Clear Sky Science · fr

Apprentissage sans rétroaction en forme fermée par projection avant

Enseigner aux machines sans messages inverses

L’intelligence artificielle moderne apprend principalement avec une méthode appelée rétropropagation, où les erreurs sont renvoyées en sens inverse dans un réseau pour ajuster ses connexions internes. Mais ce processus diffère du fonctionnement des cerveaux réels et peut être lent et gourmand en ressources. Cet article présente une nouvelle façon pour les réseaux neuronaux d’apprendre, appelée Projection avant, qui saute complètement l’étape inverse tout en obtenant de bonnes performances, en particulier sur des tâches biomédicales difficiles avec peu de données.

Une nouvelle manière de guider l’apprentissage

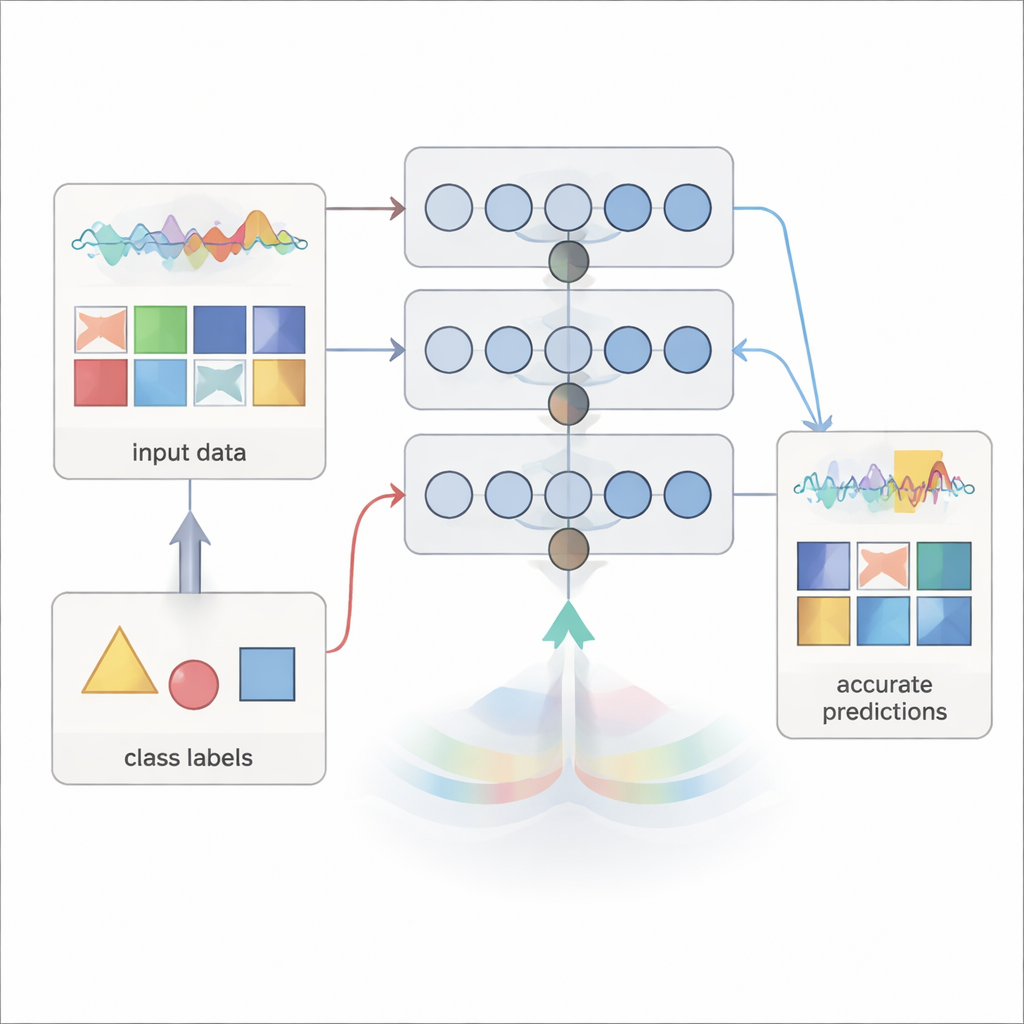

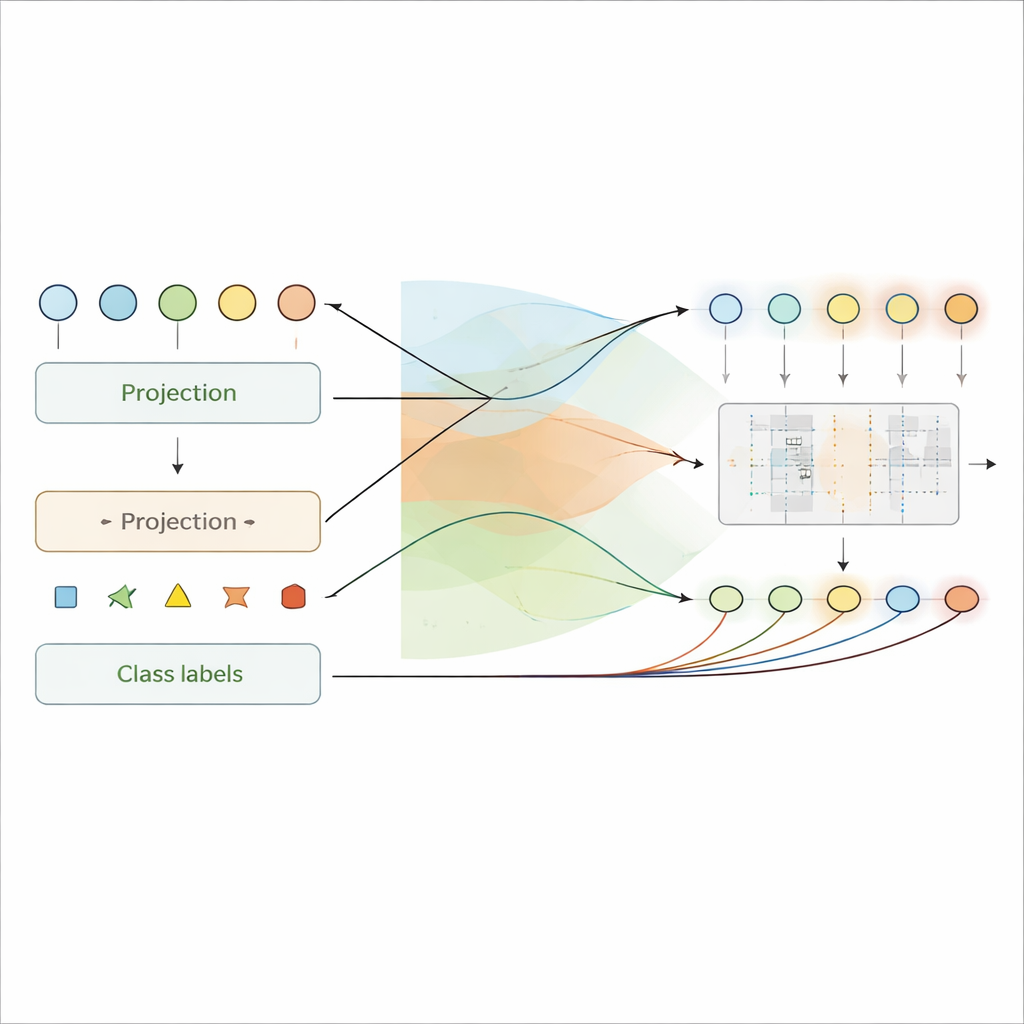

Les réseaux neuronaux classiques apprennent en comparant leurs prédictions avec les bonnes réponses et en envoyant des signaux d’erreur en arrière à travers chaque couche pour affiner les connexions. La Projection avant emprunte une voie différente. Plutôt que de s’appuyer sur ces messages d’erreur rétrogrades, elle n’utilise que l’information disponible lorsque les signaux avancent : l’activité de la couche courante et l’étiquette cible. À chaque couche, la méthode combine l’entrée de la couche et l’étiquette voulue via des projections aléatoires fixes passant par une non-linéarité simple. Cela produit un « signal cible » interne pour cette couche — un motif d’activité de type membrane que la couche doit essayer d’atteindre.

Une fois ces cibles créées, les poids de connexion de chaque couche sont résolus en une seule étape à l’aide d’une régression en forme fermée, une formule statistique standard plutôt qu’une descente de gradient itérative. Cela signifie que le réseau peut être entraîné en un seul passage sur le jeu de données, sans revisiter les mêmes exemples à plusieurs reprises ni stocker de nombreux activations intermédiaires. Parce qu’aucune information n’a besoin de circuler à rebours, la méthode respecte la communication unidirectionnelle observée dans les neurones biologiques et pourrait être plus facile à implémenter sur du matériel spécialisé à connexions unidirectionnelles.

Donner du sens à l’activité cachée

Un avantage marquant de la Projection avant est que les signaux internes dans les couches cachées deviennent directement interprétables. Puisque chaque couche est explicitement entraînée à encoder à la fois l’entrée et l’étiquette dans ses potentiels de type membrane, ces valeurs internes peuvent être lues comme des prédictions locales de la classe. Les auteurs montrent comment « décoder » approximativement ces signaux en espace d’étiquettes, transformant les motifs d’activité en explications par couche de ce que le réseau croit à chaque étape. Dans les expériences, ces explications deviennent plus précises dans les couches profondes, reflétant un apprentissage progressif — les couches précoces saisissent des schémas larges, tandis que les couches ultérieures se concentrent sur des détails cruciaux pour la décision.

Cette interprétabilité est particulièrement précieuse en médecine, où comprendre pourquoi un modèle a pris une décision peut compter autant que la décision elle‑même. Sur des données d’électrocardiogramme, les auteurs montrent que la Projection avant met en évidence des signes cliniquement connus d’infarctus — comme des changements dans des segments d’onde spécifiques — aux bons instants. Sur des scans oculaires utilisés pour détecter une croissance anormale de vaisseaux sanguins, la méthode se focalise naturellement sur des poches de liquide, des dépôts brillants et des régions cicatricielles que les spécialistes cherchent, même lorsqu’elle est entraînée avec seulement 100 exemples par classe.

Entraînement rapide, résultats solides

L’équipe a évalué la Projection avant face à plusieurs alternatives qui cherchent aussi à éviter la rétropropagation complète, ainsi qu’à la rétropropagation standard elle‑même. Sur des tâches d’images et de séquences telles que Fashion‑MNIST, la reconnaissance de promoteurs d’ADN, la détection d’infarctus à partir d’électrocardiogrammes et la reconnaissance d’objets, la nouvelle méthode a égalé ou surpassé la performance d’autres règles d’apprentissage locales. Dans des conditions standard, la rétropropagation gardait souvent un avantage global, mais la précision de la Projection avant s’en rapprochait étonnamment tout en n’utilisant qu’un seul passage d’entraînement.

Les bénéfices sont devenus plus nets dans des scénarios « few‑shot », où seuls quelques exemples étiquetés sont disponibles, comme c’est courant en pratique clinique. Là, la Projection avant a souvent mieux généralisé que la rétropropagation et que les méthodes locales concurrentes sur des radiographies thoraciques, des scans rétiniens et de petits sous‑ensembles d’images. La rétropropagation avait tendance soit à sur‑adapter les jeux de données minimes, soit à ne pas apprendre des représentations suffisamment riches, tandis que la Projection avant produisait des représentations internes plus stables et réutilisables. D’un point de vue calculatoire, l’entraînement d’une couche large demandait des ordres de grandeur moins d’opérations de multiplication‑accumulation que l’exécution de nombreuses époques de rétropropagation, se traduisant par des accélérations substantielles et une consommation d’énergie réduite.

Ce que cela signifie pour l’avenir de l’IA et l’informatique inspirée du cerveau

Concrètement, ce travail montre que les réseaux neuronaux n’ont pas besoin de s’appuyer sur des boucles de rétroaction lourdes et biologiquement improbables pour apprendre des représentations internes utiles et compréhensibles. En mélangeant astucieusement entrées et étiquettes lors d’un unique passage avant et en résolvant les poids en forme fermée, la Projection avant offre un moyen d’entraîner rapidement des modèles, d’interpréter leur fonctionnement interne et de traiter de petits jeux de données biomédicales bruités. Si la rétropropagation reste la référence pour de nombreuses tâches à grande échelle, cette approche sans rétroaction pointe vers des stratégies d’apprentissage plus proches du cerveau et plus adaptées au matériel, susceptibles de soutenir la prochaine génération de systèmes d’IA efficaces et explicables.

Citation: O’Shea, R., Rajendran, B. Closed-form feedback-free learning with forward projection. Nat Commun 17, 2414 (2026). https://doi.org/10.1038/s41467-026-69161-1

Mots-clés: apprentissage sans rétroaction, réseaux neuronaux, apprentissage en quelques exemples, IA biomédicale, apprentissage profond explicable