Clear Sky Science · fr

Vision nocturne inspirée des hiboux et calcul proche du capteur

Voir dans l’obscurité comme un hibou

Imaginez un drone capable de repérer un randonneur perdu ou un véhicule spatial lointain sans aucun projecteur, même sous un clair de ciel si faible que les caméras ordinaires ne voient pratiquement rien. Cet article décrit un nouveau matériel de vision inspiré des hiboux qui rapproche cette idée de la réalité. En imitant la façon dont les yeux du hibou s’adaptent à l’obscurité et dont son cerveau traite efficacement des signaux faibles, les chercheurs conçoivent une minuscule « synapse » électronique qui détecte la faible lumière et réalise une partie du calcul nécessaire à la reconnaissance, directement sur le capteur.

Pourquoi les machines existantes peinent la nuit

L’intelligence artificielle moderne peut reconnaître visages, objets et scènes avec une précision impressionnante, mais cela nécessite généralement des puces puissantes qui consomment énormément d’énergie. Les caméras conventionnelles séparent aussi la détection et le calcul : d’abord l’appareil capture une image, puis des processeurs distants traitent les données. En très faible luminosité, ces caméras échouent la plupart du temps à moins d’être aidées par des lampes puissantes ou un traitement numérique intensif. À l’inverse, l’œil et le cerveau du hibou fonctionnent de concert : sa rétine accumule de faibles flux de photons au fil du temps et ses circuits neuronaux s’adaptent pour que des formes ténues deviennent progressivement visibles. Les auteurs cherchent à transposer une stratégie similaire, étroitement intégrée et économe en énergie, à la vision artificielle.

Un minuscule dispositif qui apprend à partir de la lumière

Au cœur du travail se trouve une « synapse adaptative bimode inspirée du hibou » — un petit dispositif à base de transistors qui fait à la fois office de capteur lumineux et de connexion d’apprentissage entre neurones. Le dispositif est construit en couches : une électrode inférieure transparente, un film diélectrique capable de piéger des charges, un mélange spécialement conçu pour absorber la lumière, et un canal en semi‑conducteur organique en surface. Lorsqu’une lumière faible atteint la couche absorbante, quelques porteurs de charge sont générés et, guidés par une tension appliquée, se retrouvent piégés dans le diélectrique et s’accumulent dans le canal. Cela augmente progressivement la réponse électrique du dispositif, à la manière dont les bâtonnets de la rétine d’un hibou gagnent en sensibilité pendant l’adaptation à l’obscurité. Les auteurs montrent que leur dispositif peut répondre à des intensités lumineuses aussi faibles que 0,146 nanowatt par centimètre carré — environ trois ordres de grandeur plus faible que ce que gèrent les puces de caméra standards — tout en affichant un gain fort et réglable qui quantifie son adaptation à l’obscurité.

Fonctionner comme une synapse artificielle

Au‑delà de la simple détection lumineuse, le dispositif imite aussi la façon dont les synapses biologiques se renforcent ou s’affaiblissent selon l’activité. Sous des impulsions lumineuses répétées sur un large spectre, de l’ultraviolet au proche infrarouge, le courant du dispositif augmente par paliers durables, stockant une mémoire de l’historique optique. Sous des impulsions électriques appliquées à sa grille, il présente une potentialisation et une dépression à long terme — des variations graduelles et réversibles de conductance qui codent des « poids » synaptiques dans des réseaux neuronaux artificiels. Ces poids sont stockés de manière non volatile, ce qui signifie que le dispositif les conserve sans alimentation continue, et peuvent être ajustés sur plusieurs niveaux comme une valeur numérique multi‑bits. Fait crucial, chaque événement synaptique consomme de l’ordre de 10 femtojoules d’énergie, comparable ou même inférieur aux estimations pour les synapses biologiques, et des ordres de grandeur en dessous des budgets énergétiques du matériel IA typique.

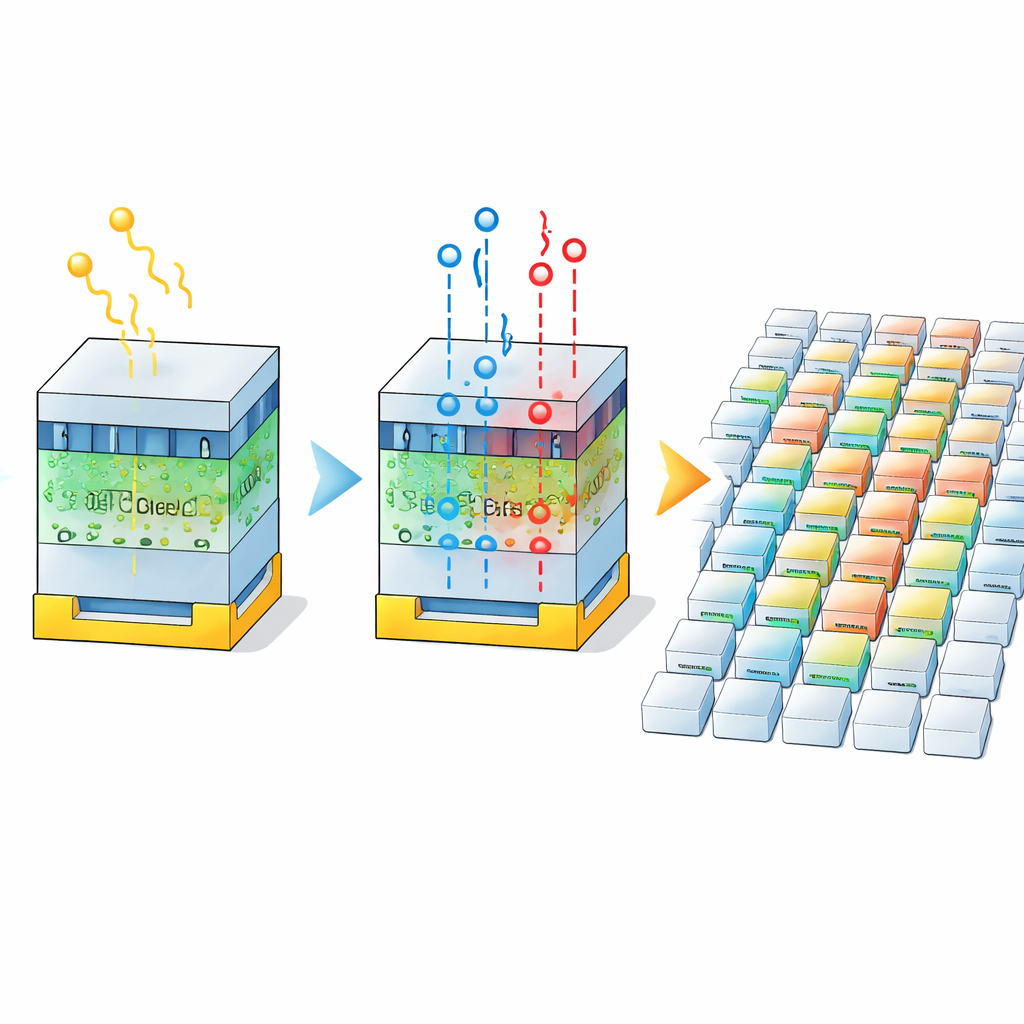

D’une synapse unique à un système de vision

Pour vérifier que ce comportement se maintient à l’échelle, l’équipe fabrique une matrice de 19 par 17 dispositifs et montre qu’ils fonctionnent de manière uniforme. Lorsqu’un motif lumineux faible est projeté sur la matrice, les photocourants aux emplacements illuminés croissent progressivement pendant l’adaptation, révélant des formes auparavant cachées sous une illumination ultra‑faible, à la manière dont la rétine d’un hibou affine une image dans le noir. Les auteurs cartographient ensuite les multiples niveaux de conductance du dispositif sur des poids dans des modèles d’apprentissage automatique, y compris des perceptrons multicouches simples, des réseaux convolutionnels et une architecture profonde de type VGG. Même avec des poids relativement grossiers et discrets, ces réseaux simulés atteignent toujours plus de 90 % de précision sur des ensembles d’images standard, démontrant que les états synaptiques suffisent pour un calcul pratique.

Vision nocturne pour drones et au‑delà

Pour illustrer le potentiel réel, les chercheurs simulent un système de reconnaissance air‑sol monté sur un petit drone, entraîné à détecter une cible en forme de vêtement à différents niveaux de luminosité correspondant à des conditions de clair de ciel. En reliant la réponse temporelle du dispositif au contraste des images capturées, ils construisent une étape de prétraitement qui « adapte » l’image, renforçant le contraste utile tout en restant dans le comportement réaliste du capteur. Un réseau populaire de détection d’objets (YOLOv5) entraîné sur ces données adaptées atteint plus de 95 % de précision de reconnaissance même au niveau de lumière le plus faible testé. En termes simples, le travail montre qu’en combinant l’adaptation à l’obscurité à la façon d’un hibou avec un apprentissage synaptique intégré directement au capteur, il est possible de pousser la vision machine dans des conditions où les caméras traditionnelles échouent, tout en consommant beaucoup moins d’énergie. Une telle technologie pourrait à terme équiper des drones de recherche‑secours, des explorateurs autonomes ou des instruments astronomiques qui voient plus en éclairant moins.

Citation: Zhao, Z., Cao, Y., Huang, S. et al. Owl-vision-inspired near sensor computing. Nat Commun 17, 2676 (2026). https://doi.org/10.1038/s41467-026-69123-7

Mots-clés: vision en faible luminosité, capteur neuromorphique, imagerie inspirée des hiboux, calcul proche du capteur, détéction d’objets de nuit