Clear Sky Science · fr

Informatique photonique neuromorphique avec une mémoire analogique électro‑optique

Pourquoi des « cerveaux » d’IA plus rapides et plus légers comptent

L’intelligence artificielle d’aujourd’hui fonctionne sur des puces informatiques gourmandes en énergie qui déplacent en permanence des données entre la mémoire et les processeurs. Cet embouteillage gaspille de l’énergie et ralentit les opérations, surtout à mesure que les modèles d’IA deviennent plus grands et plus complexes. Les travaux décrits dans cet article présentent un nouveau type de circuit de calcul fondé sur la lumière avec une mémoire analogique intégrée, conçu pour réduire fortement ces déplacements de données et rendre le matériel d’IA futur à la fois plus rapide et beaucoup plus économe en énergie.

La lumière comme nouvelle façon de calculer

Plutôt que de s’appuyer uniquement sur des électrons dans des fils métalliques, les processeurs photoniques neuromorphiques utilisent des impulsions lumineuses pour porter et combiner l’information, imitant la façon dont les signaux circulent dans les réseaux de neurones. La lumière peut voyager en plusieurs couleurs à la fois dans le même trajet, permettant un parallélisme massif et des temps de latence extrêmement faibles. Cela rend les puces photoniques attractives pour les lourdes opérations de « multiplication et addition » qui dominent les réseaux neuronaux. Cependant, la plupart des processeurs photoniques existants utilisent des « poids » fixes qui doivent être entraînés ailleurs sur du matériel numérique, puis copiés. Cela limite leur adaptabilité et laisse toujours une charge importante aux circuits de mémoire et de conversion conventionnels.

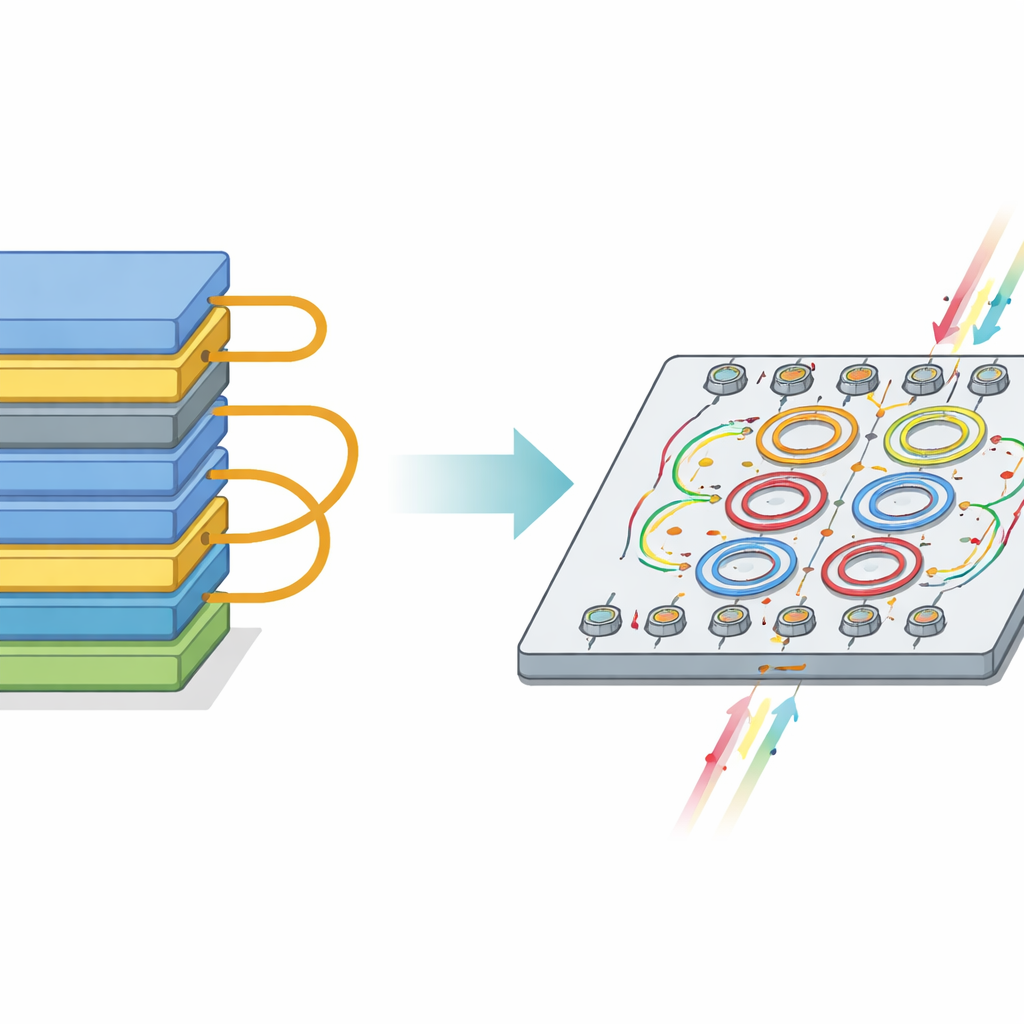

Placer la mémoire à côté de la lumière

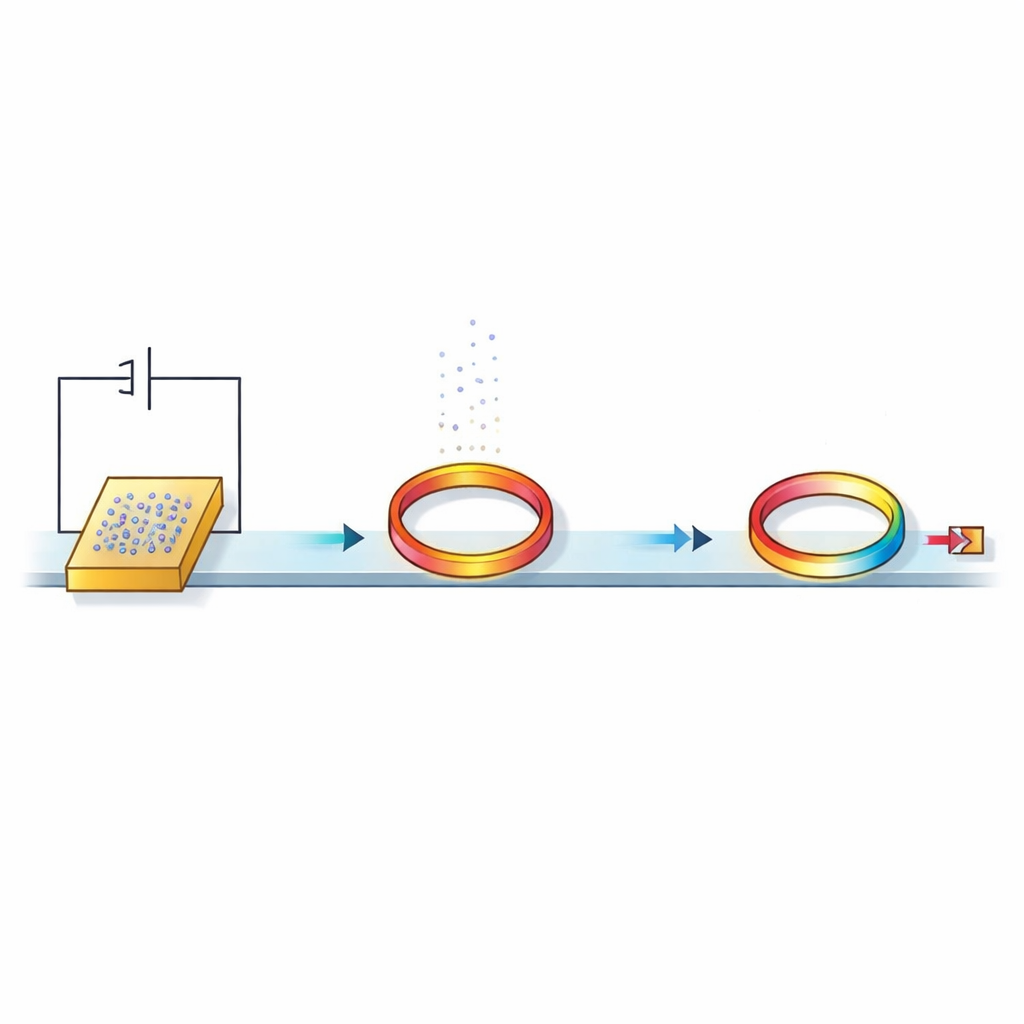

Les auteurs résolvent ce problème en ajoutant une mémoire analogique simple et compatible fonderie directement à côté de chaque minuscule élément optique qui représente un poids de réseau neuronal. Leur brique de base est une mémoire analogique électro‑optique dynamique (DEOAM) : un condensateur ordinaire connecté à une micro‑boucle en silicium qui guide la lumière. Une petite tension stockée sur le condensateur décale légèrement l’interaction de l’anneau avec la lumière qui le traverse, réglant en pratique la force d’une connexion neuronale. Comme le condensateur peut retenir cette tension pendant un court laps de temps, des convertisseurs numérique‑vers‑analogique spécialisés n’ont plus besoin d’alimenter chaque anneau en continu. À la place, un ensemble beaucoup plus réduit de convertisseurs peut mettre à jour de nombreux anneaux en séquence, tandis que la mémoire analogique maintient les valeurs programmées.

Fonctionnement de la puce prototype

L’équipe a fabriqué un circuit photonic neuromorphique sur une plate‑forme silicium commerciale en 90 nanomètres, combinant électronique standard et nanophotonique sur une même puce. Ils ont construit un réseau de résonateurs annulaires, chacun associé à sa propre cellule mémoire capacitive, plus des commutateurs simples pour écrire, maintenir ou réinitialiser les tensions stockées. Lorsqu’une tension est écrite, la réponse de l’anneau à la lumière laser change ; quand le circuit d’écriture se déconnecte, le condensateur conserve la tension, et la lumière « voit » toujours le poids programmé jusqu’à ce que la charge s’échappe progressivement. Les chercheurs ont mesuré des propriétés clés : la mémoire peut être écrite en quelques dizaines de nanosecondes, conserve des informations exploitables pendant environ un millième de seconde, et offre environ cinq bits de précision analogique. La lumière parcourt les trajets optiques en picosecondes, si bien que le calcul lui‑même est extrêmement rapide comparé au temps pendant lequel les valeurs de mémoire restent valides.

Tests avec un réseau neuronal réaliste

Pour comprendre ce que ces limites matérielles signifient pour l’IA pratique, les auteurs ont simulé le comportement d’une telle banque de poids dans un petit réseau de reconnaissance d’images entraîné sur les chiffres manuscrits du jeu de données MNIST. Ils ont cartographié un réseau à trois couches—784 entrées, 50 neurones cachés et 10 sorties—sur des matrices réalistes d’anneaux et de mémoires analogiques, en incluant le bruit, la précision limitée, la rétention finie et d’autres imperfections. L’étude montre qu’avec au moins environ quatre bits de commande pendant l’inférence, et davantage lors d’un entraînement complet sur puce, le système peut atteindre plus de 95 % de précision de classification. Ils ont aussi constaté que tant que le temps de rétention de la mémoire est au moins 100 fois supérieur au temps nécessaire pour qu’une entrée traverse le réseau, la précision reste au‑dessus de 90 % malgré la lente « fuite » des poids. En d’autres termes, une mémoire analogique modestement éphémère et fuyante peut rester très utile quand le calcul photonique est si rapide.

Économies d’énergie et compromis de conception

Un avantage central de la DEOAM est la réduction drastique du nombre de convertisseurs numérique‑vers‑analogique. Dans les conceptions conventionnelles, chaque poids optique nécessite son propre convertisseur, si bien que le nombre croît avec le carré de la taille du réseau. Avec la DEOAM, les convertisseurs sont partagés entre lignes ou colonnes, et le nombre ne croît que linéairement. En utilisant des mesures réelles de leur prototype et des données publiées pour les mémoires et circuits de conversion standard, les auteurs estiment qu’une architecture photonique intégrée avec mémoire analogique peut réduire la consommation d’énergie d’un facteur supérieur à 26 par rapport aux schémas classiques SRAM‑plus‑convertisseur. Ils analysent également comment le bruit, la taille de lot lors de l’entraînement et la nécessité de rafraîchissements périodiques de la mémoire analogique affectent les performances globales, et proposent des règles de conception pratiques pour de futurs systèmes à grande échelle.

Ce que cela signifie pour les puces d’IA de demain

Pour le grand public, le message principal est que ce travail montre une voie réaliste vers du matériel d’IA à la fois extrêmement rapide et nettement plus économe en énergie, en laissant la lumière effectuer les calculs tandis que de simples mémoires analogiques maintiennent les réglages. Même si ces mémoires s’estompent lentement, le réseau peut tolérer et même exploiter cet « oubli » comme une forme de régularisation, aidant à éviter le surapprentissage. En intégrant la mémoire directement dans le tissu optique de la puce et en réduisant fortement les étapes de conversion coûteuses, des processeurs photoniques neuromorphiques comme celui‑ci pourraient alimenter des systèmes d’IA futurs qui apprennent en continu, s’adaptent aux conditions changeantes et fonctionnent à grande vitesse sans les factures énergétiques massives des centres de données actuels.

Citation: Lam, S., Khaled, A., Bilodeau, S. et al. Neuromorphic photonic computing with an electro-optic analog memory. Nat Commun 17, 2472 (2026). https://doi.org/10.1038/s41467-026-69084-x

Mots-clés: photonique neuromorphique, mémoire analogique, informatique optique, IA économe en énergie, photonique sur silicium