Clear Sky Science · fr

L'apprentissage par transfert dans DeepLC améliore la prédiction des temps de rétention en CL à travers des modifications et des configurations sensiblement différentes

Pourquoi il est important de prédire le timing chimique

Chaque fois que des scientifiques étudient les protéines de nos cellules, ils s'appuient sur une technique qui envoie d'abord de minuscules fragments protéiques, appelés peptides, à travers une colonne remplie de liquide avant de les mesurer dans un spectromètre de masse. La durée pendant laquelle chaque peptide reste dans la colonne — son « temps de rétention » — est extrêmement informative et aide les chercheurs à reconnaître et confirmer ce qu'ils mesurent. Mais comme chaque laboratoire utilise des instruments et des réglages légèrement différents, les modèles informatiques qui prédisent ces temps de rétention se dégradent souvent lorsqu'on les transfère d'une configuration à une autre. Cet article montre comment une astuce moderne d'apprentissage automatique appelée apprentissage par transfert peut rendre ces prédictions beaucoup plus fiables et flexibles dans de nombreuses conditions expérimentales.

Chronométrer le parcours des fragments protéiques

En recherche protéique, la chromatographie liquide couplée à la spectrométrie de masse est la méthode de référence. L'étape de chromatographie liquide sépare des milliers de peptides en fonction de leurs propriétés chimiques, afin qu'ils n'arrivent pas tous en même temps au détecteur. Le temps de rétention obtenu, associé à la masse mesurée du peptide, fournit aux scientifiques une empreinte bidimensionnelle puissante. Au cours de la dernière décennie, des chercheurs ont entraîné des modèles informatiques pour prédire les temps de rétention directement à partir des séquences peptidiques. Ces prédictions améliorent la confiance dans l'identification des peptides, aident à concevoir de meilleures expériences et sont essentielles pour construire de larges bibliothèques spectrales générées par ordinateur utilisées dans les flux de travail modernes à haut débit.

Le problème des conditions de laboratoire changeantes

Malheureusement, le temps de rétention est très sensible à des détails tels que l'acidité du solvant, le matériau de la colonne, la pression et la température. Même de petits changements peuvent remanier l'ordre d'apparition des peptides à la sortie de la colonne. Les approches traditionnelles tentent de résoudre ce problème en « calibrant » un modèle entraîné ailleurs avec un petit jeu de peptides de référence, en supposant que l'ordre d'élution des peptides reste le même. Lorsque cette hypothèse échoue — par exemple lorsque la chimie de la colonne ou le pH de l'échantillon change — la calibration peut tomber en panne de façon importante. Une autre option consiste à entraîner un nouveau modèle pour chaque configuration, mais cela exige de nombreux peptides bien mesurés, qui ne sont pas toujours disponibles, surtout pour des modifications chimiques rares ou inhabituelles.

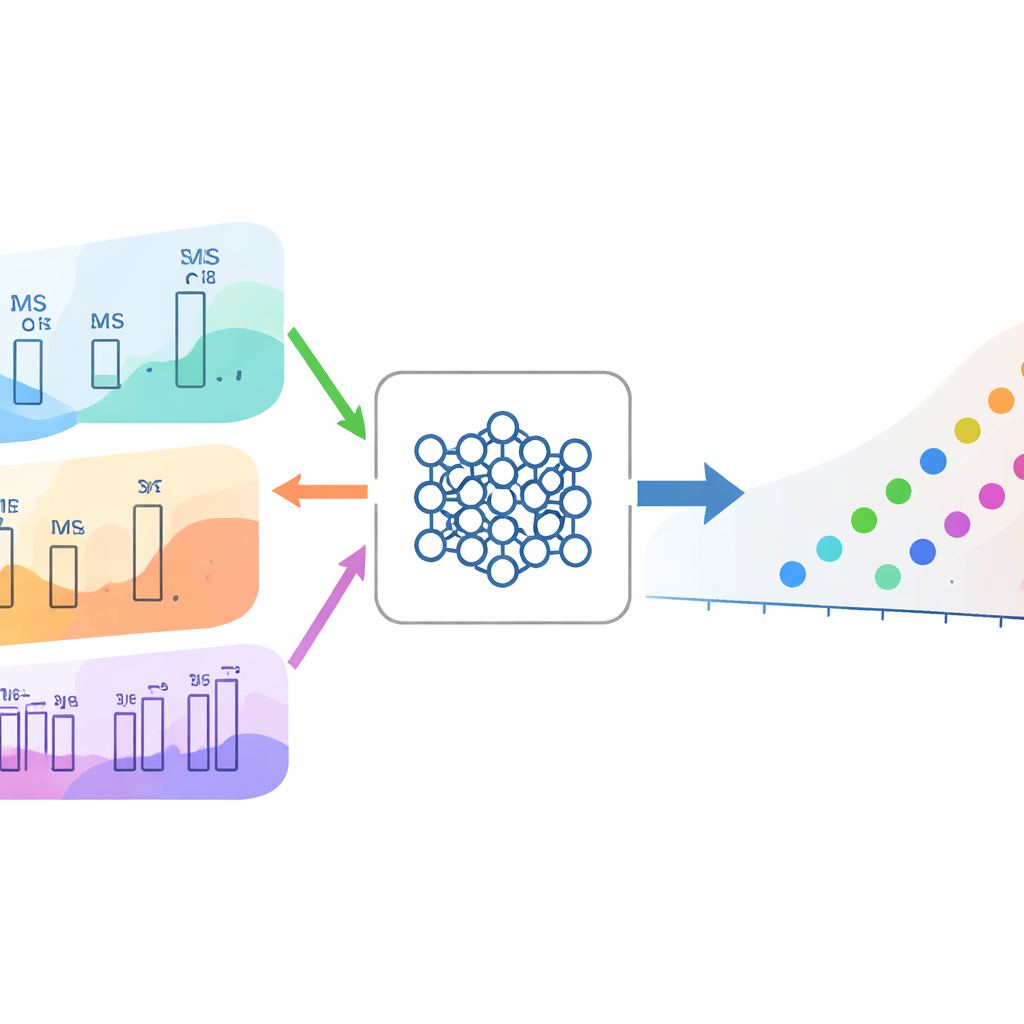

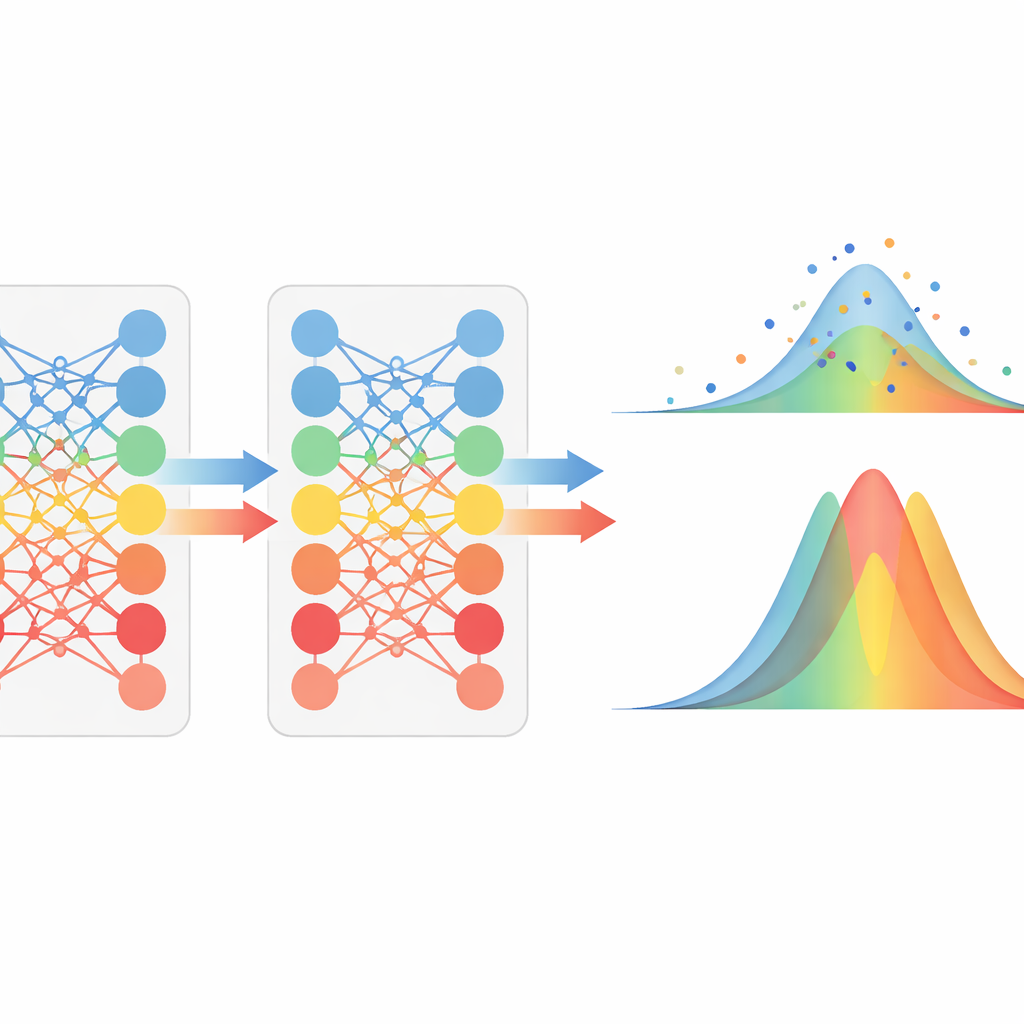

Réutiliser les connaissances avec l'apprentissage par transfert

Les auteurs s'appuient sur DeepLC, un modèle d'apprentissage profond qui prédit déjà les temps de rétention pour de nombreux types de peptides. Au lieu de repartir de zéro pour chaque nouvelle situation, ils réutilisent un modèle entraîné sur un grand jeu de données de haute qualité et le réajustent (fine-tuning) sur un ensemble beaucoup plus restreint de peptides issus de la nouvelle configuration. Sur 474 jeux de données provenant de centaines d'expériences publiques, cette stratégie d'apprentissage par transfert surpasse presque toujours à la fois la simple calibration et l'entraînement d'un nouveau modèle à partir de paramètres aléatoires. Les gains sont particulièrement nets lorsqu'il n'existe que quelques centaines à quelques milliers de peptides d'entraînement, un scénario courant dans les études réelles. Même lorsque de nombreux exemples sont disponibles, l'apprentissage par transfert tend encore à offrir une précision légèrement meilleure.

Gérer des chimiques inhabituelles et des conditions extrêmes

Pour tester jusqu'où cette approche peut être poussée, l'équipe a examiné des scénarios très difficiles. Dans l'un d'eux, les peptides portaient un grand groupement chimique qui les rend beaucoup plus « gras », décalant fortement leurs temps de rétention. Dans un autre, le liquide de la colonne était rendu basique plutôt qu'acide, modifiant fondamentalement la façon dont les peptides interagissent avec la colonne. Dans les deux cas, la simple calibration d'un ancien modèle a échoué, et même un modèle nouvellement entraîné a nécessité de nombreux exemples pour atteindre une bonne précision. L'apprentissage par transfert, en revanche, s'est adapté rapidement, atteignant des performances similaires ou supérieures avec deux à trois fois moins de peptides d'entraînement. La méthode a également amélioré les prédictions pour un large panel de modifications post-traductionnelles jamais vues pendant l'entraînement, indiquant que les connaissances préalables du modèle sur la chimie peptidique se transfèrent à de nouvelles modifications.

Ce que cela signifie pour les futures études protéiques

Pour les non-spécialistes, le message central est que réutiliser ce qu'un réseau neuronal a déjà appris sur le comportement des peptides facilite grandement l'obtention de prédictions de temps précises dans de nouvelles conditions expérimentales. Plutôt que de collecter laborieusement de grands jeux d'entraînement ou d'accepter de faibles performances issues d'une calibration simple, les chercheurs peuvent réajuster un modèle DeepLC existant avec un nombre modeste d'exemples et obtenir malgré tout des temps de rétention très précis. Cela rend les outils de prédiction avancés plus robustes et plus accessibles, permettant des analyses fiables à travers différents instruments, conditions chimiques et modifications peptidiques rares, et aidant en fin de compte les scientifiques à lire le monde des protéines avec plus de clarté et d'efficacité.

Citation: Bouwmeester, R., Nameni, A., Declercq, A. et al. Transfer learning in DeepLC improves LC retention time prediction across substantially different modifications and setups. Nat Commun 17, 2601 (2026). https://doi.org/10.1038/s41467-026-68981-5

Mots-clés: protéomique, chromatographie liquide, prédiction du temps de rétention, apprentissage profond, apprentissage par transfert