Clear Sky Science · fr

Collaboration humain‑IA pour améliorer l’exactitude et l’efficacité du pré‑dépistage des critères d’éligibilité aux essais en oncologie : essai randomisé d’évaluation utilisant des dossiers de santé électroniques rétrospectifs

Pourquoi trouver les bons patients est important

Pour de nombreuses personnes atteintes de cancer, participer à un essai clinique peut ouvrir l’accès à des traitements de pointe et à de meilleurs résultats. Pourtant, une faible proportion des adultes atteints de cancer s’inscrit réellement à un essai. Un goulot d’étranglement majeur survient bien avant la signature d’un consentement : le personnel doit fouiller des dossiers médicaux longs et désordonnés pour déterminer qui remplit les critères. Cette étude examine si l’association d’experts humains avec un système d’intelligence artificielle peut rendre ce tri initial plus précis — sans ralentir le processus.

Comment se déroule le dépistage des essais aujourd’hui

Avant qu’une personne puisse rejoindre un essai en oncologie, l’équipe de recherche clinique doit vérifier si le patient respecte des dizaines de règles d’inclusion détaillées, comme le type et le stade du cancer, les résultats d’examens et l’état fonctionnel au quotidien. Une grande partie de ces informations est enfouie dans des notes non structurées — comptes rendus d’imagerie, consultations, synthèses de laboratoire — souvent répétitives, incomplètes ou contradictoires. Parcourir manuellement ces documents est lent et épuisant, et même le personnel expérimenté peut manquer des éléments clés. En conséquence, certains patients éligibles ne sont jamais identifiés et des options potentiellement salvatrices sont perdues.

Ce que les chercheurs ont testé

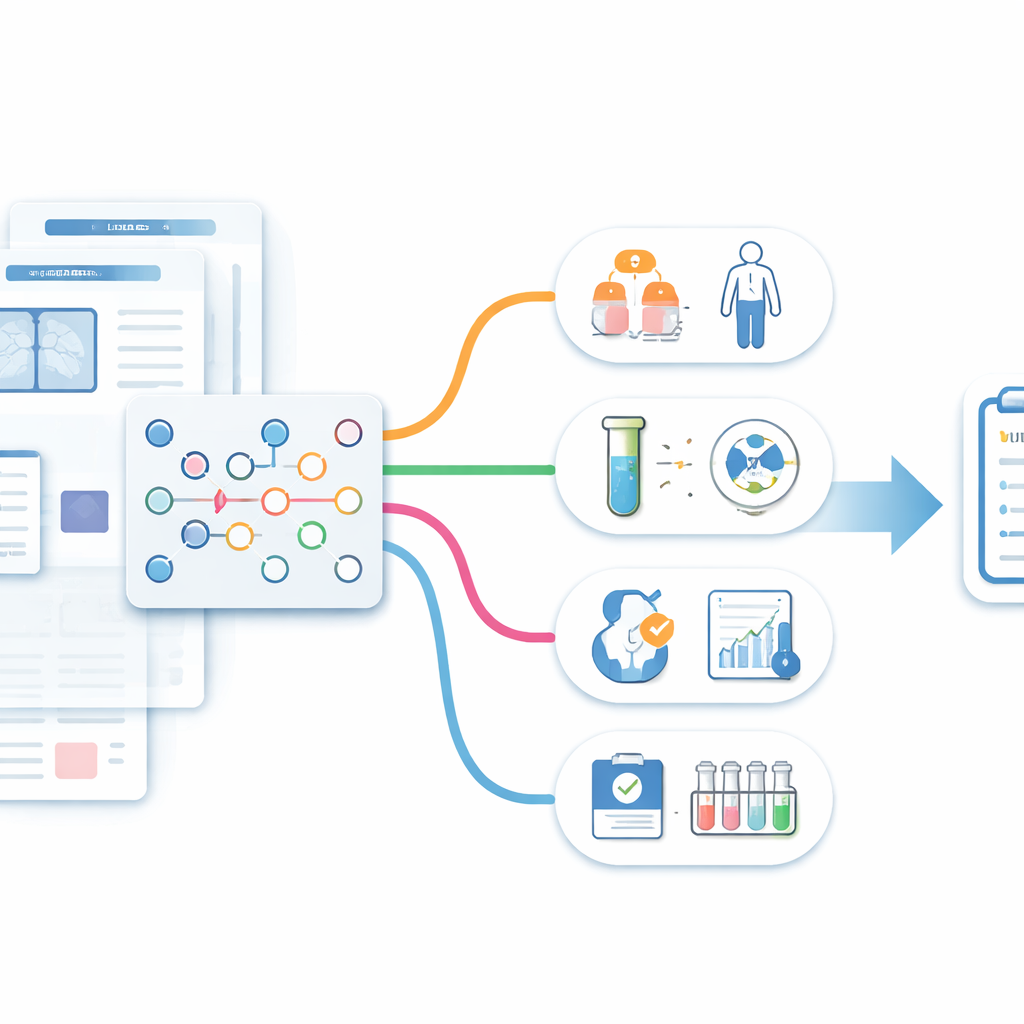

Pour évaluer l’apport de l’IA, l’équipe a utilisé les dossiers électroniques de 355 personnes atteintes d’un cancer du poumon ou colorectal prises en charge dans une pratique communautaire. Ils se sont concentrés sur 12 critères d’essais courants, incluant le stade tumoral, des biomarqueurs spécifiques, la réponse aux traitements antérieurs et l’état de santé général. Un système linguistique « neuro‑symbolique » spécialisé a d’abord converti les dossiers numérisés en texte, puis extrait des faits structurés tels que résultats d’examens et détails de stadification. Deux coordinateurs de recherche formés ont ensuite revu chaque dossier deux fois — une fois avec les suggestions de l’IA affichées (approche Humain+IA) et une fois sans (approche Humain seul), dans un ordre aléatoire. Un groupe distinct de cliniciens avait préalablement établi une clé de référence (« gold standard ») pour chaque dossier afin d’évaluer l’exactitude.

Performance de l’équipe Humain–IA

Lorsque les humains et l’IA ont travaillé ensemble, ils ont correspondu aux réponses de référence plus souvent que les humains seuls. Globalement, l’équipe Humain+IA a correctement identifié environ trois détails sur quatre, contre un peu plus de sept sur dix pour les réviseurs humains seuls, et bien mieux que le système d’IA isolé. Les plus grands gains sont apparus dans des domaines délicats comme les tests et résultats de biomarqueurs, la stadification précise de la tumeur et la réponse du patient aux traitements antérieurs. Dans ces catégories, la capacité de l’IA à filtrer de grands volumes de texte a aidé les coordinateurs à repérer des informations qu’ils auraient pu passer à côté, tandis que les humains corrigeaient les erreurs de l’IA et interprétaient les cas incertains.

Vitesse, compromis et biais humains

De façon surprenante, l’ajout de l’IA n’a pas accéléré le processus. Les deux approches ont pris un peu plus d’une demi‑heure par dossier en moyenne. Les auteurs suggèrent que, plutôt que de faire gagner du temps, l’IA a modifié le travail des coordinateurs : au lieu de chercher eux‑mêmes chaque détail, ils ont consacré plus d’efforts à vérifier et interpréter les éléments proposés par l’IA. Cela peut en réalité constituer une protection saine, réduisant le risque que les personnes acceptent mécaniquement les réponses de la machine sans les remettre en question. L’étude a aussi exploré les situations où la collaboration peut échouer. Pour une mesure du fonctionnement du patient, l’IA s’est révélée peu fiable, et les réviseurs humains qui se sont trop appuyés sur sa sortie ont fait légèrement moins bien — signe d’un « biais d’automatisation ». Dans d’autres domaines, les humains semblaient sous‑utiliser des signaux d’IA exacts, suggérant un « biais de confirmation », où l’on privilégie les informations qui confirment sa première impression.

Ce que cela signifie pour les soins du cancer à venir

En termes clairs, cet essai montre qu’un partenariat bien conçu entre humains et IA peut rendre le pré‑dépistage des essais un peu plus précis sans le ralentir. Les améliorations sont modestes, mais elles se concentrent précisément sur les types de détails complexes — comme le statut des biomarqueurs et la stadification précise — qui déterminent souvent l’admissibilité d’un patient à une étude. Si de tels systèmes sont affinés et testés dans des flux de travail cliniques en direct, ils pourraient aider à identifier davantage de patients éligibles, élargir l’accès aux essais oncologiques de pointe et ce, tout en laissant aux humains la décision finale.

Citation: Parikh, R.B., Kolla, L., Beothy, E.A. et al. Human-AI teaming to improve accuracy and efficiency of eligibility criteria prescreening for oncology trials: a randomized evaluation trial using retrospective electronic health records. Nat Commun 17, 2306 (2026). https://doi.org/10.1038/s41467-026-68873-8

Mots-clés: essais cliniques contre le cancer, dossiers de santé électroniques, intelligence artificielle, éligibilité des patients, collaboration humain‑IA