Clear Sky Science · fr

Les connexions récurrentes facilitent la reconnaissance d’objets occlus en « expliquant » l’occlusion

Comment le cerveau voit ce qui n’est pas là

Dans la vie quotidienne, nous reconnaissons sans effort des objets partiellement cachés — un chat derrière un rideau, une voiture derrière un arbre. Cet article se demande comment les cerveaux, et les réseaux artificiels inspirés du cerveau, accomplissent cet exploit. Les auteurs montrent que les circuits comportant des boucles de rétroaction peuvent utiliser l’information sur l’objet qui cache pour « reconstituer » mentalement ce qui se trouve derrière, révélant un tour clé sur lequel notre système visuel pourrait s’appuyer lorsque le monde est encombré et incomplet.

Pourquoi les objets cachés posent un problème difficile

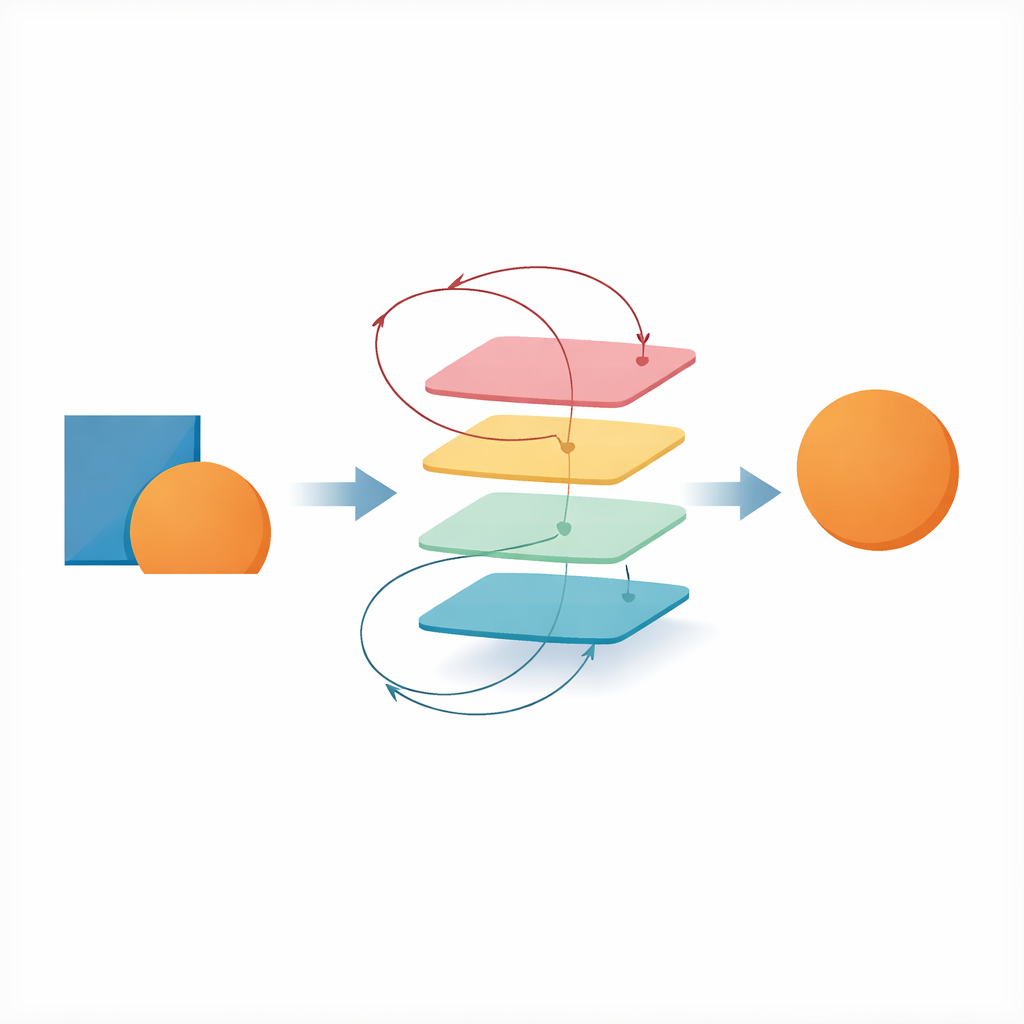

Lorsqu’un objet est occlus, bon nombre de ses caractéristiques visuelles habituelles sont absentes ou déformées. Un système visuel purement feedforward, où l’information circule directement des yeux vers les centres de reconnaissance, doit deviner l’objet caché uniquement à partir des fragments visibles. Les cerveaux biologiques, en revanche, sont remplis de connexions récurrentes — des boucles où les zones supérieures renvoient de l’information aux zones antérieures. On soupçonne depuis longtemps que ces boucles aident pour des tâches difficiles comme la reconnaissance d’objets occlus, mais on ne savait pas précisément quel avantage elles apportent ni comment elles modifient les représentations internes de ce que nous voyons.

Mettre à l’épreuve des réseaux inspirés du cerveau

Les auteurs ont construit une large batterie de réseaux convolutionnels profonds qui imitent des étapes du traitement visuel. Certains étaient purement feedforward, d’autres comportaient des boucles récurrentes ou un feedback top-down additionnel. Ils ont entraîné ces modèles sur des ensembles d’images personnalisés où un article de mode en recouvrait partiellement un autre. Les réseaux devaient identifier à la fois l’objet de devant (occlusif) et celui de derrière (occulé) selon différentes configurations de tâche. La performance dépendait moins du fait qu’un réseau soit récurrent ou feedforward que de sa « profondeur computationnelle » — le nombre d’étapes de traitement séquentielles que subit une entrée. Des modèles feedforward profonds pouvaient rivaliser ou dépasser les réseaux récurrents sur la tâche de reconnaissance de base, montrant que la récurrence n’est pas intrinsèquement supérieure.

Une astuce spéciale : expliquer l’occlusion

Bien que la profondeur importât le plus pour la précision brute, les réseaux récurrents montraient un avantage distinctif dans la façon dont ils utilisaient le contexte. Lorsque ces réseaux devaient d’abord identifier l’objet de devant puis seulement ensuite l’objet caché, leur performance sur l’objet occlus s’améliorait comparé à la classification réalisée seule. Ce schéma n’apparaissait pas dans les réseaux feedforward ordinaires qui produisaient les deux étiquettes simultanément. Les auteurs interprètent cela comme de « l’explication de l’occlusion » : une fois que le système a reconnu l’occlusif, il peut attribuer les caractéristiques étranges et manquantes de l’image à cet occlusif plutôt qu’en faire la preuve d’un objet nouveau et étrange. Dans des scènes 3D plus réalistes et dans un modèle inspiré du primate (CORnet), le même ordre — objet de devant avant objet caché — améliorait également la reconnaissance.

Voir le même effet chez les humains

Pour tester si les humains utilisent une stratégie similaire, les chercheurs ont réalisé une expérience en ligne. Les participants voyaient brièvement un objet isolé, puis une scène où un objet en cachait un autre, et devaient enfin choisir lequel de deux choix avait été l’objet caché. Sur certaines épreuves, l’objet isolé vu au départ était le même que l’occlusif ultérieur ; sur d’autres, il était sans rapport. Lorsque les personnes venaient de voir l’occlusif réel, elles identifiaient l’objet caché plus précisément et répondaient plus vite, à différents niveaux d’occlusion. Cela suggère que nos cerveaux, comme les réseaux récurrents, bénéficient de traiter d’abord l’élément qui cache, puis d’utiliser cette connaissance pour interpréter les indices partiels de ce qui se trouve derrière.

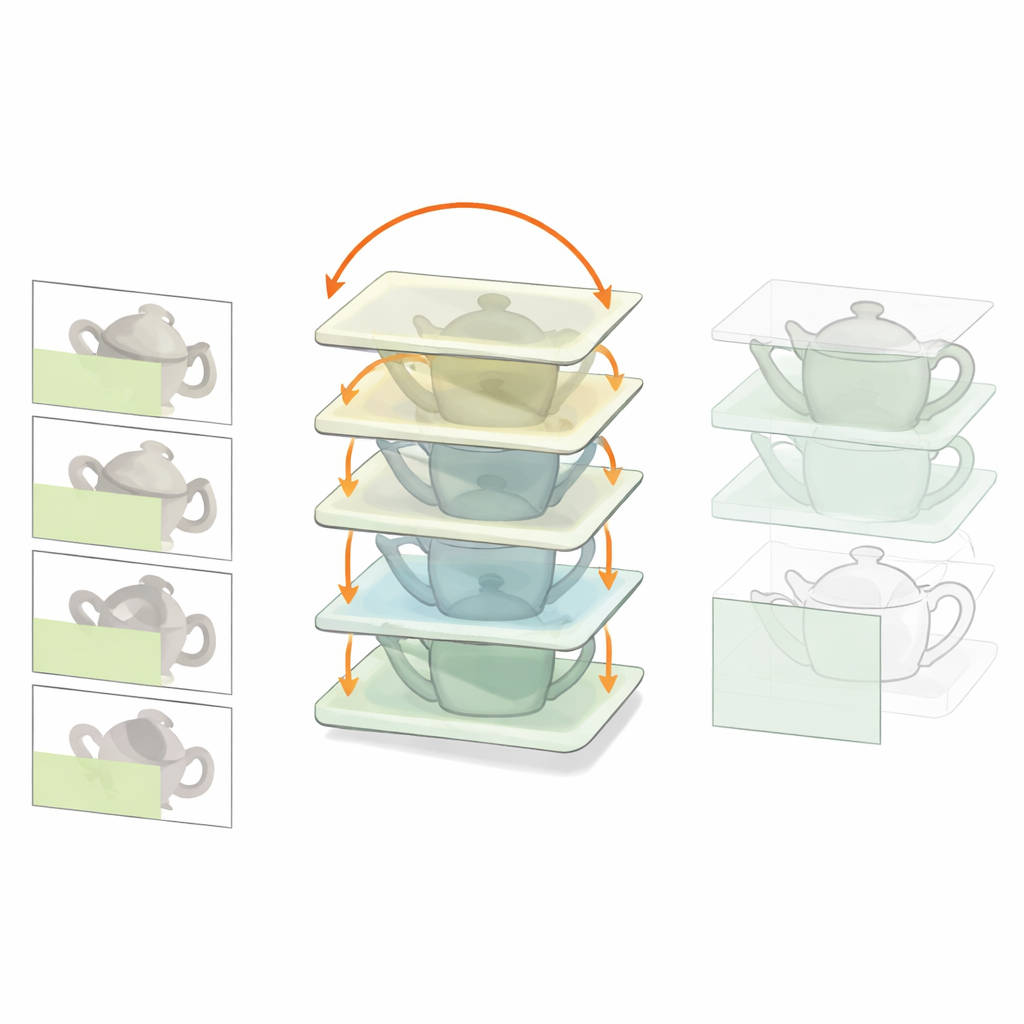

Reconstruire des images cachées de l’intérieur

Pour approfondir le mécanisme, les auteurs ont conçu un modèle plus proche de la biologie, Recon-Net, basé de manière lâche sur les interactions entre le cortex visuel et le cortex préfrontal. Recon-Net reçoit une image contenant un objet occlus ainsi qu’une vue séparée de l’occlusif et transforme itérativement une représentation interne jusqu’à ce qu’elle corresponde à ce que devrait être la version non occluse de l’objet caché. Fait frappant, des classifieurs entraînés uniquement sur des images propres et non occluses peuvent reconnaître les sorties de Recon-Net presque aussi bien que s’ils avaient été entraînés directement sur des exemples occlus. Cela signifie que le traitement récurrent « reconstitue » efficacement une image interne nette de l’objet caché, même si les pixels manquent.

Ce que cela signifie pour les cerveaux et les machines

Globalement, l’étude montre que les boucles de rétroaction ne concernent pas seulement la performance brute, mais une manière qualitativement différente d’utiliser le contexte. Les connexions récurrentes soutiennent naturellement l’explication de l’occlusion : elles permettent au système visuel de prendre en compte la façon dont un occlusif déforme ce que nous voyons et de restaurer une représentation interne stable de l’objet caché. Parallèlement, les auteurs constatent que l’entraînement sur des images fortement occluses peut laisser les réponses aux images claires largement inchangées, ce qui pourrait faciliter l’apprentissage dans les cerveaux réels en évitant un remaniement constant. Ces résultats pointent vers un principe commun pour la neuroscience et l’intelligence artificielle : quand le monde cache des informations, les systèmes intelligents ne se contentent pas de regarder plus attentivement — ils infèrent pourquoi elles manquent.

Citation: Kang, B., Midler, B., Chen, F. et al. Recurrent connections facilitate occluded object recognition by explaining-away. Nat Commun 17, 2225 (2026). https://doi.org/10.1038/s41467-026-68806-5

Mots-clés: reconnaissance d’objets occlus, réseaux neuronaux récurrents, perception visuelle, expliquer l’occlusion, neurosciences computationnelles