Clear Sky Science · fr

Former des capteurs tactiles pour apprendre la détection des forces les uns des autres

Des robots qui peuvent sentir et partager leur sens du toucher

Alors que les robots quittent les usines pour s’installer dans les foyers, les hôpitaux et les entrepôts, ils ont besoin d’un sens que nous tenons souvent pour acquis : le toucher. Tout comme nos doigts s’ajustent automatiquement lorsque nous saisissons une chips versus une lourde boîte, les robots du futur doivent apprendre combien serrer et quand un objet est sur le point de glisser. Cet article présente une nouvelle façon pour une « peau » robotique d’apprendre la détection des forces à partir d’autres peaux, réduisant les calibrages coûteux et rapprochant les machines d’une dextérité proche de celle des humains.

Pourquoi il est si difficile d’obtenir un toucher robotique fiable

Les robots modernes disposent déjà de nombreux types de peau artificielle. Certains utilisent de minuscules caméras regardant à l’intérieur de gels souples, d’autres reposent sur des aimants ou des grilles électroniques qui détectent la pression. Chaque conception excelle pour certaines tâches, mais elles parlent toutes des « dialectes » différents du toucher : la même pression sur deux capteurs peut produire des signaux très différents. Aujourd’hui, chaque nouveau capteur nécessite généralement son propre processus d’entraînement laborieux avec des capteurs de force précis, répété des milliers de fois. Pire encore, les matériaux souples vieillissent et s’usent, de sorte que ce calibrage coûteux doit être refait chaque fois qu’un capteur est remplacé.

Emprunter une idée au cerveau humain

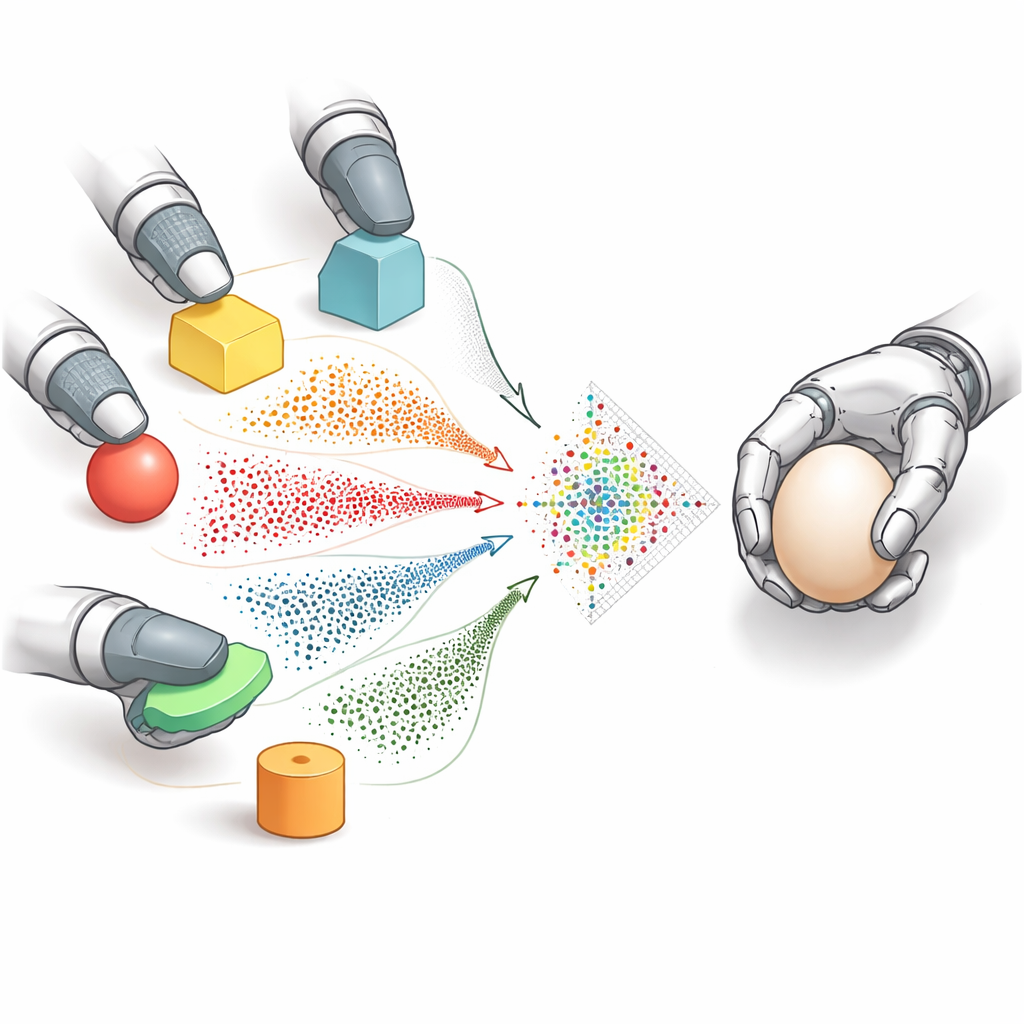

Les humains résolvent un problème similaire sans effort. Notre peau regorge de différents types de récepteurs tactiles, et pourtant le cerveau convertit tous leurs signaux en un code interne partagé. Cette mémoire tactile unifiée nous permet d’estimer la sensation d’un objet sur une partie de la main qui ne l’a jamais touché, simplement en s’appuyant sur l’expérience passée. Les chercheurs à l’origine de ce travail reproduisent cette idée chez les robots. Ils convertissent toutes les sorties des capteurs — images de caméra, relevés magnétiques ou signaux électroniques — en une forme commune, ressemblant à une image composée de points, qui représentent la déformation de la peau. Cette représentation partagée par marqueurs sert de « langue du toucher » simple que n’importe quel capteur peut utiliser.

Apprendre à un capteur à imiter un autre

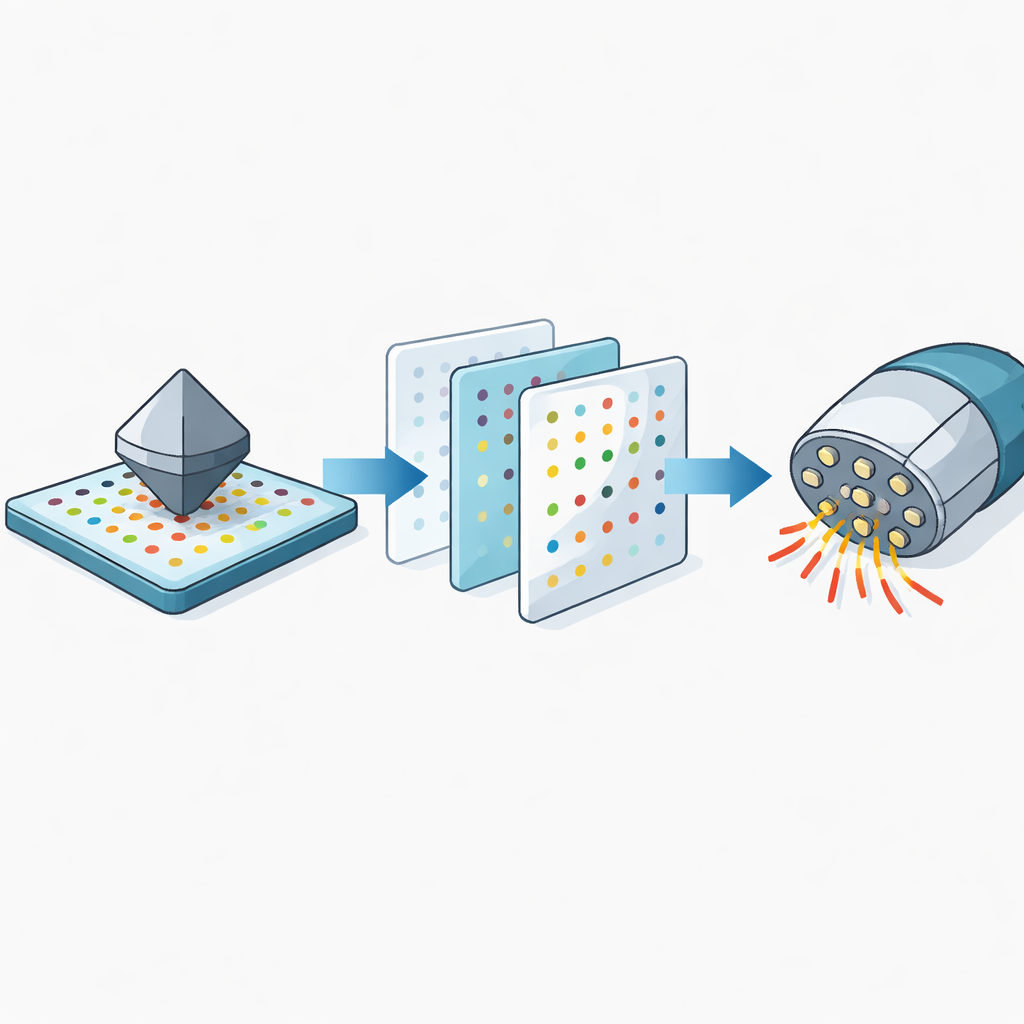

Une fois que tous les capteurs parlent ce langage à base de points, l’équipe introduit une étape de traduction appelée traduction marqueur-à-marqueur. En utilisant de puissants modèles génératifs, ils entraînent un système capable de transformer le motif de points d’un capteur en le motif qu’un autre capteur aurait affiché sous le même contact. Cela signifie qu’un capteur bien calibré peut efficacement « imaginer » ce qu’un capteur non calibré ressentirait et générer des données d’entraînement synthétiques pour celui-ci. Un second modèle analyse ensuite de courtes séquences de ces images de points pour prédire comment les forces évoluent dans le temps selon trois directions, en tenant compte à la fois de la poussée et du cisaillement latéral.

Gérer les différences du monde réel dans les peaux souples

En pratique, les différentes peaux robotiques ne diffèrent pas seulement par leur forme et leur câblage ; elles sont aussi fabriquées à partir de matériaux plus ou moins souples, qui évoluent avec l’âge. Ces différences peuvent fausser les estimations de force même si les motifs paraissent similaires. Les chercheurs mesurent la manière dont chaque type de matériau souple se déforme sous charge et intègrent une étape de correction simple qui ajuste les étiquettes de force vers le haut ou vers le bas avant l’entraînement. Cette compensation matérielle réduit fortement les erreurs, en particulier lors du transfert de connaissances entre des peaux très souples et très rigides.

Du banc de laboratoire à la manipulation quotidienne

L’équipe teste leur méthode, appelée GenForce, sur un large échantillon de capteurs, depuis plusieurs exemplaires du même pad à base de caméra jusqu’à des conceptions très différentes utilisant des aimants ou des formes courbées rappelant la pulpe d’un doigt. Sur plus de 200 combinaisons en simulation et sur matériel, GenForce réduit nettement les erreurs de prédiction comparé à la simple réutilisation d’un modèle entraîné sur un autre capteur. Lors de démonstrations, une main robotique équipée de différentes peaux tactiles sur chaque doigt utilise des modèles transférés pour saisir délicatement des objets fragiles comme des fruits ou des chips, et pour détecter et corriger le glissement en coordonnant les relevés des deux côtés d’une prise.

Ce que cela signifie pour l’avenir des mains robotiques

En permettant aux capteurs tactiles d’apprendre la détection des forces les uns des autres au lieu de repartir de zéro, GenForce ouvre la voie à des mains robotiques plus faciles et moins chères à déployer à grande échelle. Un seul capteur soigneusement calibré pourrait en entraîner beaucoup d’autres, même de conceptions différentes, et des modèles pré-entraînés pourraient être ajustés avec une petite quantité de nouvelles données. Pour le non-spécialiste, la conclusion est simple : ce travail rend plus pratique la capacité des robots à sentir la force qu’ils appliquent et à réagir rapidement quand les objets commencent à glisser, nous rapprochant de machines qui manipulent le monde réel avec la même assurance tactile que les mains humaines.

Citation: Chen, Z., Ou, N., Zhang, X. et al. Training tactile sensors to learn force sensing from each other. Nat Commun 17, 2101 (2026). https://doi.org/10.1038/s41467-026-68753-1

Mots-clés: toucher robotique, capteurs tactiles, détection de force, manipulation robotique, apprentissage par transfert