Clear Sky Science · fr

Perception visuelle ultra-rapide au-delà des capacités humaines rendue possible par l’analyse du mouvement utilisant des transistors synaptiques

Pourquoi une vision robotique plus rapide est importante

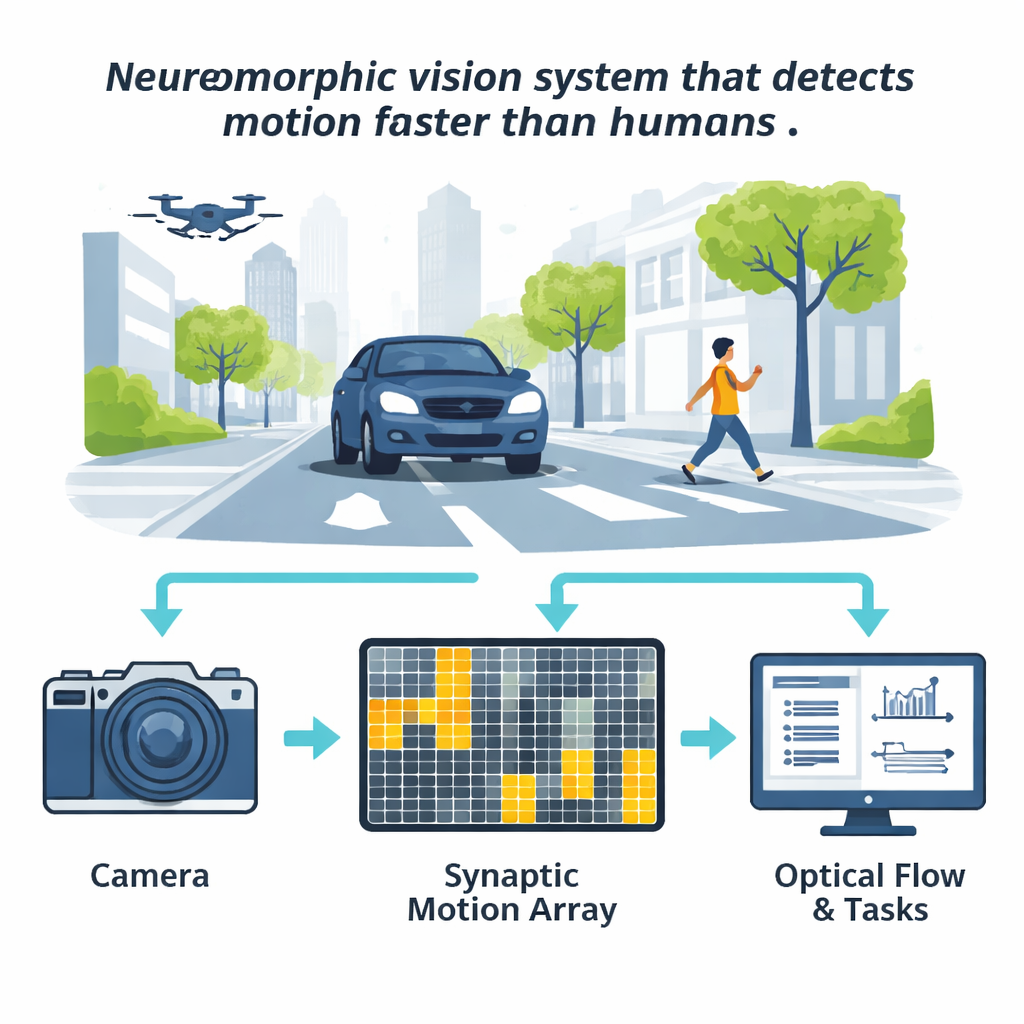

Lorsqu’un système de conduite autonome ou un drone réagit même une fraction de seconde trop lentement, les conséquences peuvent être graves. Les meilleurs algorithmes de vision par ordinateur d’aujourd’hui égalent ou dépassent les humains sur des tests standards, mais ils mettent encore trop de temps à traiter chaque image vidéo en temps réel. Cet article présente un nouveau type de matériel de vision, inspiré du cerveau, qui permet aux machines de détecter le mouvement bien plus vite que l’humain, sans sacrifier la précision.

Comment on apprend normalement aux machines à percevoir le mouvement

L’analyse du mouvement classique repose sur une technique appelée flux optique, qui estime comment chaque point d’une image se déplace d’une image à la suivante. Elle fonctionne bien mais est lourde en calcul : pour une image haute définition complète, une carte graphique puissante peut nécessiter plus d’une demi-seconde pour terminer le traitement. Dans des scénarios à mouvement rapide comme la conduite sur autoroute, ce délai peut se traduire par des dizaines de mètres parcourus avant que le système ne reconnaisse un danger. Contrairement au système visuel humain, qui se concentre rapidement sur les parties les plus pertinentes d’une scène, les algorithmes standard traitent consciencieusement chaque pixel, y compris les régions d’arrière-plan statiques qui apportent peu d’information utile.

Emprunter une astuce aux premiers stades de la vision du cerveau

La biologie résout ce problème en utilisant des couches de filtrage précoces dans l’œil et le thalamus pour mettre en évidence les zones de changement et atténuer tout le reste. Les auteurs reproduisent cette idée en silicium en construisant un module neuromorphique d’« attention temporelle ». Une caméra standard capture toujours les images, mais les variations de luminosité sont aussi envoyées dans une grille compacte de transistors synaptiques — des dispositifs électroniques qui se comportent un peu comme des connexions ajustables dans le cerveau. Chaque dispositif accumule localement combien la lumière dans sa région assignée a changé sur une courte fenêtre temporelle. Les zones de la grille qui voient de fortes variations s’illuminent en tant que régions d’intérêt, tandis que les zones plus calmes s’estompent en arrière-plan.

Des transistors intelligents qui mémorisent le mouvement

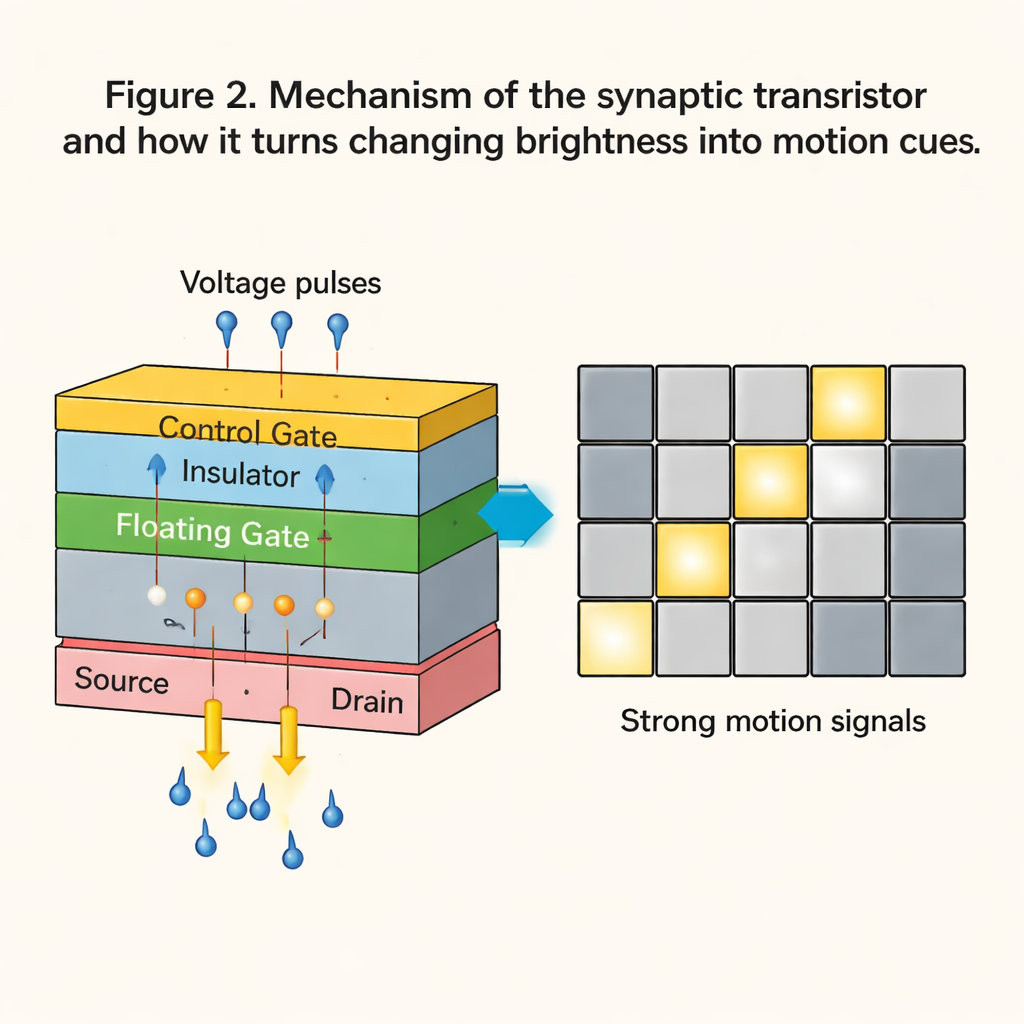

Au cœur de ce système se trouve un transistor synaptique à grille flottante spécialement conçu, construit à partir de matériaux empilés d’épaisseur atomique. En appliquant de brèves impulsions de tension, la conductance du dispositif peut être ajustée puis maintenue pendant des heures, stockant effectivement une mémoire de l’activité visuelle récente. Les transistors répondent en environ 100 microsecondes — assez vite pour la vidéo à grande vitesse — et supportent des milliers de cycles de mise à jour sans se dégrader. L’équipe a mis à l’échelle un dispositif unique en une matrice 4×4 et a montré comment les variations de luminosité de la caméra sont converties en impulsions de tension qui poussent sélectivement certaines cellules vers des états de haute conductance « mouvement » tout en supprimant les scintillements mineurs et le bruit.

Concentrer les calculs lourds uniquement là où cela compte

La sortie de la matrice est transformée en une « carte thermique » grossière du mouvement qui marque des régions d’intérêt compactes. Plutôt que d’exécuter un code de flux optique coûteux sur l’ensemble de l’image, le système n’analyse que ces zones mises en évidence, avec un léger bourrage autour d’elles. Les auteurs démontrent que cette approche s’intègre directement à plusieurs méthodes de flux optique populaires, depuis des algorithmes classiques comme Farneback jusqu’à des modèles d’apprentissage profond modernes tels que RAFT et GMFlow. Dans des tests impliquant voitures, drones, bras robotiques et sports rapides comme le tennis de table, l’interface neuromorphique de première couche réduit systématiquement le temps consacré à l’estimation du mouvement et aux tâches subséquentes — telles que la prédiction du déplacement d’un objet, la segmentation d’objets en mouvement par rapport à l’arrière-plan, ou le suivi d’une cible — d’environ un facteur quatre.

Devancer la réaction humaine sans perdre en précision

De manière cruciale, cet accélération ne se fait pas au détriment de la fiabilité. En fournissant des informations supplémentaires sur les endroits où le mouvement est probable, les indices temporels améliorent souvent la précision, surtout pour le suivi d’objets et la segmentation dans des scènes encombrées. Dans des scénarios de véhicules et de petits drones, les métriques de performance des tâches ont plus que doublé comparées aux pipelines conventionnels, tandis que les temps de traitement totaux sont tombés dans des dizaines de millisecondes — à la hauteur, voire meilleurs, que les temps de réaction humains typiques d’environ 150 millisecondes. Les auteurs soutiennent que cette interface neuromorphique de détection du mouvement peut être associée à de nombreux algorithmes de vision existants, et même à des détecteurs d’objets au-delà du flux optique, pour offrir aux robots, véhicules et machines interactives une manière beaucoup plus rapide et ciblée de comprendre des environnements dynamiques.

Citation: Wang, S., Zhao, J., Pu, T. et al. Ultrafast visual perception beyond human capabilities enabled by motion analysis using synaptic transistors. Nat Commun 17, 1215 (2026). https://doi.org/10.1038/s41467-026-68659-y

Mots-clés: vision neuromorphique, flux optique, transistors synaptiques, perception robotique, conduite autonome