Clear Sky Science · fr

Calcul analogique en mémoire pour la factorisation de matrices non négatives

Pourquoi il est important de découper les big data

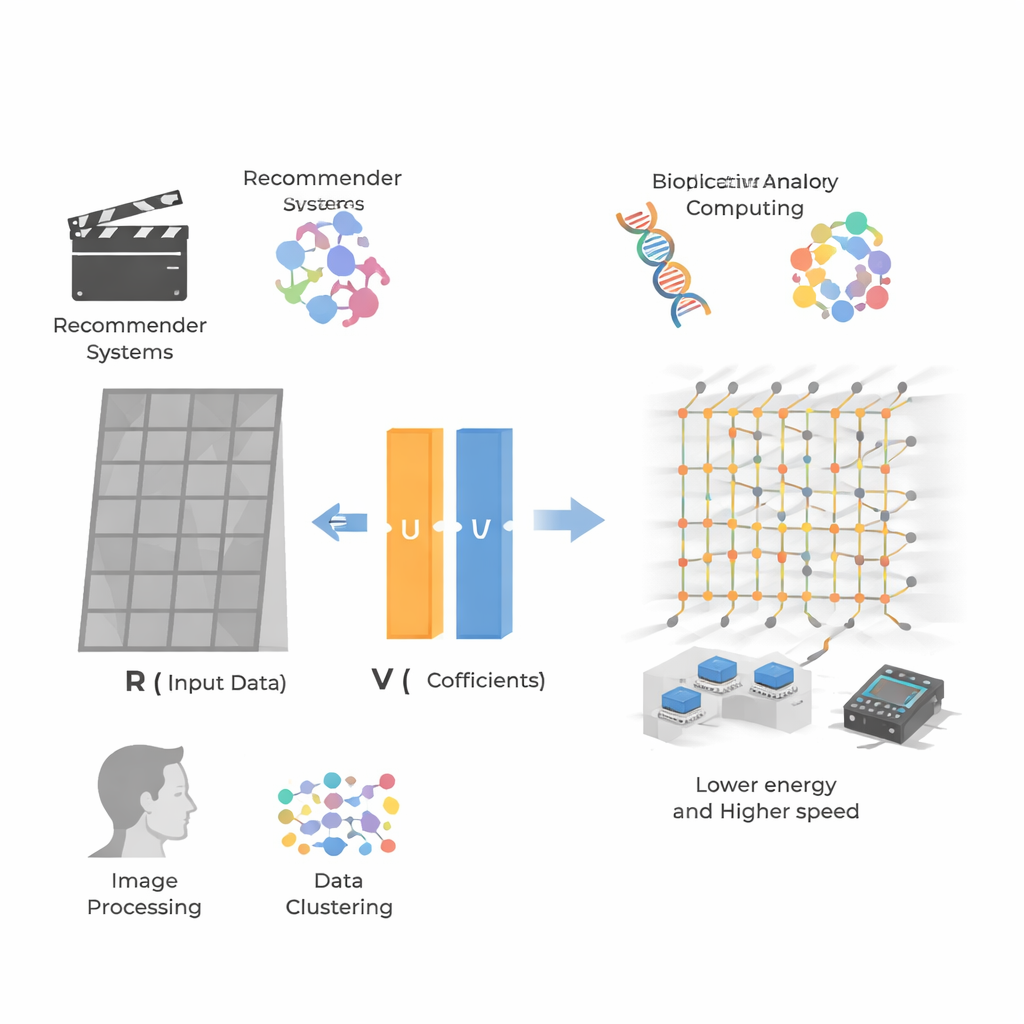

Des services quotidiens comme les recommandations de films, les applications photo et l’analyse génétique reposent tous sur la détection de motifs cachés dans d’immenses tableaux de nombres. Une méthode répandue pour cela est la factorisation de matrices non négatives (NMF), qui décompose une grande table de données en blocs plus simples et plus faciles à interpréter. Mais à mesure que les jeux de données atteignent des millions d’utilisateurs, d’objets ou de pixels, les puces numériques actuelles peinent à suivre en temps réel. Cet article montre comment une approche analogique en mémoire peut accomplir ce travail mathématique intensif beaucoup plus vite et avec beaucoup moins d’énergie, ouvrant la voie à des services IA plus réactifs et plus efficaces.

Extraire des motifs de tableaux géants

Au cœur du travail se trouve la factorisation de matrices non négatives (NMF), une méthode qui prend une grande grille de nombres non négatifs — par exemple des notes utilisateur‑film ou des valeurs de pixels d’image — et la réécrit comme le produit de deux grilles plus petites. Une grille représente des « caractéristiques » cachées (par exemple, le goût d’un utilisateur pour l’action versus la romance) et l’autre indique dans quelle mesure chaque élément ou pixel manifeste ces caractéristiques. Puisque toutes les valeurs restent non négatives, ces caractéristiques tendent à ressembler à des parties intuitives : composants faciaux dans des images, ou profils de préférence dans des données de recommandation. Cela rend la NMF populaire en systèmes de recommandation, bioinformatique, traitement d’images et regroupement, mais la rend aussi exigeante en calcul pour des jeux de données très larges et clairsemés.

Pourquoi les puces numériques butent sur un plafond

Les processeurs traditionnels — CPU, GPU et même FPGA — traitent les opérations matricielles comme de longues séquences d’étapes élémentaires, déplaçant les données entre la mémoire et les unités de calcul. Pour des problèmes modestes, cela fonctionne bien, mais pour les jeux de données modernes comportant des millions de lignes et de colonnes, le coût en temps et en énergie devient énorme. Le ralentissement de la loi de Moore et le soi‑disant goulot d’étranglement de von Neumann, où l’accès à la mémoire domine la consommation d’énergie et la latence, rendent de plus en plus difficile la mise à l’échelle de la NMF vers des applications en temps réel comme les recommandations instantanées ou l’analyse d’images rapide. Même des algorithmes numériques ingénieux doivent encore affronter une complexité en temps polynômiale et un trafic mémoire intensif dès que les matrices doivent être mises à jour de façon répétée.

Calculer à l’intérieur de la mémoire avec des signaux analogiques

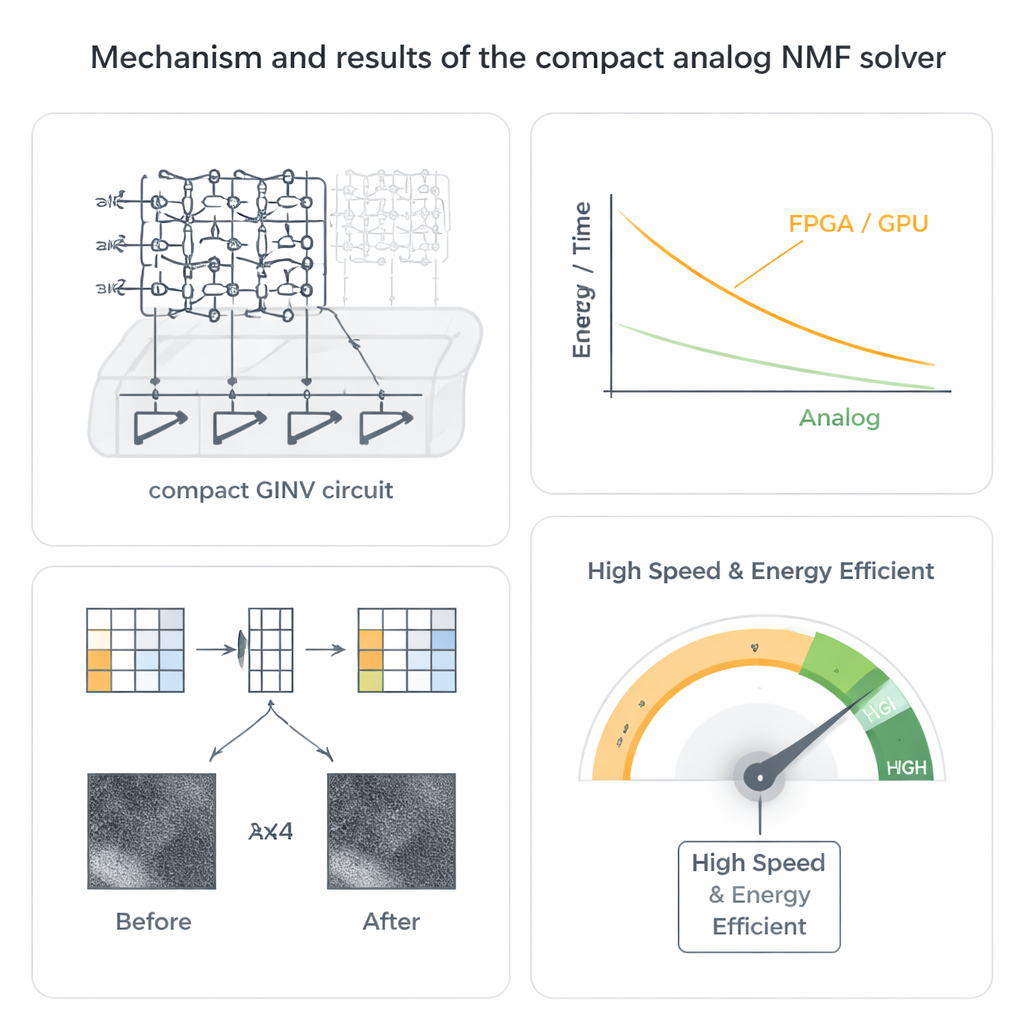

Les auteurs empruntent une voie différente en utilisant le calcul matriciel analogique basé sur des dispositifs de mémoire résistive connus sous le nom de mémristors. Ces dispositifs peuvent être disposés en réseaux en croix denses où chaque jonction stocke une valeur de conductance. Lorsqu’on applique des tensions le long d’un côté du réseau, les courants qui en sortent de l’autre côté effectuent naturellement de nombreuses opérations de multiplication‑addition en parallèle. En câblant ces réseaux dans une boucle fermée avec un petit nombre d’amplificateurs opérationnels, l’équipe construit un circuit inverse généralisé compact (GINV) qui résout des problèmes de régression entiers en essentiellement une étape analogique, plutôt qu’en de nombreuses itérations numériques. Ils affinent la conception avec un schéma de compensation de conductance qui maintient la stabilité du circuit tout en réduisant fortement le nombre d’amplificateurs, économisant ainsi de la surface de puce et de l’énergie.

D’un tour mathématique à du matériel opérationnel

Pour rendre cela pratique pour la NMF, les chercheurs associent leur circuit GINV compact à une stratégie bien connue appelée moindres carrés non négatifs alternés. Plutôt que d’essayer de résoudre simultanément les deux matrices factrices — un problème non convexe difficile — la méthode améliore alternativement une matrice tout en gardant l’autre fixe, décomposant la tâche en une chaîne de problèmes de régression non négative plus simples que le circuit analogique peut résoudre. Ils fabriquent des réseaux de mémristors en oxyde d’hafnium et construisent une plateforme sur carte à circuits imprimés, puis démontrent deux applications clés. Pour la compression d’images, une photographie de nébuleuse est découpée en petits blocs qui sont factorisés, réduisant de moitié le stockage tout en reproduisant l’image avec une perte visuelle minime. Pour les systèmes de recommandation, ils factorisent des données de notes utilisateur‑objet telles que l’ensemble MovieLens 100k, prédisant avec précision les notes manquantes malgré la grande rareté de la matrice.

Vitesse, efficacité et robustesse dans le monde réel

Au‑delà de la simple exactitude, le solveur analogique montre des avantages remarquables en vitesse et en énergie. Parce que le courant à travers le crossbar représente de nombreuses opérations effectuées simultanément, le temps nécessaire pour résoudre un problème de régression devient presque indépendant de la taille de la matrice, en net contraste avec les méthodes numériques. Des estimations au niveau système suggèrent des accélérations allant de plusieurs centaines à plusieurs milliers de fois par rapport à des implémentations avancées sur FPGA et GPU, ainsi que des améliorations de plusieurs ordres de grandeur en efficacité énergétique. Fait peut‑être surprenant, la nature analogique du matériel n’est pas une faiblesse mais une force : l’algorithme NMF tolère naturellement le bruit des dispositifs et les erreurs de programmation, et dans les simulations la qualité finale des images et des recommandations reste élevée même lorsque les valeurs des mémristors sont assez imprécises ou dérivent avec la température.

Ce que cela signifie pour la technologie de tous les jours

En termes simples, l’étude montre qu’un nouveau type de « calculatrice dans la mémoire » peut traiter l’un des outils de base de la science des données moderne beaucoup plus rapidement et plus efficacement que les puces numériques actuelles. En intégrant la factorisation matricielle directement dans des circuits analogiques compacts, des services comme les recommandations en streaming, le classement de contenu personnalisé et le traitement d’images sur appareil pourraient éventuellement fonctionner en temps réel tout en consommant beaucoup moins d’énergie. Le travail fournit à la fois une feuille de route de circuit et une preuve expérimentale que ce calcul analogique en mémoire peut traiter des jeux de données réalistes avec une précision proche du logiciel en précision complète, ouvrant la voie à du matériel futur capable de trier d’immenses flux de données aussi aisément que la lumière traverse le verre.

Citation: Wang, S., Luo, Y., Zuo, P. et al. In-memory analog computing for non-negative matrix factorization. Nat Commun 17, 1881 (2026). https://doi.org/10.1038/s41467-026-68609-8

Mots-clés: calcul analogique en mémoire, factorisation de matrices non négatives, crossbar à mémristors, compression d’images, systèmes de recommandation