Clear Sky Science · fr

La mémoire en mosaïque des grands modèles de langage

Pourquoi les copies proches importent

Les grands modèles de langage comme ChatGPT apprennent à partir d’océans de texte, et parfois ils mémorisent des fragments de ce texte. Cela soulève des inquiétudes concernant la vie privée, le droit d’auteur et la manière dont on peut évaluer équitablement ce que ces systèmes savent réellement. Cet article montre que la mémorisation ne se réduit pas à un simple copier‑coller exact. Au contraire, les modèles peuvent reconstruire des passages à partir de nombreuses versions légèrement différentes, un peu comme on assemble une mosaïque. Comprendre ce type de mémoire cachée est crucial pour quiconque se soucie d’une IA sûre et fiable.

Une nouvelle façon de penser la mémoire machine

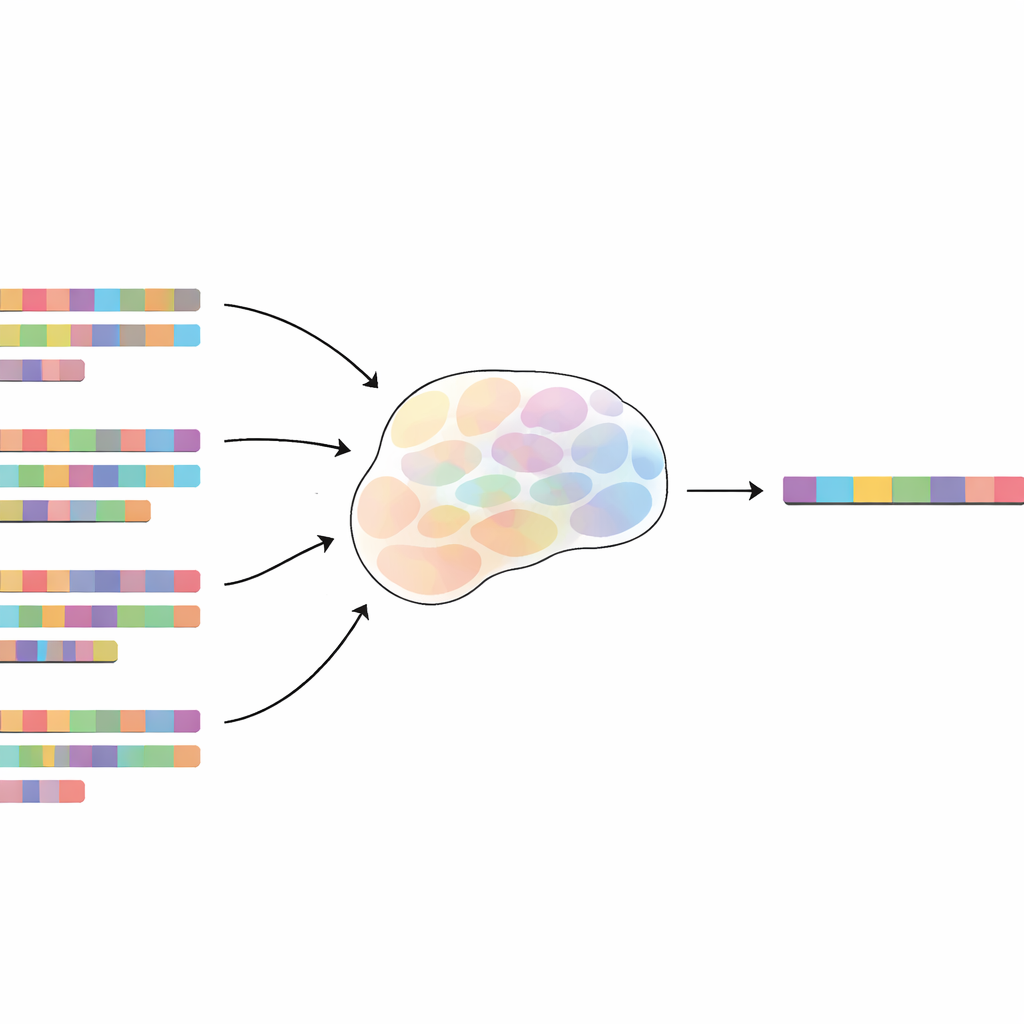

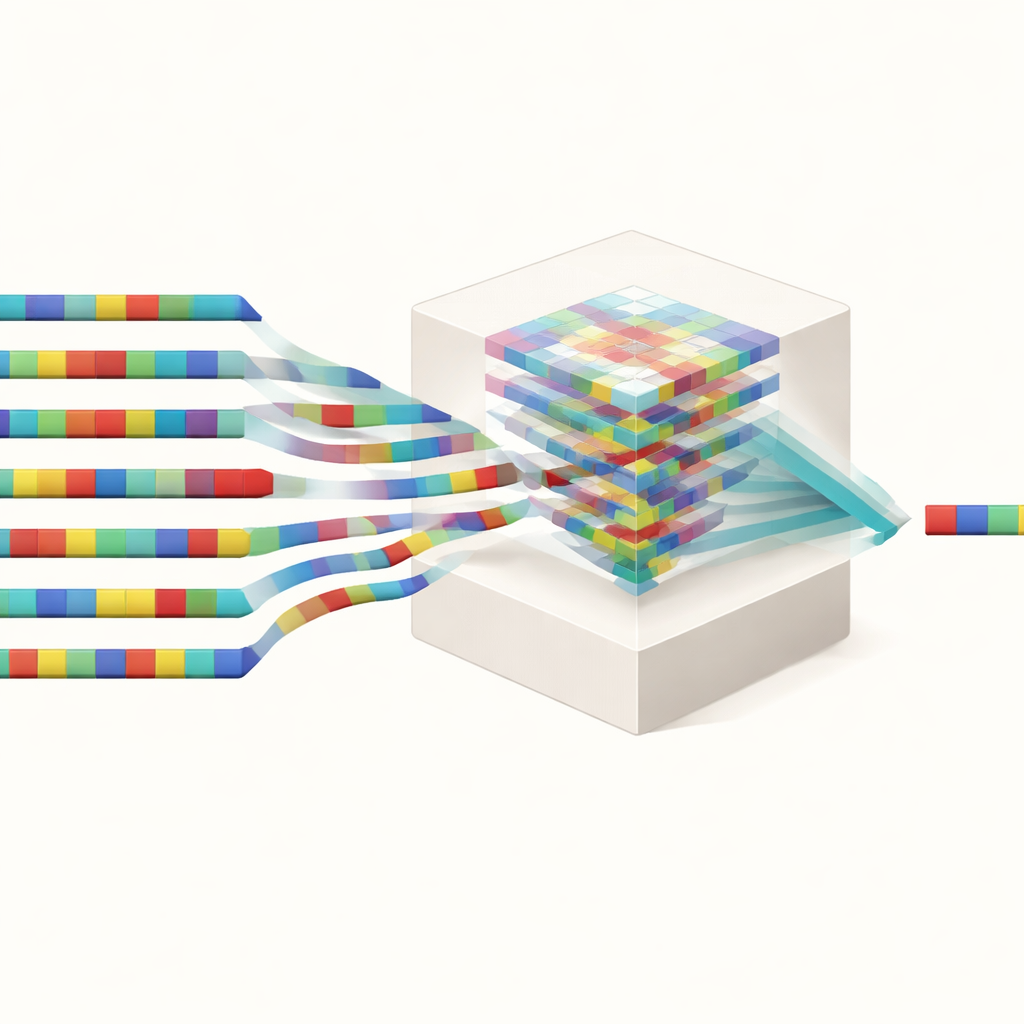

La plupart des gens supposent qu’un modèle de langage ne mémorise quelque chose que s’il voit exactement la même phrase encore et encore. Les auteurs remettent en cause cette vision en introduisant la « mémoire mosaïque ». Dans cette perspective, un modèle peut mémoriser un passage de 100 mots non seulement à partir de répétitions exactes, mais aussi à partir de nombreuses copies floues — des versions où certains mots sont absents, modifiés ou réordonnés. Pour étudier cela rigoureusement, ils plantent des phrases tests artificielles, appelées canaris, dans les données d’entraînement d’un modèle, accompagnées de nombreuses versions altérées. Après l’entraînement, ils mesurent la facilité à déterminer si un canari donné faisait partie du jeu d’entraînement, en utilisant une forme de test de confidentialité appelée attaque par inférence d’appartenance.

Comment des copies floues laissent quand même une trace nette

En comparant les copies floues aux répétitions exactes, les chercheurs définissent un « équivalent de duplication exacte » : combien une copie floue contribue à la mémorisation par rapport à une copie parfaite. Ils constatent que même des modifications très légères affaiblissent à peine la mémorisation. Si seulement environ 10 % des mots de chaque copie sont remplacés au hasard, une seule copie floue contribue encore à peu près 60–65 % de l’effet d’une duplication exacte. Même lorsque la moitié des mots est modifiée, chaque version altérée compte encore pour environ 15–20 % d’une copie complète. L’effet est robuste : ajouter des mots de remplissage aléatoires entre des phrases clés ou mélanger des segments de la phrase réduit la mémorisation, mais ne l’élimine pas. Le modèle paraît capable d’ignorer le bruit, de se concentrer sur les fragments qui se recoupent et de les reconstituer.

La forme plutôt que le sens dans ce que les modèles stockent

Étant donné que les modèles de langage modernes peuvent résoudre des problèmes mathématiques, suivre des instructions et traduire entre des langues, on pourrait s’attendre à ce que leurs mémoires portent sur le sens. De façon surprenante, l’étude trouve le contraire. Lorsque les auteurs remplacent des mots par des alternatives qui conservent le sens de la phrase, la mémorisation ne s’améliore que très légèrement par rapport à un remplacement par des mots aléatoires. Les paraphrases générées par d’autres systèmes d’IA — qui préservent la même idée mais modifient de nombreux détails de surface — contribuent relativement peu à la mémorisation, sauf si elles partagent encore de nombreuses courtes séquences de tokens avec le passage original. Dans une série de tests, ce qui stimule vraiment la mémoire, c’est le recoupement des tokens exacts (les unités de base du modèle), et non pas les idées partagées. Autrement dit, la mémoire mosaïque du modèle concerne principalement la forme, pas le sens.

Copies cachées dans les données d’entraînement du monde réel

Les auteurs se demandent ensuite à quel point les copies floues sont fréquentes dans un ensemble web populaire et fortement nettoyé utilisé pour entraîner des modèles de langage, connu sous le nom de SlimPajama. Même si cet ensemble a déjà fait l’objet d’un retrait des documents presque identiques, l’équipe découvre que de nombreuses séquences de 100 tokens qui apparaissent exactement 1 000 fois ont aussi des milliers de versions proches. Pour de petites distances d’édition — environ 10 % des caractères modifiés — il y a en moyenne environ 4 fois plus de copies floues que d’exactes, et des dizaines de milliers de plus à des distances plus grandes mais toujours influentes. Fait important, les techniques standard de « déduplication » utilisées dans l’industrie, qui retirent typiquement seulement de longs chevauchements exacts, laissent intacte la plupart de ces copies floues. Cela signifie que les modèles peuvent encore mémoriser des informations sensibles ou protégées par le droit d’auteur en les reconstituant à partir de nombreuses sources légèrement modifiées.

Pourquoi cela compte pour la vie privée, l’équité et le contrôle

Ces résultats ont des implications larges. En matière de confidentialité, ils montrent que supprimer simplement les répétitions exactes des données d’entraînement n’est pas suffisant : des informations personnelles ou confidentielles peuvent être mémorisées via des familles de passages similaires. Pour le droit d’auteur et l’évaluation, les copies floues peuvent conduire les modèles à reproduire des textes protégés ou à gonfler artificiellement leurs scores sur des tests qu’ils ont effectivement vus sous une forme déguisée. Pour les efforts d’« oubli » de données spécifiques, il ne suffit pas de supprimer un exemple problématique si de nombreuses variantes demeurent. Dans l’ensemble, ce travail révèle que la mémoire des modèles de langage est une mosaïque complexe construite à partir de nombreux petits recouvrements, ce qui met au défi les outils de sécurité actuels et appelle des méthodes plus intelligentes et plus fines pour nettoyer et auditer les données d’entraînement.

Citation: Shilov, I., Meeus, M. & de Montjoye, YA. The mosaic memory of large language models. Nat Commun 17, 2142 (2026). https://doi.org/10.1038/s41467-026-68603-0

Mots-clés: mémorisation des modèles de langage, copies approximatives, confidentialité des données, déduplication des données d'entraînement, contamination des benchmarks