Clear Sky Science · fr

Apprentissage en ligne à mémoire linéaire et indépendant du modèle dans les réseaux de neurones impulsionnels

Pourquoi entraîner des ordinateurs inspirés du cerveau est si difficile

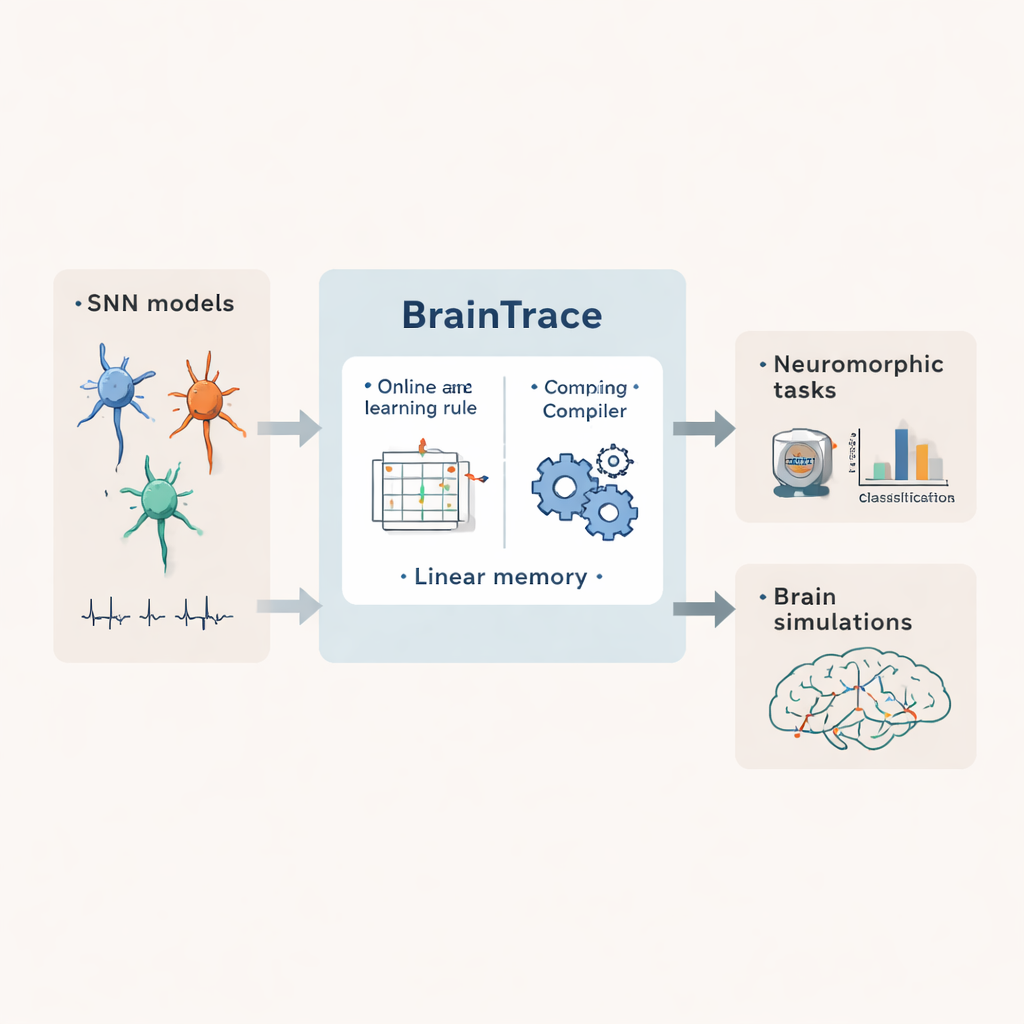

Les réseaux de neurones impulsionnels sont une classe de réseaux artificiels qui communiquent par de brèves impulsions électriques, à l’image des cellules cérébrales réelles. Ils promettent un calcul ultra‑efficace inspiré du cerveau et des simulations plus réalistes des circuits neuronaux. Mais apprendre à ces réseaux à accomplir des tâches complexes, notamment sur de longues périodes, exige généralement d’énormes quantités de mémoire informatique et du code artisanal. Cet article présente BrainTrace, un système conçu pour rendre l’entraînement des réseaux impulsionnels à la fois pratique et largement accessible.

Enseigner à des réseaux qui apprennent en temps réel

Les méthodes d’entraînement les plus puissantes pour les réseaux de type cérébral fonctionnent en rejouant une séquence complète d’activité et en rétropropagant les signaux d’erreur à travers chaque pas temporel. Cette approche, connue sous le nom de rétropropagation dans le temps, peut être très précise mais se heurte rapidement à des difficultés lorsque les séquences sont longues ou que les réseaux sont grands : chaque état intermédiaire doit être stocké, entraînant une croissance de la mémoire en fonction du temps et de la taille du réseau. Les méthodes « en ligne » alternatives mettent à jour les connexions pas à pas au fur et à mesure du flux de données, ce qui réduit fortement les besoins de stockage. Cependant, les règles en ligne existantes fonctionnent soit uniquement pour des modèles de neurones très simplifiés, soit exigent encore une mémoire qui croît de façon quadratique avec la taille du réseau, ce qui les rend difficiles à appliquer à des systèmes réalistes à l’échelle du cerveau.

Une recette générale pour de nombreux types de réseaux impulsionnels

BrainTrace s’attaque à ce problème en décrivant d’abord les réseaux impulsionnels de manière unifiée. Les auteurs montrent que de nombreux types de neurones et de synapses peuvent s’exprimer comme deux parties en interaction : une dynamique interne qui décrit comment l’état de chaque neurone évolue dans le temps, et une dynamique d’interaction qui transforme les impulsions entrantes en courants circulant entre les cellules. Ils introduisent en outre deux points de vue de modélisation, appelés AlignPre et AlignPost, qui organisent les synapses soit autour du neurone émetteur soit autour du neurone récepteur. Cette abstraction permet de traiter une grande variété de modèles biologiques et conçus avec la même machinerie mathématique, des neurones leak simples aux cellules plus riches dotées de seuils adaptatifs et de synapses complexes.

Une façon économe en mémoire de suivre la cause et l’effet

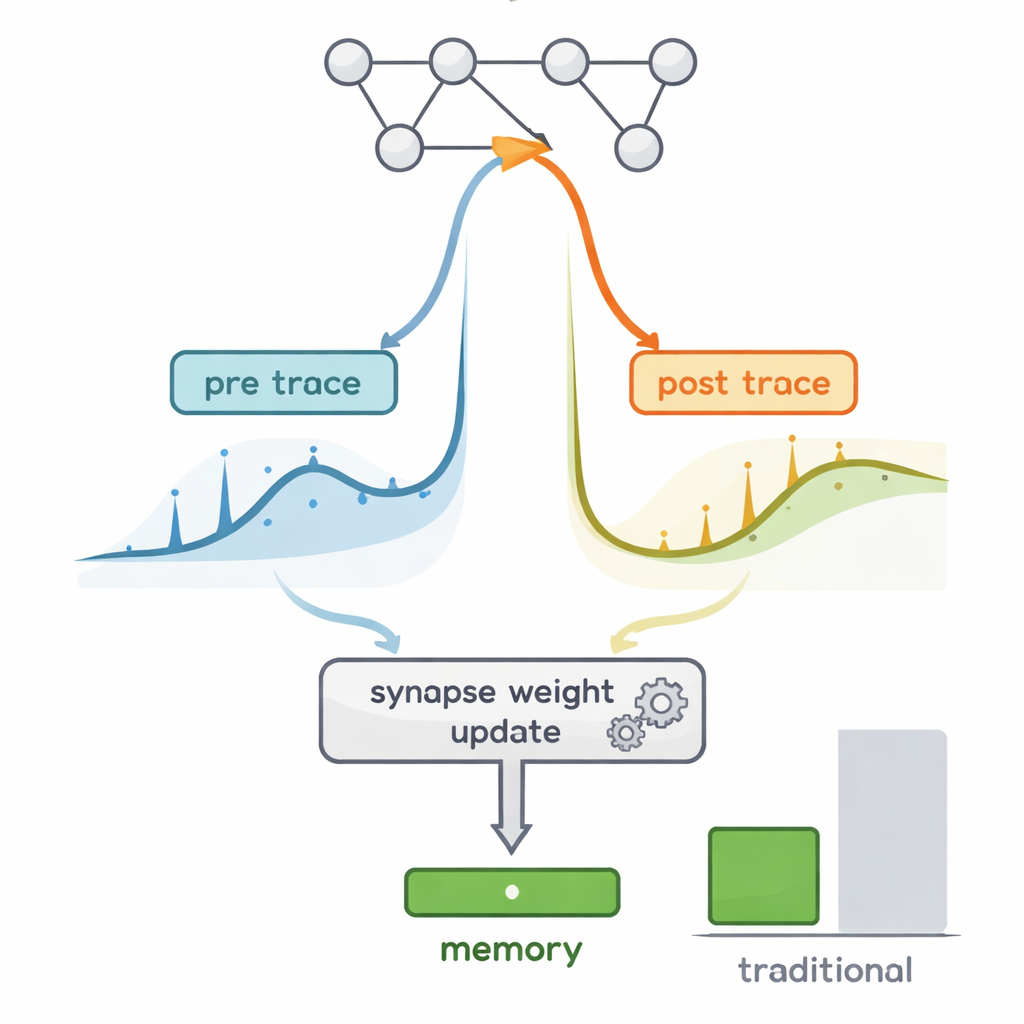

Le défi central de l’apprentissage en ligne est de suivre comment de petites modifications de chaque connexion affecteraient finalement le comportement du réseau, quantité capturée par les « traces d’éligibilité ». En principe, conserver l’information d’éligibilité complète exige de suivre d’immenses matrices qui croissent avec le cube du nombre de neurones. BrainTrace exploite trois propriétés clés des réseaux impulsionnels : la plupart des neurones sont silencieux la plupart du temps ; la fuite et la remise à zéro propres à chaque neurone dominent l’évolution de son état ; et les impulsions ainsi que les conductances synaptiques sont toujours positives. En s’appuyant sur ces faits, les auteurs montrent que les lourdes matrices d’éligibilité peuvent être approchées de près par le produit de seulement deux traces compactes par synapse, l’une résumant l’activité présynaptique et l’autre l’activité postsynaptique. Cette règle de propagation pré‑post, baptisée pp‑prop, utilise une mémoire qui croît seulement linéairement avec la taille du réseau, tout en produisant des gradients qui s’alignent bien avec ceux de la rétropropagation complète.

Des outils automatiques qui masquent les mathématiques

Au‑delà de la règle d’apprentissage elle‑même, BrainTrace fournit un compilateur qui joue un rôle similaire à celui des bibliothèques de différentiation automatique en apprentissage profond. L’utilisateur décrit la dynamique de son modèle impulsionnel dans un langage de haut niveau. Le compilateur BrainTrace analyse alors comment états et paramètres sont connectés, construit les traces d’éligibilité nécessaires, et génère du code optimisé qui exécute efficacement pp‑prop ou un algorithme connexe sur CPU, GPU ou accélérateurs spécialisés. Cela permet aux modélisateurs de se concentrer sur les questions scientifiques plutôt que d’écrire à la main du code de gradient délicat, tout en profitant d’un apprentissage en ligne et économe en mémoire.

Des petits capteurs au cerveau entier d’une mouche

Les auteurs testent BrainTrace sur des benchmarks neuromorphiques standard, où des réseaux impulsionnels classifient des versions événementielles d’images, de sons et de gestes. Sur plusieurs jeux de données et architectures, pp‑prop atteint la précision de la rétropropagation complète tout en utilisant des ordres de grandeur de mémoire en moins et en s’exécutant plus rapidement que d’autres méthodes en ligne. De façon cruciale, le système s’étend aussi à des problèmes exigeants en neurosciences. Dans un exemple, un réseau impulsionnel détaillé biologiquement, avec populations séparées excitatrices et inhibitrices, apprend une tâche d’accumulation de preuves pour la prise de décision et développe des motifs d’activité ressemblant à ceux enregistrés dans le cortex de souris. Dans un autre, un modèle impulsionnel de plus de 125 000 neurones, câblé selon le connectome de la drosophile, est entraîné pour reproduire l’activité en état de repos enregistrée sur l’ensemble du cerveau de la mouche — exploit qui dépasse la capacité mémoire d’un entraînement conventionnel sur une seule carte graphique.

Ce que cela signifie pour l’informatique inspirée du cerveau

Pour les non‑spécialistes, le message principal est que BrainTrace transforme un rêve autrefois impraticable — entraîner en temps réel des réseaux impulsionnels riches et à l’échelle du cerveau — en une possibilité réaliste. En trouvant une manière astucieuse de suivre la relation de cause à effet avec une faible quantité de mémoire, et en enveloppant cela dans des outils automatisés, ce travail rapproche l’informatique inspirée du cerveau d’un usage courant, tant en intelligence artificielle que dans les neurosciences fondamentales. Il dessine une voie vers des machines qui apprennent et s’adaptent avec l’efficacité et la précision temporelle des systèmes nerveux réels, sans exiger des ressources de niveau super‑ordinateur.

Citation: Wang, C., Dong, X., Ji, Z. et al. Model-agnostic linear-memory online learning in spiking neural networks. Nat Commun 17, 1745 (2026). https://doi.org/10.1038/s41467-026-68453-w

Mots-clés: réseaux de neurones impulsionnels, apprentissage en ligne, informatique neuromorphique, simulation cérébrale, entraînement par gradient