Clear Sky Science · es

Copiloto quirúrgico RARP: un modelo visual-lingüístico para prostatectomía radical asistida por robot

Ayuda más inteligente en el quirófano

La cirugía moderna del cáncer de próstata se realiza con robots y cámaras sofisticadas, pero los cirujanos siguen teniendo que gestionar decisiones complejas, cambios rápidos de imagen y preguntas constantes de residentes y personal. Este artículo presenta un "copiloto" de inteligencia artificial que puede observar el vídeo en directo de la intervención y responder preguntas habladas en el acto, como lo haría un asistente altamente conocedor. Para los pacientes, esto apunta a operaciones más seguras y consistentes; para los cirujanos, sugiere un futuro en el que la guía experta y la docencia estén disponibles en cada quirófano.

Un asistente digital que puede ver y hablar

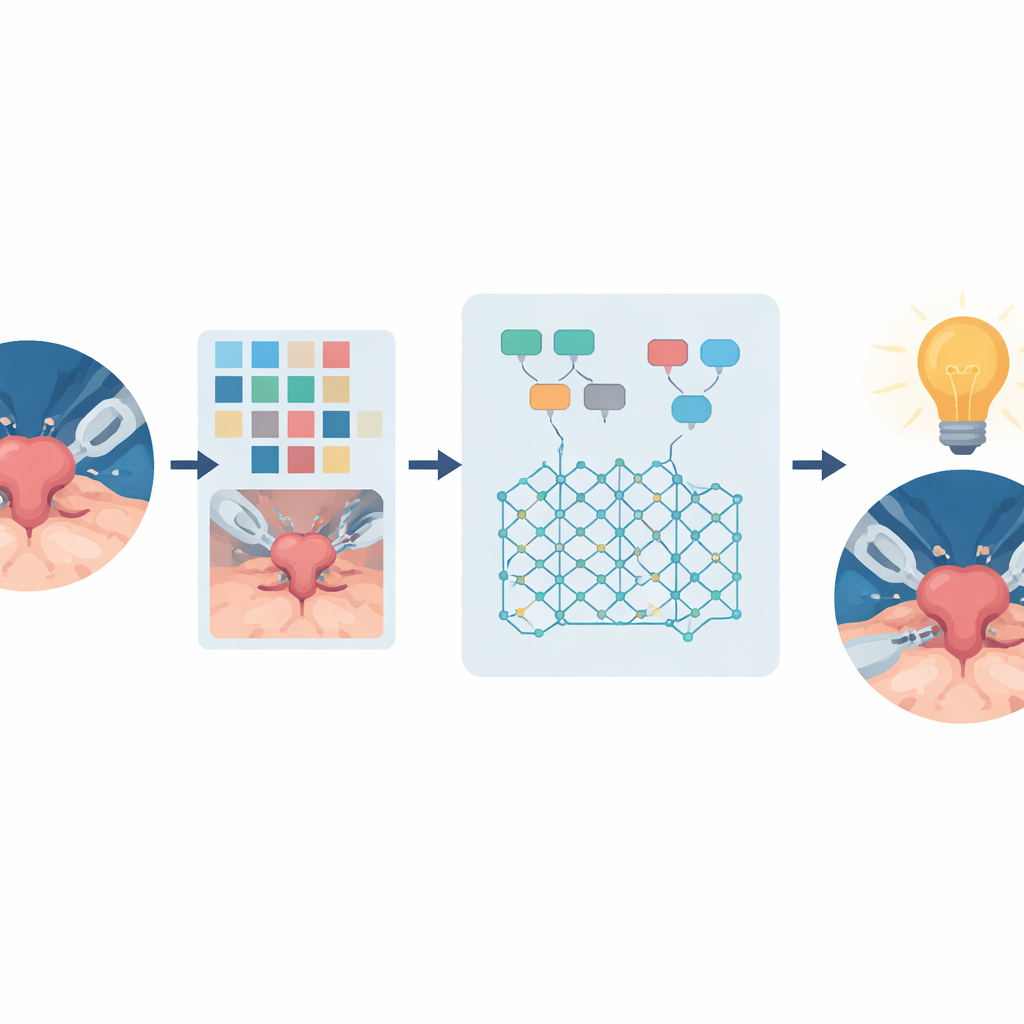

Los investigadores construyeron el Surgical RARP Copilot para una operación concreta: la prostatectomía radical asistida por robot, la intervención estándar para muchos hombres con cáncer de próstata localizado. En este procedimiento, un sistema robótico controlado por el cirujano extirpa la próstata mediante pequeñas incisiones, guiado por una cámara de alta definición dentro del cuerpo. Los sistemas de IA basados solo en texto no pueden interpretar lo que muestra la cámara quirúrgica. El Copilot, en cambio, combina visión por computador con un gran modelo de lenguaje, lo que le permite "ver" el campo operatorio y generar respuestas en lenguaje natural sobre lo que está ocurriendo, qué instrumentos aparecen en la imagen o cuáles deberían ser los siguientes pasos en la operación.

Enseñar al Copilot el saber quirúrgico

Para dotar al Copilot de experiencia quirúrgica útil, el equipo reunió un conjunto de datos de entrenamiento especializado en lugar de basarse en imágenes generales de internet. Recolectaron cerca de 20 000 fotogramas etiquetados de operaciones de próstata grabadas, marcando las posiciones de instrumentos, órganos y el paso actual del procedimiento. También añadieron información de profundidad aproximada, de modo que el sistema pudiera inferir qué objetos están por delante o en contacto entre sí. Usando reglas diseñadas por expertos, estas etiquetas se convirtieron en leyendas escritas detalladas que describían qué mostraba cada fotograma y en qué fase de la operación se encontraba. A continuación, se solicitó a grandes modelos de lenguaje, con voces de distintas "personas" que iban desde cirujanos sénior hasta niños curiosos, que generaran más de un millón de pares pregunta–respuesta basados en esas leyendas. Un modelo separado comprobó la coherencia lógica de esos pares y los ejemplos defectuosos se filtraron antes del entrenamiento.

Qué tan bien rinde el Copilot

Una vez entrenado, el Copilot se evaluó de varias formas. En un conjunto retenido de pares pregunta–respuesta sintéticos, el ajuste fino aumentó la capacidad del modelo para dar respuestas al menos parcialmente correctas desde aproximadamente el 61% hasta el 83%, y respuestas totalmente correctas desde 0% hasta 59%. Revisores humanos formularon luego 650 preguntas sobre imágenes quirúrgicas preregistradas; casi siete de cada diez respuestas se consideraron totalmente correctas. El sistema también abordó tareas clásicas de visión por computador sin reentrenamiento adicional: identificó qué paso de la prostatectomía se estaba realizando a partir de un solo fotograma con un 82% de precisión y reconoció instrumentos quirúrgicos con una puntuación F1 del 94%, además de estimar cuánto tiempo restante había en la operación. Estos resultados sugieren que un único modelo unificado puede igualar a herramientas especializadas en múltiples tareas y, al mismo tiempo, participar en conversaciones abiertas.

Integrar la IA en una operación en vivo

La demostración más notable tuvo lugar en un quirófano real. El Copilot se desplegó en un potente ordenador perimetral conectado directamente a la señal de vídeo de la cirugía robótica. Durante una prostatectomía en directo realizada en una plataforma robótica distinta de la usada en el entrenamiento, una audiencia de cirujanos e ingenieros envió 276 preguntas desde sus smartphones. Tras filtrar consultas irrelevantes y duplicadas, los expertos consideraron que el Copilot respondió correctamente alrededor del 77% de las preguntas restantes —un resultado comparable a su rendimiento fuera de línea. El sistema respondió en aproximadamente medio segundo antes de iniciar su réplica y generó texto con la suficiente rapidez como para resultar interactivo, aplicando al mismo tiempo filtros de seguridad y un comportamiento conservador cuando tenía incertidumbre.

Qué significa esto para la cirugía del futuro

Para los lectores no especializados, el mensaje clave es que un sistema de IA ya puede observar en tiempo real una intervención delicada por cáncer y ofrecer respuestas útiles y contextualizadas sobre lo que sucede y lo que debería ocurrir a continuación. Aunque el Copilot actual está limitado a un tipo de cirugía, depende de instantáneas en lugar de una memoria de vídeo completa y aún no accede a historias clínicas completas, demuestra que la IA multimodal se puede introducir de forma segura en el quirófano. A medida que sistemas similares se amplíen a más procedimientos, se conecten con datos de pacientes más completos y sean sometidos a pruebas rigurosas de impacto clínico, podrían respaldar la formación, mejorar la comunicación del equipo y, en última instancia, ayudar a que la cirugía compleja sea más segura y transparente.

Cita: Bogaert, W., Remy, F., Tejero, J.G. et al. Surgical RARP copilot: a vision language model for robot-assisted radical prostatectomy. npj Digit. Surg. 1, 3 (2026). https://doi.org/10.1038/s44484-025-00003-1

Palabras clave: cirugía robótica, cáncer de próstata, IA quirúrgica, modelo visual-lingüístico, asistencia en el quirófano