Clear Sky Science · es

Detección de lenguaje estigmatizante en notas clínicas con modelos de lenguaje grandes para la atención de adicciones

Por qué importan las palabras en su historial médico

A medida que más pacientes obtienen acceso en línea a sus registros médicos, el lenguaje que usan los clínicos ya no está oculto en los ordenadores del hospital: es visible para las mismas personas a las que describe. Para las personas que viven con adicciones, una sola frase como “tóxico” o “drogadicto” puede reforzar silenciosamente la vergüenza, dañar la confianza e incluso influir en la atención que reciben. Este estudio plantea una pregunta actual: ¿puede la inteligencia artificial moderna ayudar a los hospitales a detectar y reducir el lenguaje estigmatizante en las notas clínicas antes de que perjudique a los pacientes?

Etiquetas dañinas ocultas en las notas cotidianas

El estigma en la atención sanitaria no solo aparece en el contacto visual o el tono de voz; también está incrustado en el registro escrito. Los registros electrónicos de salud contienen millones de notas que siguen a los pacientes a través de clínicas y hospitales. Términos como “abuso de alcohol” o “conducta buscadora de drogas” pueden modelar la forma en que futuros clínicos ven a una persona mucho después de una visita de urgencias o una estancia hospitalaria. Los investigadores se centraron en notas de unidades de cuidados intensivos sobre pacientes con problemas de consumo de sustancias, donde las apuestas son altas y la documentación es abundante. Partieron de guías nacionales que fomentan un lenguaje respetuoso y centrado en la persona, como “persona con trastorno por consumo de sustancias” en lugar de “adicto”, y usaron estas ideas para crear un gran conjunto de datos de notas etiquetadas como estigmatizantes o no.

Enseñar a una IA a leer entre líneas

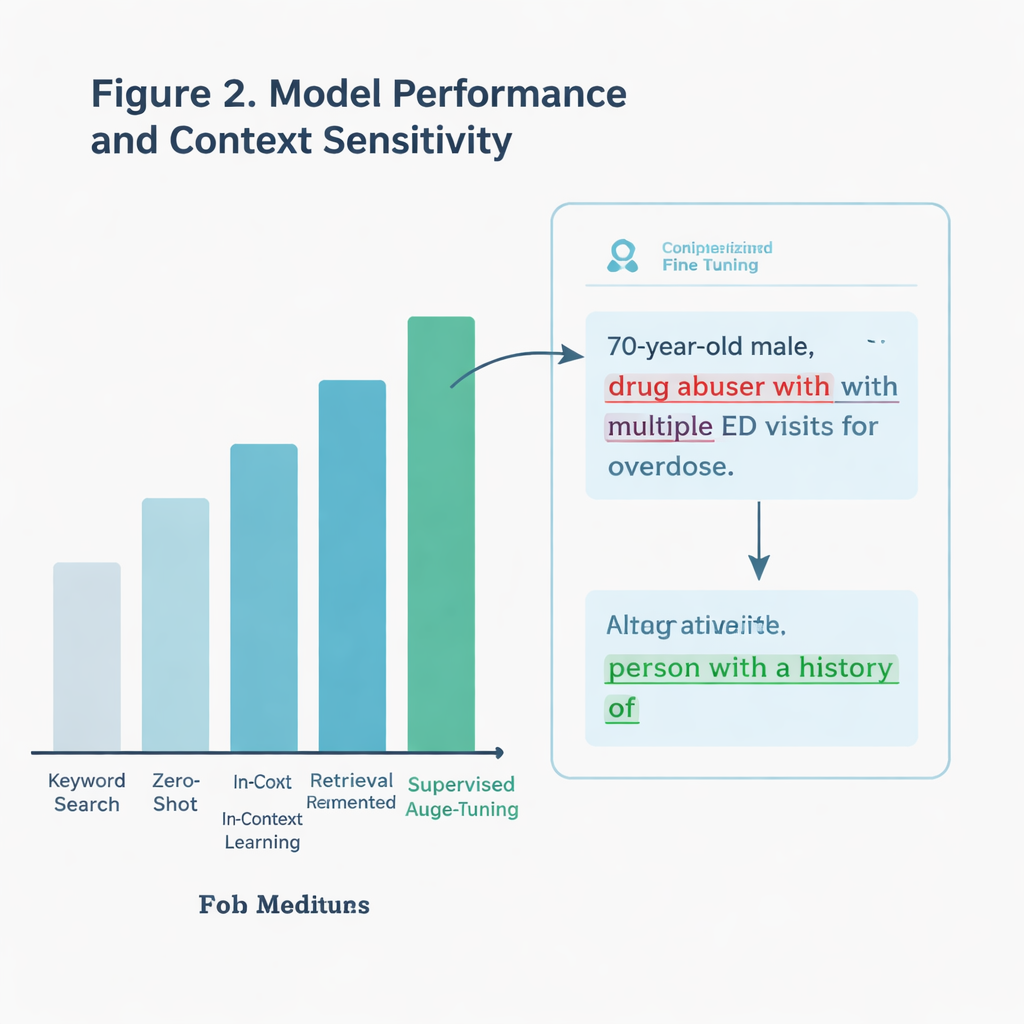

En lugar de limitarse a buscar palabras ofensivas, el equipo quería un sistema de IA que entendiera el contexto. Por ejemplo, una nota podría citar a un paciente describiéndose como “borracho”, que no es lo mismo que un clínico aplicando esa etiqueta. Los autores compararon varios enfoques, todos basados en un modelo de lenguaje grande (un tipo de IA que procesa y genera texto). Un método básico solo buscaba palabras clave específicas extraídas de las guías. Métodos más avanzados pidieron a la IA que juzgara cada nota directamente, bien sin ejemplos adicionales, con orientación añadida a partir de las guías de comunicación, o tras un entrenamiento específico—o “ajuste fino”—con miles de notas de UCI etiquetadas.

Qué funcionó mejor en el mundo real

El modelo con ajuste fino fue el claro ganador. En un conjunto de prueba reservado de más de 11.000 notas, identificó correctamente el lenguaje estigmatizante alrededor del 97 por ciento de las veces, muy por encima de la búsqueda simple por palabras clave. También se comportó mejor en un subconjunto particularmente complicado de notas que contenían términos potencialmente cargados pero que no siempre se usaban de manera dañina. El modelo pudo distinguir entre frases genuinamente juiciosas y usos neutrales o entrecomillados, donde una búsqueda más tosca fallaría. Cuando el equipo probó el sistema en notas de otro sistema sanitario—casi 300.000 notas de UCI escritas en otro estado—siguió superando el enfoque de palabras clave, aunque el lenguaje estigmatizante era raro en esa muestra del mundo real.

Detectar nuevas frases problemáticas que los clínicos pasaron por alto

Los investigadores fueron un paso más allá y pidieron a la IA que explicara por qué había señalado ciertas notas. Un especialista en adicciones revisó entonces esas explicaciones. En docenas de casos, los modelos resaltaron lenguaje verdaderamente estigmatizante que los anotadores humanos habían pasado por alto originalmente, incluidas frases no listadas en las guías existentes. Ejemplos incluían descripciones como “conducta buscadora de drogas” o menciones casuales de “cirrosis alcohólica” que culpan sutilmente a la persona en lugar de a la enfermedad. Esto sugiere que las herramientas de IA bien diseñadas podrían no solo hacer cumplir las mejores prácticas actuales, sino también ayudar a ampliar nuestra comprensión de cómo es el lenguaje dañino a medida que la redacción clínica evoluciona.

De herramienta de investigación a ayudante junto a la cama

El estudio también evaluó cuestiones prácticas. La búsqueda por palabras clave es rapidísima pero superficial. El modelo de IA más preciso requirió varias horas de entrenamiento en potentes procesadores gráficos, aunque una vez entrenado podía examinar notas en unos pocos segundos cada una—lento para un motor de búsqueda, pero aceptable para un asistente en segundo plano en un sistema hospitalario. Otro enfoque, menos personalizado y que se basaba solo en indicaciones cuidadosamente elaboradas, funcionó razonablemente bien sin entrenamiento adicional, apuntando a opciones más ligeras para clínicas con menos recursos técnicos. En conjunto, estos hallazgos apuntan a sistemas que pueden señalar redacciones riesgosas en tiempo real y sugerir alternativas más respetuosas mientras los clínicos escriben.

Un paso hacia una atención más respetuosa

Para un público general, la idea principal es simple: las palabras en su historial no son solo jerga técnica; ayudan a moldear cómo se le trata. Este trabajo muestra que los modelos de lenguaje grandes pueden detectar de forma fiable muchas formas de lenguaje estigmatizante relacionadas con la adicción en notas de cuidados intensivos, incluso cuando el problema es sutil. Aunque ningún sistema es perfecto, estas herramientas podrían funcionar como editores siempre activos, impulsando a los clínicos hacia un lenguaje que reconozca a las personas más allá de sus diagnósticos. A la larga, ese cambio—de la culpabilización al respeto—podría ser tan importante para la curación como cualquier fármaco o dispositivo.

Cita: Sethi, R., Caskey, J., Gao, Y. et al. Detecting stigmatizing language in clinical notes with large language models for addiction care. npj Health Syst. 3, 15 (2026). https://doi.org/10.1038/s44401-026-00069-0

Palabras clave: estigma en la adicción, notas clínicas, modelos de lenguaje grandes, registros electrónicos de salud, lenguaje centrado en la persona