Clear Sky Science · es

Marco explicable de razonamiento de atribución multi‑granular para la detección de noticias falsas

Por qué es cada vez más difícil detectar noticias falsas

Cada día, millones de publicaciones que combinan texto e imágenes circulan por las redes sociales. Algunas son inofensivas, otras son verdaderas y otras están cuidadosamente fabricadas para llamar la atención, provocar emociones o influir en opiniones. A medida que las herramientas de edición de imágenes y los generadores de IA se vuelven más baratos y fáciles de usar, las noticias falsas se han vuelto más pulidas y peligrosas. Este artículo presenta una nueva forma de mirar el interior de los sistemas de detección de noticias falsas para que podamos ver no solo si una publicación probablemente es falsa, sino también por qué.

Cómo las noticias falsas engañan a nuestros ojos y a nuestra mente

Los creadores de noticias falsas explotan la tendencia de las personas a ojear rápidamente titulares e imágenes. Pueden falsificar o retocar fotos, entretejer detalles parcialmente verdaderos en una historia imposible, ensamblar fragmentos de distintos sucesos o mezclar ubicaciones y cronologías que no tienen relación. Una publicación sobre un suceso de última hora puede mostrar una imagen dramática de otro incidente ocurrido años antes, o una fotografía convincente puede haber sido generada íntegramente por IA. Los sistemas tradicionales de detección suelen tratar todas las publicaciones falsas por igual y comprimir texto e imagen en una sola “sopa de características”. Ese enfoque puede funcionar razonablemente bien, pero actúa como una caja negra: resulta difícil para periodistas, plataformas o usuarios comprender las pistas específicas que dispararon la alarma.

Una nueva forma de preguntar: “¿Por qué esto es falso?”

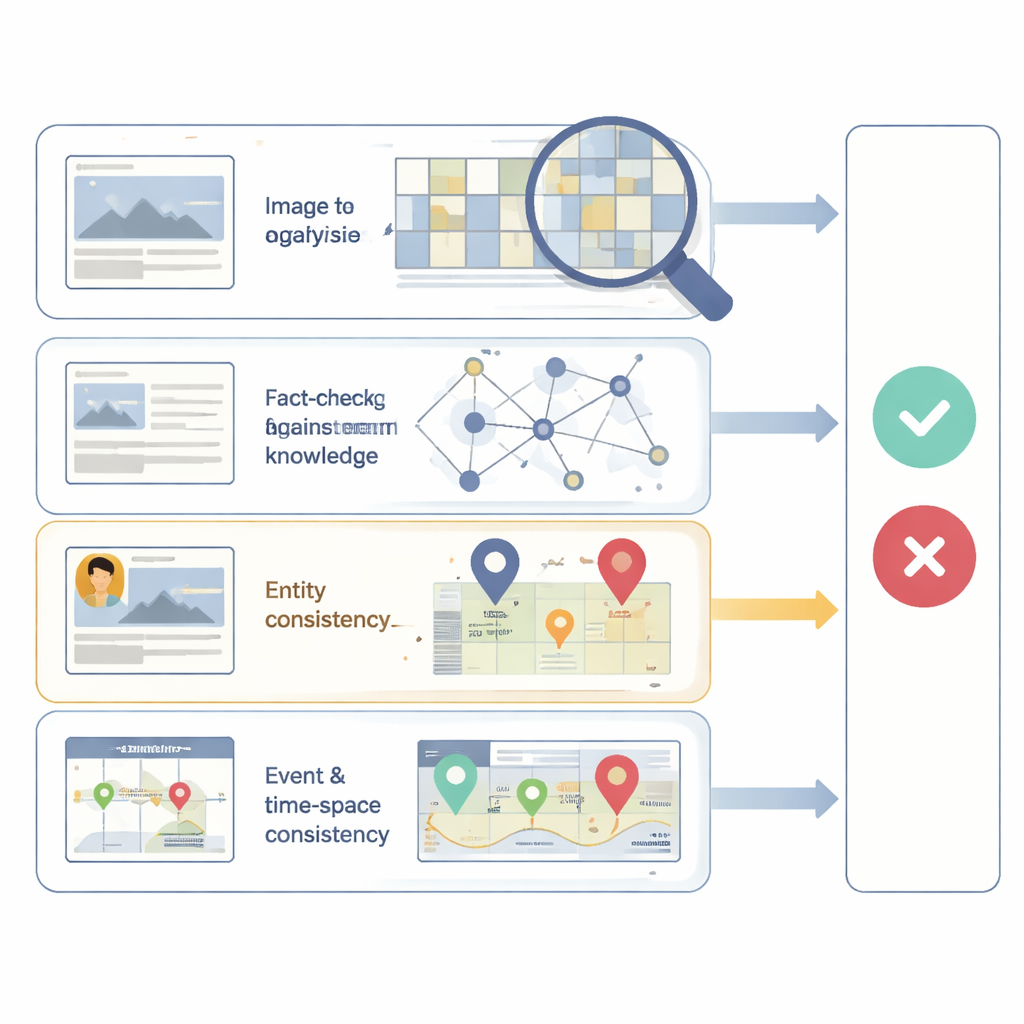

Los autores proponen un marco explicable llamado EMAR‑FND que examina las publicaciones informativas desde cuatro ángulos distintos, cada uno relacionado con una forma común de fabricar falsedades. Primero, analiza si la propia imagen muestra signos de manipulación o generación sintética, centrándose en sutiles patrones de ruido a nivel de cámara que cambian cuando una imagen es alterada. Segundo, verifica si los hechos de la historia concuerdan con conocimientos externos confiables, como relaciones conocidas entre personas, lugares y eventos. Tercero, inspecciona si las entidades clave mencionadas en el texto —como una figura pública o una ciudad— coinciden realmente con lo que aparece en la imagen adjunta. Cuarto, evalúa si el evento descrito encaja en tiempo y espacio, por ejemplo detectando una discrepancia entre una ubicación reclamada y pistas visuales en la imagen, o entre una cronología reportada y otras evidencias.

Ensamblando pistas desde múltiples ángulos

Cada una de estas cuatro comprobaciones la gestiona su propio módulo de razonamiento, que emite un juicio parcial sobre si ese aspecto concreto parece fiable. Un módulo se centra en la manipulación visual; otro razona sobre grafos de conocimiento externos; un tercero construye una red rica que conecta palabras, objetos en la imagen y eventos extraídos; y un cuarto compara la publicación con evidencias relacionadas a lo largo del tiempo y el espacio. En lugar de ocultar estas señales dentro de una única representación fusionada, EMAR‑FND mantiene sus contribuciones separadas y las combina mediante un paso final de decisión que puede ponderar la importancia de cada perspectiva en un caso particular. El resultado no es solo una puntuación final de verosimilitud, sino también una atribución que muestra, por ejemplo, que una publicación se marca principalmente porque la imagen parece manipulada, o porque el evento descrito no concuerda con hechos conocidos.

Probando el sistema en condiciones reales

Para evaluar el rendimiento de este enfoque, los investigadores aplicaron EMAR‑FND a dos colecciones públicas de publicaciones reales y falsas que incluyen tanto texto como imágenes. En estos conjuntos de datos, su método superó a varios sistemas consolidados, logrando mayor precisión y un mejor equilibrio entre detectar publicaciones falsas y evitar falsas alarmas. Al analizar cómo se agrupaban las publicaciones dentro del modelo, las noticias reales tendían a formar grupos compactos y consistentes, mientras que las noticias falsas estaban más dispersas —reflejando los numerosos trucos que emplean los falsificadores. Las salidas de atribución también resultaron útiles en ejemplos difíciles del mundo real: publicaciones cuyo texto e imagen parecían coherentes a primera vista fueron desenmascaradas como falsas porque la imagen mostraba trazas de manipulación ocultas o porque conocimientos externos contradecían los hechos alegados.

Qué significa esto para los lectores de a pie

En términos sencillos, el estudio demuestra que es posible construir detectores de noticias falsas que actúen menos como oráculos y más como investigadores cuidadosos. En lugar de ofrecer una respuesta simple de sí o no, EMAR‑FND resalta qué parte de una publicación es sospechosa: la imagen, los hechos, las personas mencionadas o el propio evento. Este tipo de explicación puede ayudar a verificadores, plataformas y lectores a confiar en las decisiones del sistema y a aprender a reconocer patrones comunes de engaño. A medida que las noticias falsas siguen evolucionando, las herramientas que pueden tanto detectar como explicar la manipulación serán cruciales para mantener los ecosistemas informativos en línea más saludables y transparentes.

Cita: Ji, W., Lv, H., Zhao, H. et al. Explainable multi-granularity attribution reasoning framework for fake news detection. npj Artif. Intell. 2, 38 (2026). https://doi.org/10.1038/s44387-026-00093-3

Palabras clave: detección de noticias falsas, desinformación multimodal, IA explicable, integridad en redes sociales, análisis de falsificación de imágenes