Clear Sky Science · es

DeepKoopFormer: una arquitectura basada en transformer mejorada con Koopman para la predicción de series temporales

Por qué importan las previsiones más inteligentes

Desde la meteorología y la planificación energética hasta los mercados financieros, muchas de nuestras decisiones más importantes dependen de predecir cómo cambiarán las cosas con el tiempo. Estas "series temporales"—flujos de mediciones como la velocidad del viento, la producción eléctrica o los precios de las criptomonedas—se están volviendo más largas, ruidosas y complejas. Las herramientas de IA modernas llamadas Transformers pueden procesar estos datos, pero a menudo actúan como cajas negras y pueden volverse inestables cuando se les exige predecir a largo plazo. Este artículo presenta DeepKoopFormer, un método de predicción que mantiene el poder predictivo de los Transformers mientras añade estructura matemática para que su comportamiento sea más estable, interpretable y fiable en horizontes largos.

Una nueva forma de estabilizar modelos potentes

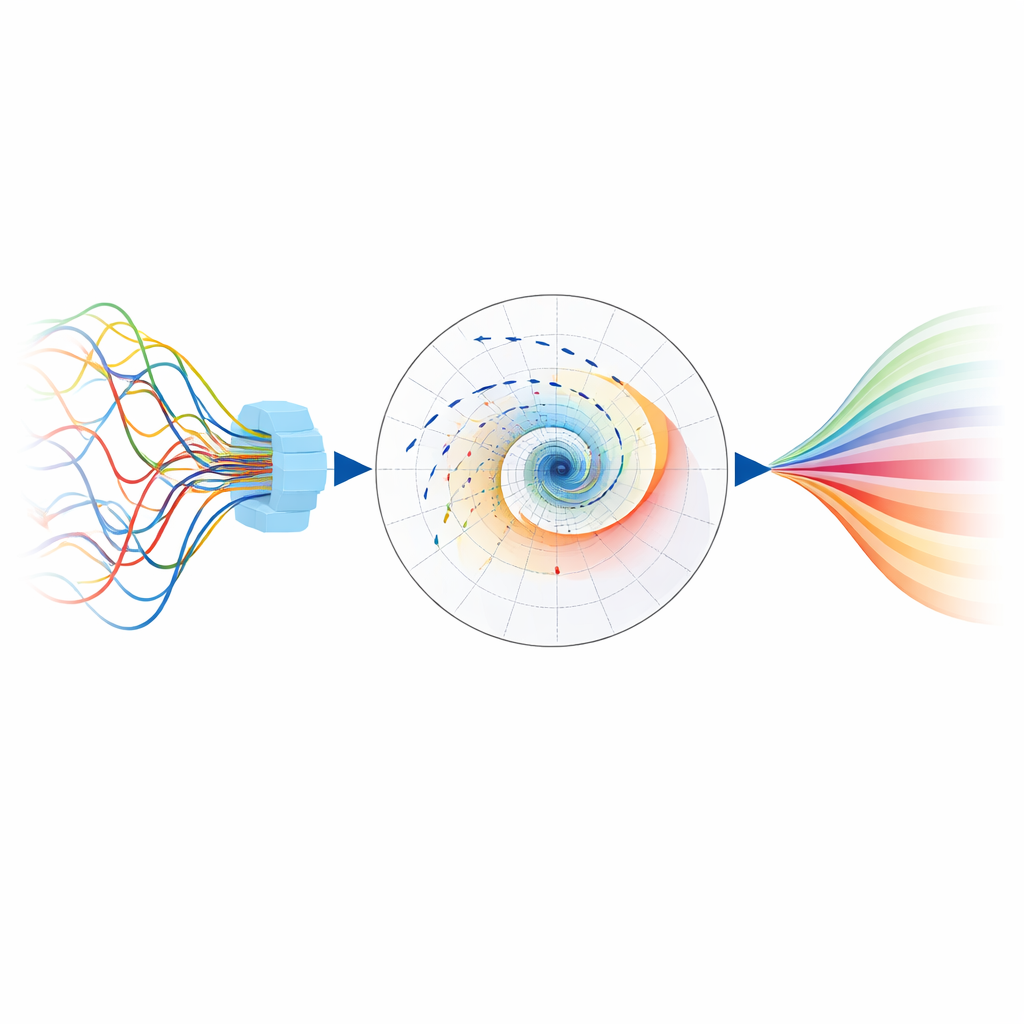

Los autores parten de una idea familiar en la IA actual: usar un Transformer para digerir series temporales en bruto y obtener una representación interna rica. DeepKoopFormer inserta entonces una capa intermedia cuidadosamente diseñada, inspirada en un concepto de los sistemas dinámicos conocido como el operador de Koopman. En lugar de dejar que el modelo evolucione de una manera compleja y completamente no lineal, esta capa intermedia avanza el estado interno utilizando una transformación lineal simple en un espacio oculto. De forma crucial, esta transformación está construida para que su influencia disminuya gradualmente con el tiempo en vez de amplificarse de forma descontrolada, lo que garantiza matemáticamente que las previsiones a largo plazo no se desborden ni oscilen sin control.

Cómo el modelo mantiene el equilibrio

Para imponer esta estabilidad, DeepKoopFormer restringe el paso lineal de varias maneras. La transformación se factoriza en tres piezas: dos matrices ortogonales (que preservan longitudes y ángulos) rodeando una matriz diagonal de factores de escala que se fuerzan a ser todos menores que uno. Esto significa que el estado oculto se contrae suavemente en lugar de amplificarse cada vez que se actualiza. Un segundo ingrediente, llamado regularización de Lyapunov, añade un penalizador de entrenamiento siempre que la energía del estado oculto crezca de un paso al siguiente. Juntos, estos mecanismos aseguran que la dinámica interna sea calmada y bien comportada, mientras que el Transformer antes y el decodificador lineal después de este paso quedan libres para ser expresivos. La capacidad del modelo para aprender patrones complejos y su estabilidad se controlan mediante ajustes separados, de modo que los usuarios pueden afinar uno sin romper el otro.

Poniendo el método a prueba

Los investigadores evalúan DeepKoopFormer tanto en problemas controlados como del mundo real. Primero lo prueban en sistemas caóticos clásicos como el atractor de Lorenz, donde pequeños cambios pueden conducir a futuros muy diferentes, y añaden ruido aleatorio para imitar mediciones reales. A través de distintos backbones de Transformer, las versiones mejoradas con Koopman siguen de cerca las trayectorias reales mientras mantienen un comportamiento interno estable en muchas previsiones a corto plazo. Los autores luego pasan a conjuntos de datos exigentes del mundo real: proyecciones climáticas y reanálisis sobre Alemania (velocidad del viento y presión superficial), precios de criptomonedas y generación eléctrica a partir de múltiples fuentes en España. En estos casos, las variantes de DeepKoopFormer se comparan con una red LSTM estándar y con baselines lineales más simples, abarcando muchas elecciones de longitud de ventana de entrada, horizonte de predicción y tamaño de modelo.

Qué revelan los experimentos

En tareas climáticas, financieras y energéticas, los Transformers aumentados con Koopman suelen lograr errores de predicción menores y un comportamiento más estable que la baseline LSTM, especialmente al predecir muchos pasos hacia adelante o al trabajar con datos de alta dimensión. Para el viento y la presión sobre Alemania, y para la generación eléctrica, las versiones PatchTST e Informer de DeepKoopFormer tienden a rendir mejor, capturando de forma fiable tanto tendencias suaves como fluctuaciones rápidas. En algunos casos especiales donde los patrones subyacentes son casi enteramente lineales, un método lineal muy simple aún gana en precisión de prueba, lo que subraya que no existe un modelo universalmente óptimo. Sin embargo, los diseños basados en Koopman muestran de forma consistente patrones de error más suaves conforme aumentan los horizontes de predicción, lo que indica mejor control de la incertidumbre a largo plazo y menor tendencia a sobreajustar detalles peculiares de los datos de entrenamiento.

Por qué este enfoque es prometedor

Al final, DeepKoopFormer demuestra que es posible combinar la flexibilidad del aprendizaje profundo con las garantías de la teoría clásica de sistemas dinámicos. Al insertar un paso lineal estructurado y estable en una tubería Transformer por lo demás estándar, los autores obtienen previsiones que son precisas, robustas al ruido y matemáticamente más sencillas de razonar. Para los profesionales que dependen de previsiones a largo plazo en ciencia climática, sistemas energéticos o finanzas—donde la estabilidad y la interpretabilidad son tan importantes como la mera precisión—este marco ofrece una manera de confiar un poco más en modelos neuronales potentes y de entender cómo y por qué sus predicciones se comportan a lo largo del tiempo.

Cita: Forootani, A., Khosravi, M. & Barati, M. DeepKoopFormer: a Koopman enhanced transformer based architecture for time series forecasting. npj Artif. Intell. 2, 35 (2026). https://doi.org/10.1038/s44387-026-00085-3

Palabras clave: predicción de series temporales, modelos transformer, operador de Koopman, dinámica estable, datos climáticos y energéticos