Clear Sky Science · es

Un marco variacional para la adaptividad basada en el residual en solucionadores neuronales de EDP y aprendizaje de operadores

IA más inteligente para ecuaciones difíciles

Muchos de los avances científicos actuales —desde la modelización climática hasta el diseño de nuevos materiales— dependen de resolver ecuaciones complejas que describen cómo fluyen los fluidos, cómo se propagan las ondas o cómo avanzan frentes químicos. Las redes neuronales se han convertido recientemente en herramientas potentes para abordar estas ecuaciones, pero con frecuencia tropiezan cuando la física es desafiante: choques abruptos, estructuras muy pequeñas y predicciones a largo plazo pueden hacer que fallen. Este artículo presenta una forma sistemática de hacer que estos solucionadores de IA concentren su esfuerzo exactamente donde más fallan, para que sean a la vez más rápidos y más precisos.

Por qué las redes neuronales necesitan orientación

En el aprendizaje automático científico, las redes neuronales se entrenan ya sea para reproducir la solución de una única ecuación (como en las redes neuronales informadas por la física, o PINNs) o para aprender un mapeo completo desde entradas hasta soluciones (conocido como aprendizaje de operadores). En ambos casos, la red se evalúa mediante un “residual”, una medida de cuánto viola la ecuación subyacente en cada punto del espacio y del tiempo. El entrenamiento estándar trata todos los puntos por igual, minimizando el error medio. Eso funciona para problemas sencillos, pero para ecuaciones con gradientes pronunciados, frentes móviles o estructuras localizadas, un promedio bajo puede ocultar errores serios en regiones críticas. Los investigadores han respondido con reglas ad hoc que colocan más puntos de entrenamiento donde el residual es grande, pero hasta ahora esas reglas han sido heurísticas y con justificación débil.

Una receta unificada para atención adaptativa

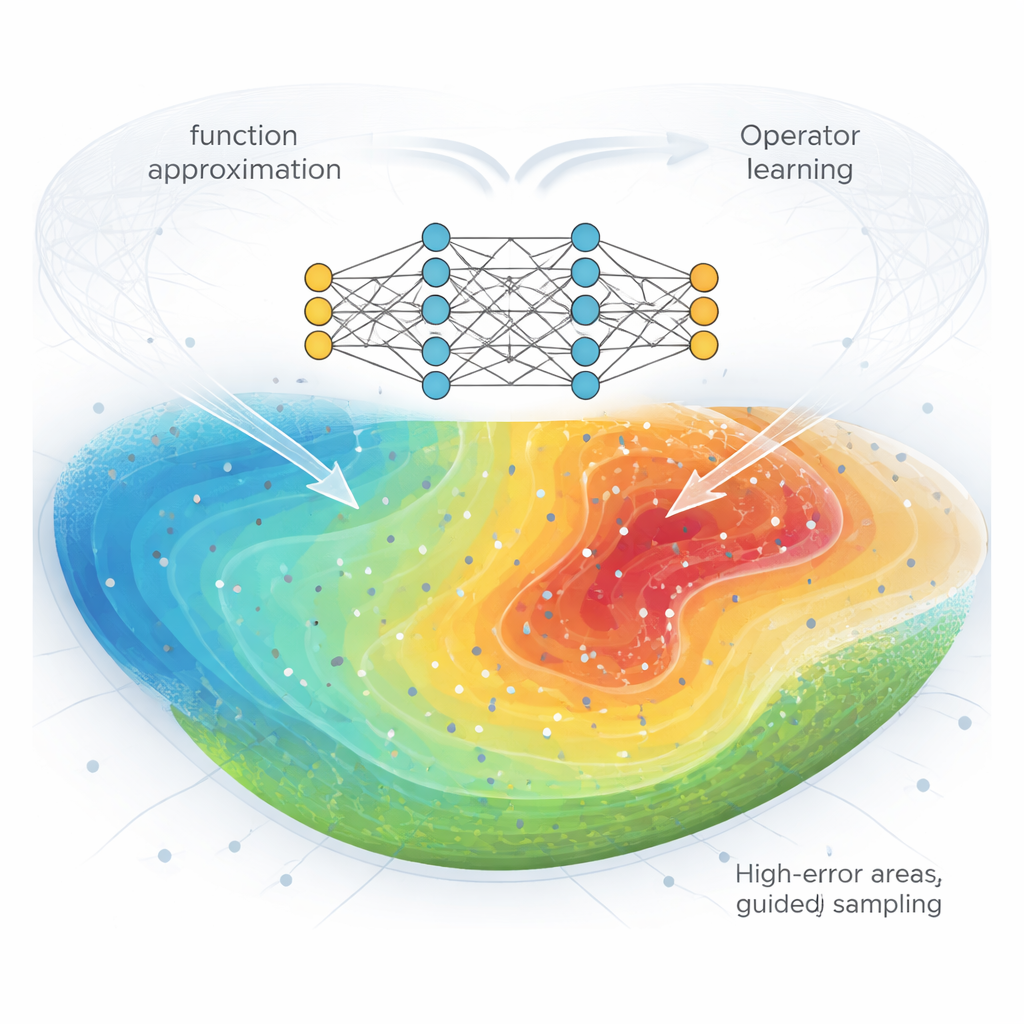

Los autores desarrollan un marco variacional que convierte esas heurísticas en una receta fundamentada. La idea clave es ver el muestreo y el ponderado como elecciones sobre qué distribución de probabilidad en el espacio (y sobre ejemplos de entrenamiento) debe importar más a la red. Introducen una familia de funciones “potencial” que transforman el residual en un nuevo objetivo. Diferentes elecciones de potencial corresponden a prioridades distintas: un potencial exponencial empuja a la red a reducir su mayor error individual, mientras que un potencial cuadrático enfatiza reducir la dispersión, o varianza, del error a lo largo del dominio. Matemáticamente, optimizar estos objetivos transformados conduce de forma natural a muestrear con mayor frecuencia en las regiones donde el residual actual es grande. El método resultante, llamado atención variacional basada en el residual (vRBA), engloba muchos esquemas adaptativos existentes y ofrece una vía clara para inventar otros nuevos.

Extensión al aprendizaje de mapas físicos completos

Los solucionadores de IA modernos buscan cada vez más aprender no solo una solución, sino todo un operador: un mapeo desde entradas como condiciones iniciales o forzamientos hasta campos espacio‑temporales completos. Este es el objetivo de arquitecturas de operadores neuronales como DeepONet, Fourier Neural Operators (FNO) y U‑Nets condicionados en el tiempo. Aquí el desafío se duplica: existe variación entre diferentes funciones de entrada y variación en el espacio y el tiempo dentro de cada ejemplo. Los autores adaptan su marco a este escenario producto combinando dos niveles de adaptividad. Primero, vuelven a ponderar los puntos espaciales dentro de cada ejemplo para que las áreas con residuos altos importen más. Segundo, usan los residuos acumulados para remuestrear preferentemente aquellos ejemplos de entrenamiento que son más difíciles de aprender. Este esquema híbrido puede integrarse directamente en modelos populares de aprendizaje de operadores sin rediseñar su arquitectura.

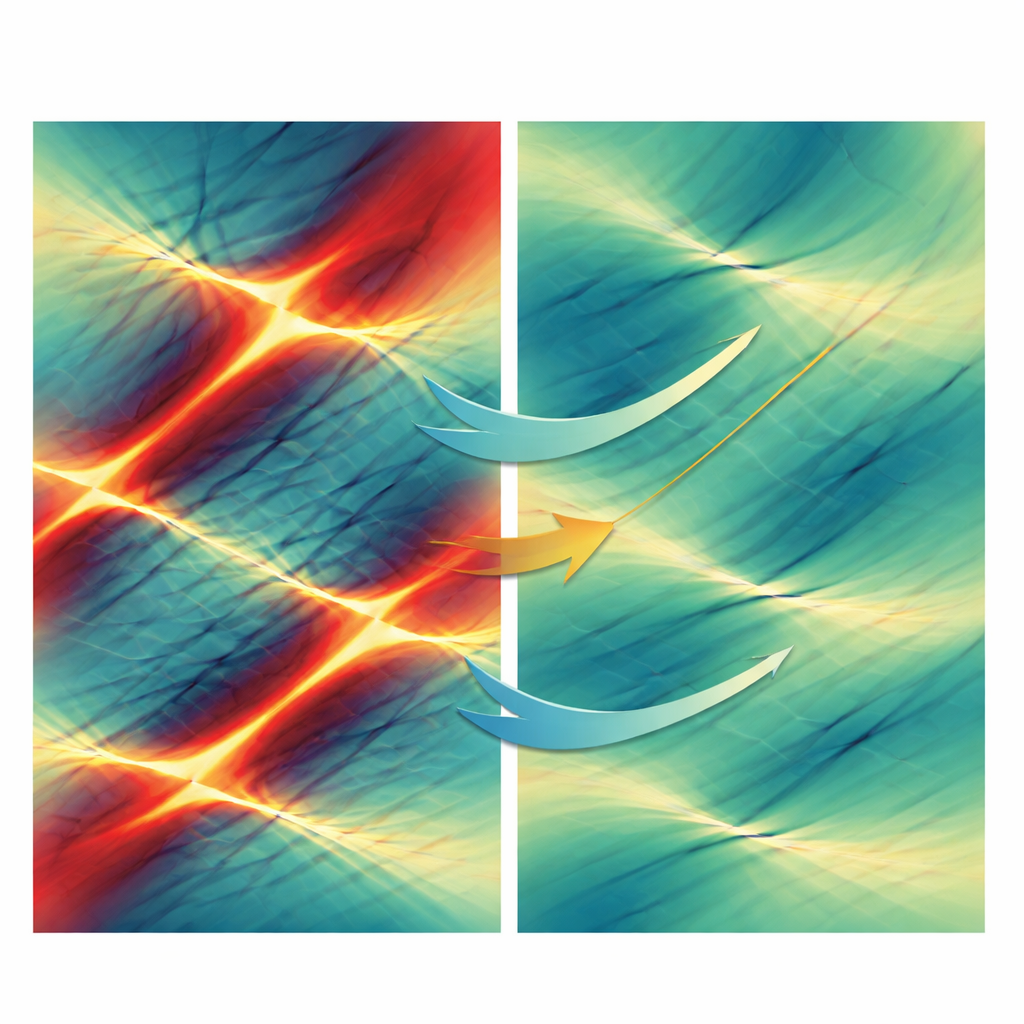

Detalles más nítidos, crecimiento de error más lento

En una amplia batería de pruebas, el enfoque vRBA supera de forma consistente al entrenamiento tradicional. Para PINNs, el equipo prueba ecuaciones no lineales clásicas como Allen–Cahn, Burgers’ y Korteweg–De Vries. Algunos de estos problemas se sabe que vencen a las PINNs estándar, ya sea por capas internas muy marcadas o por pulsos de onda que interactúan. Con vRBA, las mismas redes convergen más rápido y alcanzan errores significativamente menores, y en casos difíciles donde la línea base prácticamente fracasa, los métodos adaptativos recuperan soluciones precisas. Para el aprendizaje de operadores, aplican vRBA al crecimiento de burbujas en líquidos, flujos en tubos de choque de alta presión, turbulencia bidimensional y propagación de ondas. Aquí, el beneficio principal no es solo un error final mejor, sino una acumulación de errores mucho más lenta en el tiempo, lo cual es crucial cuando la salida de un modelo se retroalimenta repetidamente como su propia entrada.

Reduciendo el ruido en la señal de aprendizaje

Los autores atribuyen estas mejoras a dos efectos principales. Primero, al cambiar cómo se muestrean o ponderan los puntos de entrenamiento, vRBA reduce el ruido estadístico en la pérdida estimada: lotes aleatorios de puntos ofrecen una imagen más fiable de qué tan bien lo está haciendo la red en general. Esto reduce directamente el error de discretización, la brecha entre el objetivo continuo ideal y el conjunto finito de puntos usado en la práctica. Segundo, el método mejora la relación señal‑ruido de los gradientes que impulsan el aprendizaje, de modo que distintas regiones del dominio “coinciden” más sobre la dirección en la que deben moverse los parámetros. Como resultado, las redes escapan mucho antes de fases de entrenamiento lentas e indecisas y entran en un régimen donde el error cae rápidamente. El marco también aclara cuándo las estrategias agresivas —aquellas que castigan fuertemente los residuos más grandes— pueden ayudar y cuándo pueden desestabilizar el entrenamiento.

Qué significa esto para la futura IA científica

Para quienes no son expertos, el mensaje es que prestar atención más inteligente a dónde se equivoca un solucionador de IA puede convertirlo en una herramienta mucho más fiable para la ciencia y la ingeniería. En lugar de depender de reglas de prueba y error, este trabajo ofrece un plano matemático para dirigir las redes neuronales hacia las partes más informativas de un problema, ya sean frentes de choque, oscilaciones finas o comportamientos a largo plazo. A medida que los modelos científicos crecen y se usan en entornos críticos para la seguridad, estrategias tan fundamentadas para reducir el error y estabilizar el aprendizaje serán esenciales para convertir redes neuronales potentes en instrumentos científicos confiables.

Cita: Toscano, J.D., Chen, D.T., Ooomen, V. et al. A variational framework for residual-based adaptivity in neural PDE solvers and operator learning. npj Artif. Intell. 2, 32 (2026). https://doi.org/10.1038/s44387-026-00084-4

Palabras clave: redes neuronales informadas por la física, aprendizaje de operadores, muestreo adaptativo, aprendizaje automático científico, ecuaciones en derivadas parciales