Clear Sky Science · es

Atención visual humana y algorítmica en tareas de conducción

Por qué importa para la conducción diaria

A medida que los coches se automatizan, queda una pregunta clave: ¿los sistemas de conducción autónoma realmente “ven” la carretera como lo hacen los humanos? Este estudio examina cómo los conductores humanos y la inteligencia artificial centran su atención visual en el tráfico, y muestra que añadir cuidadosamente una porción de atención de tipo humano puede hacer que los algoritmos de conducción sean más inteligentes y más seguros—sin necesitar modelos de IA gigantes y de alto consumo energético.

Cómo se mueven los ojos humanos en la carretera

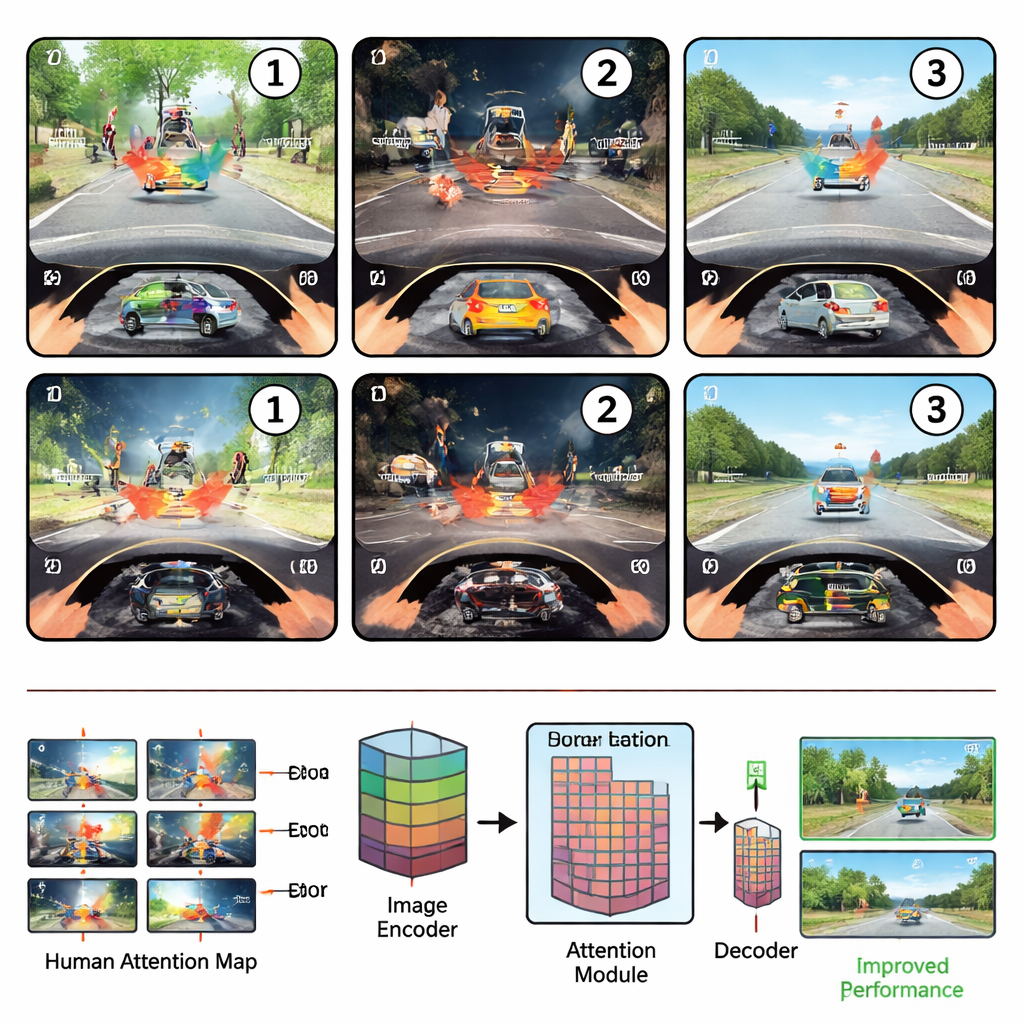

Los investigadores colocaron primero a conductores noveles y experimentados en un entorno de conducción simulado y registraron sus movimientos oculares mientras realizaban tres tareas comunes de seguridad: detectar peligros, juzgar si era seguro girar o cambiar de carril, y detectar objetos extraños o fuera de lugar. Encontraron que la atención de los conductores seguía un ritmo fiable de tres pasos. En la fase de exploración, justo después de que aparece una escena, los ojos barren ampliamente la vista, guiados principalmente por la ubicación de los elementos. En la fase de examinación, la atención se fija en la única región más informativa—como un peatón que cruza o un coche que bloquea el paso—y estudia sus detalles y significado. Finalmente, en la fase de reevaluación, los conductores comparan ese objeto clave con otros, desplazando la mirada de un lado a otro para confirmar su decisión.

Dónde miran las máquinas frente a dónde miran las personas

El equipo construyó después un modelo de aprendizaje profundo basado en atención para escenas de conducción y comparó sus “mapas de atención” internos con los procedentes de los movimientos oculares humanos. Entrenar el modelo en detección general de objetos volvió su atención algo más parecida a la humana, pero afinarlo para tareas específicas de conducción a menudo lo alejó de los patrones humanos, especialmente en la rica fase de examinación centrada en el significado. En conjunto, las correlaciones entre la atención humana y la algorítmica se mantuvieron modestas, lo que sugiere que la IA de conducción actual tiene dificultades para descubrir los principios organizativos detrás de dónde miran los humanos y por qué.

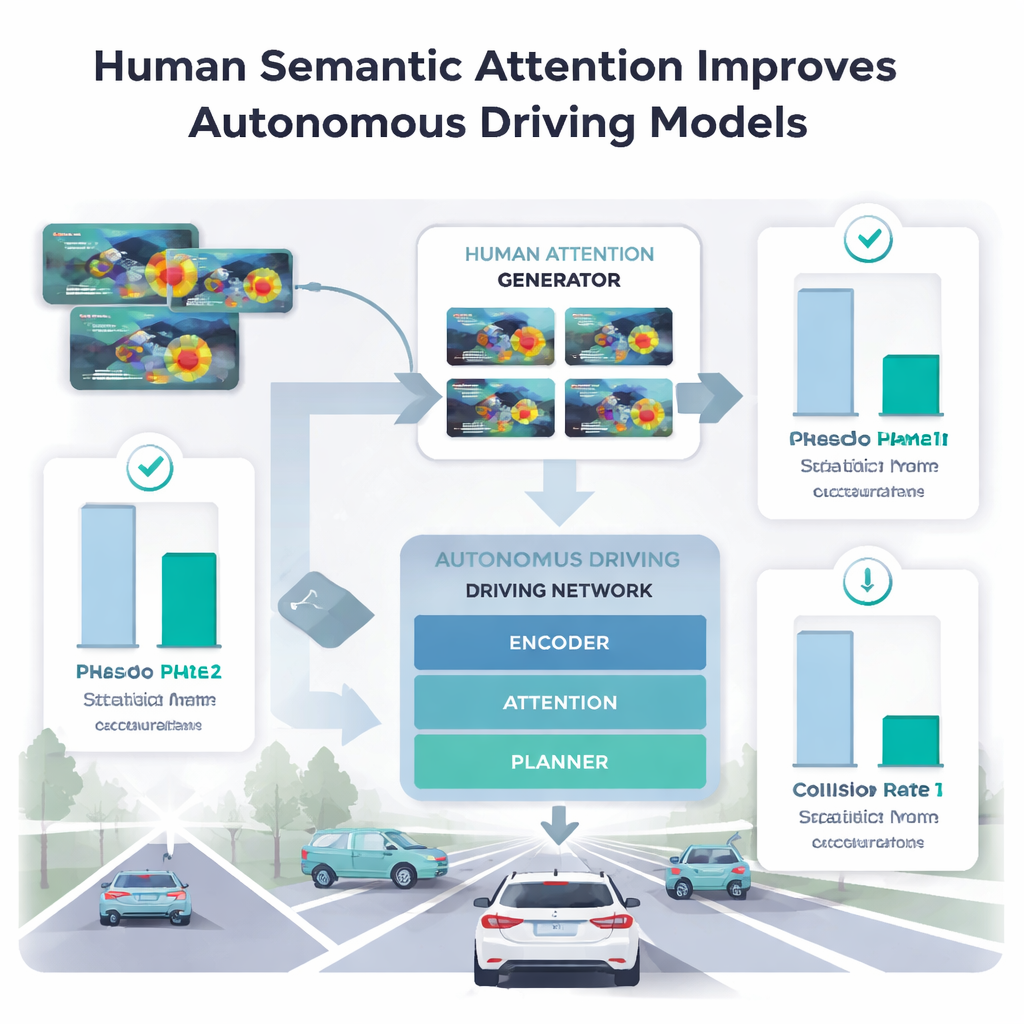

Enseñar a los coches a tomar prestada la focalización humana

Para ver qué partes de la atención humana realmente ayudan a las máquinas, los autores introdujeron distintas fases de la mirada humana en su modelo de conducción. Recopilar datos de seguimiento ocular para millones de imágenes es impráctico, por lo que entrenaron un “generador de atención humana” por separado con una muestra pequeña de apenas cinco conductores. Este generador aprendió a predecir mapas de calor de atención similares a los humanos para nuevas escenas. Cuando el modelo principal de conducción usó solo la fase espacial y temprana de exploración, su rendimiento en detección de anomalías y planificación de trayectorias empeoró a menudo o produjo trayectorias que parecían más seguras pero eran más propensas a colisiones. En cambio, cuando utilizó la fase de examinación—donde los humanos se concentran en la única región más significativa—la precisión mejoró por encima de métodos previos que usaban la mirada completa, y las tasas de colisión en tareas de planificación disminuyeron.

Lo que aún fallan los grandes modelos de visión y lenguaje

Los investigadores también probaron grandes modelos de visión y lenguaje que responden preguntas sobre conducción o generan descripciones densas de escenas callejeras 3D. En una tarea de preguntas y respuestas que enfatiza el razonamiento de alto nivel, añadir atención humana apenas ayudó y a veces empeoró los resultados, lo que implica que esos modelos ya capturan gran parte del conocimiento abstracto necesario. Pero en una exigente tarea de captioning que requiere asignar palabras precisas a objetos concretos, la atención humana de la fase de examinación aún aportó grandes mejoras. Esto sugiere que los grandes modelos pueden razonar bien en general, pero todavía tropiezan cuando deben vincular estrictamente palabras a puntos exactos en una escena visual concurrida—una brecha que la mirada humana puede ayudar a cerrar.

Qué significa esto para coches automatizados más seguros

En términos sencillos, el estudio sostiene que lo que realmente separa a las personas de la IA de conducción actual no es solo dónde miramos, sino cómo juzgamos instantáneamente qué importa en una escena. Ese breve estallido de atención semántica—cuando examinamos la región que hace que una situación sea segura o peligrosa—resulta ser exactamente la señal que a muchos algoritmos les falta. Aprendiendo a imitar esta fase a partir de una pequeña cantidad de datos de seguimiento ocular, los sistemas de conducción pueden adquirir una comprensión del entorno vial similar a la humana sin depender únicamente de modelos de IA cada vez más grandes y costosos. Este “atajo semántico” podría ser una forma eficiente de hacer que los coches automatizados futuros sean más fiables en las condiciones desordenadas e impredecibles del tráfico real.

Cita: Zheng, C., Li, P., Jin, B. et al. Human and algorithmic visual attention in driving tasks. npj Artif. Intell. 2, 23 (2026). https://doi.org/10.1038/s44387-026-00079-1

Palabras clave: conducción autónoma, atención visual, seguimiento ocular humano, modelos de visión y lenguaje, seguridad vial