Clear Sky Science · es

Agentes de IA en la sanidad: aplicaciones, evaluaciones y direcciones futuras

Por qué importan los asistentes digitales inteligentes en medicina

Los hospitales están saturados de datos, los médicos están sobrecargados y los pacientes quieren respuestas más claras sobre su salud. Un nuevo tipo de inteligencia artificial, basada en modelos de lenguaje a gran escala capaces de leer y escribir como humanos, se está transformando en “agentes de IA” que pueden razonar en tareas de varios pasos. Este artículo de revisión explica cómo estos asistentes digitales están empezando a ayudar en el diagnóstico, las decisiones de tratamiento, la documentación, las conversaciones con pacientes e incluso la educación médica, a la vez que advierte sobre lo que debe hacerse para mantenerlos precisos, justos y seguros.

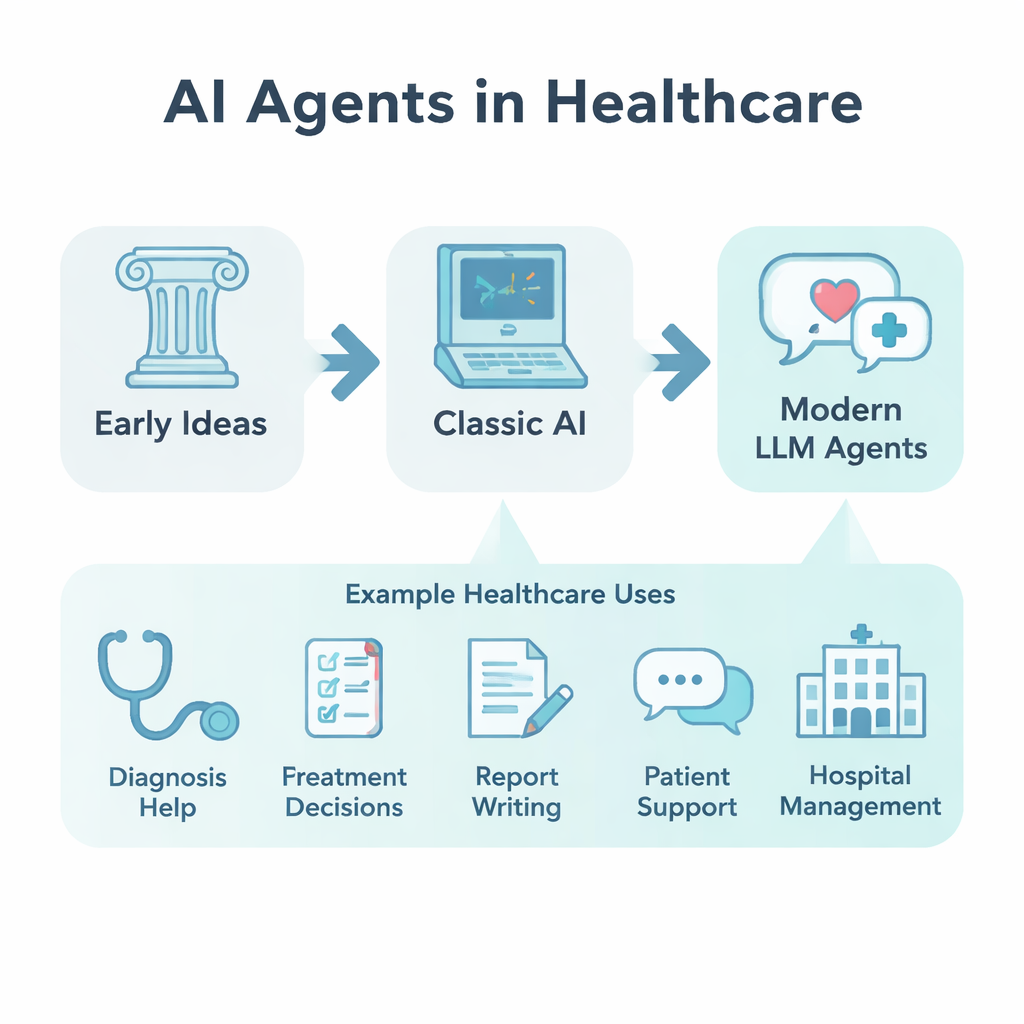

De experimentos mentales a colegas digitales prácticos

La idea de un “agente” que puede actuar con objetivos e intenciones se remonta a la filosofía antigua. Las versiones modernas llegaron con la inteligencia artificial temprana, los sistemas expertos y, más tarde, el aprendizaje automático y el aprendizaje profundo, que permitieron a los ordenadores aprender patrones a partir de datos. El avance de los modelos de lenguaje a gran escala (LLM) después de 2022 impulsó esto aún más: en lugar de limitarse a responder preguntas, estos modelos ahora pueden planificar, recordar pasos previos y llamar a otras herramientas de software. En sanidad, eso significa que un agente de IA puede leer historiales médicos, consultar guías, redactar notas y sugerir acciones siguientes, comportándose menos como un motor de búsqueda y más como un colega digital junior.

Qué distingue a estos agentes de la IA ordinaria

Según la definición adoptada en el artículo, un agente de IA en sanidad es más que un único modelo. Tiene un LLM en su núcleo, rodeado por cuatro capacidades clave: planificación, memoria, uso de herramientas y autorreflexión. La planificación le permite descomponer una tarea médica compleja en pasos más pequeños. La memoria le permite seguir la historia de un paciente o un proceso de decisión largo. El uso de herramientas significa que puede, por ejemplo, extraer resultados de laboratorio de una historia clínica electrónica o buscar en una base de datos médica. Los módulos de autorreflexión comprueban y revisan sus propias respuestas. Junto con sólidas habilidades lingüísticas y una creciente capacidad de razonamiento lógico, estas capacidades hacen que los agentes sean lo bastante flexibles para alternar entre tareas y especialidades médicas.

Cómo se están probando los agentes de IA en el trabajo sanitario real

Los investigadores están construyendo y simulando muchos tipos de agentes para ver dónde son más útiles. Algunos están diseñados para apoyar el diagnóstico simulando conversaciones entre médicos virtuales y pacientes, o haciendo que varios agentes especialistas debatan un caso difícil. Otros se centran en decisiones de tratamiento, combinando aportes de generalistas virtuales, especialistas y farmacéuticos para alcanzar un plan compartido. Hay agentes que redactan informes de radiología a partir de radiografías de tórax, o que traducen hallazgos técnicos a un lenguaje sencillo y accesible para el paciente. Se están pilotando sistemas tipo chatbot para apoyo en salud mental, coaching para pérdida de peso y recordatorios de medicación. Agentes adicionales ayudan a gestionar prescripciones, detectar efectos adversos, agilizar registros electrónicos o entrenar a estudiantes de medicina con pacientes simulados realistas.

Cómo juzgar si estos sistemas están listos para los pacientes

Dado que los errores en medicina pueden poner vidas en riesgo, la revisión sostiene que los agentes de IA deben evaluarse por más que su ingenio. Los autores agrupan las pruebas en dos capas. Las comprobaciones básicas preguntan: ¿son las respuestas correctas desde el punto de vista factual? ¿El lenguaje coincide con los informes de expertos? ¿El agente completa la tarea de forma fiable, incluyendo llamar a las herramientas adecuadas? Las comprobaciones orientadas al desarrollo analizan la velocidad, la claridad y lo bien que el sistema se comunica con las personas, incluida la consideración, la empatía y la equidad entre distintos grupos de pacientes. Los estudios comparan agentes tanto con otros modelos de lenguaje destacados como con médicos humanos, y los reguladores en Europa, Reino Unido, China y otros lugares empiezan a diseñar programas oficiales de “sandbox” para probar seguridad, equidad y beneficio clínico antes del despliegue.

Próximos pasos: robots, normas y confianza humana

Mirando hacia adelante, el artículo subraya siete prioridades: conectar agentes a robots físicos que puedan actuar en el mundo real; combinar modelos de uso general con modelos expertos más pequeños; ampliar la evaluación para incluir costos, eventos de seguridad y satisfacción del paciente; construir salvaguardas y supervisión más sólidas; integrar protecciones éticas y de privacidad; diseñar para la confianza del usuario y la retroalimentación continua; y ayudar al personal médico a adaptar sus carreras para trabajar junto a la IA en lugar de ser reemplazados por ella. Los autores concluyen que los agentes de IA podrían convertirse en socios poderosos en la sanidad, pero solo si se desarrollan, prueban y gobiernan con el mismo cuidado que la sociedad exige a cualquier nueva tecnología médica.

Cita: Zhao, L., Liu, S., Xin, T. et al. AI agent in healthcare: applications, evaluations, and future directions. npj Artif. Intell. 2, 31 (2026). https://doi.org/10.1038/s44387-026-00076-4

Palabras clave: agentes de IA en la sanidad, modelos de lenguaje a gran escala, soporte a la decisión clínica, chatbots médicos, salud digital