Clear Sky Science · es

Mejorar el reconocimiento de entidades nombradas con pocos ejemplos en grandes modelos de lenguaje usando prompting dinámico estructurado con generación aumentada por recuperación

Por qué importa leer mejor el texto médico

La medicina moderna genera océanos de texto —desde notas de cuidados intensivos hasta conversaciones en línea sobre el uso de fármacos. En esas palabras se ocultan pistas vitales sobre enfermedades, tratamientos y efectos secundarios. Encontrar y etiquetar automáticamente esos fragmentos de información, una tarea llamada “reconocimiento de entidades nombradas”, puede ayudar a los investigadores a rastrear brotes, detectar problemas con medicamentos antes y apoyar a los médicos en tiempo real. Pero los sistemas tradicionales necesitan grandes conjuntos de datos anotados a mano, que son costosos de construir y a menudo inexistentes para problemas de salud raros o emergentes. Este estudio explora cómo los grandes modelos de lenguaje, como los que hay detrás de los chatbots actuales, pueden guiarse con prompts cuidadosamente diseñados y una recuperación inteligente de ejemplos para que realicen esta tarea de etiquetado con buen rendimiento incluso cuando solo hay disponibles unos pocos ejemplos anotados.

Enseñar a las máquinas a identificar palabras importantes

Los autores se centran en el reconocimiento de entidades nombradas biomédicas —encontrar menciones de enfermedades, fármacos, síntomas e impactos sociales en el texto. Esto es difícil porque el lenguaje médico es muy especializado, varía según el hospital o subcampo, y con frecuencia incluye condiciones raras que aparecen solo unas pocas veces en cualquier conjunto de datos. Los modelos de aprendizaje automático existentes pueden alcanzar rendimientos cercanos a los humanos, pero normalmente requieren grandes corpus bien anotados que son caros de crear y compartir, especialmente bajo estrictas normas de privacidad. El aprendizaje con pocos ejemplos, en el que los modelos aprenden a partir de solo un puñado de ejemplos etiquetados, ofrece una vía para sortear este cuello de botella. Los grandes modelos de lenguaje son especialmente prometedores aquí porque pueden aprender patrones directamente a partir de instrucciones y ejemplos en el prompt, sin necesidad de reentrenar sus pesos internos.

Construir mejores instrucciones para los modelos de lenguaje

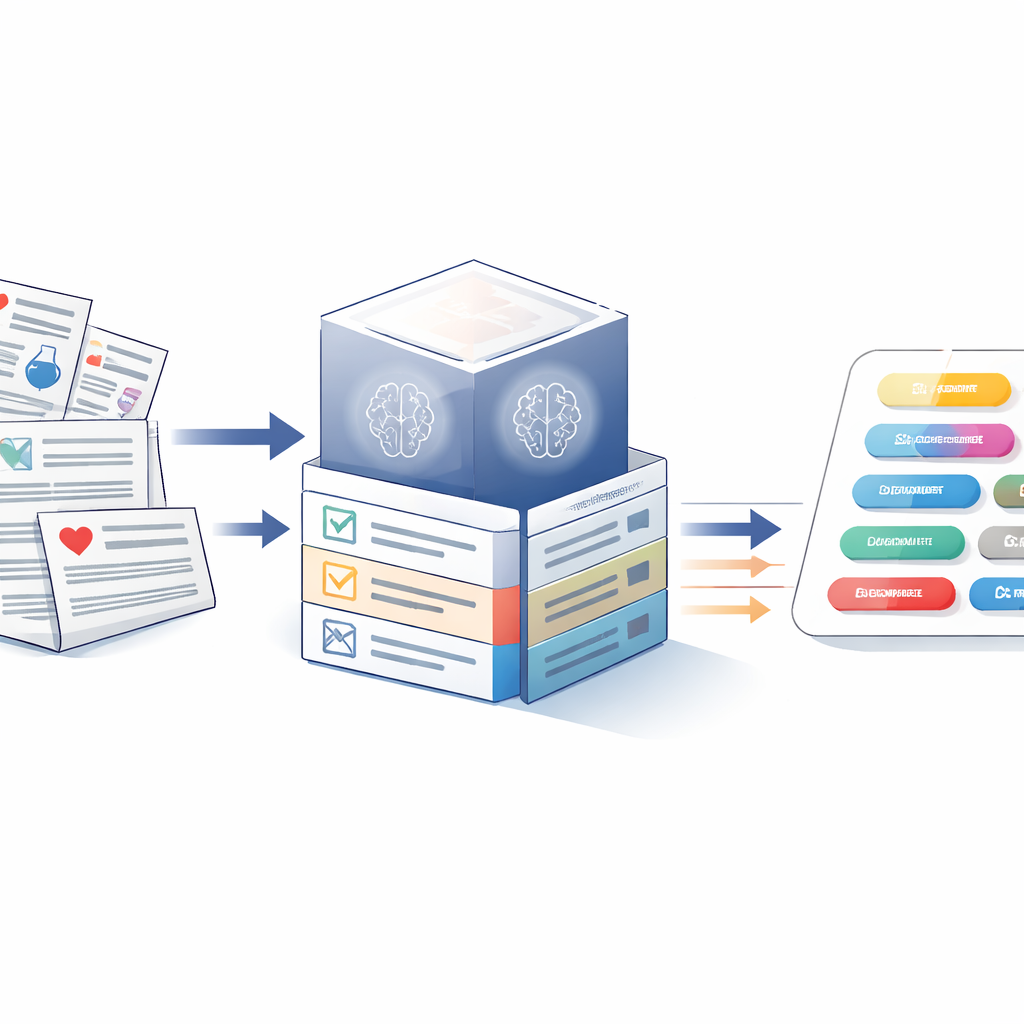

La primera parte del trabajo diseña un prompt “estático” altamente estructurado —un bloque reutilizable de instrucciones y ejemplos que se presenta al modelo para cada frase que debe etiquetar. En lugar de limitarse a decirle al modelo que marque entidades, el prompt se divide en seis elementos: una descripción clara de la tarea y definiciones de los tipos de entidad; una breve descripción del origen y el tema del conjunto de datos; palabras de ejemplo de alta frecuencia típicas de cada entidad; conocimiento médico de fondo opcional; retroalimentación resumida de errores anteriores del modelo; y un puñado de frases completamente anotadas. El equipo probó este marco con tres grandes modelos de lenguaje —GPT-3.5, GPT-4 y LLaMA 3-70B— en cinco conjuntos de datos biomédicos que abarcan registros clínicos, resúmenes científicos y publicaciones en Reddit sobre el uso de opioides. Al estratificar cuidadosamente estos componentes, las puntuaciones F1 (un equilibrio entre precisión y exhaustividad) aumentaron aproximadamente 11–12 puntos porcentuales respecto a un prompt básico, con GPT-4 logrando el mejor rendimiento global.

Permitir que el modelo busque mejores ejemplos en tiempo real

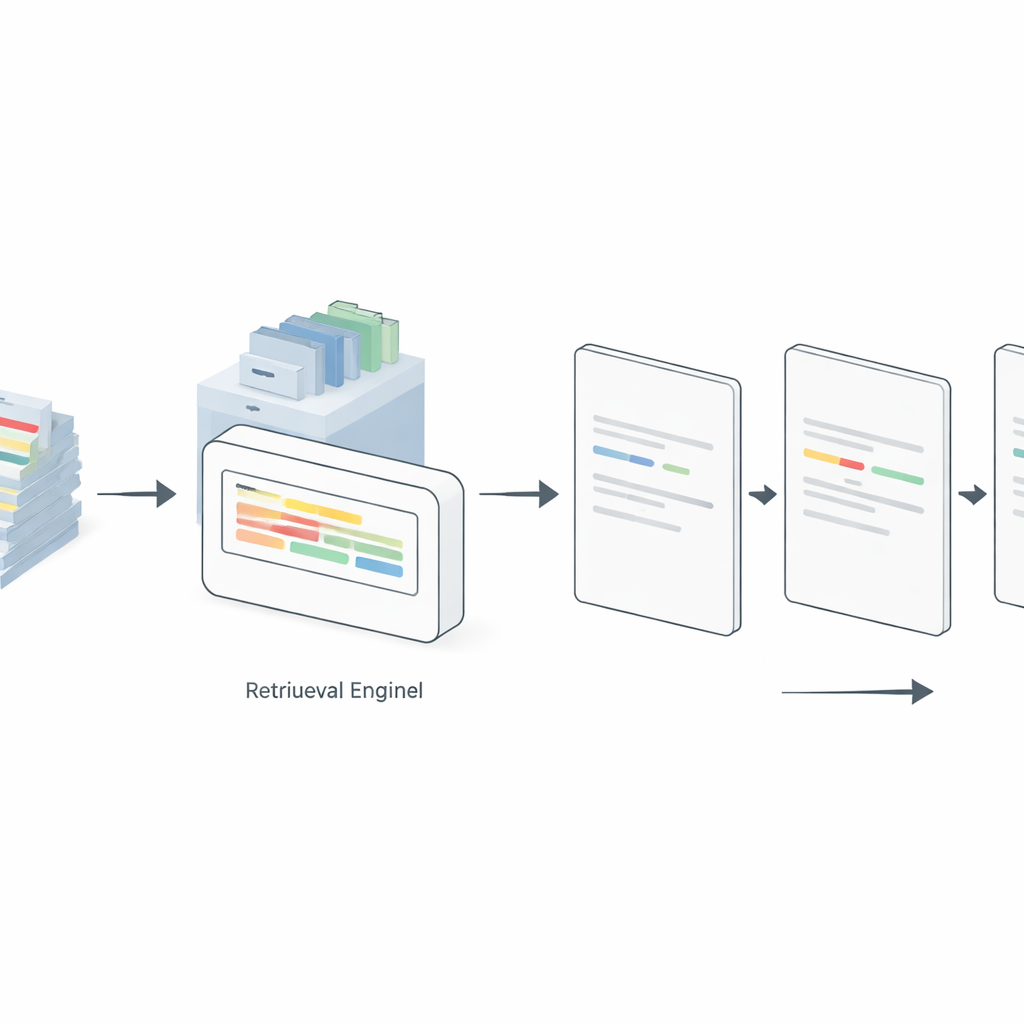

Los prompts estáticos, sin embargo, siempre muestran los mismos ejemplos, incluso cuando no encajan bien con la nueva frase que se debe etiquetar. Para solucionarlo, los autores introducen una estrategia de prompting “dinámico” potenciada por generación aumentada por recuperación. Aquí, un motor de recuperación separado indexa todos los ejemplos anotados disponibles. Para cada nueva frase de entrada, el sistema busca en este conjunto las frases etiquetadas más similares e inserta solo esas en el prompt. El estudio compara varios métodos de recuperación, desde un esquema simple de frecuencia de términos (TF–IDF) hasta modelos de incrustación neuronales como Sentence-BERT (SBERT), ColBERT y Dense Passage Retrieval. En GPT-4, LLaMA 3 y un modelo de peso abierto llamado GPT-OSS-120B, la selección dinámica de ejemplos relevantes superó consistentemente al prompting estático en configuraciones de 5, 10 y 20 ejemplos. Sorprendentemente, el método simple TF–IDF a menudo igualó o superó a enfoques más complejos, especialmente en conjuntos de datos más limpios y estandarizados, mientras que SBERT destacó en textos más ruidosos de redes sociales.

Sacar más partido a menos ejemplos anotados

Dado que anotar texto médico es costoso, los autores también estudiaron cuántos ejemplos anotados debe indexar el motor de recuperación para ser útil. Usando LLaMA 3-70B, variaron la piscina de recuperación desde 50 ejemplos hasta todo el conjunto de entrenamiento. El rendimiento generalmente mejoró a medida que la piscina crecía, pero las ganancias se aplanaron rápidamente: piscinas de aproximadamente 100–200 ejemplos alcanzaron casi la misma precisión que indexar todos los datos disponibles, a menudo dentro del margen estadístico de error. En algunos casos, piscinas extremadamente grandes empeoraron ligeramente el rendimiento, probablemente porque introducían más ejemplos irrelevantes o confusos y alargaban el prompt. Estos hallazgos sugieren que, cuando se combina con un modelo de lenguaje potente y prompts bien diseñados, incluso esfuerzos de anotación modestos pueden dar lugar a un reconocimiento de entidades biomédicas robusto, lo que hace el enfoque viable para enfermedades raras, nuevos conceptos clínicos o instituciones con recursos limitados.

Qué significa esto para la medicina real

En conjunto, el estudio muestra que los grandes modelos de lenguaje pueden identificar de forma fiable conceptos médicos importantes en el texto usando solo un puñado de ejemplos anotados, siempre que se les guíe con prompts estructurados y un sistema de recuperación que aporte los casos previos más relevantes. GPT-4 ofrece el mejor rendimiento general, mientras que los modelos abiertos y más pequeños también se benefician de forma sustancial de la misma receta de prompting y recuperación. Para los profesionales, esto significa que no es necesario construir conjuntos de datos masivos cada vez que surge un nuevo tipo de entidad o preocupación de salud; un conjunto compacto y cuidadosamente curado de ejemplos junto con un prompting inteligente puede ser suficiente. A medida que los sistemas de salud siguen digitalizando notas y los pacientes comentan sus experiencias en línea, estas herramientas eficientes y adaptables podrían facilitar mucho la extracción de conocimiento clínicamente útil del vasto y desordenado mundo del texto médico.

Cita: Ge, Y., Guo, Y., Das, S. et al. Improving few-shot named entity recognition for large language models using structured dynamic prompting with retrieval augmented generation. npj Artif. Intell. 2, 39 (2026). https://doi.org/10.1038/s44387-025-00062-2

Palabras clave: reconocimiento de entidades nombradas biomédicas, aprendizaje con pocos ejemplos, grandes modelos de lenguaje, generación aumentada por recuperación, minería de texto clínico