Clear Sky Science · es

Análisis de equidad de predicciones de agresión mediante aprendizaje automático en cuidados psiquiátricos agudos

Por qué esto importa para las personas reales

Los hospitales están recurriendo a la inteligencia artificial para identificar qué pacientes podrían volverse agresivos, con la esperanza de prevenir daños sin recurrir a contenciones traumáticas. Pero si estas herramientas de predicción son injustas, pueden agravar las desigualdades que ya determinan quién se percibe como “peligroso”. Este estudio plantea una pregunta urgente: cuando una máquina ayuda a decidir quién es de alto riesgo en una unidad psiquiátrica, ¿trata a todos los pacientes por igual?

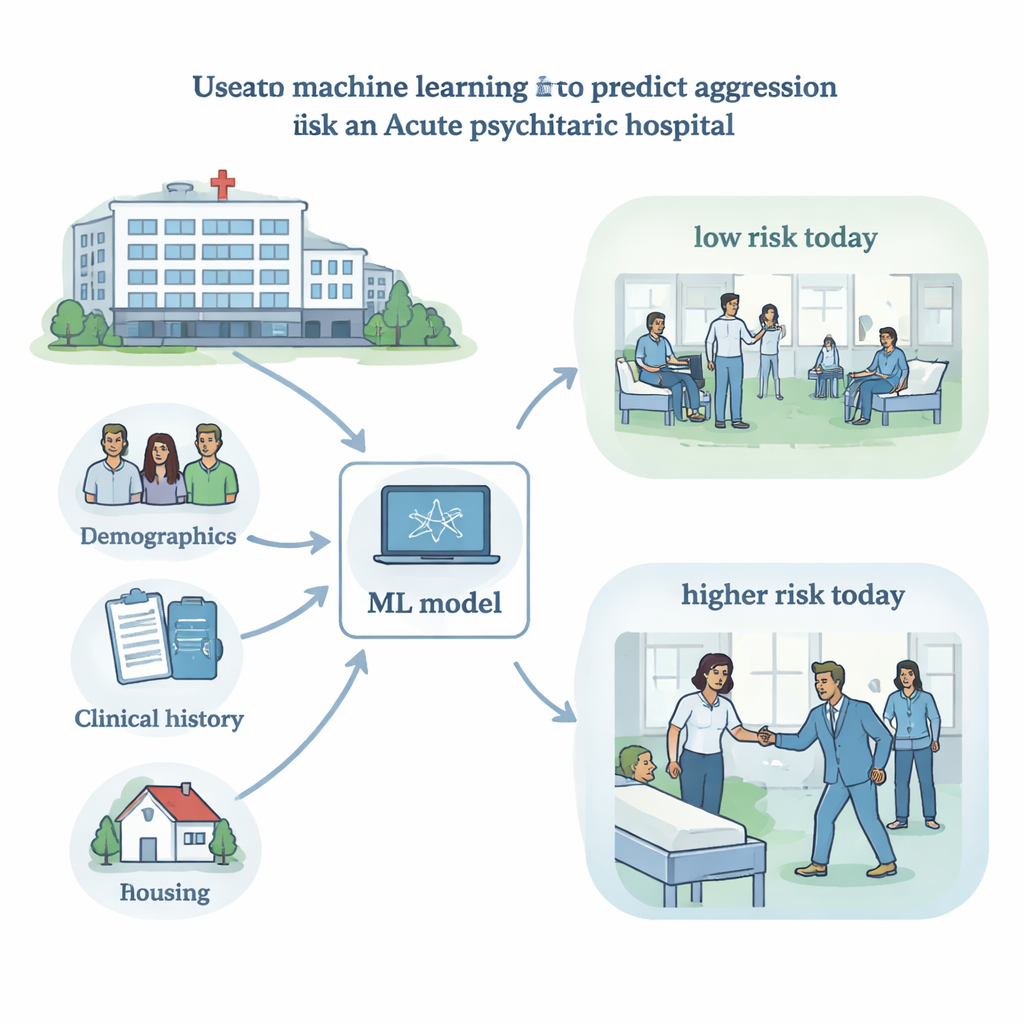

Uso de datos hospitalarios para señalar riesgo a corto plazo

Los investigadores analizaron registros de más de 17.000 pacientes atendidos en unidades psiquiátricas agudas de un gran hospital de salud mental canadiense entre 2016 y 2022. En cada uno de hasta tres días durante una estancia hospitalaria, el personal registró una lista de verificación estándar en la cabecera llamada Dynamic Appraisal of Situational Aggression (DASA), que valora comportamientos como irritabilidad o amenazas verbales que pueden señalar agresión inminente. El equipo combinó estas puntuaciones con información recogida al ingreso, como diagnóstico, edad, género, raza o etnia, situación de vivienda y cómo llegó la persona al hospital, para entrenar un modelo de aprendizaje automático que predijera si el paciente estaría implicado en un incidente agresivo (incluido el uso de contenciones o aislamiento) en las siguientes 24 horas.

Cómo rindió la herramienta de predicción en conjunto

El sistema con mejor desempeño usó un método popular de aprendizaje automático llamado random forest (bosque aleatorio). En datos de prueba retenidos, ordenó correctamente los días de mayor riesgo gran parte del tiempo, alcanzando un “área bajo la curva” de alrededor de 0,81, comparable a herramientas similares en psiquiatría. Sin embargo, la agresión era poco frecuente: hubo aproximadamente 33 días sin incidentes por cada día con uno, por lo que el modelo aún pasó por alto muchos eventos reales y generó algunas alarmas falsas. Las medidas de importancia mostraron que los factores clínicos momento a momento, especialmente ítems del DASA como la irritabilidad y incidentes recientes previos, contribuyeron con más fuerza a las predicciones que las demografías por sí solas. Esto significa que el modelo detectaba señales clínicas con significado, pero las métricas de rendimiento por sí solas no revelaban si era igualmente confiable para todas las personas.

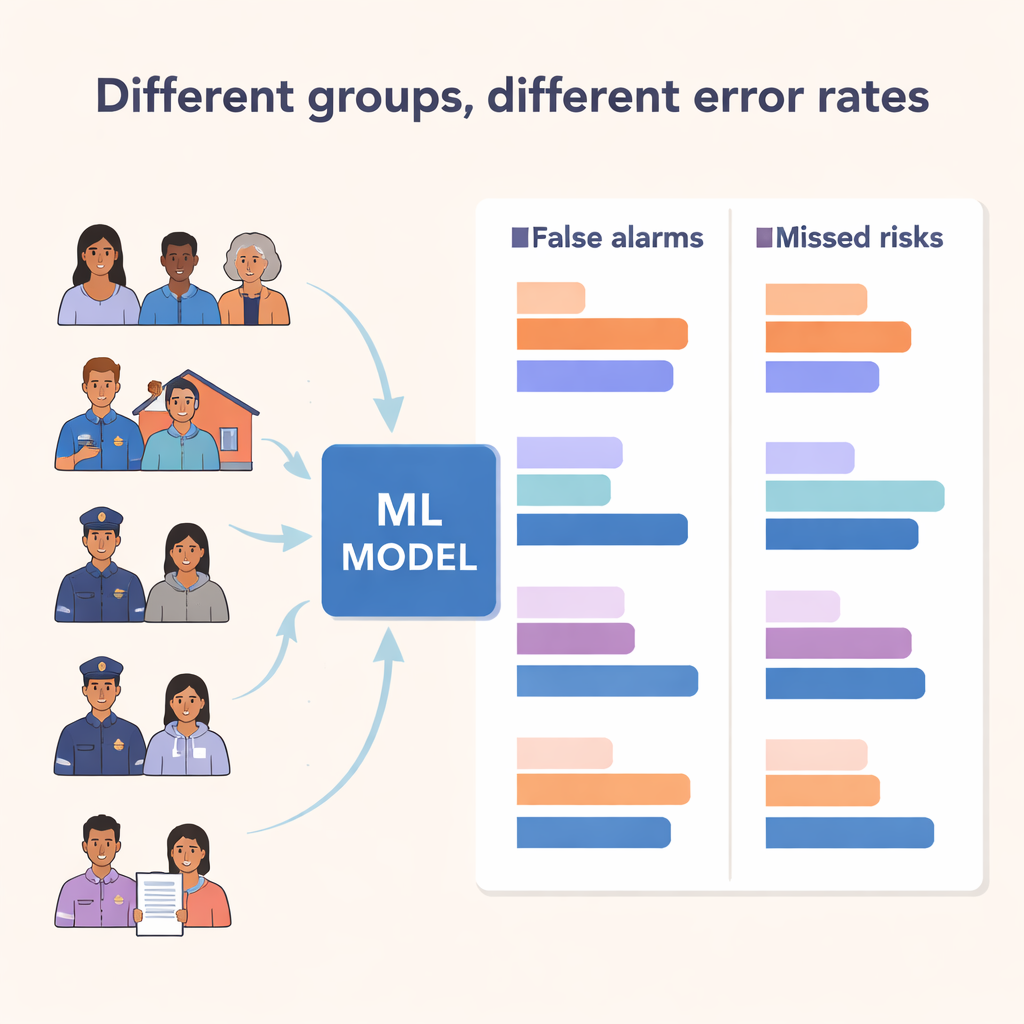

Errores desiguales entre distintos grupos

El núcleo del estudio fue una comprobación de equidad. El equipo se centró en dos tipos de errores: falsos positivos, donde el modelo señala riesgo pero no ocurre nada, y verdaderos positivos, donde anticipa correctamente un incidente. Un modelo justo, según un criterio de uso común llamado “odds igualados” (equalized odds), debería tener tasas similares de falsos positivos y verdaderos positivos entre los grupos. En cambio, los investigadores encontraron grandes diferencias. Los falsos positivos fueron más altos para pacientes de origen mediooriental y negros, hombres, personas llevadas al hospital por la policía y quienes estaban sin hogar o en viviendas de apoyo. Algunos grupos—como los admitidos por la policía o quienes tenían vivienda inestable—presentaron tanto tasas de detección más altas como más alarmas falsas, lo que sugiere que el modelo estaba ajustado para ser especialmente sensible con ellos. Otros, como los pacientes negros, experimentaron una combinación preocupante: más alarmas falsas y menor capacidad para identificar correctamente el riesgo verdadero.

Cuando las identidades se cruzan, las brechas se amplían

Dado que las experiencias de las personas están determinadas por más de una característica a la vez, los investigadores también examinaron identidades superpuestas, en particular la combinación de raza o etnia y género. Aquí, la mayor señal de alerta surgió para los hombres medioorientales, que tuvieron la tasa de falsos positivos más alta de todos los grupos, mientras que las mujeres medioorientales no la presentaron. Los hombres negros e indígenas también tuvieron falsos positivos elevados en comparación con las mujeres de la misma procedencia. Estos patrones reflejan desigualdades bien documentadas en la atención en salud mental, como tasas más altas de intervención policial, ingreso involuntario y diagnósticos erróneos entre ciertos grupos racializados y entre hombres. El sistema de aprendizaje automático no creó esas desigualdades, pero aprendió de datos impregnados por ellas—y corrió el riesgo de amplificarlas en las decisiones clínicas.

Qué significa esto para el futuro de la IA en psiquiatría

Los autores sostienen que el análisis de equidad debe tratarse como una verificación de seguridad central, no como un extra opcional, antes de implementar cualquier herramienta predictiva. Señalan que los métodos técnicos de “dessesgo”—como ajustar los datos de entrenamiento o establecer distintos umbrales de alerta para diferentes grupos—pueden ayudar, pero son limitados si los registros subyacentes ya reflejan trato desigual y prácticas coercitivas. En última instancia, decidir qué cuenta como un modelo “justo” no es solo un problema matemático; es una cuestión social y ética que requiere la participación de pacientes, clínicos y comunidades. Este estudio muestra que, si bien el aprendizaje automático puede ayudar a identificar el riesgo de agresión a corto plazo, también puede reproducir silenciosamente el racismo estructural, el sexismo y las desigualdades de vivienda, a menos que la equidad se mida, debata y aborde con rigor.

Cita: Wang, Y., Sikstrom, L., Xiao, R. et al. Fairness analysis of machine learning predictions of aggression in acute psychiatric care. npj Mental Health Res 5, 16 (2026). https://doi.org/10.1038/s44184-026-00194-6

Palabras clave: equidad algorítmica, agresión psiquiátrica, aprendizaje automático en salud, desigualdades en salud, modelos de predicción de riesgo