Clear Sky Science · es

Todos los ojos, sin IMU: aprender la actitud de vuelo solo a partir de la visión

Ver como un insecto

Los pequeños robots voladores suelen apoyarse en diminutos sensores de movimiento para mantenerse erguidos, algo así como un oído interno para máquinas. Pero los insectos consiguen vuelos ágiles con hardware mucho más sencillo, confiando en gran medida en lo que ven. Este estudio muestra que un dron puede hacer algo similar: volar de forma estable usando solo un tipo especial de cámara y un cerebro artificial compacto, sin los sensores de movimiento habituales. Ese cambio podría hacer que futuras aeronaves del tamaño de una palma o a escala de insecto sean más ligeras, baratas y robustas.

¿Por qué prescindir de los sensores habituales?

El control de actitud—mantener un dron inclinado correctamente respecto a la gravedad—se maneja normalmente con una unidad a bordo que mide aceleración y giro. Estos sensores inerciales funcionan bien, pero añaden peso, consumen energía y pueden ser un punto único de fallo. En cambio, muchos insectos voladores no tienen un sensor dedicado a la gravedad y extraen pistas sobre su inclinación a partir de cómo se desplaza el mundo a través de sus ojos. Si los robots pudieran copiar este truco, los aparatos muy pequeños podrían necesitar solo visión tanto para ver como para equilibrarse, simplificando su diseño y facilitando reducir su tamaño hasta alcanzar la escala de los insectos.

Una cámara que solo ve el cambio

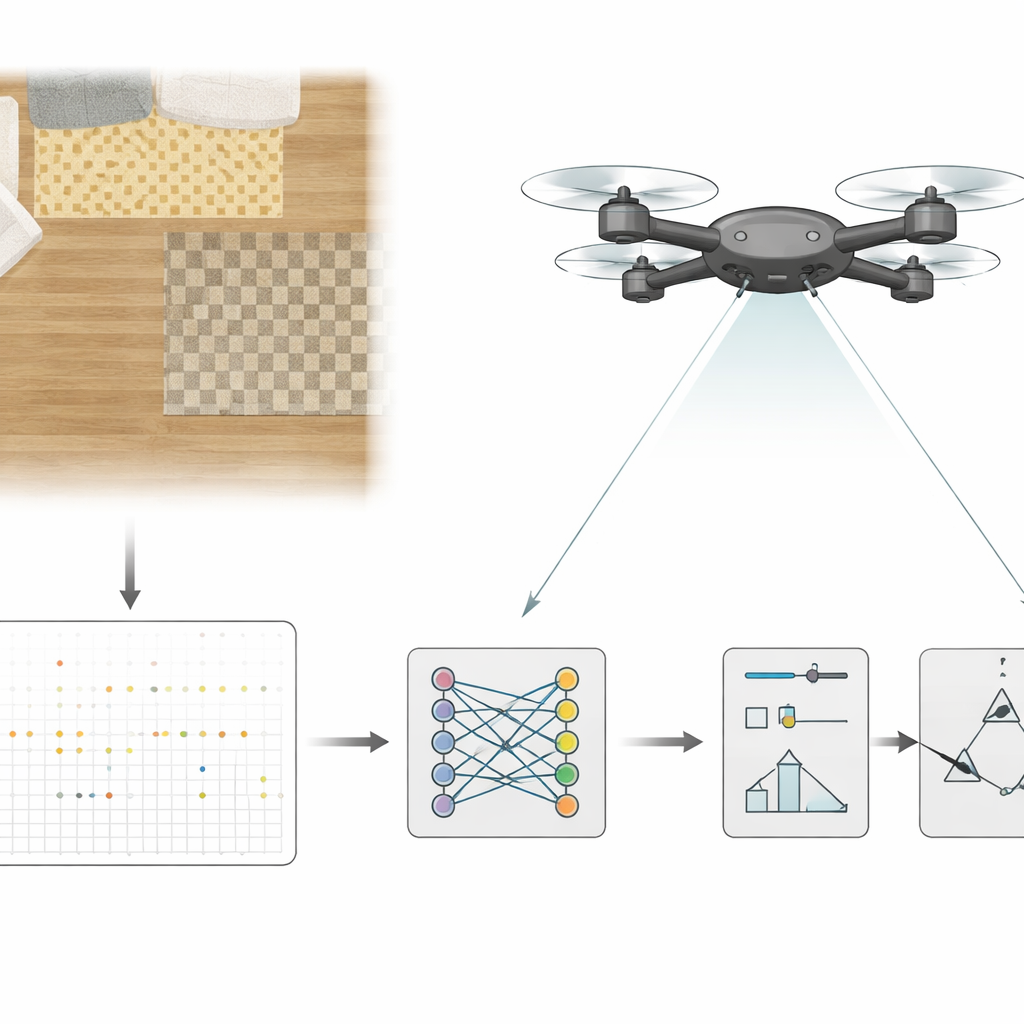

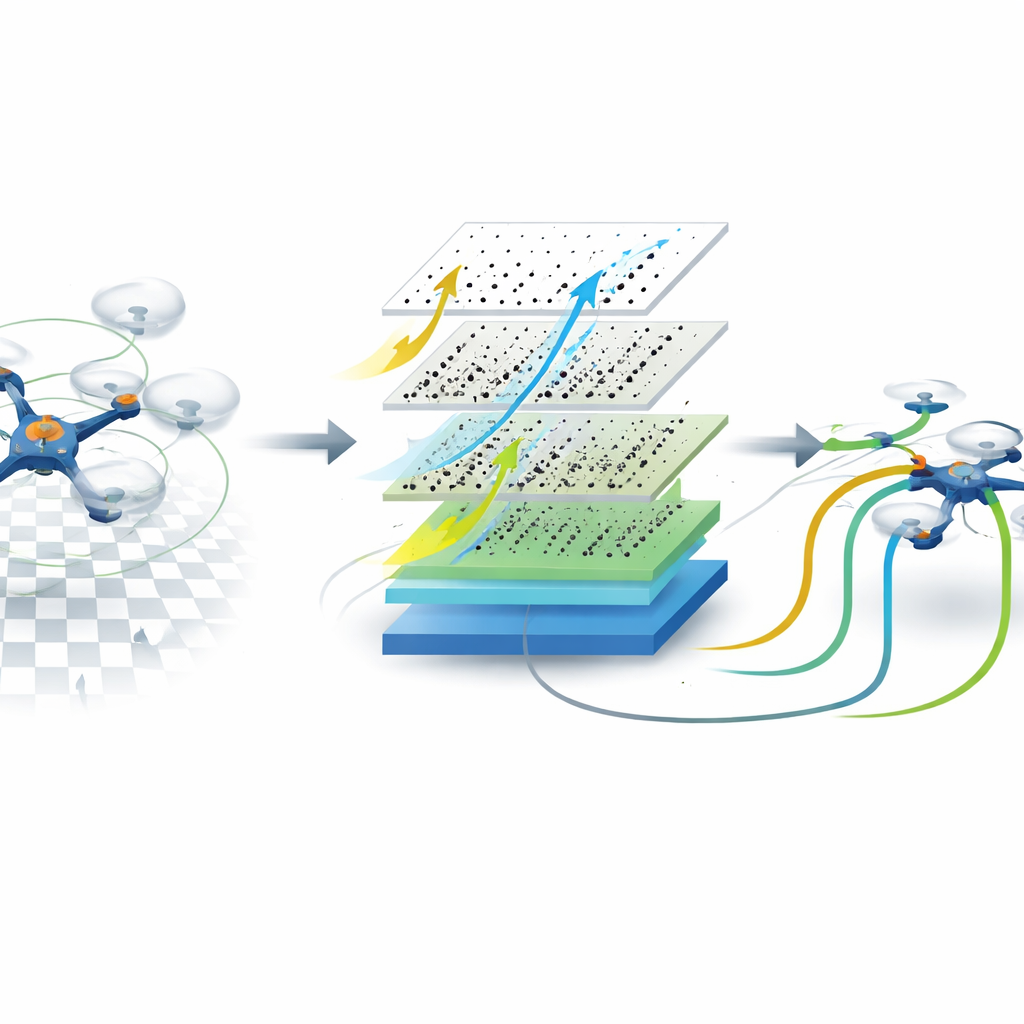

En lugar de una cámara de vídeo estándar, los investigadores usan una cámara basada en eventos orientada hacia abajo desde el dron. En vez de enviar imágenes completas a intervalos fijos, este sensor informa únicamente pequeños cambios de brillo en cada píxel, y lo hace con gran rapidez. La corriente de eventos se agrupa en fragmentos breves, cada uno cubriendo solo cinco milésimas de segundo, y estos fragmentos se alimentan a una pequeña red neuronal convolucional recurrente que se ejecuta en un chip gráfico a bordo. Con el tiempo, la red aprende a convertir patrones de cambio visual en estimaciones de la inclinación del dron y de su velocidad de rotación, reemplazando efectivamente a la unidad de movimiento tradicional en el bucle de control.

Enseñar a un dron a equilibrarse solo con visión

Para entrenar este cerebro artificial, el equipo primero voló su cuadricóptero en una arena interior mientras todavía usaba un conjunto de sensores convencional. Durante estos vuelos registraron la secuencia de eventos de la cámara junto con los valores de inclinación y rotación estimados por el controlador estándar. Luego entrenaron la red, bajo supervisión, para reproducir esos valores solo a partir de los datos visuales. En pruebas posteriores, los papeles se invirtieron: el dron voló con las estimaciones de la red cerrando el bucle, mientras que medidas independientes de captura de movimiento o lecturas a bordo sirvieron únicamente para evaluar su rendimiento. El sistema mantuvo el dron en hover y siguiendo trayectorias comandadas por el piloto durante minutos, con la mayoría de los errores de inclinación dentro de unos pocos grados y errores de rotación en límites modestos, suficientes para un vuelo estable.

Escudriñando la habilidad visual aprendida

Los investigadores indagaron qué hace que este control solo por visión funcione mejor. Compararon distintos diseños de red, añadieron o quitaron entradas adicionales como velocidades de los motores o señales de giroscopio, y variaron cuánto del campo visual de la cámara se utilizaba. Las redes con memoria—capaces de integrar información visual a lo largo del tiempo—fueron cruciales para seguir con precisión rotaciones rápidas, mientras que las versiones sin memoria lo pasaban mal. Un amplio campo de visión, que expone pistas similares al horizonte en los bordes de la imagen, ofreció los errores brutos más bajos en escenas familiares. Sorprendentemente, sin embargo, forzar a la red a mirar solo la parte central de la imagen, donde faltan esas pistas estáticas, la hizo depender más de patrones de movimiento en lugar de la apariencia de la escena. Aunque esto redujo la precisión absoluta, mejoró la manera en que el sistema se adaptaba cuando se trasladaba a entornos muy distintos, lo que sugiere que se estaba aprendiendo un sentido interno del movimiento.

Hacia robots voladores diminutos con visión como prioridad

En conjunto, el trabajo demuestra que un dron puede mantenerse erguido y controlable usando solo lo que ve, sin ningún sensor inercial en el bucle. Al combinar una cámara de eventos con una red neuronal compacta, el sistema alcanza la velocidad y capacidad de respuesta necesarias para el control en tiempo real mientras reduce el peso y la complejidad del hardware. Para el lector general, el mensaje principal es que futuras enjambres de pequeños robots voladores, parecidos a insectos, podrían equilibrarse y navegar usando un solo ojo inteligente, al igual que los insectos, abriendo la puerta a máquinas más ligeras, con mayor eficiencia energética y capaces de explorar con seguridad espacios desordenados e impredecibles.

Cita: Hagenaars, J.J., Stroobants, S., Bohté, S.M. et al. All eyes, no IMU: learning flight attitude from vision alone. npj Robot 4, 21 (2026). https://doi.org/10.1038/s44182-026-00081-4

Palabras clave: control de vuelo basado en visión, drones con cámara de eventos, robótica inspirada en la biología, controladores con redes neuronales, UAVs a escala de insecto