Clear Sky Science · es

Unir modalidades con IA: revisión de los avances en IA para imágenes biomédicas multimodales

Ver más de lo que aparece a simple vista

La medicina moderna depende en gran medida de las imágenes —desde radiografías y exploraciones por resonancia magnética hasta preparaciones microscópicas de tejido— para entender lo que ocurre en el interior del cuerpo. Esta revisión explica cómo la inteligencia artificial (IA) puede entrelazar muchos tipos distintos de imágenes médicas en una sola visión más completa de la enfermedad. Para un lector general, el atractivo es claro: estos avances podrían traducirse en una detección de cáncer más temprana, diagnósticos más precisos y tratamientos adaptados al individuo en lugar del paciente promedio.

Por qué una sola imagen ya no es suficiente

Cada técnica de imagen muestra solo una parte de la historia. Las herramientas de radiología como la TC, la RM y la ecografía revelan la forma y la estructura de los órganos, mientras que exploraciones nucleares como la PET resaltan cuán activo está un tumor. Bajo el microscopio, los patólogos observan cómo se organizan las células, y los métodos espectroscópicos leen las huellas químicas de los tejidos. Las técnicas ópticas, como la tomografía de coherencia óptica, pueden ampliar capas finas en el ojo o la piel. Por sí solas, estas instantáneas de “vista única” pueden pasar por alto pistas importantes. Sin embargo, cuando se combinan, pueden relacionar cómo se ve un tumor, cómo se comporta y qué moléculas lo impulsan, ofreciendo a los médicos una comprensión más completa de la enfermedad.

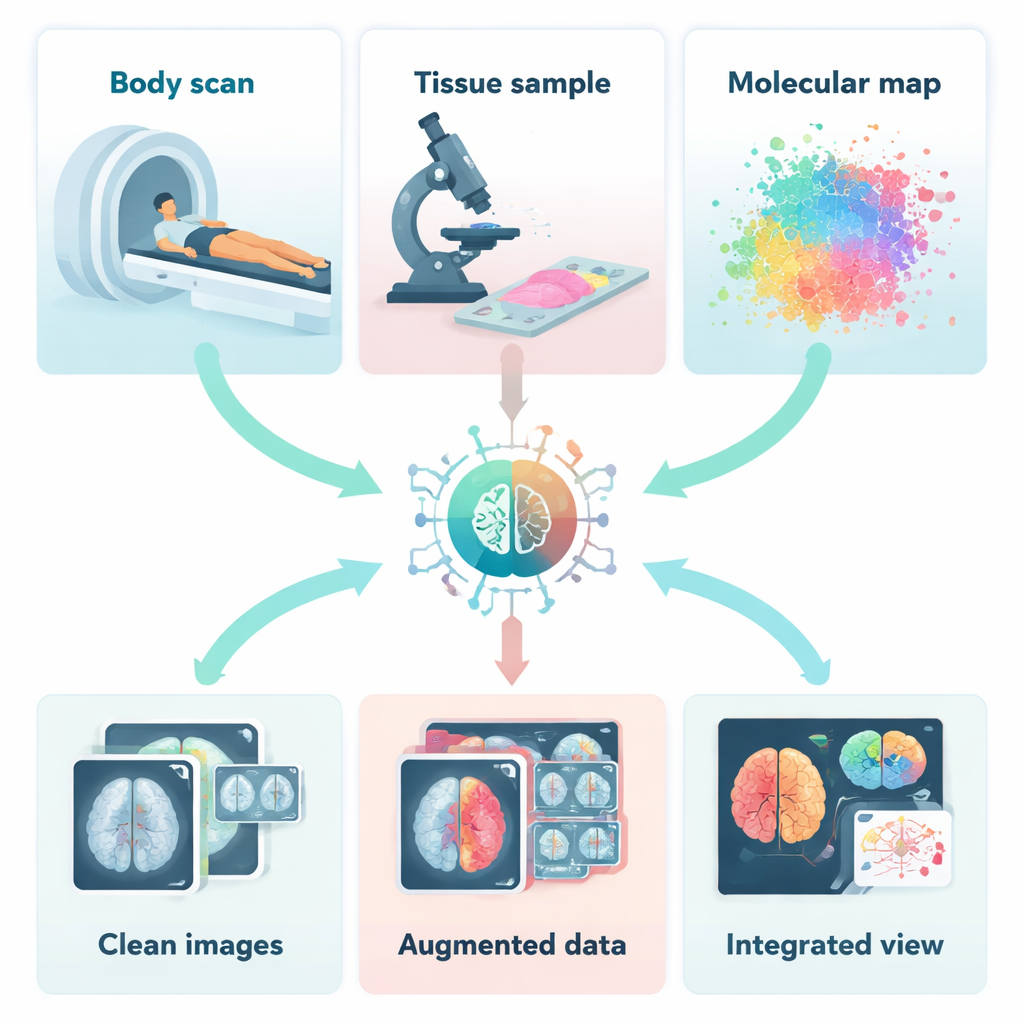

Cómo la IA limpia y complementa las imágenes médicas

Antes de que se puedan combinar distintas imágenes, deben limpiarse, alinearse y, a veces, incluso generarse desde cero. Los autores describen cómo la IA ayuda a eliminar el ruido y el desenfoque por movimiento en las exploraciones, recuperar detalles en TC o PET de baja dosis y corregir artefactos que, de otro modo, confundirían tanto a médicos como a ordenadores. Los sistemas de aprendizaje profundo pueden aprender, a partir de ejemplos, cómo debe verse una imagen limpia y luego restaurar nuevas exploraciones en consecuencia. Otros modelos de IA generan imágenes sintéticas realistas para “engordar” conjuntos de datos pequeños o llenar tipos de exploraciones que faltan. Esto es especialmente valioso en enfermedades raras, donde puede haber muy pocos ejemplos reales para entrenar herramientas diagnósticas.

Combinar diferentes vistas en una sola historia

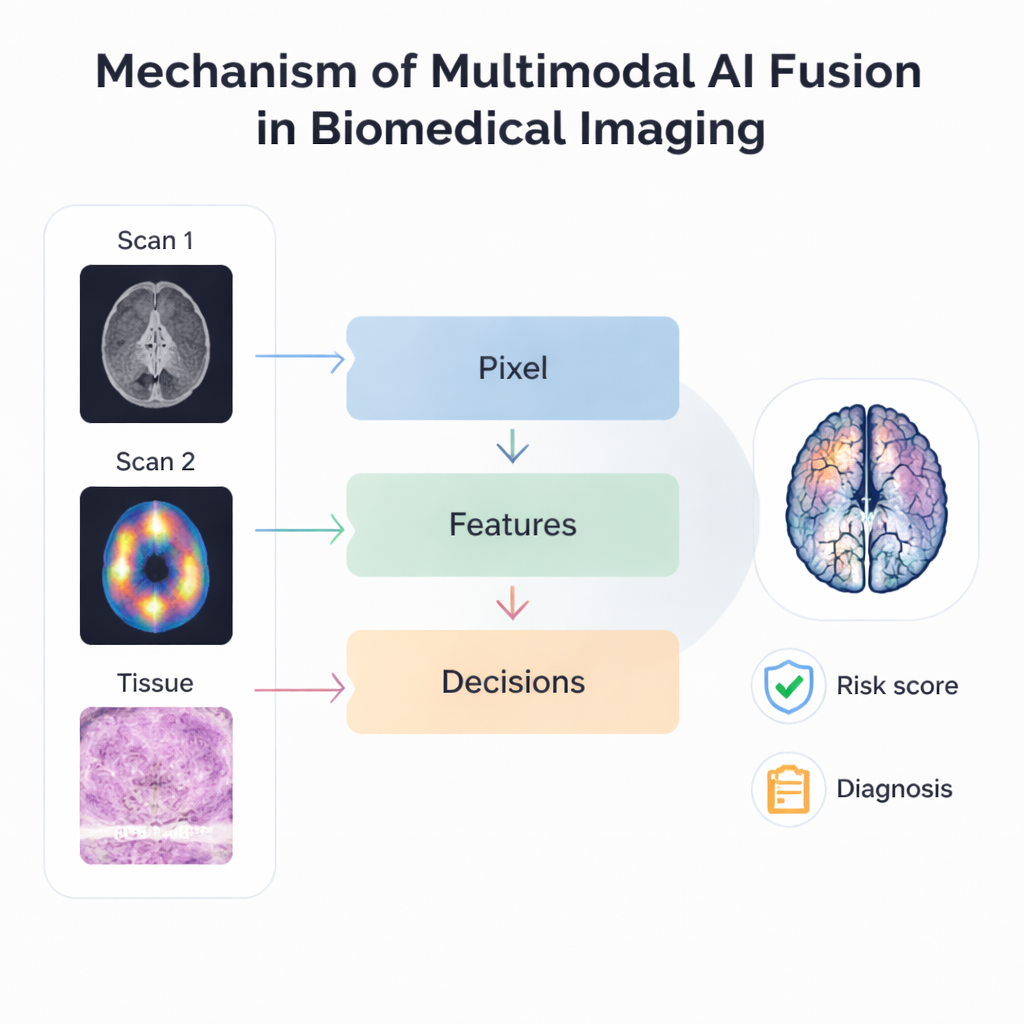

El núcleo de la revisión es cómo la IA fusiona realmente múltiples fuentes de imagen. En el nivel más básico, los métodos basados en píxeles superponen exploraciones como la RM y la PET para que la estructura y la actividad aparezcan en una sola imagen más nítida. Los enfoques más avanzados extraen patrones clave o “características” de cada modalidad y combinan esos patrones en lugar de las imágenes en bruto, lo que hace que el proceso sea más robusto frente a diferencias de resolución y alineación. La fusión en fase tardía o a nivel de decisión va más allá, permitiendo que modelos de IA separados analicen distintas imágenes y luego voten o promedien sus predicciones. Los sistemas jerárquicos mezclan varias de estas ideas, apilando diferentes etapas de fusión para poder manejar todo, desde detalles celulares diminutos hasta cambios a nivel de órgano dentro de un único marco.

De mejores imágenes a mejor atención

Estas técnicas de fusión ya se están probando en muchos escenarios clínicos. Combinar múltiples secuencias de RM mejora la segmentación de tumores cerebrales, mientras que unir mamografías, ecografía y RM potencia la detección del cáncer de mama y la predicción del riesgo. Vincular preparaciones de patología digital con imágenes de radiología ayuda a predecir la genética tumoral y la supervivencia del paciente sin necesidad de pruebas adicionales. La IA también respalda la “imagen basada en datos”, donde patrones sutiles en las exploraciones se correlacionan con la actividad génica o los resultados clínicos, prometiendo un pronóstico más preciso y una mejor selección de terapias. Nuevos modelos base y grandes modelos multimodales de lenguaje aspiran a generalizar entre tareas y tipos de imagen, e incluso a conectar imágenes con notas clínicas escritas, avanzando hacia herramientas universales que puedan adaptarse a múltiples enfermedades y hospitales.

Confianza, equidad y el camino por delante

A pesar del entusiasmo, los autores subrayan que quedan retos importantes. Las imágenes médicas varían ampliamente entre hospitales, máquinas y grupos de pacientes, lo que puede hacer que la IA sea frágil o sesgada si no se aborda con cuidado. Muchos modelos potentes se comportan como cajas negras, lo que dificulta que los clínicos comprendan por qué se tomó una decisión concreta. La revisión analiza esfuerzos para resaltar qué regiones de cada imagen influyen más en las predicciones y para diseñar sistemas más justos y transparentes. También señala cuestiones éticas relacionadas con la privacidad, el intercambio de datos y las elevadas exigencias computacionales de los modelos grandes. Mirando hacia el futuro, los autores imaginan “agentes” de IA especializados que monitoricen de forma continua las imágenes, los sensores vestibles y los registros de salud, ayuden a los clínicos en tiempo real y contribuyan a coordinar la atención a largo plazo. Para los pacientes, la conclusión es que combinar muchos tipos de imágenes médicas con IA podría significar respuestas más rápidas, tratamientos más personalizados y, en última instancia, mejores resultados —siempre que estas tecnologías se desarrollen y desplieguen de forma responsable.

Cita: Doan, L.M.T., Shahhosseini, K., Verma, S. et al. Bridging modalities with AI: a review of AI advances in multimodal biomedical imaging. Commun Eng 5, 30 (2026). https://doi.org/10.1038/s44172-026-00602-x

Palabras clave: imágenes biomédicas multimodales, IA médica, fusión de imágenes, radiología y patología, medicina de precisión