Clear Sky Science · es

Cuando los grandes modelos de lenguaje son fiables para juzgar la comunicación empática

Por qué la empatía de las máquinas importa para usted

Cada vez más, las personas recurren a chatbots y asistentes digitales cuando están estresadas, solas o enfrentan decisiones difíciles. Estos sistemas pueden sonar atentos y comprensivos, pero ¿pueden también juzgar si un mensaje es realmente de apoyo y amable? Este artículo explora cuándo los grandes modelos de lenguaje (LLM), la tecnología detrás de muchos chatbots, pueden evaluar de forma fiable cuán empática se siente una respuesta escrita y qué significa eso para herramientas cotidianas como aplicaciones de bienestar, terapeutas virtuales y bots de atención al cliente.

Estudiando conversaciones de apoyo

Los investigadores analizaron 200 conversaciones reales basadas en texto en las que una persona describía un problema personal —como estrés laboral, conflictos familiares, preocupaciones económicas o dificultades de salud mental— y otra persona intentaba responder de forma solidaria. Estas conversaciones procedían de cuatro conjuntos de datos existentes, cada uno vinculado a un conjunto distinto de preguntas para juzgar la empatía. Algunos se centraban en si el respondedor mostraba comprensión u ofrecía consuelo emocional; otros preguntaban si daba consejos prácticos, animaba al hablante a decir más o, en cambio, centraba la conversación en sí mismo. En conjunto, estos marcos descomponen “ser empático” en 21 comportamientos específicos que se pueden valorar en escalas, de forma parecida a una encuesta de satisfacción del cliente.

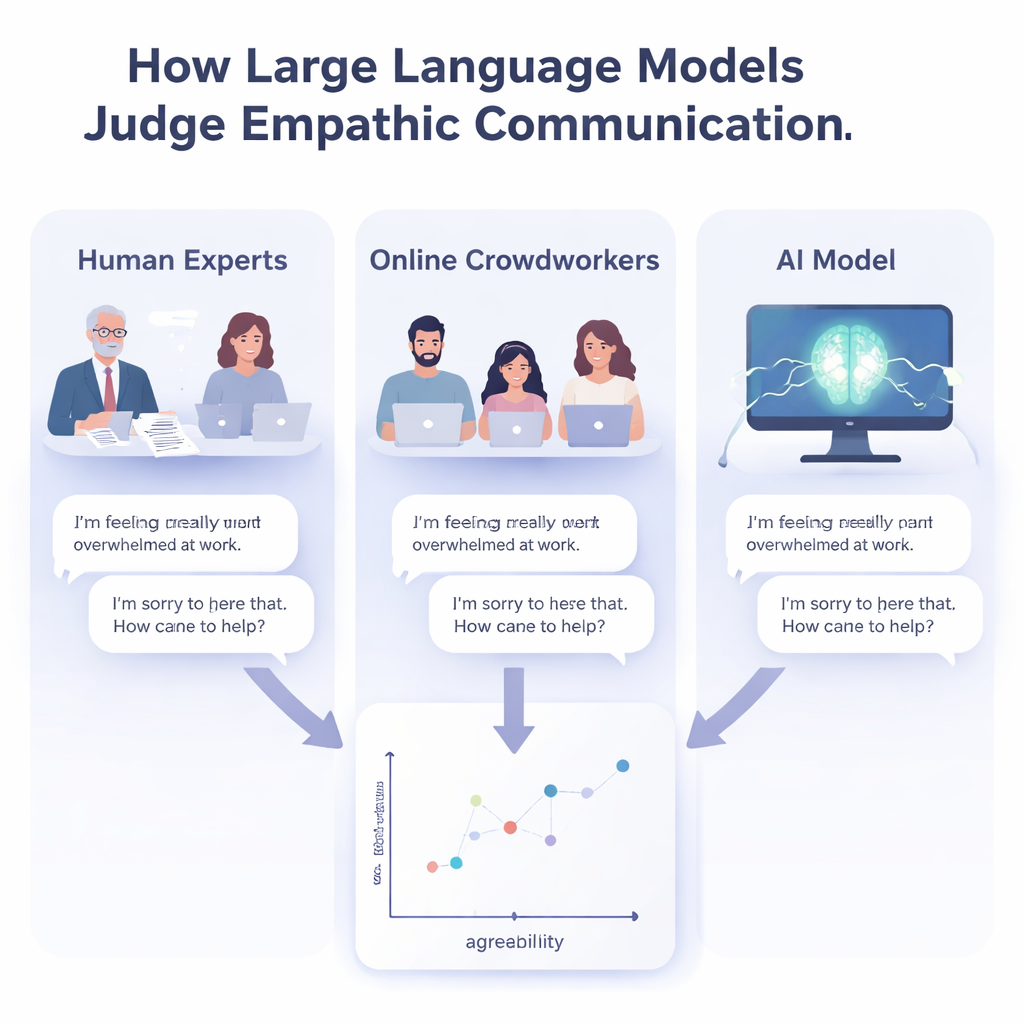

Expertos, multitudes y máquinas

Para ver qué tan bien pueden los LLMs evaluar la empatía, el equipo comparó tres tipos de jueces: expertos en comunicación, trabajadores en línea y modelos de lenguaje modernos. Tres académicos veteranos en comunicación empática valoraron de forma independiente cada conversación en los 21 comportamientos. Los trabajadores en línea —usuarios comunes de internet— ya habían proporcionado valoraciones para los mismos mensajes en estudios anteriores. Finalmente, a tres modelos de lenguaje líderes se les dio un conjunto de indicaciones en lenguaje sencillo y ejemplos de valoraciones de los expertos, y luego se les pidió puntuar cada conversación con las mismas escalas. Esta configuración permitió a los autores medir cuán estrechamente coincidían los distintos grupos, no solo con una respuesta “correcta”, sino entre sí.

¿Cuán estrecha es su concordancia?

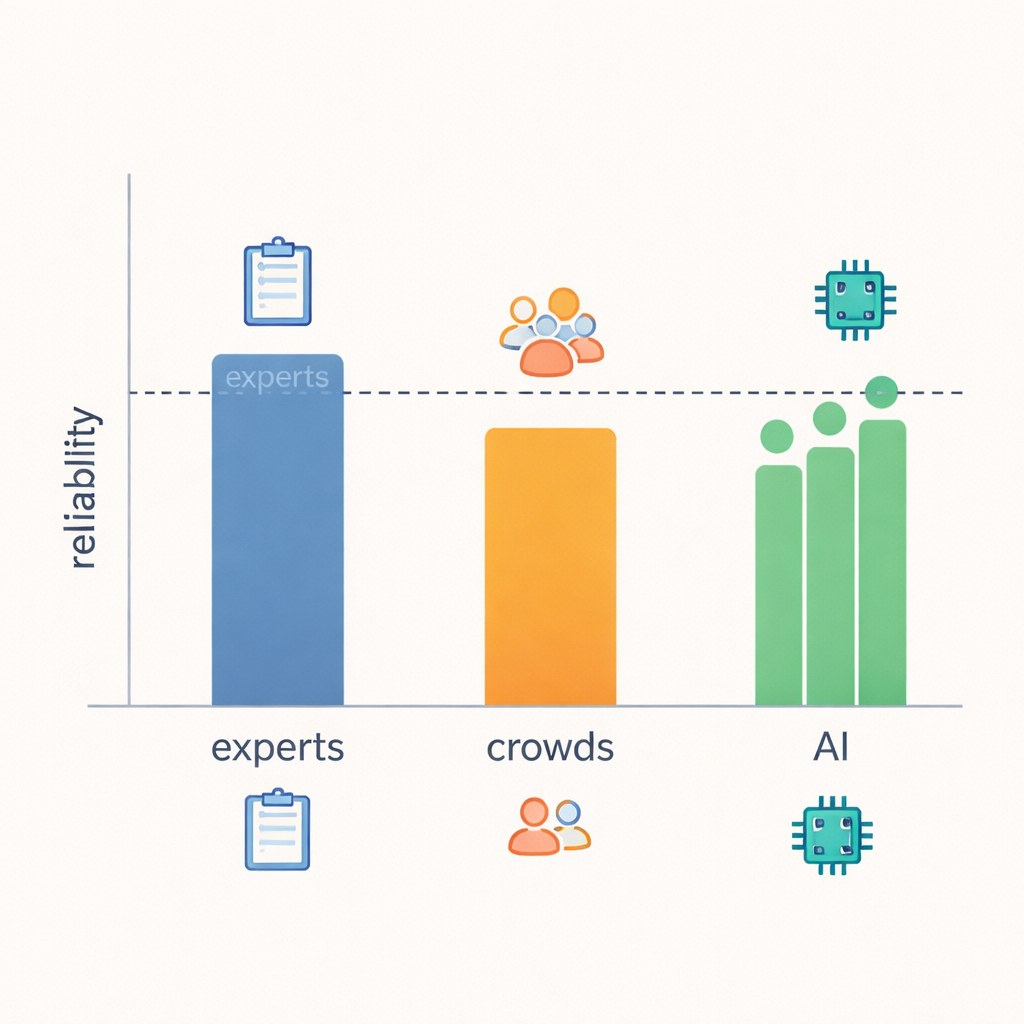

El hallazgo central es que los LLMs se acercaron sorprendentemente a la fiabilidad a nivel de expertos. Cuando los investigadores midieron con qué frecuencia coincidían las valoraciones y qué tan grandes eran las discrepancias, los modelos igualaron o casi igualaron a los expertos en la mayoría de los 21 comportamientos, y claramente superaron a los trabajadores en línea. En áreas con señales claras y observables —como si una respuesta ofrecía consejos prácticos, hacía preguntas de seguimiento o devolvía la atención al hablante— expertos, LLMs e incluso las multitudes tendían a coincidir más. Pero al juzgar ideas más difusas, como si una respuesta realmente “demostraba comprensión” o cuáles eran las intenciones del respondedor, incluso los expertos discrepaban con mayor frecuencia y la fiabilidad de los LLM disminuía junto con la de ellos. Esto sugiere que algunos aspectos de la empatía son simplemente más difíciles de determinar a partir del texto solo, independientemente de quién haga la valoración.

Por qué las puntuaciones simples pueden engañar

Muchos estudios de IA informan de éxito utilizando puntuaciones de clasificación familiares —tratando cada valoración de un experto como una verdad incuestionable y midiendo con qué frecuencia un modelo la coincide—. Los autores muestran que este enfoque puede pintar un cuadro distorsionado cuando se trata de juicios humanos sutiles. Por ejemplo, un sistema puede obtener buena puntuación adivinando mayoritariamente la valoración mayoritaria en una escala desequilibrada, aun cuando fracase en los casos más raros pero importantes. Del mismo modo, un método que suele dar puntuaciones “casi correctas” —con un error de un solo punto— puede parecer pobre bajo una métrica de coincidencia estricta, aunque se comporte de forma muy similar a un experto humano. Al centrarse en la fiabilidad entre evaluadores —qué tan consistentemente distintos jueces puntúan lo mismo—, el estudio ofrece una visión más honesta de lo que tanto humanos como máquinas pueden evaluar de forma fiable.

Qué significa esto para la IA cotidiana

Para el público en general, la conclusión es a la vez esperanzadora y cautelosa. Los LLM bien configurados pueden ahora ayudar a verificar si las respuestas escritas —tanto de ayudantes humanos como de otros bots— cumplen los estándares expertos de comunicación empática, y a menudo lo hacen con más consistencia que evaluadores humanos no entrenados. Eso podría facilitar la supervisión y mejora de chatbots usados en salud, educación y atención al cliente. Al mismo tiempo, el estudio advierte que no todas las “pruebas de empatía” se crean igual: las preguntas vagas o solapadas generan un acuerdo humano inestable y, a su vez, juicios de máquina inestables. Antes de confiar en la IA para calificar algo tan delicado como el apoyo emocional, deberíamos asegurarnos primero de que los propios expertos puedan ponerse de acuerdo sobre cómo es lo “bueno” y usar ese referente para decidir dónde las máquinas pueden ayudar con seguridad y dónde el juicio humano sigue siendo esencial.

Cita: Kumar, A., Poungpeth, N., Yang, D. et al. When large language models are reliable for judging empathic communication. Nat Mach Intell 8, 173–185 (2026). https://doi.org/10.1038/s42256-025-01169-6

Palabras clave: comunicación empática, grandes modelos de lenguaje, compañeros de IA, apoyo a la salud mental, interacción humano–IA