Clear Sky Science · es

Inferencia basada en simulación para la física de neutrinos de precisión mediante ajuste Monte Carlo neuronal

Afinando los ojos de los telescopios de neutrinos

Los futuros experimentos de neutrinos pretenden responder preguntas fundamentales sobre el universo, como el ordenamiento de masas de las pequeñas neutrinos y cómo explotan las estrellas. Para ello, sus detectores gigantes deben medir la energía con una precisión exquisita—muy superior a lo que permiten las fórmulas sencillas de libro. Este artículo muestra cómo las herramientas modernas de aprendizaje automático pueden ayudar a ajustar y validar las complejas simulaciones que conectan lo que ocurre dentro de un detector con los destellos de luz que realmente registramos.

Por qué es tan difícil entender la respuesta del detector

En experimentos como el Jiangmen Underground Neutrino Observatory (JUNO) en China, los neutrinos interactúan en un enorme tanque de líquido que produce luz cuando las partículas lo atraviesan. Esa luz es recogida por miles de fotomultiplicadores como pulsos eléctricos minúsculos, contados como “fotoelectrones”. El reto es convertir esos conteos de vuelta en la energía original de la partícula. En la práctica, esta relación no es una línea recta: depende de la geometría del detector, del comportamiento del líquido y de varios efectos físicos entrelazados. Los enfoques tradicionales confiaban en ajustar manualmente los parámetros de la simulación hasta que los espectros simulados se parecieran aproximadamente a los datos de calibración, un método que se vuelve inmanejable para experimentos modernos de alta precisión.

Enseñar a redes neuronales a emular el simulador

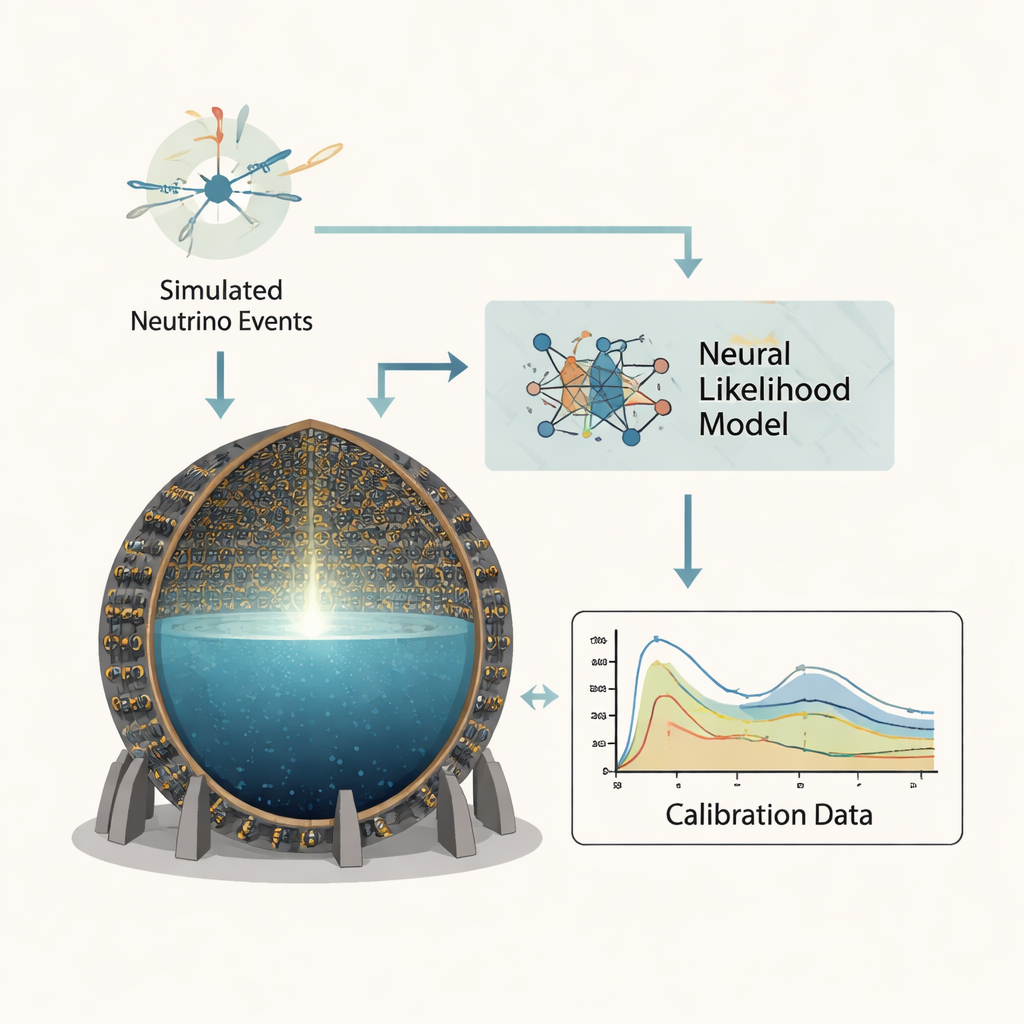

Los autores adoptan una estrategia conocida como inferencia basada en simulación, donde en lugar de intentar escribir una fórmula matemática exacta para la respuesta del detector, dejan que las simulaciones y las redes neuronales hagan el trabajo pesado. Se centran en tres parámetros clave que gobiernan cómo JUNO convierte la energía verdadera en luz detectada: un coeficiente que describe cómo se “apaga” (quenching) la producción de luz a alta densidad de ionización, un rendimiento luminoso global que fija el brillo medio y un factor que controla la cantidad de luz de Cherenkov. Usando el software Monte Carlo oficial de JUNO, generan alrededor de mil millones de eventos de calibración simulados a partir de cinco fuentes radiactivas colocadas en el centro del detector, cada evento resumido por un solo número: la luz total recogida. Esto sirve como terreno de entrenamiento para redes neuronales que aprenden cuán probable es cualquier señal de luz dada una elección de los tres parámetros.

Dos lentes complementarias de aprendizaje automático

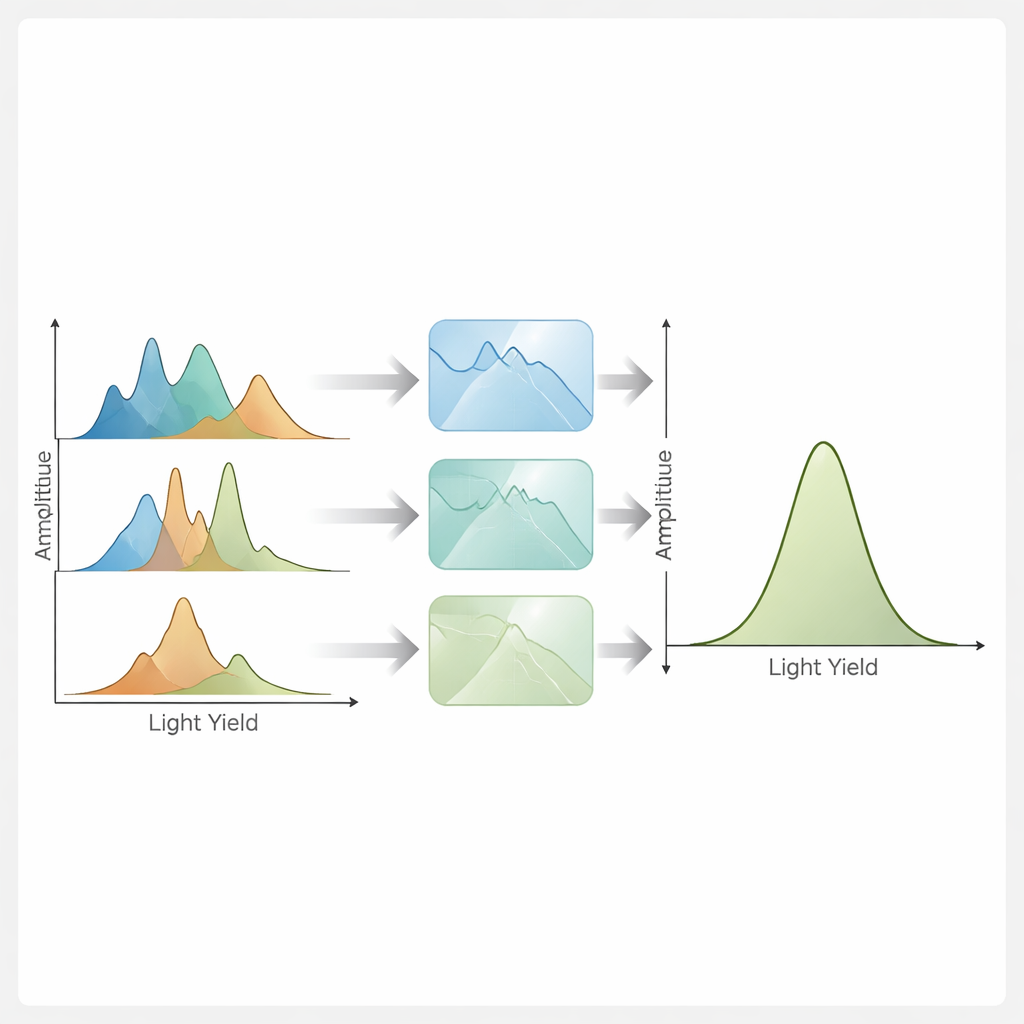

El equipo desarrolla dos “estimadores de verosimilitud” neuronales complementarios que aproximan la probabilidad de observar una señal de luz dada una configuración concreta del detector. El primero, llamado Transformer Encoder Density Estimator, utiliza una arquitectura transformer—la misma familia de modelos detrás de muchas herramientas de lenguaje—para predecir directamente un histograma finamente segmentado del espectro de luz para cada combinación de parámetros y fuente. Esto soporta de forma natural los análisis estadísticos tradicionales por contenedores. El segundo, llamado Normalizing Flows Density Estimator, emplea una cadena de transformaciones invertibles para mapear los espectros complicados y con múltiples picos en una distribución simple en forma de campana. Debido a que estas transformaciones están controladas matemáticamente, el método puede evaluar la probabilidad exacta de cada evento no agrupado, permitiendo análisis que usan toda la información de los datos.

Verificar precisión, exactitud y robustez

Para demostrar que estas herramientas neuronales son fiables, los autores las someten a pruebas rigurosas. Primero comprueban si los modelos pueden reproducir los espectros simulados a lo largo de miles de combinaciones de los tres parámetros, usando varias distancias estadísticas que comparan distribuciones predichas y “verdaderas”. Ambos métodos siguen picos agudos y características espectrales sutiles extremadamente bien, con discrepancias del orden de unas pocas partes por mil. A continuación, incorporan las verosimilitudes aprendidas en motores estadísticos establecidos—muestreo anidado bayesiano, Monte Carlo por cadenas de Markov y minimización clásica—para recuperar los parámetros originales de la simulación a partir de conjuntos de datos ficticios. En un amplio rango de valores de parámetros y estadísticas de eventos, los parámetros recuperados no presentan sesgo y sus incertidumbres declaradas coinciden con la dispersión real de los resultados. Las incertidumbres disminuyen con más datos exactamente como se espera por la estadística de conteo básica, y los métodos capturan fielmente las fuertes correlaciones entre los parámetros.

De meses de cálculo a segundos

Un resultado llamativo es la aceleración computacional. Ejecutar simulaciones completas del detector con suficientes eventos para caracterizar cada punto del espacio de parámetros puede llevar muchas horas por configuración en un procesador convencional. Sin embargo, una vez entrenado, el modelo transformer puede generar un espectro predicho en unos pocos milisegundos, y el modelo de flujos normalizantes puede evaluar probabilidades para decenas de miles de eventos en mucho menos de una décima de segundo. Esto hace realista explorar grandes espacios de parámetros y cuantificar incertidumbres sistemáticas que de otro modo serían prohibitivamente costosas, abriendo la puerta a calibraciones de detectores más detalladas y fiables.

Qué implica esto para futuros experimentos de neutrinos

Para no especialistas, el mensaje central es que este trabajo convierte simulaciones de detectores complicadas y lentas en sustitutos rápidos y precisos sin sacrificar el significado físico. Los tres parámetros afinados siguen correspondiendo directamente a propiedades reales del detector y de su líquido, por lo que los resultados continúan siendo interpretables por los físicos. El estudio demuestra que ambos enfoques neuronales pueden determinar estos parámetros con sesgos extremadamente pequeños y errores limitados principalmente por la cantidad de datos disponible. A medida que experimentos próximos como JUNO, DUNE e Hyper-Kamiokande avancen hacia precisiones subporcentuales en mediciones de neutrinos, métodos como estos serán esenciales para asegurar que lo que inferimos sobre el universo no esté limitado por cuánto entendemos nuestros detectores.

Cita: Gavrikov, A., Serafini, A., Dolzhikov, D. et al. Simulation-based inference for precision neutrino physics through neural Monte Carlo tuning. Commun Phys 9, 63 (2026). https://doi.org/10.1038/s42005-026-02499-6

Palabras clave: detectores de neutrinos, aprendizaje automático, ajuste Monte Carlo, flujos normalizantes, inferencia basada en simulación