Clear Sky Science · es

Adaptación visual guiada por la anatomía para la comprensión multimodal del cáncer de mama

Cribado más inteligente para un cáncer frecuente

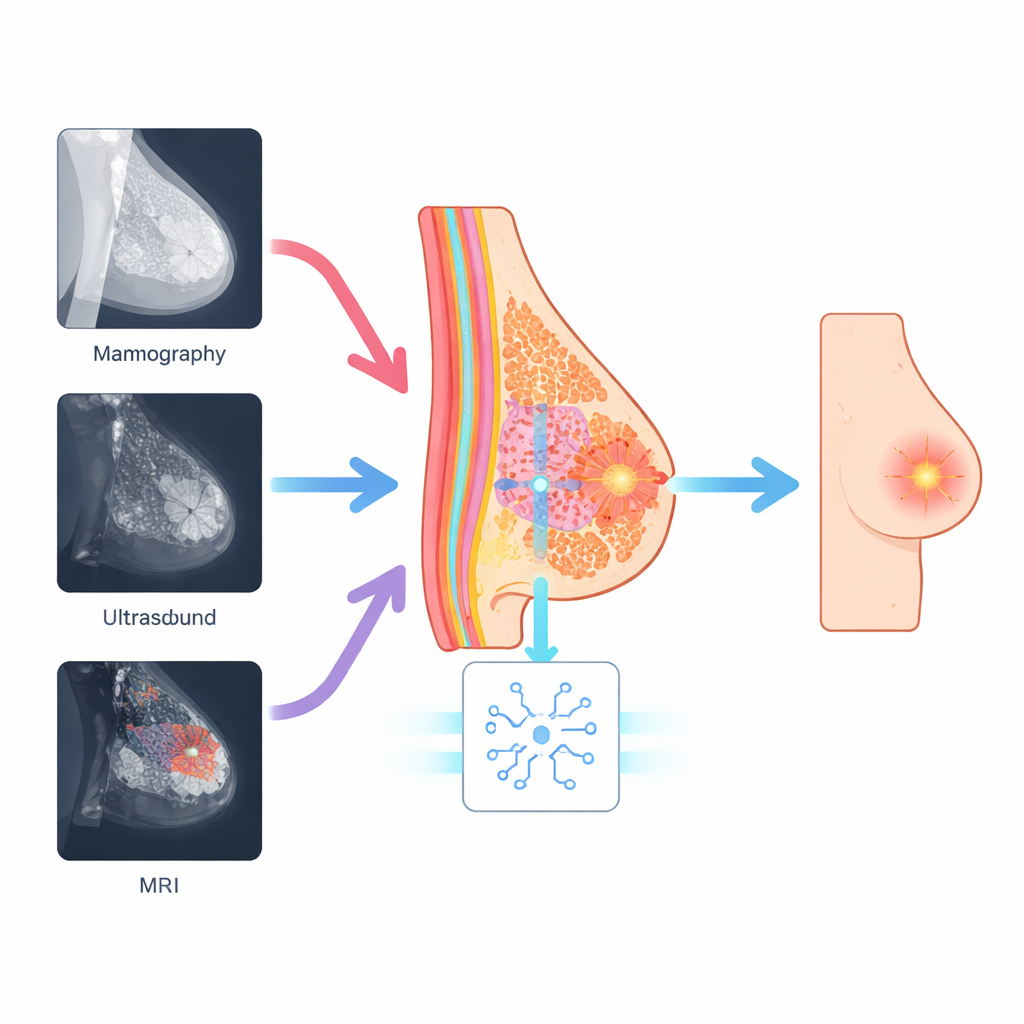

El cáncer de mama es una de las principales causas de muerte por cáncer en mujeres, y los médicos confían cada vez más en programas informáticos para ayudar a interpretar imágenes médicas complejas. Pero las mamografías, las ecografías y las resonancias magnéticas muestran la mama de formas muy distintas, lo que dificulta que los sistemas de inteligencia artificial actuales sean fiables entre máquinas y hospitales. Este estudio presenta un nuevo enfoque de IA que "piensa" en la anatomía subyacente de la mama en lugar de fijarse solo en los patrones de luminosidad de cada imagen, lo que conduce a una detección de áreas sospechosas más precisa y más consistente.

Por qué distintos escáneres confunden a los ordenadores

La mamografía, la ecografía y la RM utilizan físicas diferentes para observar el interior de la mama. Un cáncer que aparece como un punto brillante en una ecografía puede mostrarse como una sombra sutil en una mamografía o como una mancha luminosa en una RM. Muchos sistemas de IA modernos, incluidos potentes transformadores de visión y modelos visión‑lenguaje, aprenden principalmente a partir del aspecto general de la imagen. A menudo pasan por alto detalles pequeños pero importantes, como microcalcificaciones o bordes irregulares, y su rendimiento puede caer drásticamente al trasladarlos de un tipo de equipo u hospital a otro. Esta brecha entre las condiciones de entrenamiento y las clínicas reales ha limitado la confianza que los médicos depositan en estas herramientas.

Usar la propia mama como guía

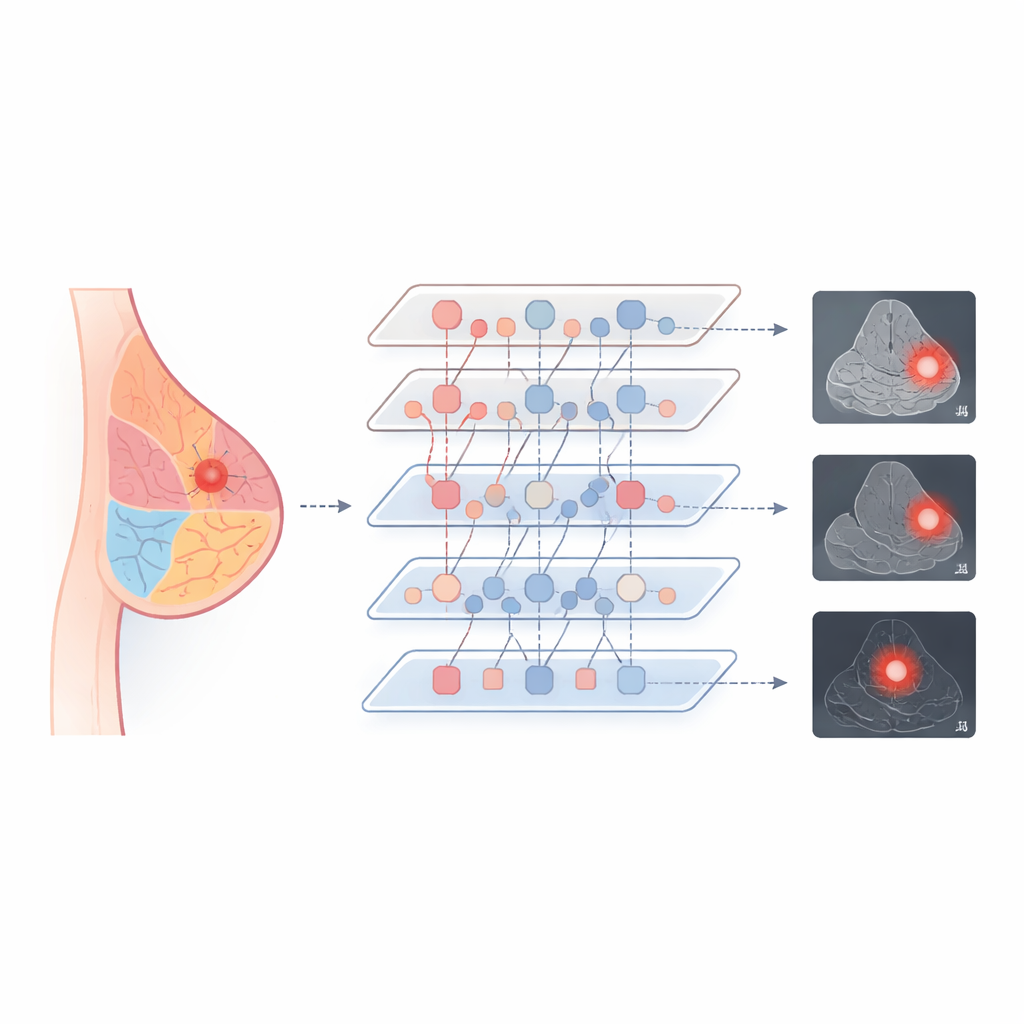

Los investigadores sostienen que, aunque las imágenes se vean diferentes, la biología real de la mama no cambia entre exploraciones. Toda imagen contiene tejido glandular, grasa y estructuras ductales dispuestas en un patrón reconocible. Su método, llamado Adaptación Visual Guiada por la Anatomía (A‑VPT), integra este mapa básico de la mama directamente en el modelo de IA. En lugar de ajustar millones de pesos internos, el sistema añade un pequeño conjunto de señales adicionales de "prompt" que le indican a la red qué regiones tisulares está observando. Estos prompts se generan a partir de mapas anatómicos toscos o señales tisulares aprendidas y se inyectan capa por capa en un transformador preentrenado y congelado. En la práctica, el modelo recibe un recordatorio continuo de dónde están los conductos, las glándulas y la grasa, de modo que puede evaluar las zonas sospechosas en el contexto adecuado.

Enseñar a un sistema a hablar muchos "idiomas" de imagen

Para que el modelo funcione entre tipos de imagen, el equipo diseñó un esquema de entrenamiento que obliga a la IA a tratar tejidos similares de la misma manera, independientemente de cómo se escaneen. Alinean las huellas internas de las regiones grasas, glandulares y ductales obtenidas de mamografía, ecografía y RM, empujándolas hacia un espacio compartido. Cuando hay informes de texto disponibles, el sistema también vincula estos patrones tisulares a frases descriptivas cortas, atando características visuales al lenguaje médico. Durante el procesamiento, módulos de interacción especializados permiten que los prompts anatómicos y las características de la imagen intercambien información en ambas direcciones, con un paso de compuerta que controla la influencia de la anatomía en cada capa. Esta combinación ayuda al modelo a centrarse en las estructuras correctas manteniéndose estable y eficiente.

Mejor precisión con un toque más ligero

Los autores evaluaron A‑VPT en tres colecciones bien conocidas de imágenes mamarias que cubren las tres modalidades. En comparación con redes profundas tradicionales y varias maneras populares de reajustar modelos grandes, su método alcanzó las puntuaciones más altas tanto para clasificar lesiones como benignas o malignas como para delimitar sus contornos. Se comportó especialmente bien cuando se le pidió usar conocimiento de un tipo de exploración para interpretar otro —por ejemplo, entrenar con mamografías y luego evaluar con ecografías— donde los métodos anteriores suelen fallar. De forma llamativa, A‑VPT obtuvo estos resultados actualizando menos del 2% de los parámetros del modelo, lo que reduce las necesidades computacionales y facilita su despliegue en hospitales reales. Las visualizaciones de dónde "miró" el modelo mostraron que se concentró en regiones glandulares y peritumorales realistas, lo que sugiere que sus decisiones coinciden con el razonamiento de los radiólogos.

Qué significa esto para pacientes y clínicas

En términos sencillos, este trabajo muestra que enseñar anatomía básica a los sistemas de IA puede hacerlos más inteligentes y más comprensibles. Al anclar su razonamiento en la estructura real de la mama, A‑VPT es mejor detectando y delineando tumores entre diferentes métodos de imagen, con menos ajustes y un comportamiento más transparente. Si se valida con más estudios, esta estrategia podría apoyar un cribado y un diagnóstico más consistentes en entornos diversos, desde grandes centros médicos hasta clínicas más pequeñas, y podría extenderse a otros órganos como el pulmón o el hígado. En última instancia, la IA consciente de la anatomía podría convertirse en un socio clave para una detección del cáncer más temprana y fiable.

Cita: Zhao, S., Meng, Q., He, Y. et al. Anatomy-guided visual prompt tuning for cross-modal breast cancer understanding. npj Digit. Med. 9, 240 (2026). https://doi.org/10.1038/s41746-026-02417-8

Palabras clave: imágenes del cáncer de mama, IA médica, transformadores de visión, aprendizaje multimodal, indicadores guiados por la anatomía