Clear Sky Science · es

Rendimiento independiente y colaborativo de grandes modelos de lenguaje y profesionales sanitarios en diagnóstico y triaje

Por qué esto importa para tu próxima visita al médico

Cuando escribes tus síntomas en un chatbot en línea o preguntas a una app de IA qué podría estar mal, estás usando el mismo tipo de tecnología que los médicos están empezando a probar en los hospitales: grandes modelos de lenguaje, o LLM. Este estudio plantea una pregunta simple pero vital: ¿qué tan bien diagnostican estas herramientas realmente las enfermedades y deciden cuán urgente es un caso, en comparación con profesionales sanitarios reales, y qué ocurre cuando ambos trabajan juntos?

Cómo los investigadores abordaron la cuestión a gran escala

Los autores no probaron un único chatbot en una sola clínica. En su lugar, combinaron evidencia de 50 estudios independientes realizados en todo el mundo entre 2020 y 2025. Estos estudios abarcaron muchas especialidades, desde enfermedades oculares y exploraciones cerebrales hasta atención de urgencias. En cada uno, a los médicos y a uno o varios LLM se les ofrecieron las mismas descripciones de casos de pacientes reales o diseñados cuidadosamente. Los LLM tenían que sugerir diagnósticos posibles o decidir cuán rápido necesitaba atención un paciente, mientras que los médicos hicieron lo mismo. En algunos estudios, a los médicos también se les mostraron las sugerencias de la IA para ver si esto les ayudaba a mejorar su desempeño.

¿Qué tan buenos son los sistemas de IA por sí solos?

En todos los estudios, las herramientas de IA a menudo podían incluir el diagnóstico correcto en algún lugar de su lista, pero todavía solían quedar por detrás de los médicos cuando se les obligaba a elegir solo una respuesta. Cuando solo se contó la primera opción, los LLM fueron aproximadamente un 11 % menos precisos que los profesionales sanitarios, en promedio. A medida que se permitía una lista más larga de candidaturas, esa brecha se redujo y eventualmente desapareció: cuando se permitieron hasta diez diagnósticos posibles, los sistemas de IA eran al menos tan probables como los médicos de incluir el correcto. En decisiones de triaje—valorar la urgencia de un caso y el nivel de atención necesario—la IA y los humanos rindieron de forma similar en conjunto. Sin embargo, los resultados variaron ampliamente según el modelo y el diseño de la prueba, lo que sugiere que algunas herramientas son mucho más fiables que otras.

¿Qué pasa cuando los médicos usan la IA como compañera?

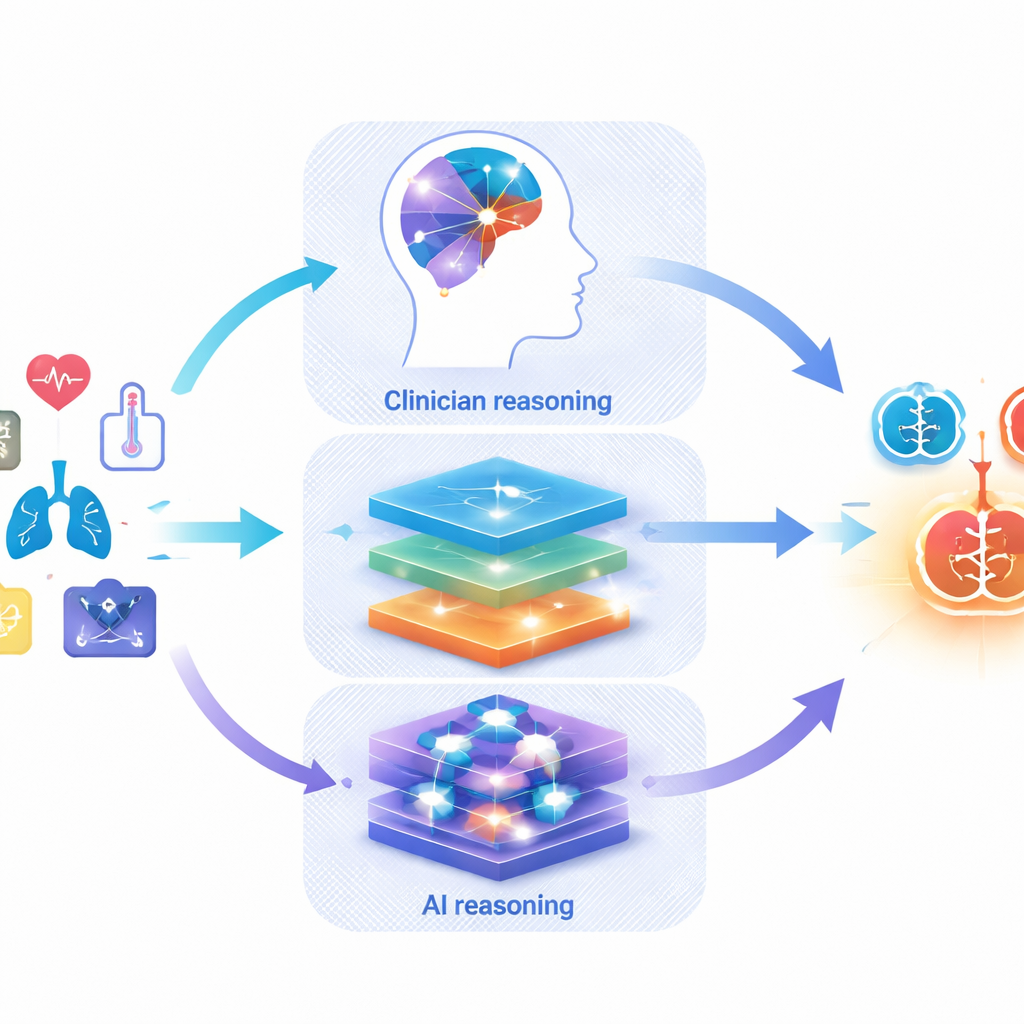

Nueve estudios analizaron directamente la colaboración: los médicos trabajaron primero solos y luego repitieron la tarea con ayuda de un LLM. Aquí la noticia fue alentadora. Cuando contaban con apoyo de la IA, los médicos fueron más precisos en general, especialmente cuando se les permitía ofrecer varios diagnósticos posibles. Por ejemplo, con ayuda de un LLM, su precisión para listas cortas de candidatos mejoró en torno al 10–40 %, según cuántas opciones se consideraran. Esto sugiere que la IA es especialmente útil como socio para generar ideas, ampliando el conjunto de posibilidades y empujando a los clínicos a considerar condiciones menos obvias, mientras que el experto humano sigue tomando la decisión final.

Por qué los resultados de hoy pueden parecer mejores que la práctica real

Aunque las cifras suenan prometedoras, los autores advierten que la mayoría de los estudios existentes están lejos de ser perfectos. Muchos se basaron en resúmenes de casos pulcros al estilo de los libros de texto o en casos raros elegidos con fines docentes, no en las historias incompletas y desordenadas que presentan los pacientes en las consultas reales. Solo unos pocos utilizaron pacientes en tiempo real. A menudo faltaban detalles sobre cómo se seleccionaron los casos, cómo se configuraron las herramientas de IA y cómo se evaluaron las respuestas. La información visual, como exploraciones o fotos de la piel, se usó con menos frecuencia, y cuando se probaron solo imágenes, los clínicos experimentados claramente superaron a la IA. Los investigadores también señalan que los clínicos junior y los expertos pueden responder de forma distinta al asesoramiento de la IA, y que cuestiones como la privacidad de los datos, sesgos ocultos y la confianza excesiva en las sugerencias de la máquina siguen sin probarse en la práctica cotidiana.

Qué significa esto para los pacientes y el futuro de la atención

En conjunto, el estudio sugiere que los chatbots y los LLM actuales no están listos para reemplazar a tu médico, pero podrían convertirse pronto en asistentes valiosos. Usados con prudencia, pueden ayudar a generar listas más amplias de diagnósticos posibles y respaldar decisiones más precisas, especialmente cuando los médicos mantienen el control y tratan la IA como una segunda opinión en lugar de un veredicto final. Antes de que estas herramientas se integren en la atención rutinaria, sin embargo, los autores sostienen que necesitamos ensayos mejor diseñados en entornos reales, estándares de reporte más claros y salvaguardas sólidas en torno a la seguridad, la equidad y la privacidad. Para los pacientes, esto significa que la IA podría eventualmente ayudar a tu equipo de atención a pensar con más amplitud y actuar más rápido, pero cualquier sistema de confianza debe probarse con el mismo rigor que un nuevo fármaco o dispositivo médico.

Cita: Chen, M., Wu, Y., Ma, J. et al. Independent and collaborative performance of large language models and healthcare professionals in diagnosis and triage. npj Digit. Med. 9, 222 (2026). https://doi.org/10.1038/s41746-026-02409-8

Palabras clave: diagnóstico médico IA, triaje clínico, grandes modelos de lenguaje, colaboración médico IA, seguridad en salud digital