Clear Sky Science · es

Modelo fundamental de vídeo de gran escala auto-supervisado para cirugía inteligente

Ayuda más inteligente en el quirófano

Los cirujanos modernos dependen cada vez más de cámaras y ordenadores para guiar su trabajo, pero la inteligencia artificial actual todavía tiene dificultades para entender por completo lo que ocurre durante una operación. Este artículo presenta una nueva forma de entrenar IA con miles de vídeos quirúrgicos para que pueda seguir mejor los pasos de un procedimiento, reconocer instrumentos y tejidos, y evaluar cómo progresa la operación en términos de seguridad y habilidad. A largo plazo, este tipo de tecnología podría apoyar a los cirujanos en tiempo real, mejorar la formación y ayudar a que la cirugía sea más segura para los pacientes.

Por qué es difícil enseñar a las máquinas sobre cirugía

Enseñar a los ordenadores a entender la cirugía no es tan simple como darles unas pocas imágenes etiquetadas. Cada procedimiento implica cámaras en movimiento, cambios de punto de vista, humo, sangre y manos y herramientas que se tapan constantemente entre sí. Además, existen miles de tipos distintos de operaciones, muchas de ellas raras. Etiquetar cuidadosamente los vídeos fotograma a fotograma requiere tiempo de expertos, un recurso escaso, y pronto resulta demasiado caro. Los sistemas anteriores intentaron aliviar esta carga con trucos que aprenden de imágenes no etiquetadas, pero se centraban sobre todo en fotogramas estáticos y solo más tarde intentaron añadir una noción del tiempo. Como resultado, a menudo perdían la historia en desarrollo de una operación: qué ocurrió antes, qué está sucediendo ahora y qué es probable que ocurra a continuación.

Aprender directamente de películas quirúrgicas

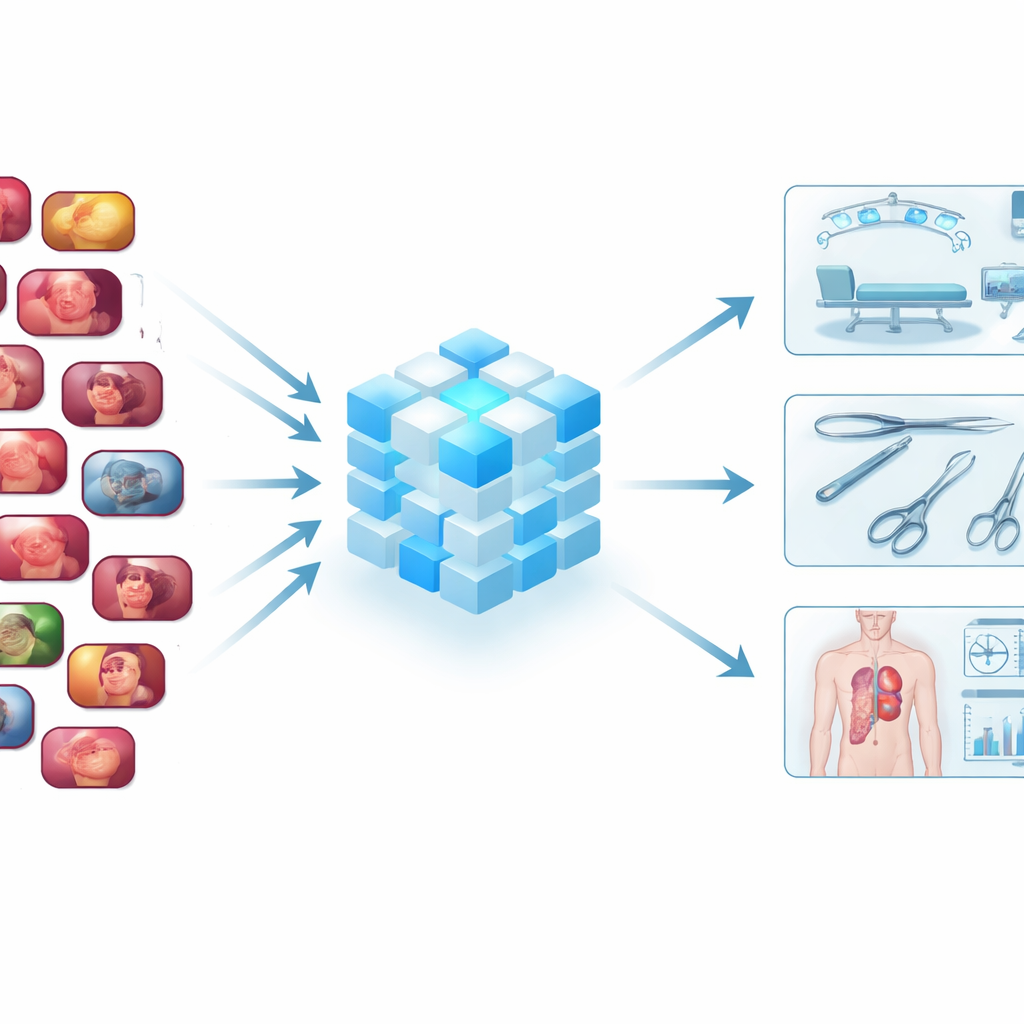

Los autores sostienen que una IA destinada a asistir en cirugía debe entrenarse con vídeos en lugar de con imágenes aisladas. Para ello reunieron una de las colecciones más grandes de vídeos endoscópicos hasta la fecha: 3.650 grabaciones con 3,55 millones de fotogramas, extraídas de conjuntos de datos de investigación públicos y de un amplio muestreo de material quirúrgico en línea. Estos vídeos abarcan más de 20 tipos de procedimientos y más de 10 regiones anatómicas, desde colecistectomías hasta cirugía hepática y operaciones ginecológicas. Esta diversidad permite que la IA vea muchas formas en que un procedimiento puede lucir en la vida real, incluidos distintos hospitales, instrumentos y estilos de cámara.

Un nuevo plan de aprendizaje centrado en el vídeo

Partiendo de este tesoro de datos, el equipo diseñó SurgVISTA, un «modelo fundamental» afinado específicamente para vídeos quirúrgicos. En lugar de intentar etiquetar cada fotograma, SurgVISTA aprende rellenando lo que falta. Durante el entrenamiento, se ocultan partes de cada clip de vídeo y el modelo debe reconstruir las regiones ausentes. Esto le obliga a prestar atención a cómo cambian los tejidos, los instrumentos y los movimientos a lo largo del tiempo. Al mismo tiempo, una segunda rama del sistema se entrena para igualar las señales visuales detalladas captadas por un modelo experto basado en imágenes que ya sabe mucho sobre escenas quirúrgicas. Esta combinación ayuda a SurgVISTA a captar tanto los detalles finos dentro de cada fotograma como el flujo más amplio de toda la operación, todo dentro de una única red unificada.

Poniendo el modelo a prueba

Para comprobar si este enfoque realmente rinde, los autores evaluaron SurgVISTA en 13 conjuntos de datos diferentes que implican seis tipos de cirugía y cuatro tareas prácticas. Estas tareas incluían reconocer en qué fase de la operación se encuentra, identificar acciones quirúrgicas específicas, capturar la relación tríadica entre instrumento, acción y tejido objetivo, y juzgar qué tan seguras han sido las etapas clave. En todos los casos, SurgVISTA superó a los modelos líderes entrenados con vídeos cotidianos, así como a los mejores sistemas centrados en cirugía existentes que se basaban principalmente en imágenes estáticas. Rindió con fuerza incluso en procedimientos que no había visto durante el entrenamiento, lo que demuestra que los patrones que aprendió no estaban ligados a un único órgano, conjunto de instrumentos o hospital.

Por qué importan más y mejores datos de vídeo

El estudio también investigó cómo cambiaba el rendimiento a medida que se añadían más datos de entrenamiento. A medida que los autores ampliaron gradualmente el tamaño y la variedad de la colección de vídeos, los resultados de SurgVISTA mejoraron casi en todas partes, incluso en procedimientos que no aparecían en el conjunto de entrenamiento. Curiosamente, el modelo se benefició no solo de más ejemplos del mismo procedimiento, sino también de distintos tipos de operaciones: la exposición a variadas «historias» quirúrgicas le ayudó a detectar patrones visuales y de movimiento generales que se transfieren entre especialidades. Experimentos adicionales mostraron que la orientación extra procedente del modelo experto basado en imágenes agudizó aún más la capacidad del modelo para preservar detalles anatómicos finos, lo cual es crucial para distinguir, por ejemplo, una estructura vital del tejido circundante.

Qué implica esto para la cirugía futura

En términos sencillos, este trabajo muestra que una IA entrenada con grandes cantidades de vídeo quirúrgico real, teniendo en cuenta el espacio y el tiempo, puede construir una comprensión mucho más profunda de lo que ocurre en el quirófano. SurgVISTA aún no es una herramienta que tome decisiones por sí sola, pero proporciona una columna vertebral potente en la que otras aplicaciones pueden apoyarse, ya sea para rastrear el progreso quirúrgico, señalar momentos de riesgo, apoyar la formación o comparar técnicas entre hospitales. Los autores señalan que aún se necesitan datos más amplios y pruebas clínicas, pero sus resultados sugieren que los modelos fundamentales basados en vídeo podrían convertirse en un ingrediente clave en futuros sistemas quirúrgicos inteligentes orientados a hacer los procedimientos más seguros, más consistentes y mejor adaptados a cada paciente.

Cita: Yang, S., Zhou, F., Mayer, L. et al. Large-scale self-supervised video foundation model for intelligent surgery. npj Digit. Med. 9, 220 (2026). https://doi.org/10.1038/s41746-026-02403-0

Palabras clave: IA en vídeo quirúrgico, aprendizaje auto-supervisado, flujo operativo, cirugía asistida por ordenador, modelado espacio-temporal