Clear Sky Science · es

Colaboración humano–modelo de lenguaje grande en medicina clínica: una revisión sistemática y metaanálisis

Por qué importa para la atención sanitaria cotidiana

Los médicos recurren cada vez más a chatbots de IA potentes, conocidos como modelos de lenguaje grande, para ayudar a analizar casos complejos, redactar notas e interpretar pruebas médicas. Este estudio plantea una pregunta sencilla pero crucial: cuando los médicos se asocian con estas herramientas, ¿realmente se benefician los pacientes? Al reunir los resultados de los mejores ensayos disponibles, los autores muestran que la respuesta es más matizada que el bombo mediático: a veces la colaboración ayuda, a veces apenas hace diferencia y en pocas situaciones incluso puede entorpecer.

Qué examinaron los investigadores

El equipo realizó una búsqueda sistemática en las principales bases de datos médicas de estudios en los que los clínicos trabajaron con o sin la ayuda de un sistema de IA basado en modelos de lenguaje grande como GPT‑4. Para ser incluido, un estudio tenía que enfrentar directamente un flujo de trabajo “médico más IA” contra la atención habitual de médicos solos y, en ocasiones, contra la IA actuando por sí sola. Las tareas clínicas abarcaron una variedad de problemas reales: determinar qué podría estar ocurriendo en un paciente críticamente enfermo, interpretar escáneres cerebrales, redactar y leer notas de consulta y decidir cómo manejar dolor torácico y otras quejas comunes. En total, 10 ensayos revisados por pares formaron el núcleo del análisis, con algunos preprints adicionales usados solo para comprobar la solidez de las conclusiones.

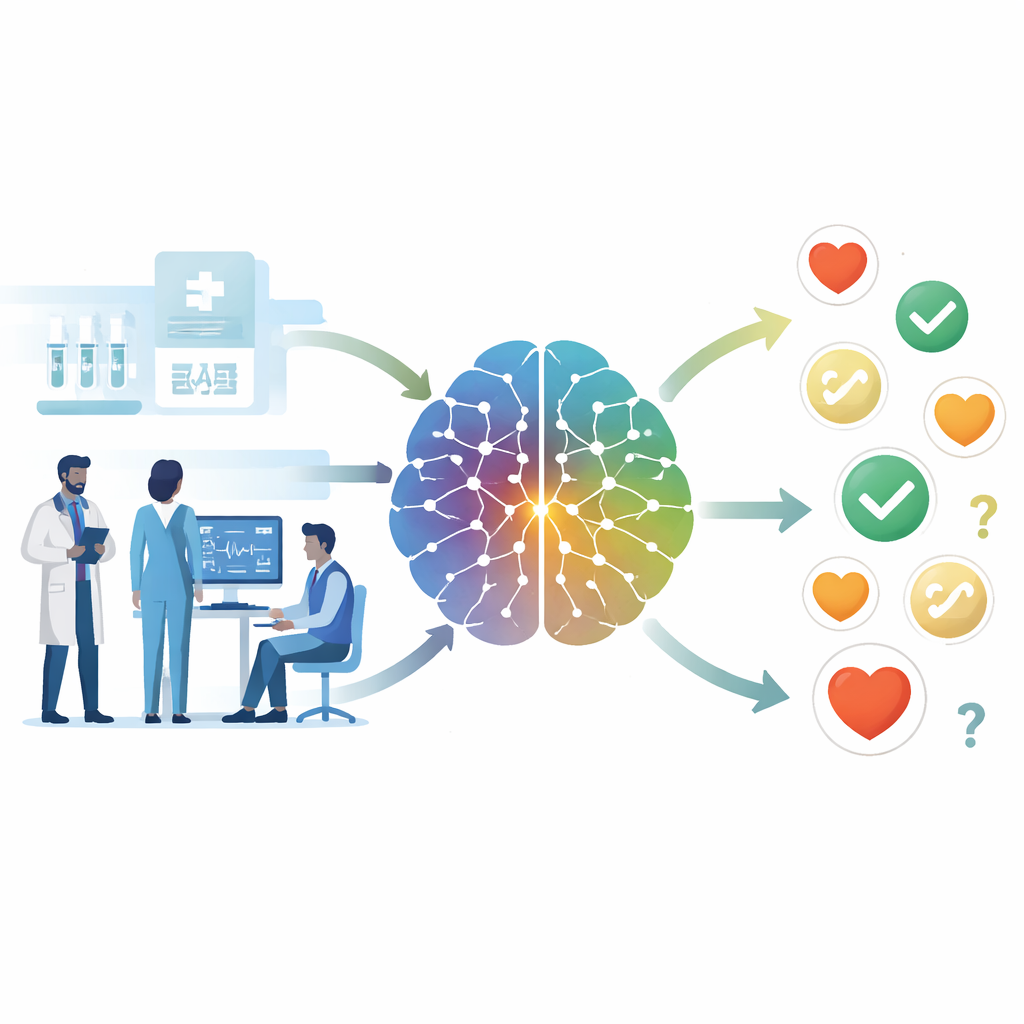

Cómo se desempeñaron los equipos médico–IA

En estos estudios, emparejar a los médicos con la IA mostró mejoras pequeñas pero visibles en algunas medidas de calidad diagnóstica y de manejo. En dos ensayos aleatorizados que usaron sistemas de puntuación detallados para las decisiones de caso, los equipos médico–IA obtuvieron alrededor de cinco puntos porcentuales más que los médicos solos. En términos sencillos, si los médicos trabajando por su cuenta tomaran unas 100 decisiones clave, añadir la IA podría evitar aproximadamente cinco de esas decisiones erróneas. Sin embargo, los autores subrayan que los datos subyacentes son escasos: solo un par de ensayos contribuyeron a estas estimaciones, y el rango de resultados plausibles en el mundo real es lo bastante amplio como para incluir ausencia de beneficio —o incluso daño— en otros contextos.

Velocidad, documentación y errores ocultos

Muchos esperan que la IA libere tiempo a los médicos. Aquí, la evidencia fue poco convincente. Al combinar tres ensayos que midieron la duración de las tareas, los investigadores no encontraron ahorros de tiempo globales significativos. En algunos ejercicios simulados los médicos fueron algo más rápidos con la IA; en un estudio en una clínica real, el efecto neto sobre la duración de la visita fue casi nulo, aunque algunos subgrupos experimentaron ganancias modestas. La documentación contó una historia igualmente «mixta». La asistencia de la IA a menudo hizo que las notas se vieran más claras y estructuradas, y ayudó a los no especialistas a comprender mejor informes técnicos de oftalmología. Aun así, cuando los investigadores comprobaron los hechos, encontraron que aproximadamente una de cada tres notas apoyadas por IA aún contenía errores. Esta división —registros de mejor apariencia que pueden seguir siendo incorrectos— plantea preocupaciones de seguridad evidentes.

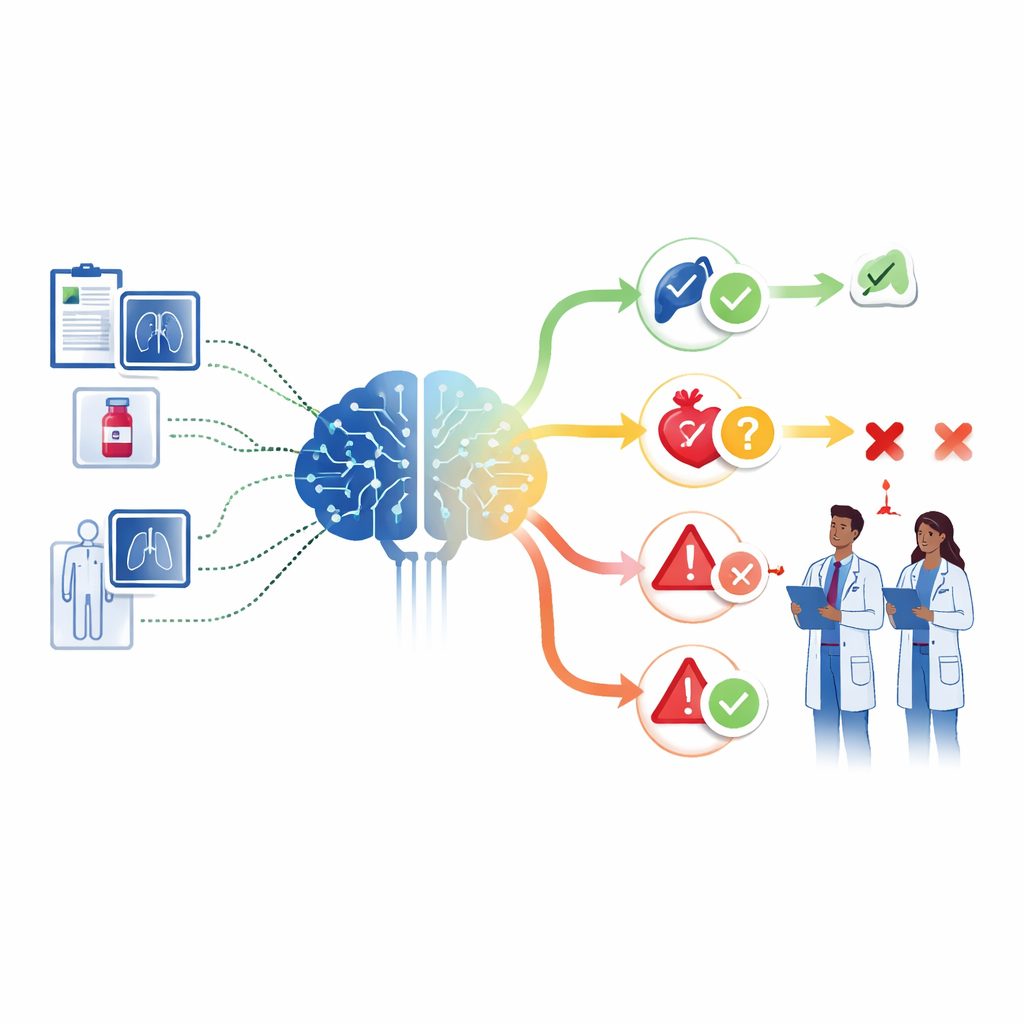

Cuando la colaboración no supera a la máquina

Un hallazgo llamativo provino de ensayos que también probaron la IA por sí sola. En un estudio con pacientes críticamente enfermos, la IA sola rindió aproximadamente igual que el equipo médico–IA y mejor que muchos médicos trabajando solos. En otro, los informes de pruebas generados por la IA fueron claramente peores que los producidos por expertos humanos, ya fuera que la IA se usara como asistente o no. En conjunto, estos resultados exponen lo que los autores denominan una «paradoja de la colaboración»: insertar simplemente a un humano en el bucle no garantiza una mejora sobre una IA potente y, en algunas situaciones, la asociación puede diluir las fortalezas de ambos. Factores como cómo se presenta el consejo, cuánto confían o desconfían los médicos en él y cómo se integra la herramienta en el flujo de trabajo diario influyen en si la colaboración ayuda o perjudica.

Qué significa esto para el futuro de los equipos médico–IA

En conjunto, la revisión dibuja un panorama de promesa cauta más que de una revolución ya conseguida. Los equipos médico–IA pueden mejorar modestamente ciertos puntajes de decisión y hacer que la redacción médica sea más fácil de leer, pero no ahorran tiempo de forma fiable y siguen generando un número preocupante de errores factuales. Los autores sostienen que los sistemas de salud deberían desplegar estas herramientas de forma gradual, con salvaguardas sólidas que se centren en detectar errores en lugar de solo aumentar la eficiencia. También piden ensayos clínicos más amplios en el mundo real que prueben la asistencia de IA en hospitales y clínicas concurridos, no solo en simulaciones controladas de casos. Hasta que llegue esa evidencia, la vía más segura es tratar a los modelos de lenguaje grande como asistentes potentes pero falibles —y diseñar flujos de trabajo donde los clínicos actúen como revisores críticos y guardianes, no como aceptadores pasivos, del consejo de la IA.

Cita: Wang, G., Zhang, K., Jiang, J. et al. Human–large language model collaboration in clinical medicine: a systematic review and meta-analysis. npj Digit. Med. 9, 195 (2026). https://doi.org/10.1038/s41746-026-02382-2

Palabras clave: colaboración humano–IA, soporte a la decisión clínica, modelos de lenguaje grande, precisión diagnóstica, documentación médica