Clear Sky Science · es

DARE-FUSE: aprendizaje guiado por evidencia alineada al dominio para la segmentación y clasificación conjunta de tumores cerebrales en MRI

Por qué importan exploraciones cerebrales más inteligentes

Los tumores cerebrales están entre los diagnósticos más temidos en medicina, y la imagen por resonancia magnética (MRI) es la herramienta principal que usan los médicos para ver dónde empieza y termina un tumor. Sin embargo, incluso los radiólogos expertos pueden tener dificultades para delinear con precisión un tumor y juzgar cómo cambia con el tiempo, especialmente cuando sus bordes se difuminan con el tejido cerebral edematoso. Este artículo presenta DARE-FUSE, un nuevo sistema de inteligencia artificial diseñado para leer exploraciones cerebrales por MRI con mayor fiabilidad, trazando límites tumorales más nítidos y ofreciendo explicaciones más claras de sus decisiones para apoyar a cirujanos, oncólogos y pacientes.

Bordes difusos y clínicas sobrecargadas

En los hospitales reales, las exploraciones cerebrales por MRI son desordenadas. Los tumores a menudo se mezclan con la hinchazón circundante, los implantes metálicos pueden distorsionar la imagen y distintos centros usan ajustes de adquisición ligeramente diferentes. Los radiólogos deben desplazarse manualmente por cientos de imágenes, marcar el tumor corte a corte y luego decidir cómo se comporta. Ese trabajo consume tiempo, resulta fatigoso y está sujeto a desacuerdo entre expertos. Las herramientas de IA existentes pueden ayudar a delinear tumores o a etiquetar escaneos como “con tumor” o “sin tumor”, pero la mayoría de los sistemas manejan estas tareas por separado y muchos fallan cuando las imágenes provienen de nuevos centros o contienen crecimiento marginal sutil e irregular.

Un asistente de IA unificado para mapas tumorales y etiquetas

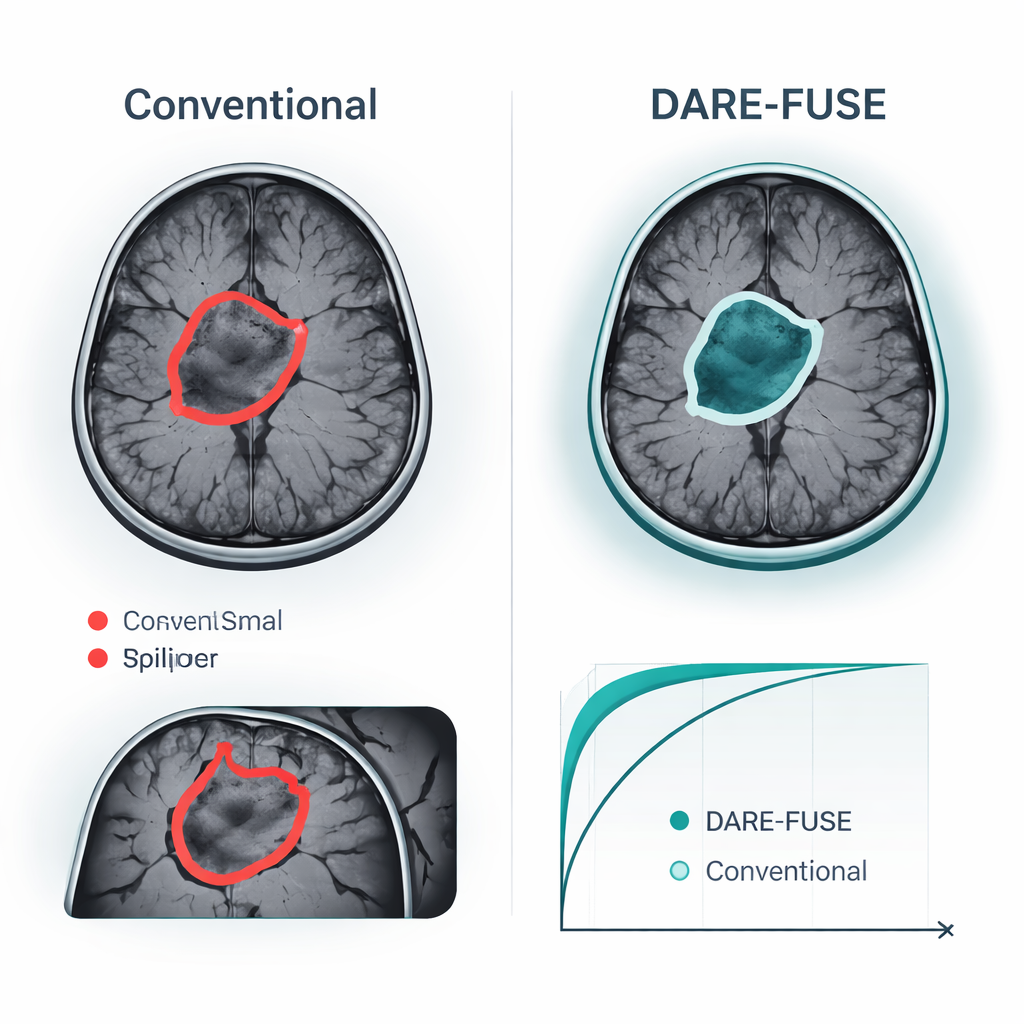

DARE-FUSE aborda varios de estos obstáculos a la vez. Está construido como una única canalización que tanto traza el tumor en cada corte de la MRI (segmentación) como clasifica imágenes completas en grupos diagnósticos (clasificación). En su núcleo hay dos “vistas” que cooperan: una red afinada para formas y contornos detallados y otra orientada a patrones globales que distinguen distintos tipos tumorales. Un módulo especial de alineación mantiene sincronizadas estas vistas entre hospitales y escáneres, de modo que las características aprendidas en un conjunto de datos no empeoren el rendimiento en otro. El sistema también estima su propia incertidumbre, marcando esencialmente las áreas donde tiene menos seguridad sobre el contorno exacto del tumor, lo cual es vital para un uso clínico seguro.

Usando pistas de mapas de calor y reconstrucciones “sin tumor”

En lugar de confiar en una sola señal, DARE-FUSE aprende a partir de varios tipos de evidencia. Una rama produce mapas de calor, que muestran qué partes del cerebro respaldan con más fuerza la decisión de clasificación de la IA. Otra rama utiliza un modelo generativo para imaginar cómo sería la misma exploración si el tumor se hubiera eliminado y luego compara esa versión “sin tumor” con el original. Las diferencias entre ambas resaltan cambios estructurales sutiles y bordes que podrían no activarse con fuerza en un mapa de calor estándar. Un módulo de fusión combina luego estas pistas en un “prior” tumoral continuo: las regiones en las que varias fuentes coinciden se tratan como tumor central, mientras que las zonas con menos certeza se incorporan de forma más cautelosa y se ponderan a la baja cuando la incertidumbre del modelo es alta. Este prior combinado guía el contorno final, ayudando a evitar tanto bolsas tumorales pasadas por alto como islas espurias en tejido sano.

Mejoras demostradas en conjuntos públicos de tumores cerebrales

Los autores probaron DARE-FUSE en seis grandes desafíos multicéntricos de tumores cerebrales (la serie BraTS) y en cuatro colecciones públicas de MRI empleadas para clasificación a nivel de imagen. En todas las ediciones de BraTS, el sistema igualó o superó a los mejores modelos recientes de aprendizaje profundo, logrando una superposición ligeramente mayor entre sus máscaras tumorales predichas y los delineados de expertos, y errores consistentemente menores en la medición de la superficie tumoral. Estas mejoras fueron más notables en casos difíciles: tumores pequeños, bordes de bajo contraste y formas complejas e irregulares. En tareas de clasificación —decidir, por ejemplo, si una exploración muestra un glioma, un meningioma, un tumor hipofisario o ausencia de tumor— DARE-FUSE también superó por poco a potentes transformadores y líneas base de aprendizaje débil en precisión y en una medida estándar de discriminación (AUC). Es importante que, cuando los investigadores redujeron artificialmente el número de anotaciones detalladas, el nuevo sistema degradó su rendimiento con suavidad y mantuvo una ventaja sobre competidores semi-supervisados y con supervisión débil.

Qué podría significar esto para los pacientes

Para pacientes y clínicos, la principal promesa de DARE-FUSE no es un algoritmo llamativo, sino un apoyo de imagen más fiable e interpretable. En la práctica, el sistema podría proponer un contorno tumoral, resaltar regiones donde tiene menos confianza y mostrar mapas de calor que expliquen qué regiones de la imagen sustentan su clasificación. Los médicos podrían aceptar las regiones de baja incertidumbre como un contorno de partida y centrar su atención en las áreas señaladas en lugar de volver a trazar todo desde cero. Mediciones más precisas y consistentes del volumen y la forma del tumor podrían mejorar la planificación del tratamiento, la delimitación en radioterapia y el seguimiento de la respuesta a lo largo del tiempo. Si bien los autores enfatizan que su herramienta es un asistente —no un reemplazo— del juicio experto, sus resultados apuntan hacia sistemas de IA que pueden ver los tumores con más claridad y comunicar su nivel de confianza de maneras que los clínicos puedan aprovechar.

Cita: Liu, Y., Sun, C., Niu, Y. et al. DARE-FUSE: domain aligned evidence guided learning for joint brain tumor MRI segmentation and classification. npj Digit. Med. 9, 178 (2026). https://doi.org/10.1038/s41746-026-02365-3

Palabras clave: resonancia magnética de tumores cerebrales, segmentación de imágenes médicas, aprendizaje profundo en radiología, soporte a la decisión clínica, IA consciente de la incertidumbre