Clear Sky Science · es

Escalar la ciencia regulatoria de dispositivos médicos usando grandes modelos de lenguaje

Por qué esto importa para pacientes y médicos

La medicina moderna se está llenando rápidamente de dispositivos “inteligentes” que utilizan inteligencia artificial para leer exploraciones, registrar signos vitales y ayudar a los médicos en la toma de decisiones. Solo en Estados Unidos, más de mil de estas herramientas ya han sido autorizadas o aprobadas por la Food and Drug Administration (FDA). Cada dispositivo deja un rastro documental de informes complejos y registros de seguridad. Hoy, la mayor parte de esa información sigue siendo procesada a mano, lo que es lento, costoso y pronto queda desactualizado. Este artículo explora si los grandes modelos de lenguaje—el mismo tipo de IA detrás de chatbots avanzados—pueden leer de forma fiable esos documentos a gran escala y convertirlos en datos utilizables para ayudar a reguladores, investigadores y al público a entender cómo están construidos estos dispositivos y cuán seguros son en su funcionamiento.

El problema de demasiados documentos complejos

Cada dispositivo médico con IA viene acompañado de extensos resúmenes de decisión, informes de seguridad y avisos de retirada. Estos documentos son largos, están redactados en jerga densa y con frecuencia incluyen tablas, imágenes y formatos inconsistentes. Investigaciones previas han mostrado que responder a preguntas básicas—como cómo se probó un dispositivo antes de su aprobación o qué falló exactamente cuando funcionó mal—ha requerido equipos de expertos que lean cientos de PDFs línea por línea. Las herramientas de búsqueda simples y el emparejamiento de patrones pueden encontrar detalles obvios como números de identificación, pero tienen dificultades con preguntas más profundas que requieren juicio, por ejemplo si un estudio se realizó en varios hospitales o si un dispositivo contribuyó realmente a la lesión o muerte de un paciente. A medida que ha explotado el número de dispositivos habilitados por IA, este enfoque manual se ha vuelto imposible de seguir.

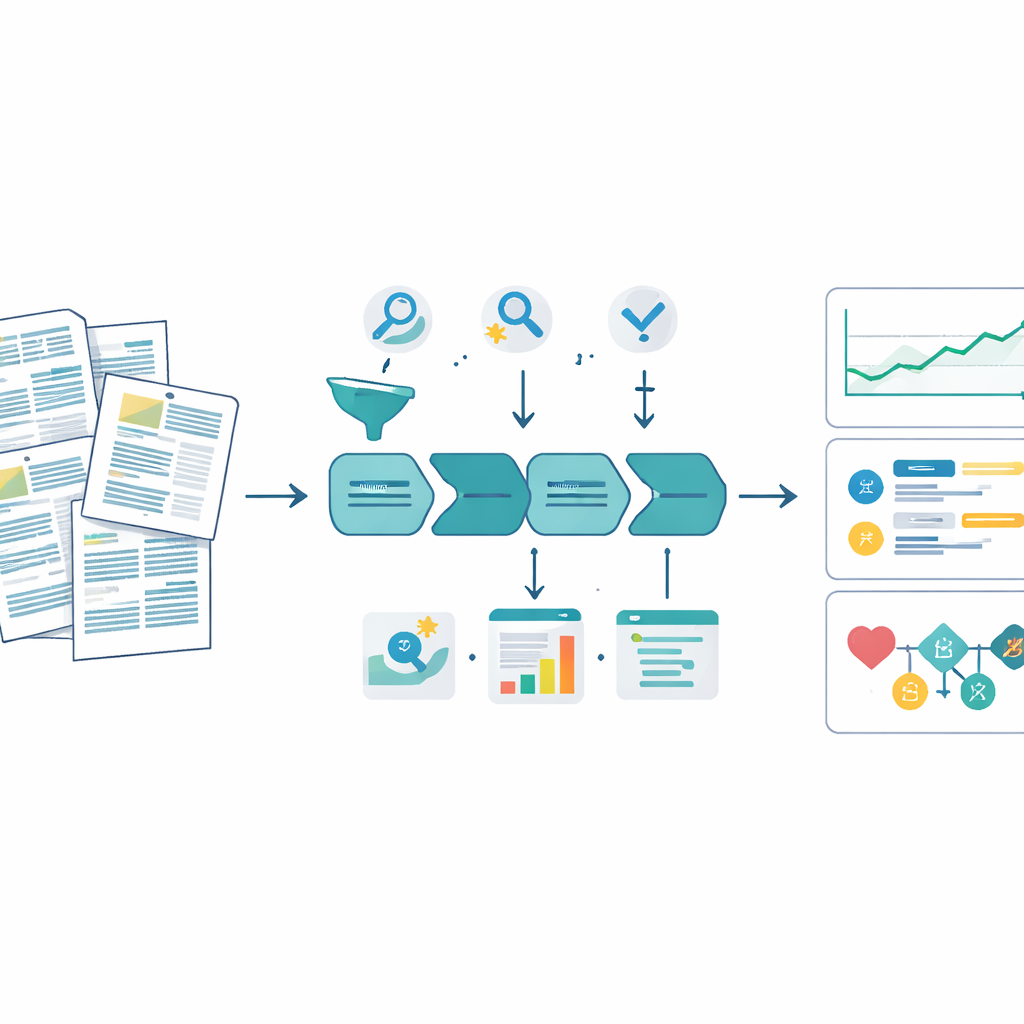

Una canalización de IA que lee como un experto

Los autores desarrollaron una canalización general basada en un modelo de lenguaje de vanguardia para abordar este reto. Primero, recopilaron todos los resúmenes de decisión y los informes de seguridad disponibles públicamente de la FDA para 1.247 dispositivos de IA o aprendizaje automático y 1.852 informes de eventos adversos relacionados hasta mediados de 2025, limpiando los PDFs y usando reconocimiento óptico de caracteres cuando fue necesario. Luego, en lugar de pedir al modelo que respondiera a preguntas amplias de una sola vez, dividieron el trabajo en subtareas más pequeñas y bien definidas. Para cada tipo de documento, el modelo recibió instrucciones detalladas fundamentadas en la guía oficial de la FDA, además de ejemplos de cómo los humanos etiquetarían la información. Se pidió al modelo que razonara paso a paso y que devolviera sus respuestas en un formato estricto y estructurado, convirtiendo texto libre en campos claros como “número de centros del estudio”, “tipo de evento de seguridad” o “clase de cambio en el dispositivo”.

Comprobando la precisión en preguntas regulatorias reales

Para ver si este sistema podía confiarse, el equipo realizó tres estudios de caso en los que investigaciones anteriores ya habían pasado meses revisando manualmente. Primero, revisaron cómo se prueban los dispositivos antes de la aprobación preguntando si los ensayos fueron prospectivos (recogiendo datos hacia adelante) y si involucraron múltiples hospitales. Comparando las salidas del modelo con las etiquetas de los expertos, observaron tasas de concordancia a menudo por encima del 80–90 %, comparables a la concordancia entre anotadores humanos. Segundo, utilizaron el modelo para reetiquetar informes de seguridad que describían fallos, lesiones o muertes, y para clasificar qué había fallado en el dispositivo. Cuando revisores humanos compararon los códigos originales del fabricante con los sugeridos por el modelo—sin saber cuál era cuál—prefirieron las opciones del modelo la gran mayoría de las veces, especialmente en categorías sensibles como muerte frente a mal funcionamiento. Tercero, los investigadores vincularon detalles de los documentos previos a la aprobación con informes de seguridad posteriores para explorar qué decisiones tempranas—como elegir un dispositivo predecesor con retiradas previas o realizar cambios importantes de hardware—se asociaban estadísticamente con mayor riesgo de problemas futuros.

Lo que revelan los hallazgos sobre seguridad y supervisión

Una vez validada, la canalización permitió al equipo escalar estos análisis desde docenas de dispositivos hasta toda la población conocida de herramientas médicas habilitadas por IA. Por ejemplo, encontraron que las evaluaciones clínicas prospectivas se han mantenido relativamente escasas durante tres décadas, rondando aproximadamente uno de cada diez dispositivos, mientras que las menciones de pruebas multisitio han crecido sustancialmente. En los informes de seguridad, el modelo descubrió patrones en los que el tipo de problema descrito en el texto no coincidía con el código enviado a la FDA—por ejemplo, situaciones en las que fallos de hardware se etiquetaron como problemas de calidad de imagen. Al vincular características previas a la aprobación con eventos de seguridad posteriores, los dispositivos cuyos predecesores ya tenían retiradas o historiales de eventos adversos mostraron riesgos mucho mayores de nuevos informes, mientras que los dispositivos respaldados por pruebas clínicas tendieron a presentar menor riesgo. Estos resultados son exploratorios, pero ilustran el tipo de preguntas que ahora pueden formularse de forma rutinaria en lugar de en proyectos puntuales.

Límites, salvaguardas y el camino por delante

Los autores enfatizan que su enfoque no es perfecto y no debe reemplazar el juicio experto. Una precisión alrededor del 80 % puede ser más que suficiente para analizar tendencias generales, pero no para tomar decisiones sobre un dispositivo o paciente individual. El rendimiento puede variar según el tipo de dispositivo y el año, y la calidad de los documentos subyacentes de la FDA y de las bases de datos de seguridad sigue siendo un cuello de botella importante. Aun así, este estudio muestra que sistemas de modelos de lenguaje cuidadosamente diseñados pueden convertir montañas de texto regulatorio no estructurado en datos estructurados y auditables en días en lugar de años. Para lectores no especializados, la conclusión es que las mismas tecnologías de IA que impulsan chatbots de consumo también pueden ayudar a vigilantes e investigadores a seguir cómo se construyen, prueban y supervisan los dispositivos médicos con IA—lo que podría conducir a una detección más rápida de problemas y a mejores evidencias para diseñar reglas y productos más seguros.

Cita: Li, H., He, X., Subbaswamy, A. et al. Scaling medical device regulatory science using large language models. npj Digit. Med. 9, 221 (2026). https://doi.org/10.1038/s41746-026-02353-7

Palabras clave: Dispositivos médicos con IA, ciencia regulatoria, grandes modelos de lenguaje, informes de seguridad de la FDA, supervisión de tecnología sanitaria