Clear Sky Science · es

Modelado de la incertidumbre en el análisis multimodal del habla a lo largo del espectro psicótico

Escuchar pistas ocultas en el habla cotidiana

La psicosis suele imaginarse como algo súbito y dramático—voces, visiones y una ruptura con la realidad. Pero mucho antes de una crisis, pueden aparecer cambios sutiles en la manera de hablar de las personas: el tono de voz, la elección de palabras e incluso el ritmo de las frases. Este estudio explora si los ordenadores pueden detectar esas señales débiles en el habla y, de forma crucial, indicar con qué confianza lo hacen. Así, el trabajo apunta hacia herramientas futuras que podrían ayudar a los clínicos a seguir la salud mental con mayor objetividad y personalizar la atención a lo largo de todo el rango, desde el riesgo leve hasta la enfermedad manifiesta.

De la charla informal a las entrevistas clínicas

Los investigadores grabaron el habla de 114 voluntarios de habla alemana que cubrían el espectro psicótico: personas con trastornos psicóticos tempranos y personas sin diagnóstico pero con niveles bajos o altos de rasgos similares a la psicosis (conocidos como esquizotipia). Cada persona completó cuatro tipos de tareas de habla, desde entrevistas clínicas estructuradas hasta relatos autobiográficos más libres, narraciones basadas en imágenes y conversación cotidiana. Estos distintos contextos importan porque una entrevista muy dirigida puede sacar a relucir ciertos síntomas, como la aplanamiento emocional, mientras que las narrativas abiertas pueden revelar pensamientos divagantes o percepciones inusuales. Al muestrear en distintos contextos, el equipo pudo ver cuán fiable era el habla para señalar síntomas en situaciones más parecidas al mundo real.

Escuchar tanto cómo hablamos como qué decimos

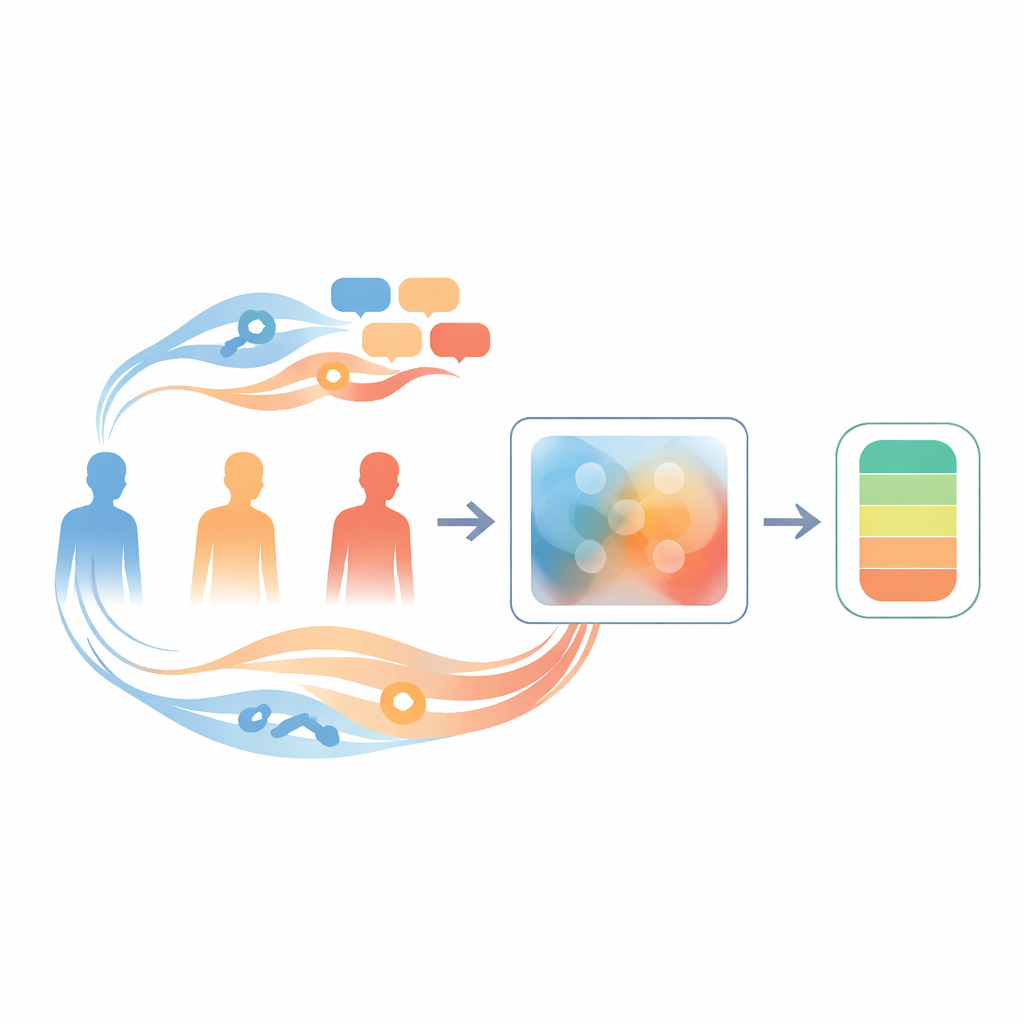

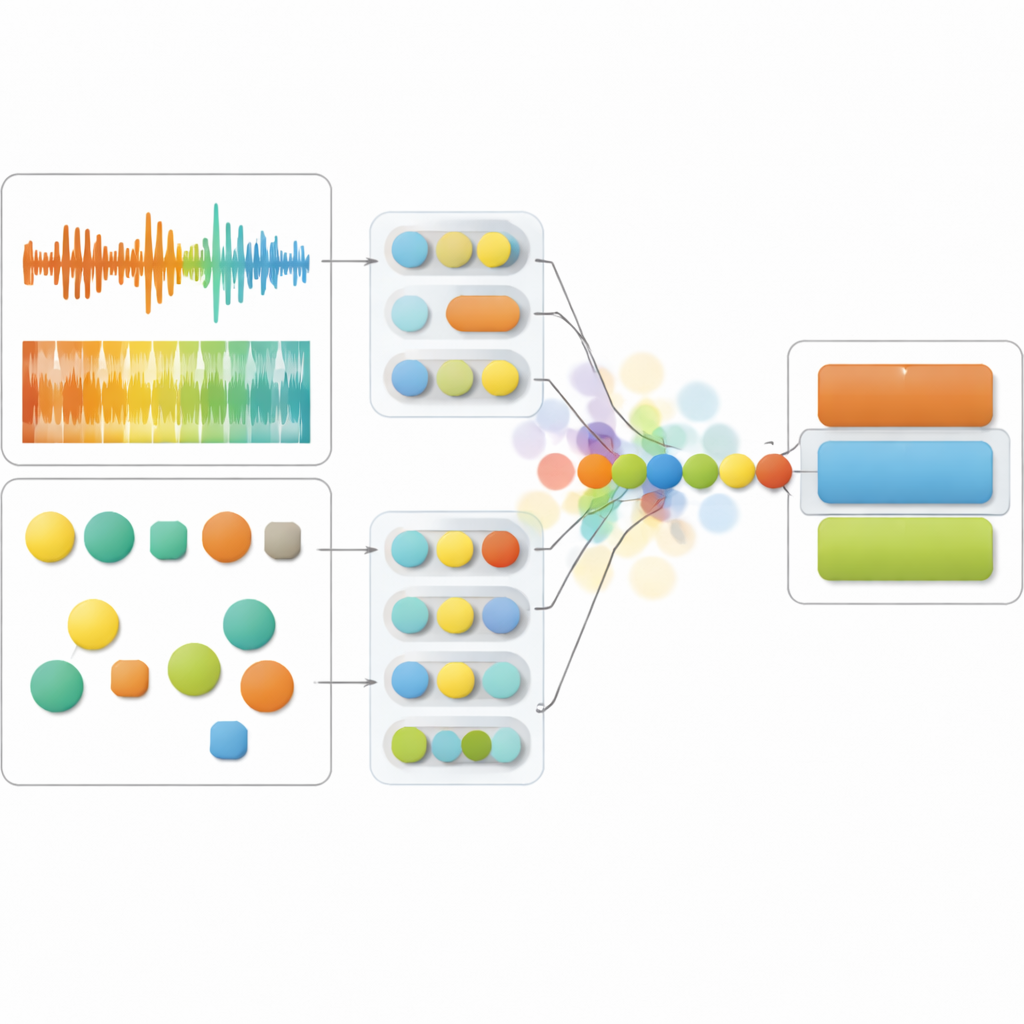

El sistema del estudio escucha dos caras del habla a la vez. En el lado sonoro, rastrea características como cambios de tono, intensidad y la estructura fina de la voz, que en conjunto capturan expresividad, tensión y fluidez. En el lado del lenguaje, analiza las propias palabras: cuán emocionales son, si se centran en percepciones o en conexiones sociales y cuán coherentes parecen. Redes neuronales avanzadas, entrenadas originalmente con grandes colecciones de audio y texto, convierten estas señales brutas en huellas numéricas compactas. El modelo central fusiona estas huellas a lo largo del tiempo para poder juzgar, momento a momento, qué canal—sonido o lenguaje—proporciona la pista más fiable sobre el estado mental de una persona.

Enseñar al modelo a admitir cuando está inseguro

Lo que distingue a este trabajo es que el modelo no solo ofrece una predicción; también estima su propia incertidumbre. En lugar de tratar las corrientes de audio y texto como fijas, las representa como nubes de probabilidad que pueden expandirse cuando los datos son ruidosos o inusuales. Si la grabación de voz está distorsionada o la persona murmura, el sistema resta peso al sonido y se apoya más en las palabras. Si la transcripción es poco fiable o el habla está extremadamente fragmentada, hace lo contrario. Esta fusión consciente de la incertidumbre, denominada Temporal Context Fusion, logró un rendimiento sólido: distinguió los grupos de baja esquizotipia, alta esquizotipia y psicosis temprana con una puntuación F1 del 83% y mostró una confianza bien calibrada, es decir, su certeza declarada se correspondía estrechamente con la frecuencia con la que realmente acertaba.

Patrones del habla que reflejan distintos tipos de síntomas

Al sondear el funcionamiento interno del modelo, los investigadores identificaron qué aspectos del habla seguían de forma más consistente distintas dimensiones sintomáticas. Las personas con síntomas positivos más intensos—como experiencias inusuales o ideas delirantes—tendían a mostrar un tono más alto y más variable, cambios rápidos en el espectro de la voz y mayores oscilaciones de intensidad, especialmente en relatos abiertos. Su lenguaje también contenía muchas palabras de percepción (vinculadas a ver, oír o sentir) y términos cargados emocionalmente. En contraste, las personas con síntomas negativos más marcados—como el aislamiento social y el embotamiento emocional—hablaban de forma más monótona, con tono restringido y una articulación menos flexible, y usaban menos palabras de emoción positiva y de contenido social. Los rasgos desorganizados, tanto en pacientes como en voluntarios de alta esquizotipia, se manifestaron como inestabilidad en la intensidad, titubeos y lenguaje fragmentado lleno de palabras relacionadas con el riesgo y procesos cognitivos, sugiriendo esfuerzo mental sin una estructura clara.

Por qué esto importa para la futura atención de la salud mental

En conjunto, los hallazgos muestran que el habla conserva huellas medibles de rasgos relacionados con la psicosis incluso en personas que no están clínicamente enfermas, y que esas huellas cambian según la situación comunicativa. El modelo consciente de la incertidumbre pudo aprovechar tanto el sonido como el lenguaje para seguir características positivas, negativas y desorganizadas a lo largo de un continuo, al tiempo que señalaba abiertamente cuando su evidencia era débil. Para un lector no especializado, la idea clave es que una escucha cuidadosa—amplificada por una IA que conoce sus propios límites—podría, en el futuro, ayudar a los clínicos a monitorizar la salud mental con mayor objetividad, reducir la conjetura y detectar cambios significativos antes. En lugar de sustituir el juicio humano, tales herramientas podrían servir como un segundo par de oídos, destacando patrones en el habla cotidiana que merecen una atención más detallada.

Cita: Rohanian, M., Hüppi, R., Nooralahzadeh, F. et al. Uncertainty modeling in multimodal speech analysis across the psychosis spectrum. npj Digit. Med. 9, 218 (2026). https://doi.org/10.1038/s41746-025-02309-3

Palabras clave: psicosis, análisis del habla, aprendizaje automático, evaluación de la salud mental, IA multimodal