Clear Sky Science · es

PlantCLR: preentrenamiento auto-supervisado contrastivo para la detección generalizable de enfermedades de las plantas

Por qué importa detectar enfermedades de las plantas de forma más inteligente

Las enfermedades de las plantas roban silenciosamente alimentos de la mesa del mundo, reduciendo los rendimientos de los cultivos y afectando los ingresos de los agricultores. En muchas regiones, solo hay unos pocos expertos disponibles para identificar problemas en el campo, y obtener su ayuda puede ser lento o imposible. Este estudio presenta PlantCLR, un sistema informático que aprende a reconocer enfermedades a partir de fotos de hojas con muchas menos etiquetas proporcionadas por humanos de lo habitual. Al hacer que el diagnóstico automatizado sea más preciso, más fiable y más fácil de desplegar en hardware modesto, el trabajo apunta a herramientas basadas en teléfonos inteligentes o cámaras de bajo coste que podrían ayudar a los agricultores a detectar problemas temprano y proteger sus cosechas.

De fotos de hojas a alertas tempranas

Hoy en día, muchas enfermedades de las plantas se diagnostican de la manera tradicional: una persona mira una hoja y decide si manchas, amarilleo o deformaciones son signos de infección. Ese juicio puede variar entre expertos y se ve fácilmente afectado por sombras, fondos desordenados o distintas etapas de crecimiento. Los sistemas de visión por ordenador basados en aprendizaje profundo han empezado a ayudar, pero normalmente requieren decenas de miles de fotos cuidadosamente etiquetadas. En agricultura, esas imágenes etiquetadas son escasas y costosas de recopilar, mientras que grandes cantidades de imágenes sin etiquetar tomadas con móviles y cámaras de campo a menudo no se aprovechan. PlantCLR está diseñado para aprovechar estos datos no etiquetados, aprendiendo cómo suelen verse las hojas sanas y enfermas antes de ver cualquier etiqueta.

Enseñar a un modelo a aprender por comparación

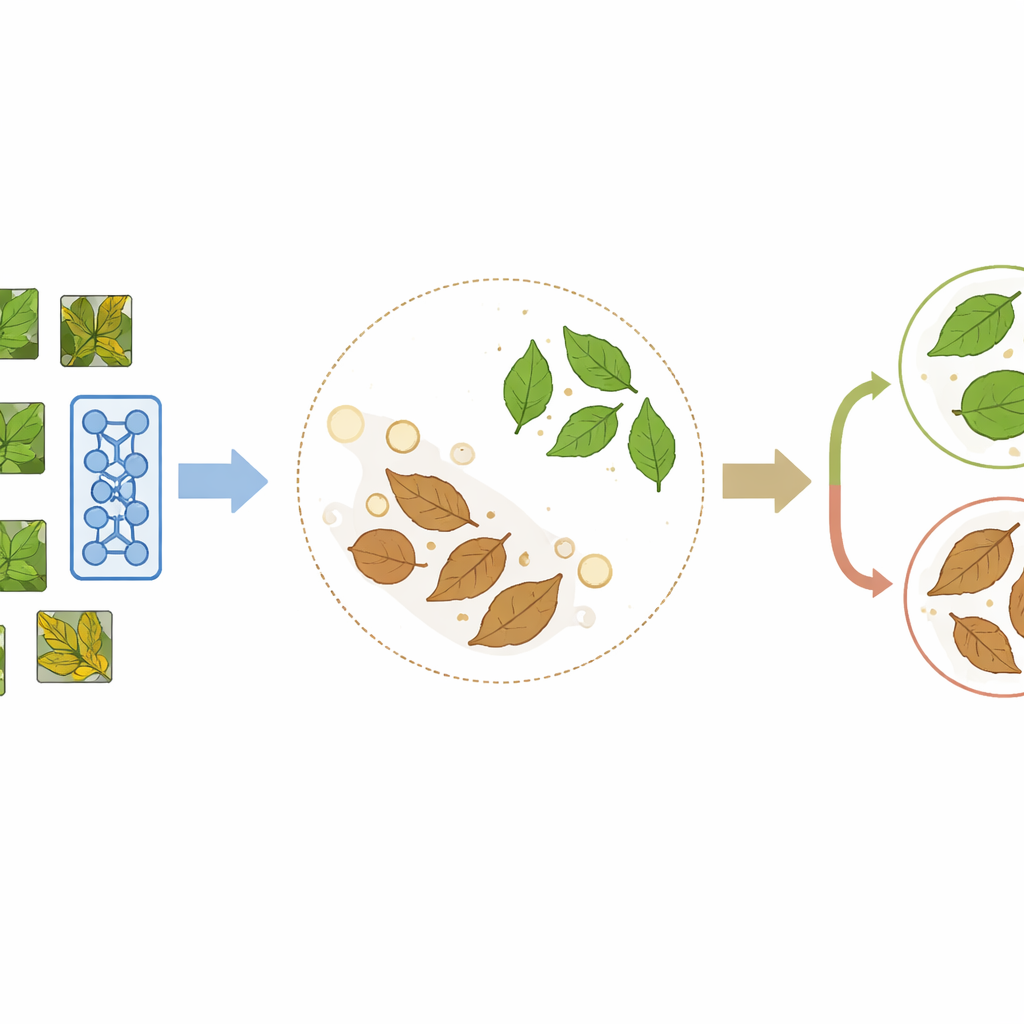

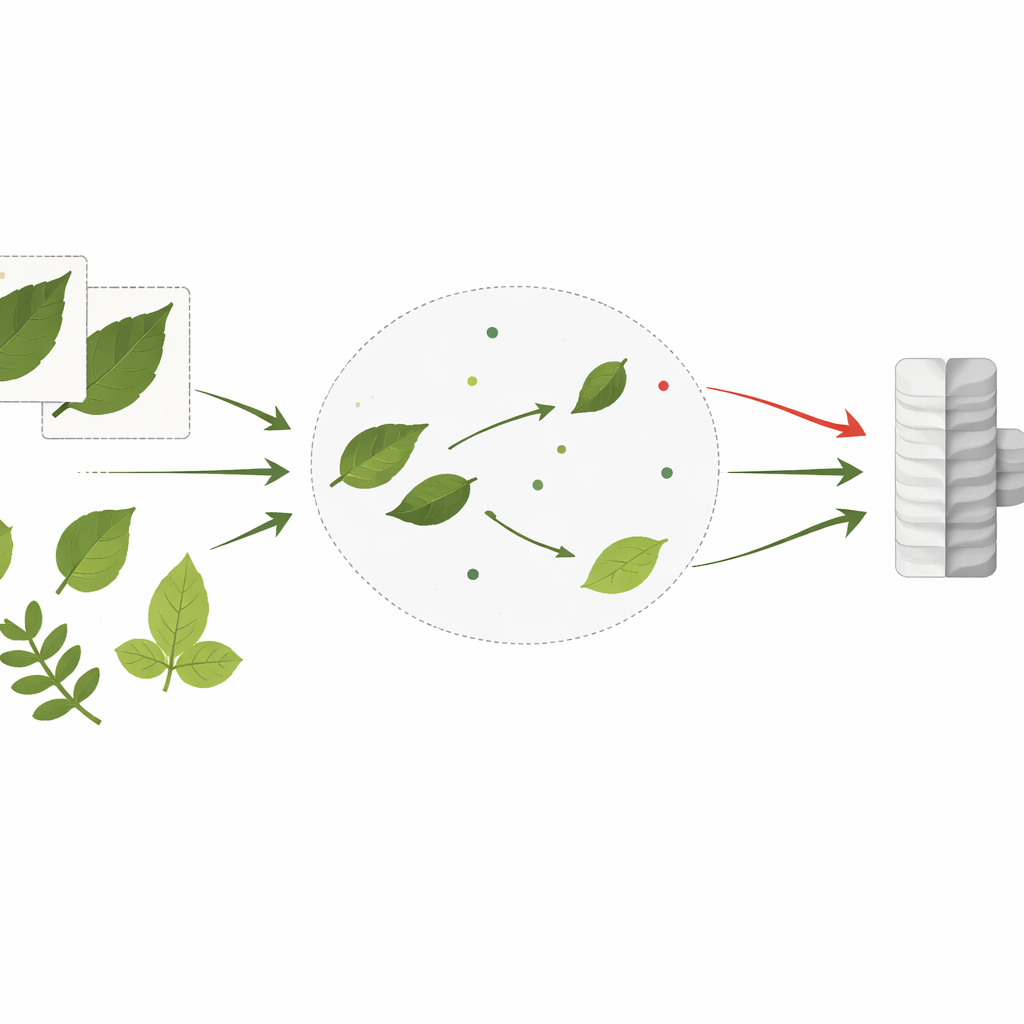

PlantCLR se basa en un enfoque reciente llamado aprendizaje contrastivo auto-supervisado, en el que un modelo se enseña a sí mismo comparando imágenes en lugar de leer etiquetas. Primero, el sistema toma una imagen de hoja no etiquetada y crea dos versiones ligeramente diferentes mediante recortes aleatorios, volteos, cambios de color o desenfoque. Estas dos versiones deben representar claramente la misma hoja, por lo que el modelo se entrena para tratarlas como un par coincidente y darles representaciones internas similares, mientras separa las representaciones de hojas diferentes en el mismo lote de entrenamiento. Esta fase de preentrenamiento utiliza una arquitectura compacta pero moderna de procesamiento de imágenes llamada ConvNeXt-Tiny, combinada con un módulo extra pequeño que se usa solo durante este paso de aprendizaje por comparación.

Poner el sistema a prueba

Para probar qué tan bien funciona esta estrategia en la práctica, los autores recurrieron a dos conjuntos de hojas populares que imitan entornos del mundo real muy distintos. El conjunto PlantVillage contiene más de 54.000 imágenes de hojas fotografiadas en condiciones ordenadas y controladas, por lo general con fondos limpios y síntomas claros en 38 categorías de enfermedades y cultivos. En contraste, el conjunto Cassava Leaf Disease contiene aproximadamente 21.000 imágenes de hojas de yuca tomadas directamente en el campo, con fondos desordenados, iluminación desigual y hojas que se solapan o torsionan en muchas direcciones, en cinco clases que incluyen varias infecciones virales y bacterianas graves. El estudio usa PlantVillage principalmente como una fuente rica de imágenes no etiquetadas para el preentrenamiento y luego evalúa el rendimiento tanto en ese conjunto como, más críticamente, en las fotos de yuca estilo campo, más difíciles.

Rendimiento robusto ante condiciones cambiantes

PlantCLR alcanzó un 99,10 % de precisión en el conjunto de prueba de PlantVillage y un 96,83 % en el conjunto de Cassava, con puntuaciones F1 igualmente altas que demuestran que el modelo funciona bien incluso con enfermedades menos comunes. Estas cifras superan a una variedad de redes profundas bien conocidas, incluidas DenseNet, ResNet, VGG y un modelo transformer visual, todas entrenadas de forma puramente supervisada en condiciones cuidadosamente igualadas.

Por qué este enfoque es un avance

Para los no especialistas, el mensaje clave es que PlantCLR muestra cómo una máquina puede convertirse en un doctor de plantas eficaz aprendiendo primero de grandes colecciones de fotos no etiquetadas y luego refinando sus habilidades con un conjunto más pequeño y etiquetado. Esta estrategia no solo alcanza una precisión muy alta, sino que también se mantiene bien cuando la cámara pasa del laboratorio al campo, donde las condiciones son mucho menos pulidas. Dado que el modelo subyacente es relativamente ligero, podría llegar a desplegarse en hardware asequible, haciendo que la detección avanzada de enfermedades sea más accesible para agricultores y técnicos de extensión en todo el mundo. En resumen, el estudio demuestra un camino práctico hacia herramientas de monitorización de la salud vegetal escalables, robustas y eficientes en etiquetas que podrían ayudar a proteger los suministros de alimentos.

Cita: Shah, S.S.A., Saeed, F., Raza, M.U. et al. PlantCLR: contrastive self-supervised pretraining for generalizable plant disease detection. Sci Rep 16, 10550 (2026). https://doi.org/10.1038/s41598-026-45684-x

Palabras clave: detección de enfermedades de plantas, aprendizaje auto-supervisado, aprendizaje contrastivo, IA agrícola, monitorización de la salud de los cultivos