Clear Sky Science · es

Un conjunto de transformers ViT y Swin con explicaciones basadas en LLM para el diagnóstico de enfermedades foliares de la caña de azúcar

Por qué importa detectar hojas enfermas de caña de azúcar

La caña de azúcar es un cultivo fundamental para la producción de azúcar, biocombustibles y para muchas economías rurales, pero sus hojas son vulnerables a diversas enfermedades que erosionan la producción de forma silenciosa. Los agricultores suelen confiar en la inspección visual, que puede ser lenta, inconsistente y difícil de escalar en campos extensos. Este artículo explora cómo la inteligencia artificial moderna puede analizar automáticamente fotos de hojas para detectar múltiples enfermedades de la caña de azúcar con alta precisión y, a continuación, usar un modelo de lenguaje para convertir esas predicciones en recomendaciones en lenguaje claro para los agricultores.

Cómo se convierten las fotos de hojas en datos

Los investigadores construyeron su sistema usando una colección pública de imágenes de hojas de caña de azúcar de Kaggle, que contiene casi veinte mil fotografías a color. Cada imagen pertenece a una de seis categorías: sana o una de cinco enfermedades comunes, entre ellas Tizón Bacteriano, Mosaico, Pudrición Roja, Roya y Enfermedad de Hoja Amarilla. Las fotos fueron tomadas en condiciones reales de campo, por lo que incluyen variaciones de luz, sombras y fondos con desorden. Para preparar los datos, el equipo eliminó duplicados e imágenes corruptas y luego dividió el conjunto en entrenamiento, validación y prueba manteniendo el mismo equilibrio de tipos de enfermedad en cada partición. Durante el entrenamiento, se aplicaron aumentos solo a las imágenes de entrenamiento —rotaciones, volteos y zoom— para simular distintos ángulos y distancias de cámara, haciendo el sistema más robusto sin inflar su rendimiento en el conjunto de prueba.

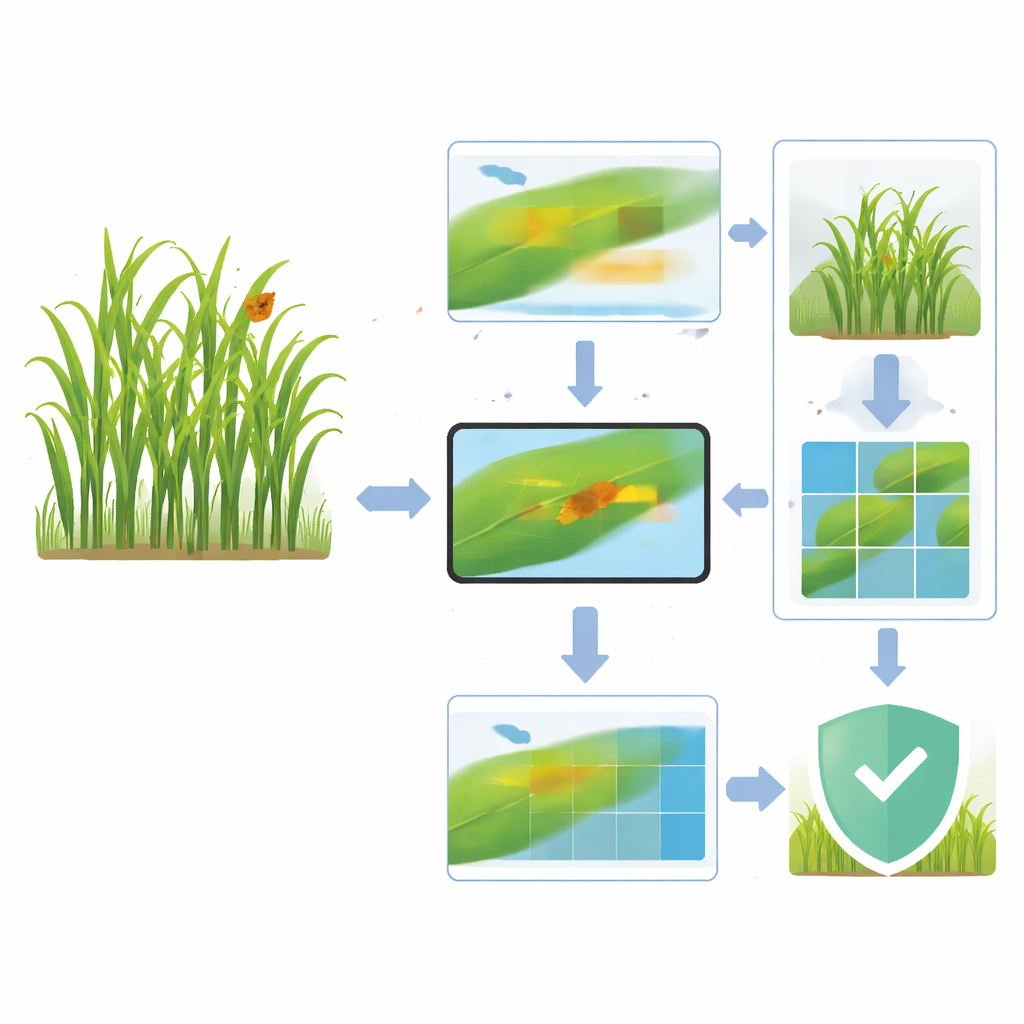

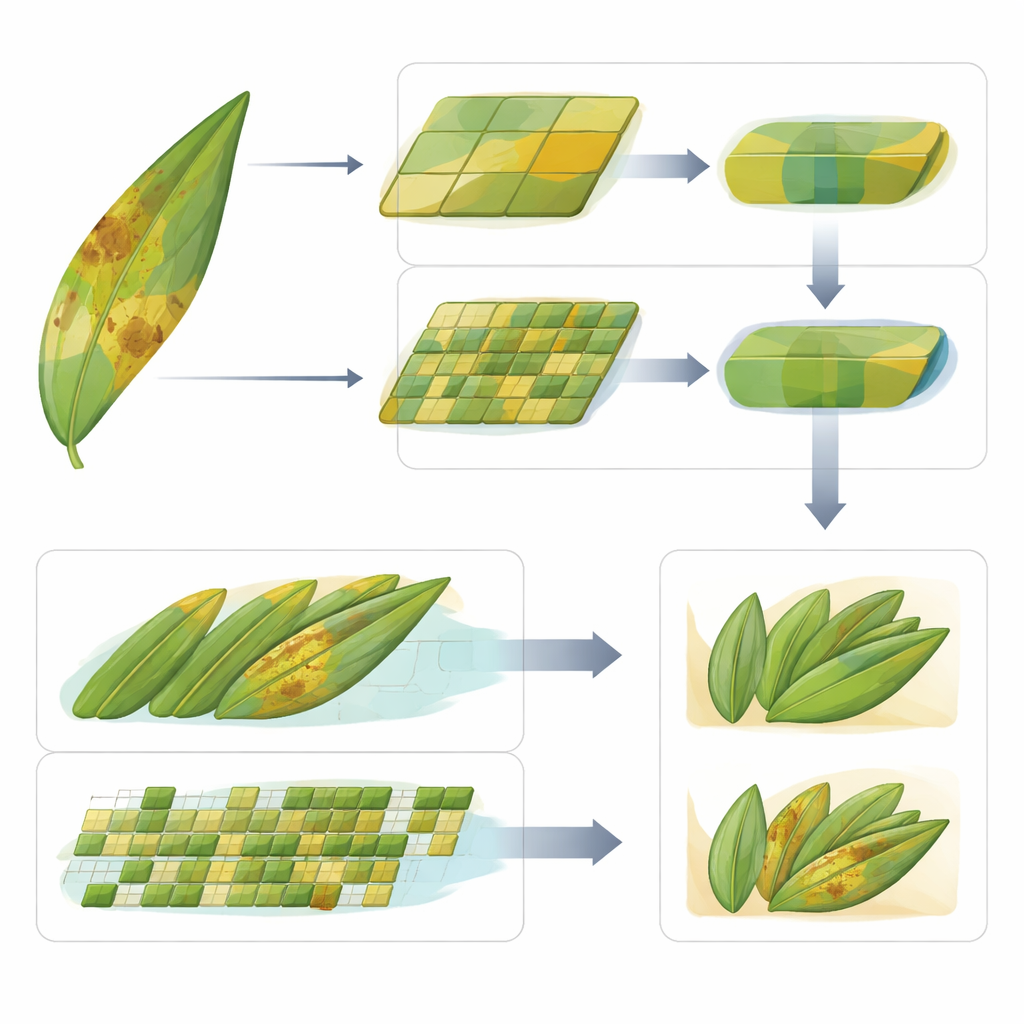

Dos formas complementarias de mirar una hoja

En el núcleo del estudio está un “conjunto” que combina dos modelos avanzados de visión conocidos como transformers. Uno, el Vision Transformer (ViT), interpreta cada imagen como un conjunto de parches y aprende patrones a lo largo de toda la hoja a la vez. Esta vista global es adecuada para enfermedades que se manifiestan como áreas grandes y difusas de decoloración. El otro, denominado Swin Transformer, trabaja con ventanas superpuestas más pequeñas que se desplazan por la imagen, construyendo una comprensión en capas de texturas finas y pequeñas manchas. Este enfoque local ayuda con enfermedades que aparecen como lesiones diminutas, estrías o puntos. Por diseño, ViT es sensible a cambios de color amplios, mientras que Swin presta atención a detalles pequeños y agrupados: dos caras de cómo las enfermedades foliares reales se muestran en el campo.

Cómo se unen los dos modelos

En lugar de construir una red nueva y complicada, los autores combinan ViT y Swin de una forma simple y transparente. Cada modelo examina primero la misma imagen de la hoja y produce sus propias puntuaciones de probabilidad para las seis clases. Estas puntuaciones se promedian luego, sin pesos entrenables adicionales, y la mayor probabilidad combinada decide el diagnóstico final. Esta estrategia de promediado equilibra las fortalezas de cada modelo y evita el sobreajuste en un conjunto de datos que, aunque razonablemente grande, aún refleja un conjunto específico de regiones y condiciones. Los experimentos muestran que reemplazar Swin por una red convolucional tradicional elimina detalles locales cruciales, y usar solo ViT pierde señales sutiles —prueba de que la ganancia proviene de la verdadera sinergia entre atención global y local, no simplemente de apilar más modelos.

Qué tan bien funciona el sistema en la práctica

En el conjunto de prueba retenido de casi tres mil imágenes, el conjunto alcanza una exactitud de alrededor del 97 por ciento, con precisión, recall y puntuaciones F1 igualmente altas en las seis clases. Supera a fuertes baselines convolucionales como ResNet, EfficientNet, MobileNet y DenseNet, así como a los modelos individuales ViT y Swin. La matriz de confusión muestra que la mayoría de errores ocurren entre enfermedades visualmente similares, como Hoja Amarilla y Mosaico, pero las tasas de clasificación errónea siguen siendo bajas en general. Las curvas ROC para cada clase son casi perfectas, lo que indica que el conjunto es muy confiable y consistente al separar hojas sanas de enfermas y entre los distintos tipos de enfermedad.

Convertir predicciones en orientación accesible para agricultores

Para ir más allá de las etiquetas crudas, los autores conectan su conjunto de imágenes a un modelo de lenguaje grande (LLM) alojado en línea. Una vez que se clasifica una foto de hoja, el nombre de la enfermedad predicha se envía al LLM, que devuelve una breve explicación de los síntomas probables y sugerencias generales de manejo, pensadas para agricultores y técnicos de extensión. Una interfaz web construida sobre la plataforma Hugging Face permite a los usuarios subir una imagen de hoja, ver la enfermedad predicha y leer la guía generada por la IA en pocos segundos. Los autores subrayan que estas recomendaciones son orientativas y deben verificarse con expertos en agronomía, porque los LLM pueden a veces generar consejos excesivamente confiados o incompletos. Aun así, esta capa lingüística hace el sistema más accesible para no especialistas.

Qué significa esto para futuras herramientas de agricultura inteligente

En términos sencillos, el estudio muestra que combinar dos “maneras de ver” la misma hoja —una que ve el bosque, otra que ve los árboles— puede producir un explorador digital muy fiable para las enfermedades de la caña de azúcar. El conjunto de ViT y Swin Transformers capta tanto síntomas amplios como detallados, mientras que el modelo de lenguaje adjunto ayuda a traducir predicciones técnicas en sugerencias comprensibles. Aunque los modelos aún necesitan pruebas en más regiones, condiciones de iluminación y dispositivos, y las salidas lingüísticas requieren la supervisión de expertos, este trabajo apunta hacia herramientas prácticas para teléfonos o tabletas que podrían ayudar a los agricultores a detectar problemas temprano, reducir la conjetura y apoyar un uso más preciso de tratamientos en la caña de azúcar y, eventualmente, en muchos otros cultivos.

Cita: Saritha, M., Rasane, K. An ensemble of vision and swin transformers with LLM-based explanations for sugarcane leaf disease diagnosis. Sci Rep 16, 10707 (2026). https://doi.org/10.1038/s41598-026-45453-w

Palabras clave: detección de enfermedades de la caña de azúcar, modelos de visión transformer, agricultura de precisión, imágenes de hojas de plantas, soporte de decisión por IA