Clear Sky Science · es

Segmentación de instrumentos quirúrgicos con supervisión débil y agnóstica al dominio

Por qué importan vistas más inteligentes de los instrumentos quirúrgicos

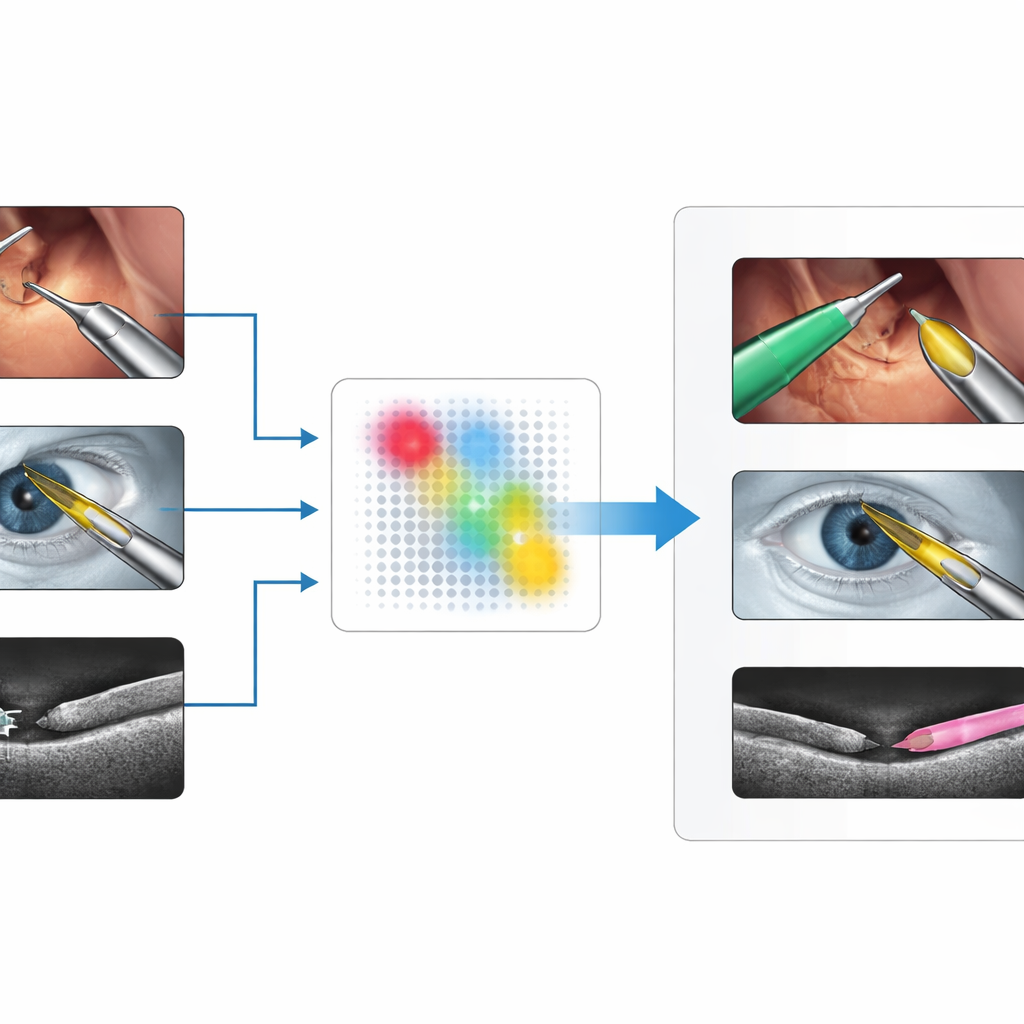

Los cirujanos modernos operan cada vez más con la ayuda de cámaras, microscopios y escáneres avanzados. Para guiar robots, alinear vistas 3D o ocultar herramientas en ciertas imágenes, los ordenadores deben localizar con fiabilidad cada instrumento en cada fotograma, una tarea llamada segmentación. Hoy esto suele exigir miles de anotaciones minuciosas y pixel-perfect realizadas por expertos médicos—y aun así, los sistemas con frecuencia fallan cuando cambia la configuración de imagen o el procedimiento. Este estudio presenta una forma de permitir que potentes modelos de visión detecten instrumentos en tipos muy diferentes de imágenes médicas, sin necesitar dibujos detallados de cada herramienta de antemano.

El reto de encontrar herramientas en muchos tipos de imagen

Los cirujanos usan una amplia gama de sistemas de imagen: vídeos en color de cámaras laparoscópicas dentro del abdomen, vistas microscópicas del ojo durante una cirugía de cataratas y exploraciones seccionales como tomografía de coherencia óptica (OCT) o ecografía. En cada uno de estos, los instrumentos quirúrgicos se ven muy distintos—varillas metálicas brillantes en imágenes en color, líneas finas y brillantes o medias lunas en OCT, o manchas moteadas en ecografía. Los métodos actuales de aprendizaje profundo pueden funcionar muy bien, pero solo después de entrenarse con grandes conjuntos de datos cuidadosamente etiquetados de un entorno específico. Cuando cambia el dispositivo de imagen, la anatomía o el tipo de instrumento, el rendimiento suele caer en picado, y recolectar nuevas anotaciones es lento, costoso y limitado por restricciones de privacidad y especialización.

Una idea nueva: tratar los instrumentos como objetos fuera de lugar

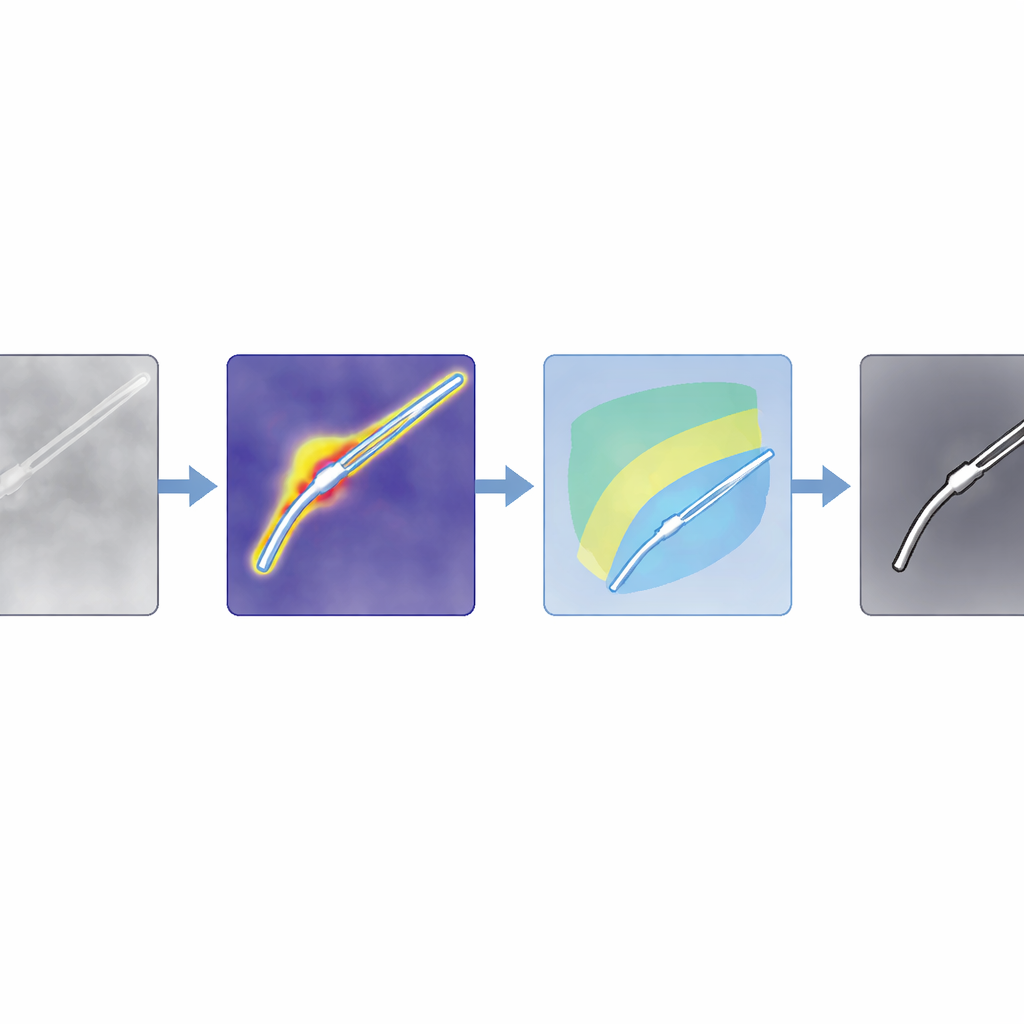

Los autores proponen un método que llaman SAM4SIS que invierte el problema. En lugar de enseñar al sistema exactamente cómo es cada instrumento, primero le muestran imágenes sin herramientas, permitiéndole aprender cómo se ve el tejido “normal”. Usan un detector de anomalías llamado PatchCore para construir una memoria de estos patrones normales. Cuando llega una nueva imagen, PatchCore resalta regiones cuya apariencia no encaja en esa memoria—áreas que probablemente contengan instrumentos quirúrgicos. Este paso solo necesita información sencilla a nivel de imagen sobre si hay o no una herramienta presente, no dibujos pixelados de su contorno, lo que facilita mucho la puesta en marcha.

De indicios imprecisos a contornos precisos

Los mapas de anomalía son toscos, por lo que el equipo los combina con un potente modelo fundacional, Segment Anything Model 2 (SAM2), que puede trazar contornos nítidos si se le da un punto dentro del objeto de interés. El truco clave es elegir automáticamente esos puntos a partir del mapa de anomalías, en lugar de pedir a un humano que haga clic. Los autores diseñan filtros adaptados a imágenes en color ordinarias y a exploraciones basadas en intensidad como OCT, realzando regiones que probablemente contengan instrumentos y suprimiendo sombras y artefactos brillantes. Luego puntúan posibles regiones de herramientas y eligen los puntos más fuertes como indicaciones para SAM2. Dado que SAM2 devuelve varios contornos candidatos, los autores introducen una nueva regla de puntuación, SAM4SIS, que mide qué tan bien encaja cada candidato con el mapa basado en anomalías y selecciona la máscara que mejor se ajusta.

Funciona en muchas cirugías y escáneres

Los investigadores prueban su enfoque en tres conjuntos de datos exigentes: vídeos de cirugía robótica abdominal (EndoVis2017), imágenes microscópicas de operaciones de cataratas (CaDIS) y exploraciones OCT seccionales de ojos porcinos con instrumentos diminutos (PASO-SIS). Estos cubren vistas, colores y patrones de ruido muy distintos. Sin volver a entrenar el gran modelo de segmentación ni dibujar nuevas máscaras, SAM4SIS alcanza puntuaciones de precisión en contorno entre aproximadamente 53% y 73%, rivalizando o superando métodos de prompting basados en texto y acercándose a algunos sistemas supervisados. Rinde especialmente bien donde los métodos tradicionales tienen dificultades, como en datos OCT y de ecografía, y requiere menos de un minuto de tiempo de configuración. El equipo también demuestra que la misma idea puede resaltar otros objetos extraños, como bolas de algodón en ecografías cerebrales, lo que sugiere que el concepto no se limita a instrumentos.

Qué significa esto para la cirugía inteligente futura

Para el lector, el mensaje central es que los ordenadores pueden ahora aprender a “segmentar cualquier novedad” en escenas quirúrgicas entendiendo primero cómo es el tejido normal y luego marcando formas no familiares como probables herramientas, que después son refinadas por un modelo de visión de propósito general. Este enfoque evita el trabajo de anotación intensivo, se adapta a distintas tecnologías de imagen y puede integrarse en flujos de trabajo quirúrgicos con preparación mínima. Aunque los modelos especializados cuidadosamente entrenados siguen ganando cuando hay abundantes datos etiquetados, SAM4SIS ofrece una alternativa práctica para procedimientos nuevos, configuraciones de imagen raras o investigaciones en etapa temprana, acercando la detección automática y robusta de instrumentos a la realidad clínica cotidiana.

Cita: Peter, R., Pham, D.X.V., Matten, P. et al. Domain-agnostic weakly supervised surgical instrument segmentation. Sci Rep 16, 9337 (2026). https://doi.org/10.1038/s41598-026-43054-1

Palabras clave: segmentación de instrumentos quirúrgicos, IA en imágenes médicas, detección de anomalías, modelos fundacionales de visión, cirugía robótica