Clear Sky Science · es

Desarrollo y evaluación de un marco de aprendizaje por transferencia multietapa para un análisis de imágenes médicas robusto

Por qué importa leer imágenes con mayor inteligencia

La medicina moderna depende en gran medida de las imágenes —desde mamografías hasta radiografías de tórax— para detectar enfermedades de forma temprana y orientar el tratamiento. Pero enseñar a las computadoras a interpretar estas imágenes con la precisión de expertos humanos suele exigir conjuntos de datos enormes y cuidadosamente etiquetados que muchos hospitales no tienen. Este estudio presenta una nueva forma de entrenar sistemas de inteligencia artificial que aprovecha mejor las imágenes disponibles, incluidas fotos de laboratorio económicas de células cancerosas, para mejorar el rendimiento en exploraciones del mundo real al tiempo que reduce las exigencias de privacidad y de datos.

De fotos cotidianas a exploraciones hospitalarias

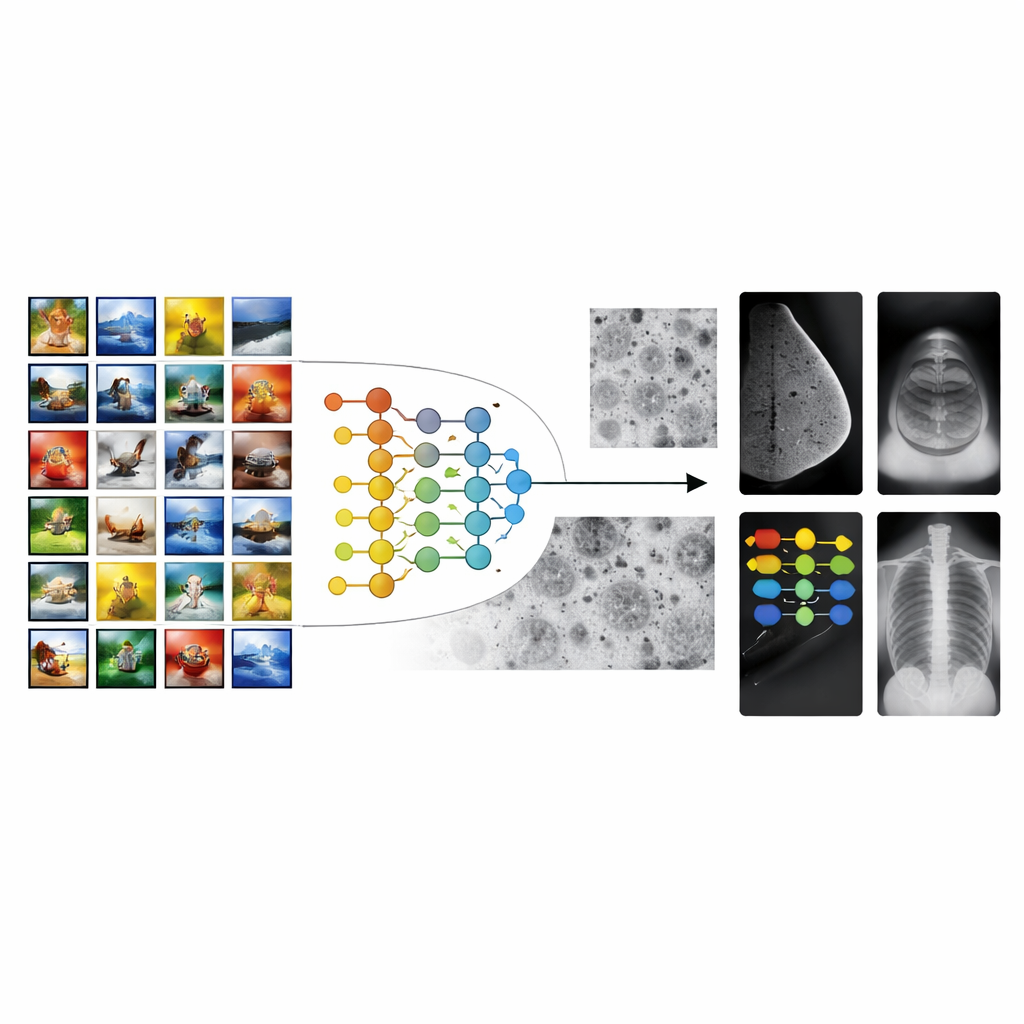

La mayoría de los sistemas de IA para imágenes médicas parten de modelos entrenados con millones de fotos cotidianas, como animales, objetos y paisajes. Esta estrategia, conocida como aprendizaje por transferencia, da a los algoritmos una “ventaja” para reconocer formas y texturas. Sin embargo, existe una gran brecha entre las fotos de vacaciones y las exploraciones médicas. Los patrones que importan en una mamografía o una radiografía —minúsculas motas, sombras tenues o texturas sutiles del tejido— no se parecen a los objetos en fotografías ordinarias. Como resultado, el aprendizaje por transferencia convencional puede quedarse estancado, dando lugar a herramientas que rinden bien en el laboratorio pero tienen dificultades entre distintos hospitales, máquinas o grupos de pacientes.

Construyendo un puente con imágenes de células

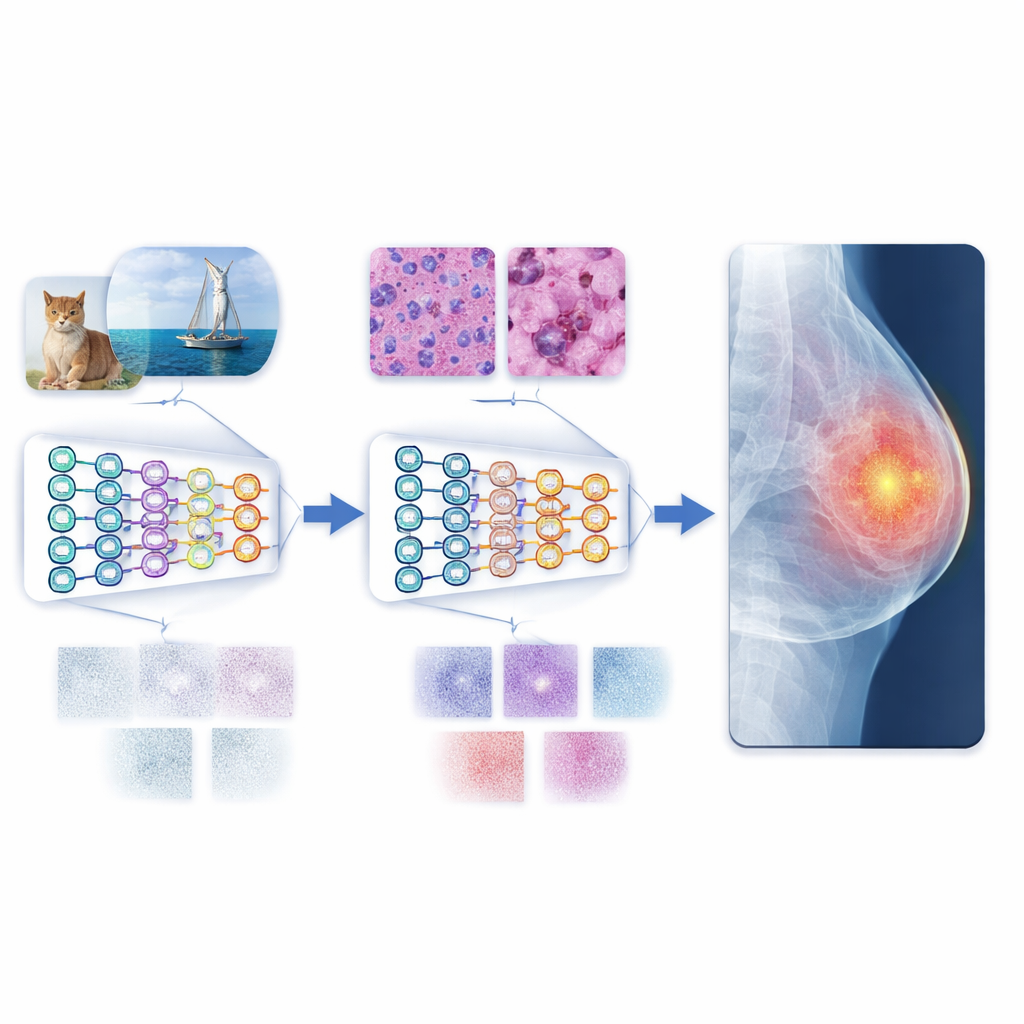

Los autores proponen un marco de aprendizaje por transferencia multietapa (MSTL) que añade un paso intermedio crucial entre las imágenes generales y las exploraciones clínicas. Tras un primer entrenamiento con una gran colección de imágenes naturales, el modelo se ajusta finamente con fotografías microscópicas de líneas celulares cancerosas cultivadas en el laboratorio. Estas imágenes de células comparten muchas características visuales con las exploraciones médicas: estructuras densas y agrupadas; texturas finas y detalladas; y variaciones sutiles de brillo. Además, son relativamente baratas de producir, se pueden generar en gran cantidad y evitan los problemas de privacidad asociados a los datos de pacientes. Al adaptarse primero a este mundo de imágenes celulares, el modelo aprende características más relevantes para los patrones de enfermedad antes de ver una mamografía, una ecografía o una radiografía.

Pruebas en distintos tipos de exploraciones

Para evaluar esta estrategia, los investigadores entrenaron tanto redes neuronales convolucionales tradicionales como los más recientes transformadores de visión en tres tareas de imagen comunes: detección de cáncer de mama en mamografías, análisis de lesiones mamarias en ecografías y detección de neumonía en radiografías de tórax. Compararon tres estilos de entrenamiento: empezar desde cero, usar aprendizaje por transferencia convencional desde imágenes naturales y emplear el nuevo método multietapa con imágenes de células cancerosas como puente. El enfoque multietapa ofreció consistentemente los mejores resultados, a menudo elevando la precisión cerca de la perfección en los conjuntos de datos probados. Los transformadores de visión, que pueden capturar patrones de largo alcance en toda la imagen, superaron a las redes convolucionales estándar en casi todos los escenarios, especialmente cuando se combinaron con el entrenamiento multietapa.

Midiendo cuán bien se transfiere el conocimiento

Más allá de las simples puntuaciones de precisión, el equipo examinó con qué facilidad las características aprendidas en una etapa se trasladaban a la siguiente. Usaron tres medidas de transferibilidad que reflejan cuán compatibles son los patrones de imagen aprendidos con nuevas tareas. Para mamografías y radiografías de tórax en particular, estas medidas siguieron de cerca el rendimiento real, especialmente para el modelo más potente, un transformador de visión base (ViTB-16). Esta relación estrecha sugiere que la etapa intermedia con imágenes celulares hace más que mejorar las cifras; produce representaciones que realmente “encajan” mejor con las imágenes médicas. Experimentos adicionales mostraron que reducir a la mitad el número de imágenes celulares perjudicaba el rendimiento, y que sustituirlas por otras modalidades médicas (como endoscopia o imágenes oculares) era menos eficaz, subrayando el valor particular de las líneas celulares cancerosas como puente.

Hacia un diagnóstico automatizado más fiable

En términos sencillos, el estudio demuestra que enseñar a un sistema de IA a leer imágenes de células cultivadas en el laboratorio antes de las exploraciones hospitalarias lo convierte en un “lector” de imágenes médicas más hábil y fiable. Este camino multietapa reduce la discrepancia entre las coloridas fotos cotidianas y los patrones apagados y complejos de las imágenes clínicas, permitiendo que el modelo generalice mejor incluso cuando solo hay disponibles cantidades modestas de datos médicos etiquetados. Combinado con transformadores de visión modernos, el enfoque ofrece un rendimiento de vanguardia en varios conjuntos de referencia. Aunque aún se requieren datos más diversos y pruebas más amplias, el marco apunta a herramientas escalables y respetuosas con la privacidad que podrían ayudar a los médicos a diagnosticar enfermedades con mayor precisión y consistencia en todo el mundo.

Cita: Ayana, G., Park, Sy., Jeong, K.C. et al. Development and evaluation of a multistage transfer learning framework for robust medical image analysis. Sci Rep 16, 8873 (2026). https://doi.org/10.1038/s41598-026-42157-z

Palabras clave: análisis de imágenes médicas, aprendizaje por transferencia, aprendizaje profundo, transformadores de visión, imágenes de células cancerosas