Clear Sky Science · es

Diseño e implementación de un marco de aprendizaje profundo para la clasificación automatizada de cultivos y el diagnóstico de su salud en la agricultura de precisión

Campos más inteligentes para un mundo hambriento

Alimentar a una población mundial en crecimiento implica obtener más alimentos de cada parcela mientras se desperdicia menos agua, fertilizantes y mano de obra. Sin embargo, los agricultores aún pasan incontables horas recorriendo sus tierras, revisando hojas y suelo a simple vista. Este artículo presenta un modo automatizado de vigilar los cultivos mediante drones, satélites en órbita y sensores enterrados, todos conectados a un sistema de aprendizaje profundo que puede detectar problemas tempranos y sugerir acciones rápidas.

Uniendo el cielo y el suelo

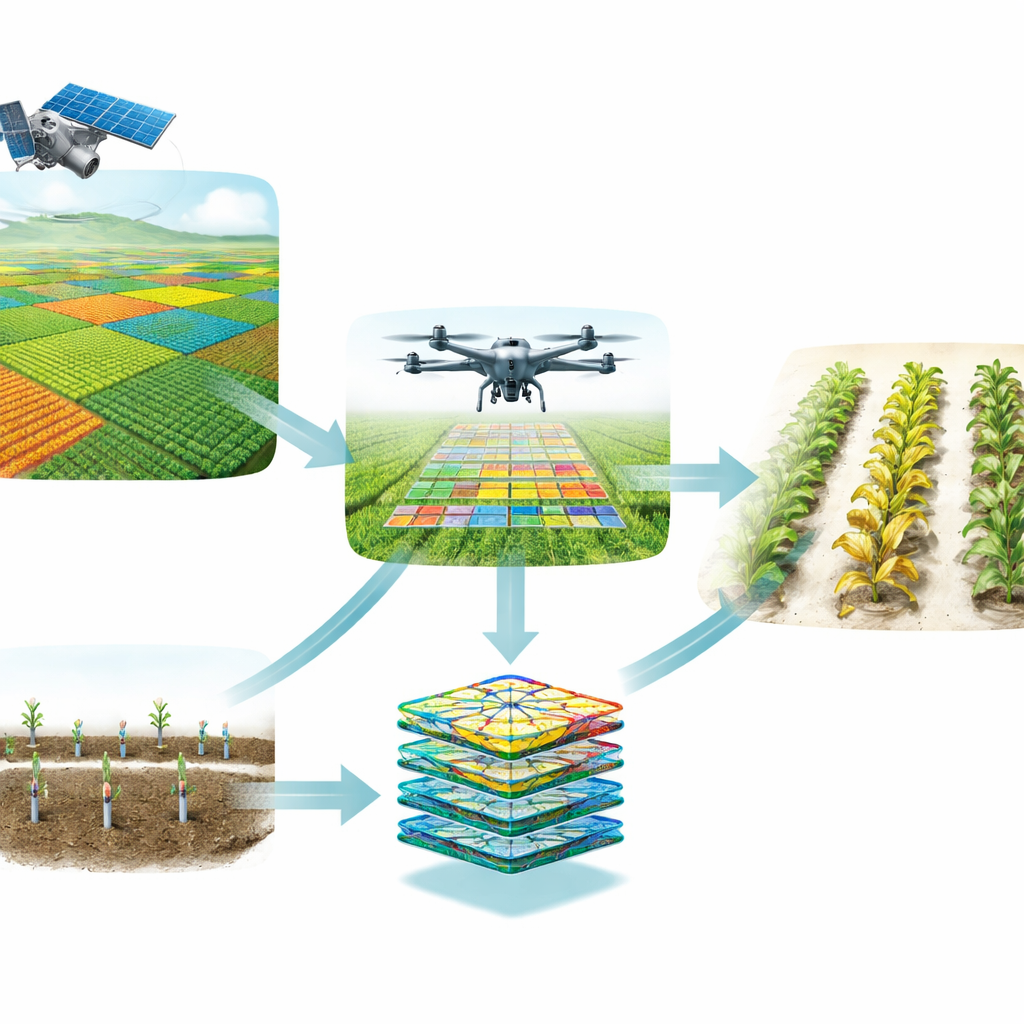

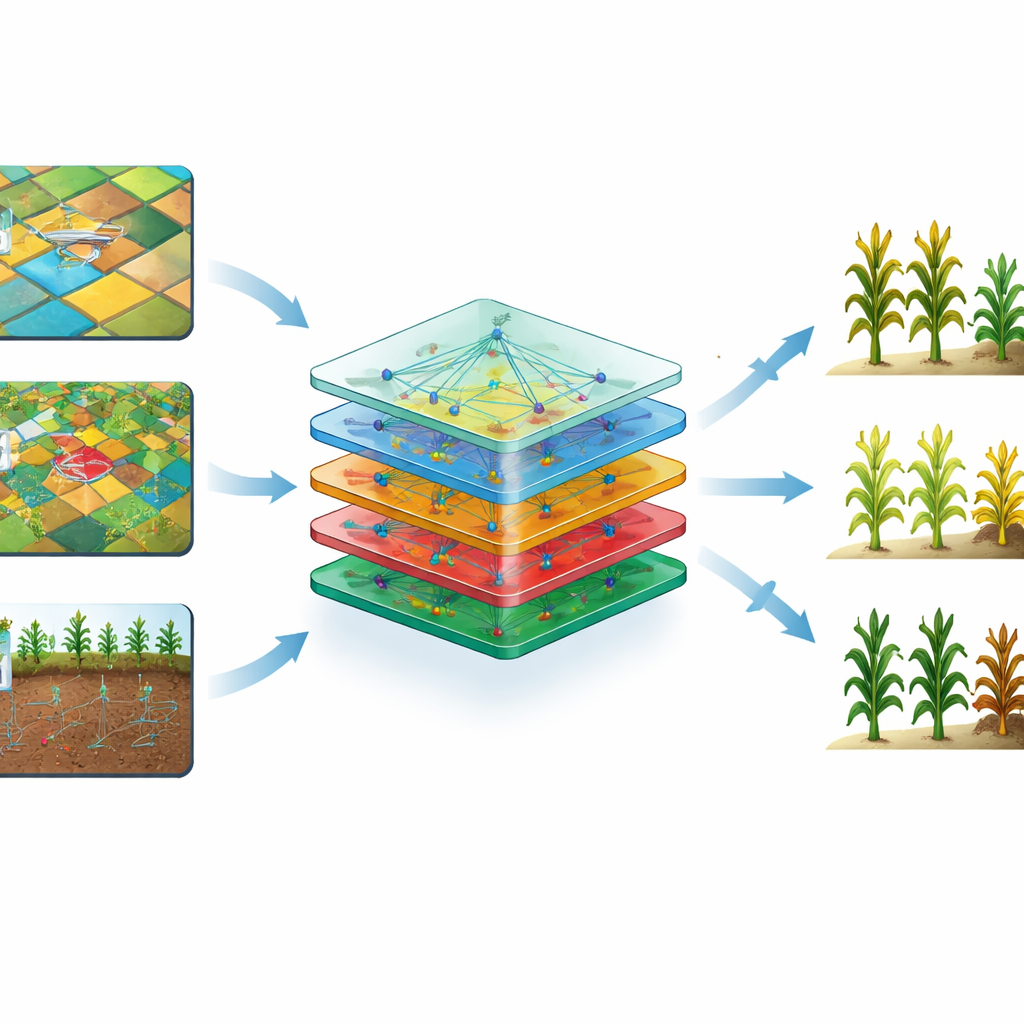

La mayoría de las herramientas agrícolas de alta tecnología solo examinan una pieza del rompecabezas: fotos en primer plano de las hojas o cifras crudas de sondas del suelo. Los autores sostienen que esta visión «aislada» pasa por alto pistas importantes. Su marco, en cambio, combina tres puntos de vista. Desde el espacio, las imágenes satelitales revelan patrones a gran escala, como qué zonas de un campo están bajo estrés. Desde el aire, los drones capturan vistas detalladas en color e infrarrojo cercano de plantas individuales. En el suelo, sensores conectados a Internet registran humedad, nutrientes, temperatura y otras condiciones. Alineando estas fuentes de datos en tiempo y lugar, el sistema puede conectar lo que ve en las hojas con lo que está ocurriendo en el suelo y el entorno circundante.

Cómo aprende el doctor digital de los cultivos

El corazón del marco es un modelo de aprendizaje profundo entrenado para reconocer tipos de cultivo y condiciones de salud. Primero, todos los datos entrantes se limpian y estandarizan: las escenas satelitales con nubes se normalizan, las imágenes de drones se redimensionan y ajustan por cambios de iluminación, y se rellenan los huecos en los registros meteorológicos. El sistema también aumenta los datos de imagen rotando y volteando las fotos para que el modelo aprenda a ignorar el ángulo de la cámara y se concentre en las características reales de la planta. Luego, una red especializada de análisis de imágenes, conocida como red neuronal convolucional, extrae patrones como la textura de las hojas, cambios de color y formas de lesiones, mientras que capas adicionales procesan las lecturas numéricas de los sensores. Un mecanismo de «atención» ayuda al modelo a concentrarse en las regiones más informativas —como un parche de hojas manchadas— mientras descarta el suelo o el cielo de fondo.

De datos crudos a decisiones en tiempo real

Una vez entrenado, el modelo actúa como un doctor de cultivos siempre activo. Los datos de múltiples fuentes se transmiten al sistema y se fusionan en una única representación interna. Las capas guiadas por atención comparan lo que detectan con miles de ejemplos pasados, y el bloque final de clasificación decide si una planta es saludable o muestra signos de enfermedad, daños por plagas o estrés. En lugar de etiquetar simplemente un campo como bueno o malo, el marco vincula su diagnóstico visual con los niveles actuales de humedad y nutrientes del suelo. Esa combinación le permite priorizar alertas: por ejemplo, un patrón de enfermedad acompañado de condiciones húmedas podría activar una advertencia de alta urgencia, impulsando una fumigación dirigida e inmediata en lugar de un tratamiento masivo en toda la explotación.

Poniendo el sistema a prueba

Para evaluar si este enfoque funciona más allá de la teoría, los autores entrenaron y evaluaron su marco con un conjunto de datos público de agricultura de precisión que incluye imágenes satelitales, fotos de drones y lecturas de sensores de suelo para cultivos básicos clave: maíz, patata y trigo. Dividieron los datos en conjuntos de entrenamiento, validación y prueba para evitar sobreajuste y compararon su modelo con técnicas estándar de aprendizaje profundo y métodos tradicionales de aprendizaje automático. Su sistema multimodal alcanzó de manera consistente más del 90 por ciento de precisión en la identificación del tipo de cultivo y del estado de salud, además de realizar predicciones más rápidas que los modelos de referencia. Es importante destacar que, cuando una fuente de datos se degradó —por ejemplo, imágenes de drones afectadas por sombras— el sistema pudo mantener una alta precisión apoyándose más en la información del suelo y del satélite.

Qué significa esto para los agricultores

La conclusión del estudio es que combinar las vistas del cielo al suelo permite a los ordenadores evaluar la salud de los cultivos de forma más fiable que los observadores humanos o las herramientas de sensor único. Para los agricultores, eso podría traducirse en advertencias más tempranas sobre brotes de enfermedades, un uso más preciso del agua y los productos químicos, menores costes de mano de obra y, en última instancia, mayores rendimientos con menos impacto ambiental. Aunque el sistema actual todavía depende de una buena conectividad para enviar datos a la nube, versiones futuras podrían ejecutarse directamente en drones o dispositivos edge en el campo. Si se implementa a escala, estos guardianes agrícolas inteligentes y multiojos podrían convertirse en una piedra angular de una agricultura verdaderamente sostenible y basada en datos.

Cita: Pal, A.K., Patro, B.D.K. & Chaube, S. Design and implementation of a deep learning framework for automated crop classification and health diagnosis in precision agriculture. Sci Rep 16, 11436 (2026). https://doi.org/10.1038/s41598-026-42151-5

Palabras clave: agricultura de precisión, detección de enfermedades de cultivos, aprendizaje profundo, imágenes de dron y satélite, agricultura inteligente