Clear Sky Science · es

GWKNN: un algoritmo k-vecinos más cercanos mejorado con reconstrucción de la métrica G y Optimizador Lobo Gris

Reconocimiento de patrones más inteligente para el aluvión de datos actual

Desde exploraciones médicas hasta transacciones bancarias, la vida moderna genera océanos de datos. Mucha de esta información debe ser clasificada automáticamente en categorías: sano o enfermo, fraudulento o normal, spam o legítimo. Un caballo de batalla clásico para este tipo de tareas es el algoritmo k-vecinos más cercanos (KNN), que etiqueta un caso nuevo observando los ejemplos pasados más parecidos. Sin embargo, a medida que los conjuntos de datos crecen, se vuelven más complejos y más desbalanceados, esta idea simple empieza a fallar. El artículo presenta GWKNN, una versión renovada de KNN diseñada para aprovechar mejor las distancias entre puntos y tratar los casos raros pero importantes de forma más justa.

Por qué la similitud simple se queda corta

El KNN convencional asume que todas las características de un punto de datos contribuyen por igual y mide la similitud con una distancia euclídea estándar. Eso puede funcionar bien cuando los datos son de baja dimensión y están bien separados, pero los datos del mundo real suelen ser de alta dimensión, ruidosos y una mezcla de distintos tipos de información. En esos casos, la distancia habitual puede ser engañosa, haciendo que el algoritmo elija vecinos poco útiles. Al mismo tiempo, muchos conjuntos de datos están desequilibrados: las categorías comunes dominan, mientras que las categorías raras pero cruciales, como una enfermedad en estadio inicial, están subrepresentadas. Cuando KNN vota entre ejemplos cercanos, la clase mayoritaria tiende a ahogar a esas minorías, conduciendo a decisiones sesgadas y, a veces, peligrosas.

Enseñar al algoritmo un sentido de distancia mejor

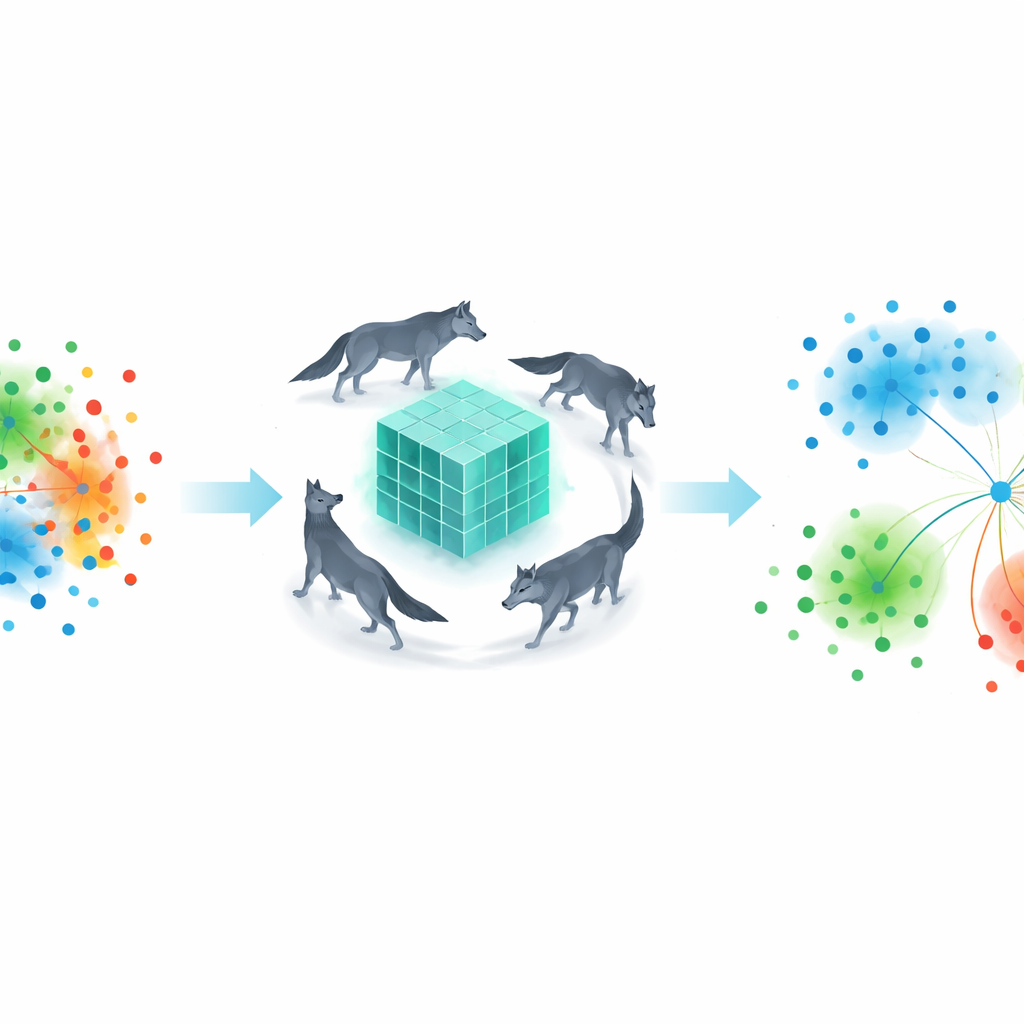

La primera innovación importante en GWKNN es una medida de distancia aprendida. En lugar de fijar la regla euclídea habitual, los autores permiten que el algoritmo descubra cómo deben separarse los puntos de datos de manera que las categorías queden mejor diferenciadas. Codifican esto como una métrica flexible “G” que remodela el espacio para que las características informativas pesen más y las redundantes pesen menos. Para ajustar esta métrica, el método toma inspiración del comportamiento de caza de los lobos grises. Un procedimiento de inteligencia de enjambre, llamado Optimizador Lobo Gris, explora muchas maneras posibles de estirar y comprimir el espacio de datos, conservando aquellas que reducen los errores de clasificación mientras mantienen la estabilidad matemática. Tras muchas iteraciones, los “lobos” virtuales convergen en una regla de distancia que hace que los puntos similares se agrupen de forma más fiable, incluso en conjuntos enredados y de alta dimensión.

Darles una voz más fuerte a los casos raros

La segunda mejora aborda el sesgo de voto. El KNN estándar simplemente cuenta cuántos de los k vecinos pertenecen a cada clase y elige la mayoría. GWKNN, en cambio, pondera cada voto según lo común que sea esa clase en los datos de entrenamiento. A las clases que aparecen menos a menudo se les asignan pesos mayores; a las muy frecuentes, pesos menores. Un pequeño término de suavizado evita que las categorías extremadamente raras dominen la decisión. De este modo, si un punto nuevo está cerca de un puñado de ejemplos de una clase minoritaria y de muchos ejemplos de la clase mayoritaria, las señales de la minoría no se ahogan automáticamente. El esquema es sencillo de calcular pero tiene un efecto potente: empuja al clasificador a prestar más atención a patrones raros pero significativos, mejorando la equidad y la sensibilidad para las clases minoritarias.

Poniendo a prueba el nuevo método

Para determinar si GWKNN realmente ayuda en la práctica, los autores lo evaluaron en 12 conjuntos de referencia del conocido repositorio UCI. Estas colecciones abarcan datos financieros, medidas médicas, escritura a mano, semillas de plantas y varios conjuntos de expresión génica y cáncer de alta dimensión, con problemas tanto binarios como multiclase. Compararon cuatro versiones de KNN: la base simple, una versión solo con la nueva métrica de distancia, una versión solo con los nuevos pesos de voto y la GWKNN completa que combina ambas ideas. También enfrentaron GWKNN contra siete clasificadores ampliamente usados, incluidos máquinas de vectores de soporte, árboles de decisión, bosques aleatorios, regresión logística, naive Bayes y una red neuronal. A través de particiones repetidas de entrenamiento y prueba, registraron no solo la precisión media sino también la variabilidad de los resultados.

Resultados: más preciso y más consistente

El enfoque combinado GWKNN resultó ganador o empatado como mejor rendimiento en la mayoría de los conjuntos de datos, particularmente en aquellos con muchas características y tamaños de clase desiguales. En tareas relativamente simples, todos los métodos funcionaron bien y las mejoras fueron modestas, pero GWKNN seguía tendiendo a aumentar ligeramente la precisión y a reducir la variabilidad. En conjuntos de expresión génica más difíciles, con miles de características, las ventajas fueron más claras: la métrica de distancia aprendida ayudó al algoritmo a formar vecindarios más significativos y el voto ponderado mejoró el reconocimiento de clases subrepresentadas. Pruebas estadísticas a lo largo de todos los conjuntos confirmaron que las clasificaciones de GWKNN eran significativamente mejores que las del KNN estándar y algunos modelos clásicos, lo que indica que sus mejoras no son meras fluctuaciones afortunadas sino robustas frente a diferentes condiciones de datos.

Qué significa esto para las decisiones de datos cotidianas

Para no especialistas, la conclusión es que GWKNN refina una idea muy intuitiva—“mirar casos pasados similares”—para ajustarla mejor a la realidad desordenada de los datos modernos. Al aprender cómo medir la similitud de forma dirigida por los datos y al aumentar la influencia de las categorías raras durante la votación, el método aspira a ser tanto más preciso como más justo. Aunque esta sofisticación adicional conlleva un coste computacional mayor, especialmente para conjuntos muy grandes y de alta dimensión, GWKNN muestra un fuerte potencial para tareas donde la clasificación correcta de casos minoritarios realmente importa, como la detección temprana de enfermedades o la identificación de fraudes. El trabajo ilustra cómo los algoritmos clásicos pueden actualizarse con ideas de optimización y equidad para seguir el ritmo de la escala y complejidad de la información actual.

Cita: Guo, Z., Liu, G., Liu, W. et al. GWKNN: an enhanced k-nearest neighbor algorithm with G metric reconstruction and Grey Wolf Optimizer. Sci Rep 16, 8857 (2026). https://doi.org/10.1038/s41598-026-41851-2

Palabras clave: k-vecinos más cercanos, aprendizaje de métricas de distancia, desequilibrio de clases, <keyword>clasificación de datos