Clear Sky Science · es

Un modelo explicable de vision transformer con aprendizaje por transferencia para la clasificación precisa de enfermedades en hojas de frijol

Por qué las hojas enfermas del frijol importan a todos

Los frijoles son un alimento básico para cientos de millones de personas, especialmente en países en desarrollo, y suministran proteína y fibra a bajo coste. Sin embargo, dos enfermedades foliares comunes —mancha angular y roya del frijol— pueden reducir silenciosamente la producción en los campos, poniendo en riesgo tanto la alimentación como los ingresos de los agricultores. Este estudio explora cómo un nuevo tipo de inteligencia artificial puede detectar estas enfermedades de forma temprana y, lo que es crucial, mostrar a los agricultores exactamente lo que ve, transformando una caja negra misteriosa en una herramienta comprensible y de confianza.

Amenazas ocultas en hojas cotidianos

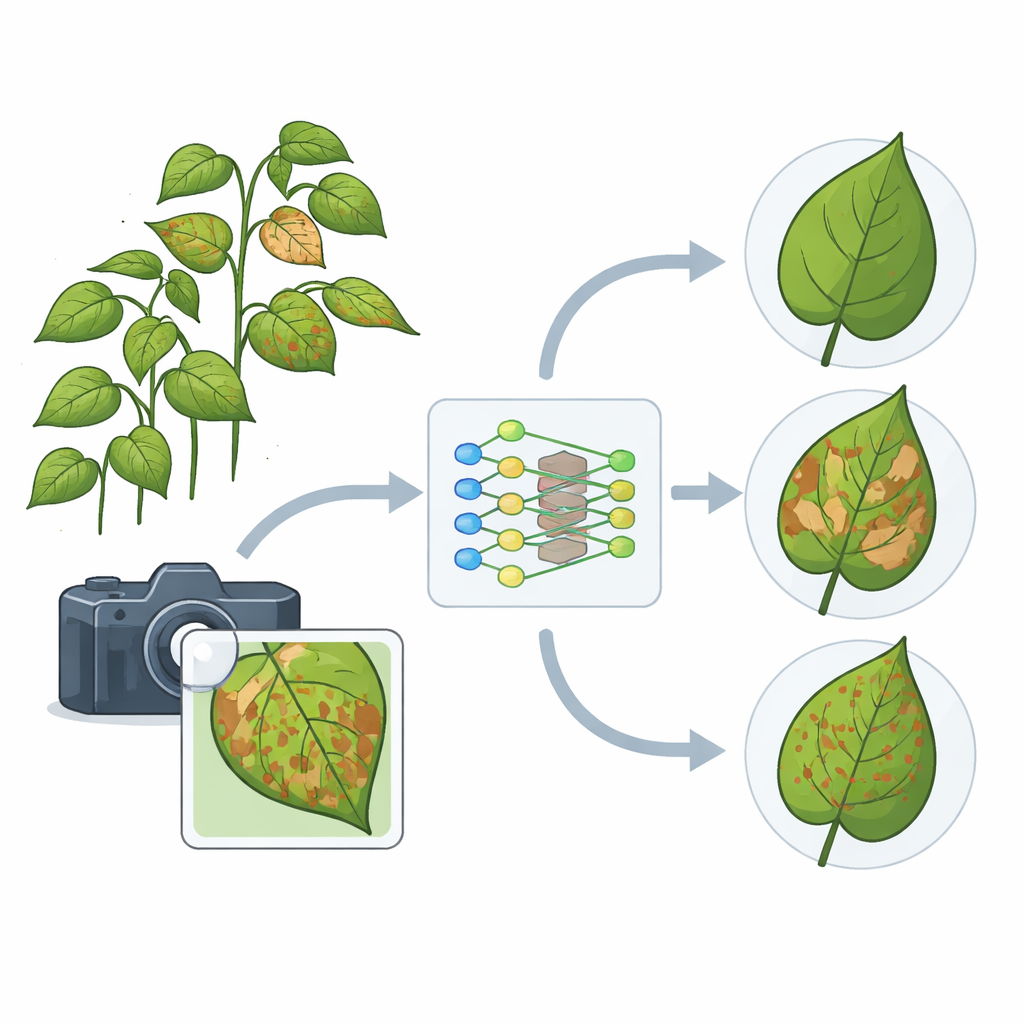

Las plantas de frijol están constantemente bajo ataque de invasores fúngicos que marcan sus hojas, reducen la fotosíntesis y provocan cosechas más pequeñas y de peor calidad. Tradicionalmente, los expertos recorren los campos para detectar problemas, pero ese proceso es lento, subjetivo y poco realista a gran escala. Mientras tanto, muchos sistemas modernos de IA que analizan fotos de plantas pueden ser extraordinariamente precisos, pero siguen siendo opacos para los usuarios: entregan una etiqueta de enfermedad sin ninguna explicación. Para los agricultores que deben tomar decisiones de alto impacto sobre fumigación, replantado o cosecha, confiar ciegamente en un algoritmo silencioso es una apuesta arriesgada.

Una forma más inteligente de leer imágenes de hojas

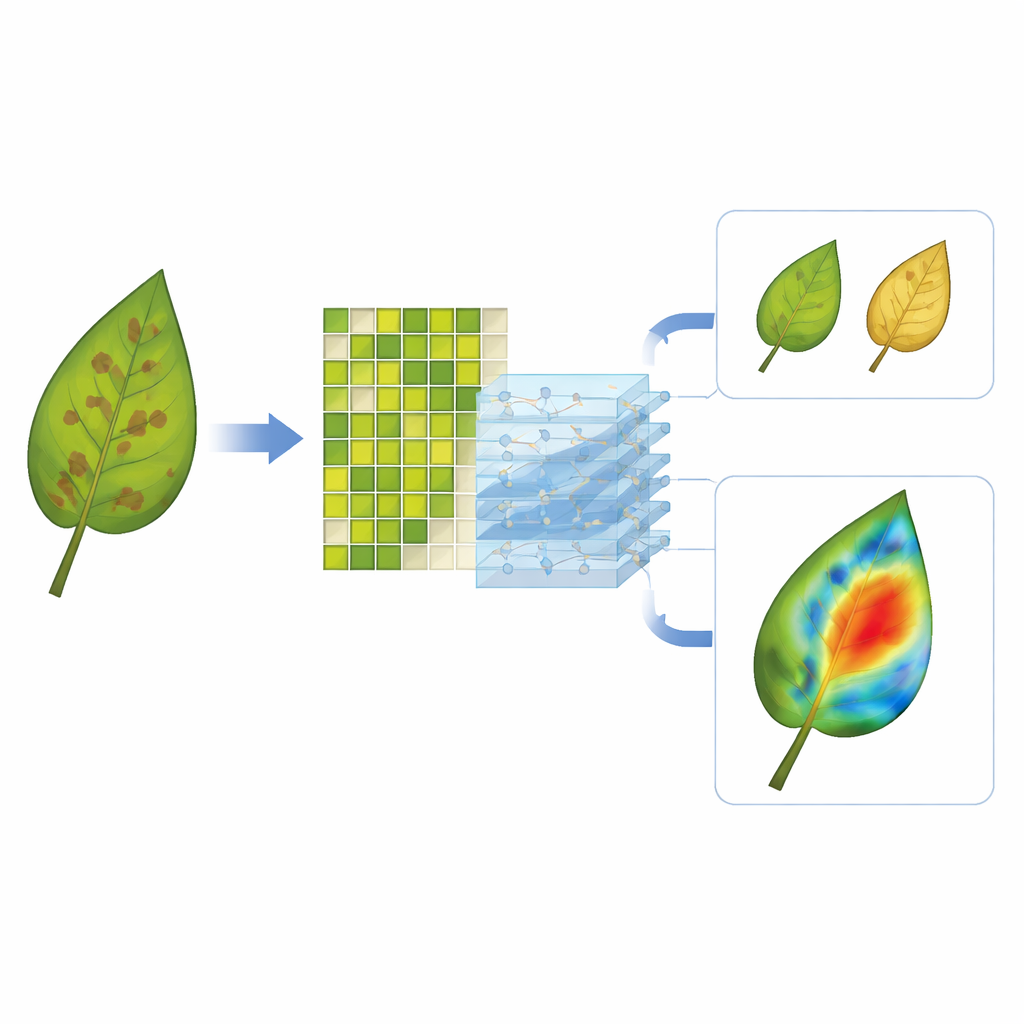

Los investigadores proponen un sistema de diagnóstico automatizado basado en un “vision transformer”, una familia relativamente nueva de modelos de imagen que ha venido transformando la visión por computador. En vez de escanear una imagen con pequeños filtros deslizantes, este modelo divide una foto de hoja en muchos pequeños fragmentos y aprende cómo se relacionan todos esos fragmentos entre sí a la vez. Esa visión global le ayuda a detectar signos sutiles y dispersos de enfermedad que los métodos anteriores podrían pasar por alto. Para superar la necesidad habitual de conjuntos de entrenamiento enormes, el equipo parte de un modelo ya entrenado con millones de imágenes generales y luego ajusta (fine-tune) sus capas finales con hojas de frijol, una estrategia conocida como aprendizaje por transferencia.

Convertir cajas oscuras en cajas transparentes

Lo que hace que este sistema destaque no es solo lo bien que clasifica las hojas como sanas, con mancha angular o con roya del frijol, sino lo claramente que muestra su trabajo. Los autores integran una técnica de explicabilidad llamada GradCAM++, que convierte las señales internas del modelo en un mapa de calor sobre la foto original. Las regiones brillantes en la hoja corresponden a las manchas y pústulas que más influyeron en la decisión. En hojas enfermas, la atención del modelo se concentra en las lesiones características; en hojas sanas, distribuye la atención de forma amplia en lugar de fijarse en texturas de fondo al azar. Esto crea un bucle de retroalimentación visual en el que agrónomos y agricultores pueden verificar que el modelo se está centrando en síntomas reales y no en tierra, dedos o artefactos de la cámara.

Poniendo el sistema a prueba

Para medir el rendimiento, el equipo utiliza un conjunto de datos público “I-Bean”, ensamblado originalmente en campos de Uganda y etiquetado por expertos en salud vegetal. Amplían considerablemente la porción de entrenamiento rotando, volteando y ajustando el color de las imágenes para simular distintos ángulos de cámara y condiciones de iluminación. Tras ajustar el modelo con este conjunto enriquecido y mantener fijo su extractor de características central, lo evalúan en un conjunto de prueba intacto. El sistema alcanza alrededor del 97,5 por ciento de precisión, con puntuaciones igualmente altas en precisión, recall y una medida F1 combinada. Las confusiones entre los tres estados de la hoja son raras, lo que sugiere que el modelo separa con fiabilidad las plantas sanas de cada tipo de enfermedad aun cuando sus diferencias visuales son sutiles.

Pasos hacia una agricultura más inteligente y justa

A pesar de su sólido rendimiento, el enfoque aún enfrenta obstáculos. Los vision transformers son computacionalmente exigentes, lo que dificulta ejecutarlos en tiempo real en teléfonos inteligentes o drones de bajo coste sin más optimización. El conjunto de datos, aunque aumentado, representa solo tres estados de enfermedad y un rango limitado de extremos de iluminación. Los autores describen líneas futuras como comprimir el modelo para que pueda vivir en dispositivos en el borde (edge), ampliar a más enfermedades y síntomas de estrés, y explorar variantes de transformer más ligeras. Si se superan estos desafíos, el resultado podría ser un asistente portátil y confiable que ayude a agricultores de todo el mundo a detectar la enfermedad temprano, salvar cosechas y gestionar recursos con mayor criterio —y que siempre pueda mostrarles exactamente por qué llegó a su conclusión.

Cita: Potharaju, S., Singh, A., Singh, D. et al. An explainable vision transformer model with transfer learning for accurate bean leaf disease classification. Sci Rep 16, 10402 (2026). https://doi.org/10.1038/s41598-026-41723-9

Palabras clave: enfermedad de la hoja del frijol, detección de enfermedades de plantas, vision transformer, IA explicable, agricultura de precisión