Clear Sky Science · es

Un sistema optimizado de servo‑visualización cualitativa HOG en tiempo real para silla de ruedas autónoma

Paseos más inteligentes para quienes más los necesitan

Para muchas personas que dependen de sillas de ruedas eléctricas, maniobrar por pasillos concurridos o aceras irregulares puede resultar fatigante, estresante o incluso imposible sin ayuda. Este artículo presenta una nueva forma para que una silla de ruedas “vea” su entorno mediante una pequeña cámara y se dirija de forma suave y segura en tiempo real, incluso usando hardware económico. Al rediseñar cuidadosamente cómo se procesa la información visual y se traduce en movimiento, el autor demuestra que la navegación inteligente de una silla puede funcionar en un ordenador diminuto y de bajo consumo manteniendo a la vez la comodidad y el control del usuario.

Por qué las sillas normales tienen problemas en la vida real

Las sillas de ruedas eléctricas tradicionales suelen manejarse directamente con un joystick o confiar en sencillos sensores de choque para evitar obstáculos. Esos enfoques a menudo fallan en espacios concurridos y cambiantes, como pasillos de hospitales, centros comerciales o aceras urbanas. Los usuarios dicen que lo que más desean es un movimiento suave y predecible y fiabilidad bajo distintas condiciones de iluminación, no velocidad bruta. Al mismo tiempo, muchos métodos robóticos avanzados que usan cámaras y matemáticas complejas requieren ordenadores potentes, que son demasiado caros y voluminosos para una silla de uso diario. Esa brecha —entre lo que necesitan los usuarios y lo que el hardware de bajo coste puede gestionar— es precisamente lo que este estudio pretende cerrar.

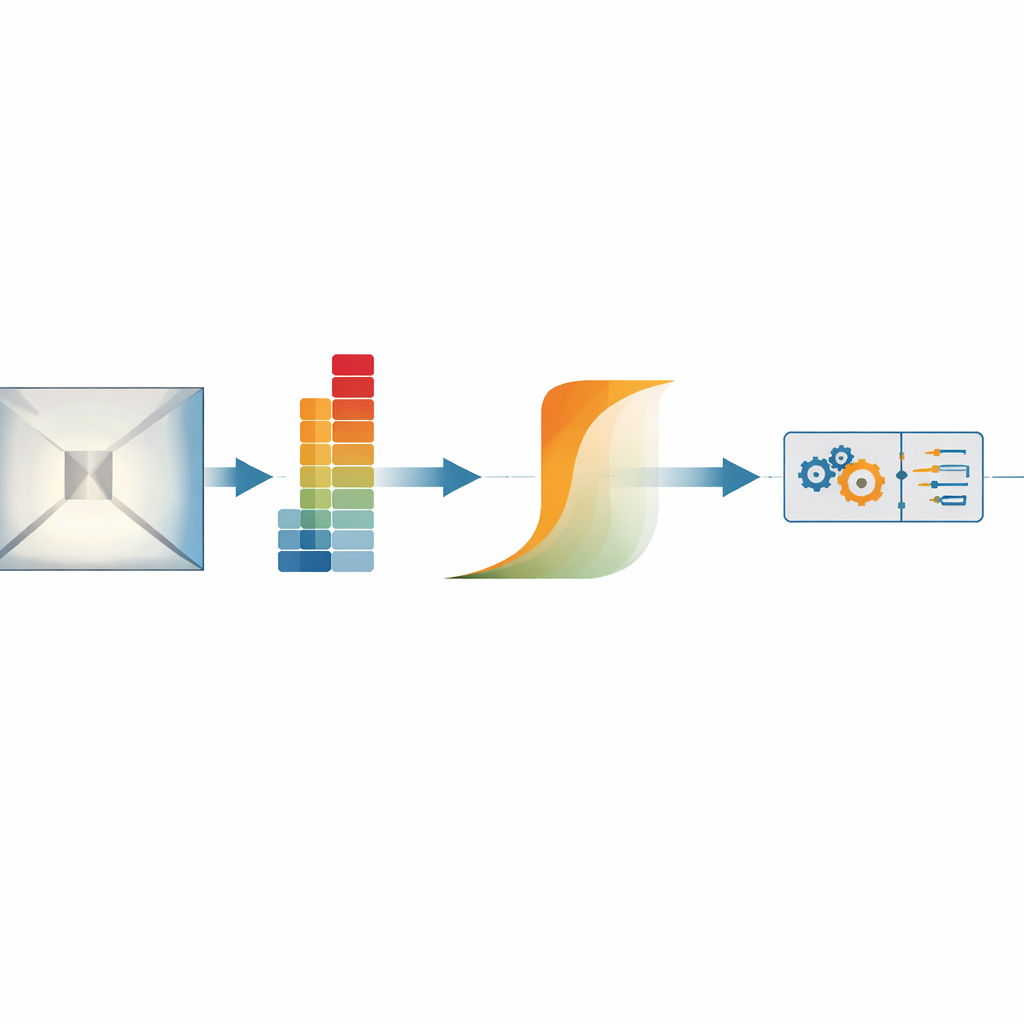

Enseñar a una silla a leer patrones en lugar de puntos

El sistema usa una cámara montada en la silla para observar la escena delante y representarla no como puntos o hitos individuales, sino como patrones de bordes y líneas conocidos como histogramas de gradiente. En términos sencillos, analiza cómo cambia la luminosidad a lo largo de la imagen y lo condensa en una huella compacta de la escena. Este tipo de descripción de patrones es naturalmente tolerante a cambios de luz y bloqueos parciales, como una persona que cruza momentáneamente la vista de la cámara. La silla compara el patrón actual con un patrón “objetivo” que corresponde a la vista deseada —por ejemplo, el aspecto de un pasillo recto o un hito al final de un trayecto— y luego ajusta su movimiento para aproximar ambos patrones.

Permitir margen de maniobra para un control más seguro

En lugar de exigir una coincidencia perfecta entre la vista actual y la objetivo, el método introduce una “zona de confianza” flexible. Si la vista de la cámara está lo bastante cerca del objetivo, el sistema de control se relaja deliberadamente, evitando correcciones nerviosas de vaivén. Esto se consigue mediante una función de activación matemática que modula gradualmente la respuesta de la dirección según el tamaño del error visual, en vez de simplemente aplicar más fuerza ante cualquier discrepancia. Como resultado, la silla puede manejar oclusiones parciales e incertidumbre visual sin sacudidas bruscas, manteniendo trayectorias suaves en tareas como seguir un pasillo o dirigirse hacia una secuencia de objetivos visuales.

Hacer que la visión avanzada funcione en un ordenador diminuto

Un reto importante es que estas ricas huellas visuales suelen ser costosas de calcular. El autor aborda esto reescribiendo los cálculos para que usen operaciones eficientes “todas a la vez” en lugar de bucles anidados lentos, reduciendo precisión innecesaria y organizando cuidadosamente el uso de la memoria. Ejecutado en una Raspberry Pi —un ordenador del tamaño de una tarjeta de crédito frecuentemente usado en proyectos amateur—, el software mejorado aumenta la velocidad de procesamiento desde niveles inoperables (alrededor de una imagen cada 12 segundos) hasta unas cinco imágenes y media por segundo. Los motores de la silla reciben comandos a una tasa mucho más rápida y constante, de modo que las ruedas se mueven suavemente mientras la cámara y el sistema de visión se actualizan en segundo plano. Se incorporan capas adicionales de seguridad, incluidos frenos de hardware y un watchdog que detiene la silla si cesan los comandos, para adecuarla al uso asistencial real.

De la teoría de laboratorio a la ayuda cotidiana

A través de experimentos en pasillos, aceras y pruebas de vídeo controladas, el sistema dirige la silla de forma consistente desde un objetivo visual a otro mientras reduce gradualmente sus correcciones de dirección al acercarse a cada blanco. El error de emparejamiento de patrones de la cámara disminuye de forma sostenida, lo que confirma que la silla se alinea visualmente sin perder de vista características importantes en el trayecto. En lenguaje claro, el estudio demuestra que un ordenador pequeño y asequible y una cámara simple son suficientes para dotar a una silla eléctrica de un “piloto automático” guiado por cámara, que respeta la comodidad y la seguridad. Esto abre la puerta a ayudas de navegación basadas en cámara más accesibles para personas con movilidad reducida y sienta las bases para futuras mejoras como percepción 3D más rica y una evitación de obstáculos aún más suave.

Cita: Hafez, A.H.A. An optimized real-time qualitative HOG-based visual servoing system for autonomous wheelchair. Sci Rep 16, 8688 (2026). https://doi.org/10.1038/s41598-026-41566-4

Palabras clave: silla de ruedas autónoma, robótica asistencial, visión por computador, navegación visual, control en tiempo real