Clear Sky Science · es

Predicción, sintaxis y anclaje semántico en el cerebro y en grandes modelos de lenguaje

Cómo tu cerebro adivina la siguiente palabra

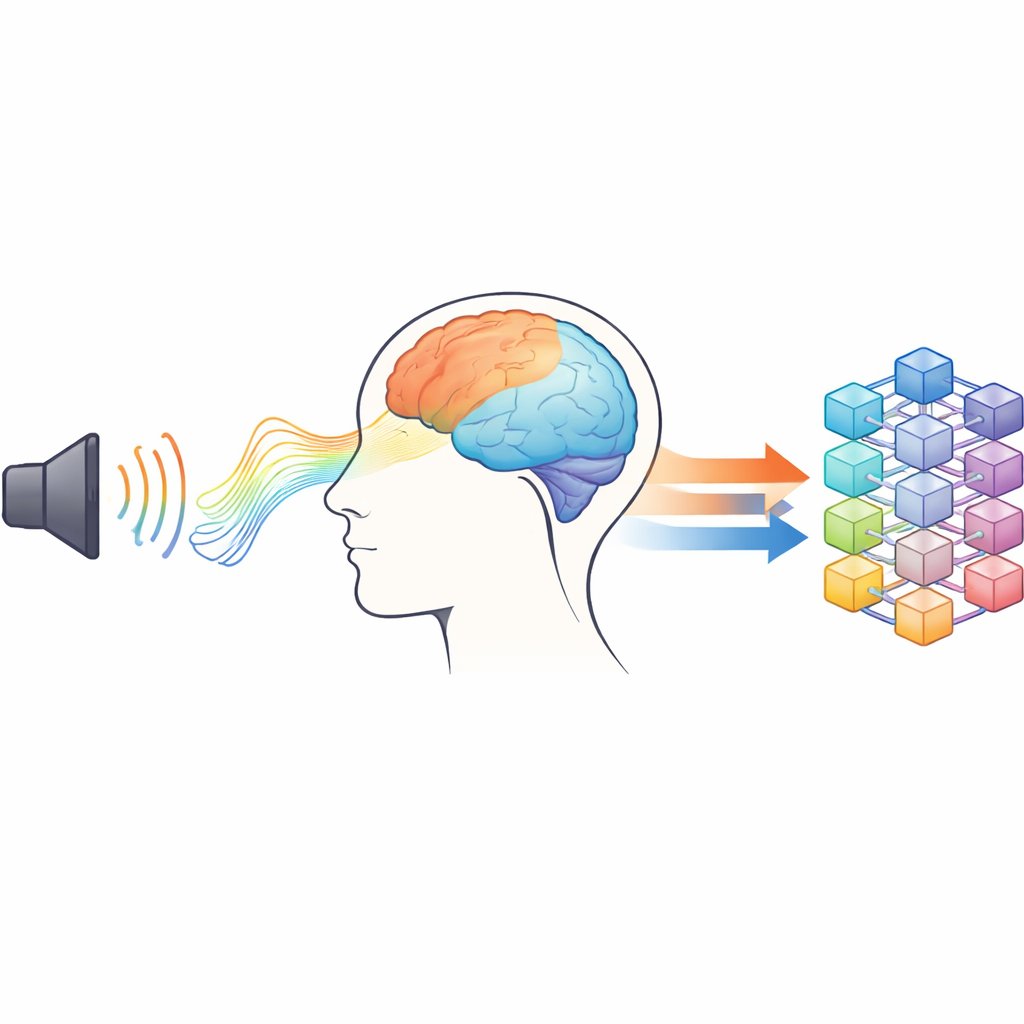

Cuando escuchas una historia, a menudo parece fácil seguirla, pero bajo la superficie tu cerebro está constantemente adivinando qué vendrá después. Al mismo tiempo, los sistemas de IA modernos, como los grandes modelos de lenguaje (LLM), también predicen las próximas palabras para generar texto fluido. Este estudio reúne esos dos mundos, preguntando cómo el cerebro humano anticipa palabras en tiempo real y cómo esos procesos se comparan con la forma en que funciona un modelo avanzado de IA.

Escuchar una historia en el laboratorio

Para estudiar la comprensión del lenguaje natural, los investigadores fueron más allá de listas artificiales de palabras o frases cortas e aisladas. En su lugar, 29 voluntarios jóvenes escucharon unos 50 minutos de un audiolibro de ciencia ficción en alemán mientras se registraba su actividad cerebral. Se utilizaron simultáneamente dos técnicas complementarias: electroencefalografía (EEG), que mide pequeños cambios de voltaje en el cuero cabelludo, y magnetoencefalografía (MEG), que detecta los campos magnéticos generados por la actividad cerebral. Juntas, estas técnicas pueden seguir las respuestas del cerebro a cada palabra con precisión milisegundaria mientras las personas siguen una historia continua.

Seguir distintos tipos de palabras

El audiolibro se dividió automáticamente en palabras individuales y se etiquetó por tipo gramatical: sustantivos (como “planeta”), verbos (como “correr”), adjetivos (como “oscuro”) y nombres propios. Para cada palabra de la historia, los científicos recortaron una ventana temporal corta de las señales de EEG y MEG antes y después de que se pronunciara la palabra y luego promediaron esos fragmentos dentro de cada clase de palabra. Esto reveló “firmas” eléctricas y magnéticas fiables para los distintos tipos de palabra, incluidos componentes bien conocidos vinculados al significado y a la estructura oracional. De forma importante, el equipo halló que la actividad para los sustantivos empezaba a acumularse incluso antes de que la palabra comenzara, lo que sugiere que el cerebro estaba especialmente preparado para ese tipo de palabra en contexto.

Dónde se encuentran significado y movimiento

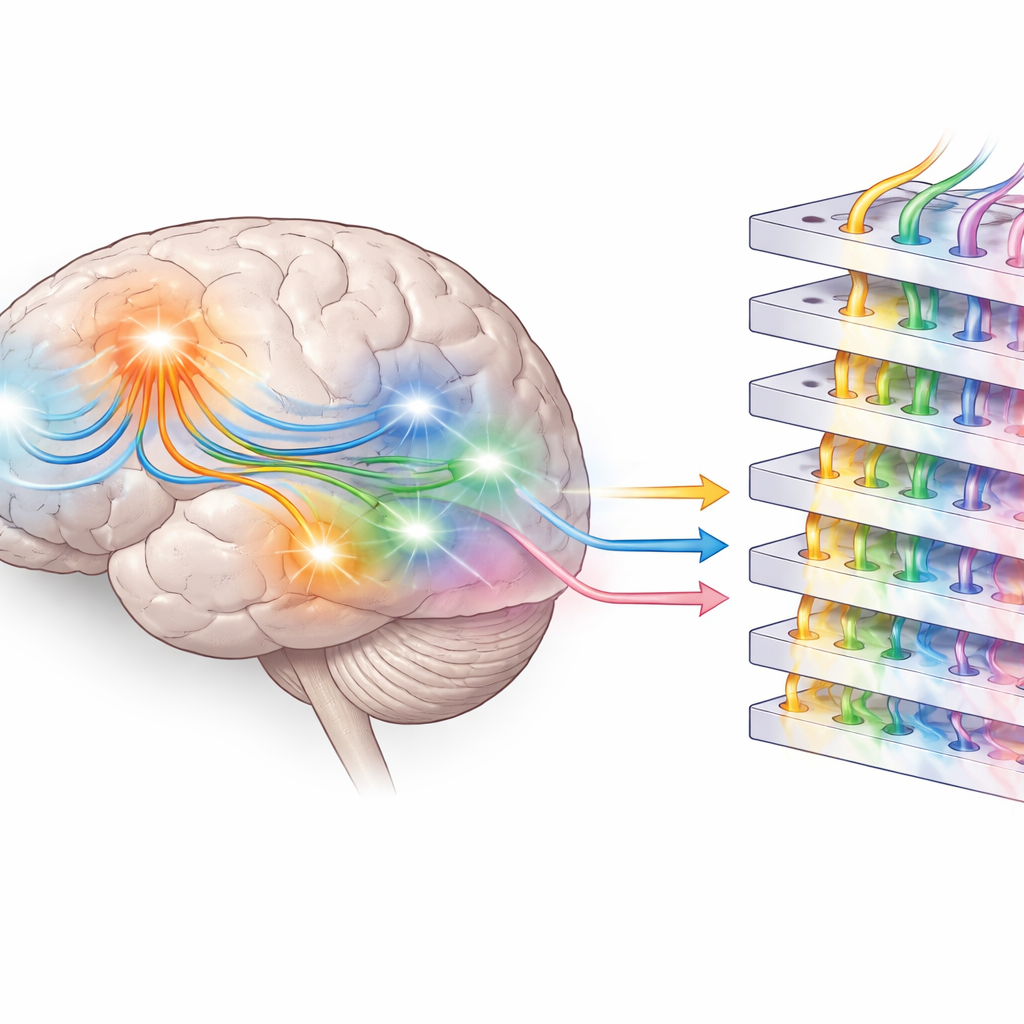

Para ver en qué zonas del cerebro surgían estas señales, los investigadores utilizaron modelos informáticos para estimar las posibles fuentes de los patrones de MEG y EEG en el interior de la cabeza. Los sustantivos no solo activaron las clásicas regiones del lenguaje en los lóbulos temporales; también implicaron áreas compatibles con partes del sistema sensoriomotor, cerca de regiones relacionadas con el movimiento y la sensación corporal. Los verbos, en contraste, mostraron un patrón distinto y más limitado. Esto respalda la idea de un lenguaje “encarnado”, en el que comprender una palabra—especialmente un sustantivo concreto—reactiva en parte redes ligadas a la percepción y la acción, anclando el significado en experiencias sensoriales pasadas en lugar de en reglas abstractas únicamente.

Comparando cerebros y grandes modelos de lenguaje

El equipo recurrió entonces al modelo de lenguaje Llama 3.2 de Meta como punto de referencia computacional. Primero probaron la “predicción semántica” alimentando al modelo con el contexto precedente del audiolibro y preguntando cuán probable consideraba la verdadera siguiente palabra. Resultó que los sustantivos eran los más fáciles de predecir para el modelo, lo que coincide con su papel central en la construcción de la historia. A continuación, los investigadores exploraron la “predicción sintáctica” examinando las activaciones internas, o incrustaciones, dentro de Llama. Incluso sin entrenamiento adicional, las capas ocultas del modelo agruparon de forma natural las palabras según el tipo gramatical de la palabra siguiente, y una simple red sonda podía a menudo indicar qué clase de palabra vendría a continuación. A través de las capas, la estructura interna para nombres propios y sustantivos se volvió más distintiva, haciendo eco de la separación creciente de roles observada en los patrones de actividad cerebral.

Dos tipos de preparación para las palabras

En conjunto, los resultados sugieren que el cerebro se prepara para el lenguaje entrante en al menos dos niveles. En regiones temporales, la actividad antes del inicio de la palabra parece reflejar una especie de preparación gramatical o “sintáctica”: conocimiento sobre dónde tienden a aparecer ciertos tipos de palabra en una oración. En regiones más frontales y sensoriomotoras, los patrones de preparación parecen portar expectativas “semánticas” más ricas, ligadas al significado y a la experiencia, especialmente para sustantivos y nombres. Los grandes modelos de lenguaje, entrenados únicamente para predecir la siguiente palabra, desarrollan sus propias estructuras internas por capas que reflejan en parte estas distinciones, pero carecen de un anclaje directo en el mundo físico. Al combinar registros cerebrales de alta velocidad con análisis de la IA de última generación, este trabajo ayuda a clarificar cómo los humanos anticipan palabras durante la escucha cotidiana y hasta qué punto las máquinas actuales han llegado a aproximarse a esa característica esencial de la comprensión del lenguaje humano.

Cita: Kölbl, N., Rampp, S., Kaltenhäuser, M. et al. Prediction, syntax and semantic grounding in the brain and large language models. Sci Rep 16, 8728 (2026). https://doi.org/10.1038/s41598-026-41532-0

Palabras clave: predicción del lenguaje, cerebro e IA, grandes modelos de lenguaje, anclaje semántico, EEG MEG lenguaje