Clear Sky Science · es

Marco de privacidad estocástico incrustado con Poisson para aprendizaje federado con cifrado homomórfico seguro en IA médica

Mantener a salvo los secretos médicos mientras se entrena a las máquinas

Los hospitales están recopilando enormes cantidades de radiografías que podrían ayudar a los médicos a detectar enfermedades como la COVID‑19 antes y con mayor precisión. Pero esas imágenes también son profundamente personales, y las estrictas normas de privacidad dificultan reunir los datos en un solo lugar para entrenar potentes herramientas de inteligencia artificial (IA). Este estudio presenta una forma de permitir que los hospitales cooperen en un sistema compartido de diagnóstico por rayos X sin entregar nunca sus imágenes en bruto a nadie, con el objetivo de mantener los datos de los pacientes protegidos y, al mismo tiempo, alcanzar una precisión de primer nivel.

Por qué es tan difícil compartir datos médicos

La IA moderna prospera con conjuntos de datos grandes y variados, sin embargo los hospitales normalmente almacenan las imágenes localmente y son reacios—o legalmente incapaces—de enviarlas a un servidor central. Los enfoques tradicionales que copian todos los datos en una gran base de datos corren el riesgo de filtraciones y ciberataques, socavando la confianza pública y violando normativas. Incluso métodos más recientes, en los que los hospitales entrenan un modelo compartido conjuntamente en una configuración llamada “aprendizaje federado”, no son completamente seguros: atacantes hábiles a veces pueden invertir el proceso a partir de las actualizaciones del modelo para adivinar cómo eran las imágenes de los pacientes. Al mismo tiempo, los datos médicos suelen ser desiguales y heterogéneos, con algunos hospitales que disponen de muchos más casos de una enfermedad concreta que otros, lo que puede desestabilizar el entrenamiento y reducir la fiabilidad.

Una red cooperativa que nunca comparte radiografías en bruto

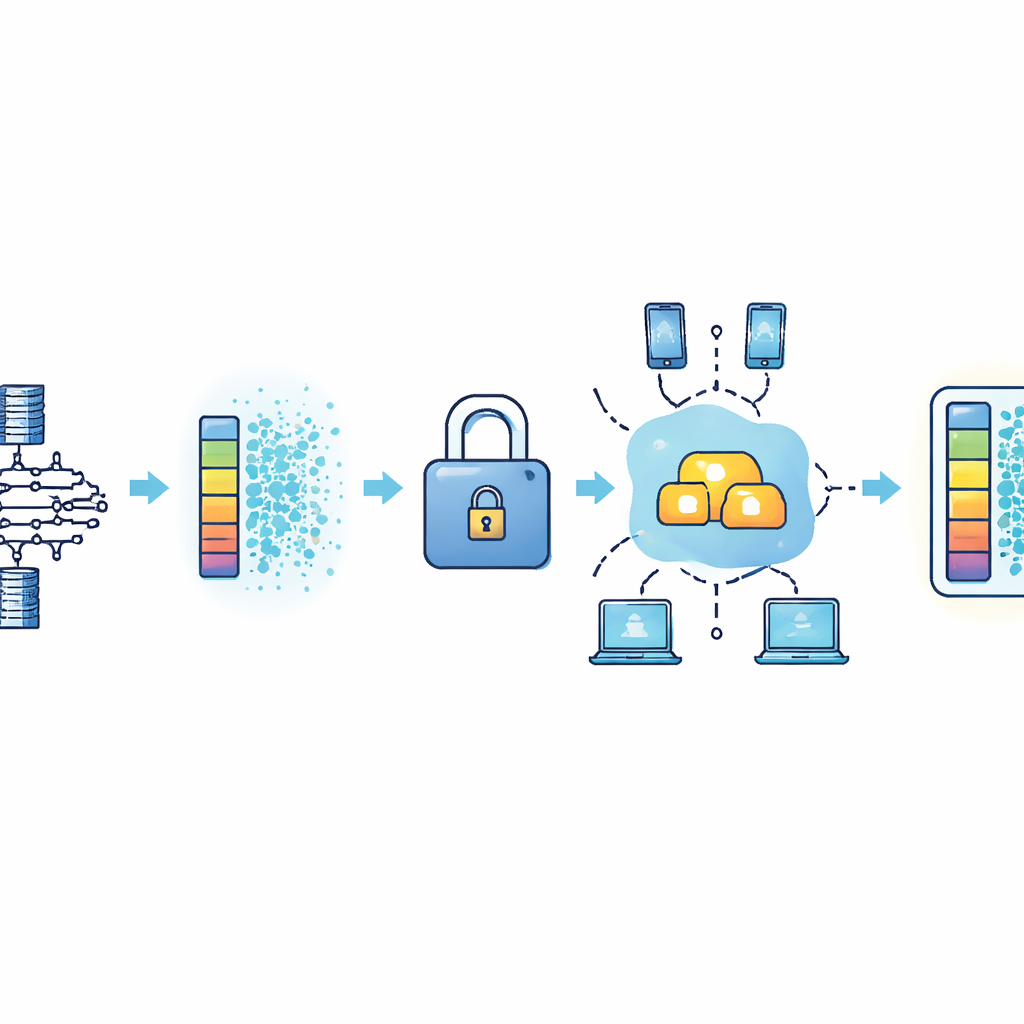

Los autores diseñan un marco de aprendizaje federado centrado en un potente modelo de reconocimiento de imágenes conocido como ResNet‑50 para distinguir COVID‑19 de radiografías torácicas normales. Cada hospital entrena su propia copia de este modelo con sus imágenes locales, manteniendo todas las radiografías in situ. En lugar de enviar imágenes, los hospitales solo remiten actualizaciones numéricas que describen cómo debe cambiar su modelo local. Un servidor central promedia estas actualizaciones para formar un modelo global mejorado y luego envía el modelo refinado de vuelta a cada hospital. Repetir este ciclo permite que el modelo compartido se beneficie de la experiencia combinada de todos los participantes sin exponer exploraciones individuales.

Añadir “ruido” digital y cajas fuertes para mayor privacidad

Para impedir que atacantes reconstruyan imágenes de pacientes a partir de las actualizaciones del modelo, el marco superpone dos técnicas de privacidad sobre el aprendizaje federado. Primero, cada hospital añade ruido aleatorio cuidadosamente calibrado a sus actualizaciones del modelo, algo así como agregar estática a una señal de radio para que las voces individuales sean más difíciles de distinguir mientras el mensaje general sigue siendo audible. Segundo, antes de que las actualizaciones viajen por la red, se cifran mediante un método que permite al servidor sumarlas mientras permanecen bloqueadas—similar a sumar valores dentro de sobres sellados. Solo un titular de clave de confianza puede desbloquear el resultado combinado, y el servidor central nunca ve la actualización de ningún hospital en forma clara. Estas medidas, en conjunto, están diseñadas para frustrar los intentos de ingeniería inversa sobre los datos de los pacientes sin sacrificar la utilidad del modelo compartido.

Poner el sistema a prueba

El equipo evalúa su marco con un conjunto equilibrado de radiografías torácicas de COVID‑19 y normales, simulando varios hospitales como sitios de entrenamiento separados. Comparan tres configuraciones: entrenamiento centralizado clásico con todos los datos agrupados, aprendizaje federado estándar sin protecciones adicionales, y su enfoque mejorado en privacidad. A pesar del ruido y el cifrado añadidos, el sistema protegido alcanza puntuaciones sorprendentemente altas—alrededor del 99,6% de precisión, con valores igualmente sólidos de precisión, recall y F1—igualando o superando tanto la versión agrupada como la federada sin protección. Las medidas de rondas de comunicación, pérdida de entrenamiento y tiempo de cómputo muestran que la precisión mejora de forma constante a medida que los sitios colaboran, mientras que el coste temporal adicional por el cifrado se mantiene moderado. Experimentos de ablación, en los que partes del sistema se activan o desactivan, confirman que los niveles de ruido elegidos y la estrategia de cifrado más compresión ofrecen una privacidad fuerte con solo ligeros compromisos de rendimiento.

Qué significa esto para la atención futura

Para el público general, el mensaje clave es que este trabajo demuestra una receta práctica para enseñar a la IA a partir de las radiografías de muchos hospitales sin exponer nunca las imágenes en bruto ni debilitar las leyes de privacidad. Al combinar un modelo de imagen de alto rendimiento con “estática” digital y agregación cifrada, el marco muestra que los hospitales pueden construir conjuntamente herramientas diagnósticas precisas manteniendo los registros de los pacientes en el lugar y fuera del alcance de miradas indiscretas. Aunque se probó en un conjunto de datos relativamente pequeño y centrado en radiografías por COVID‑19, las mismas ideas podrían extenderse a otras enfermedades, tipos de imagen e incluso a otros campos sensibles como las finanzas. En resumen, el estudio apunta hacia un futuro en el que una IA potente y una sólida privacidad médica puedan reforzarse mutuamente en lugar de oponerse.

Cita: Gomathi, R., Saranya, K., Mahaboob John, Y.M. et al. Stochastic Poisson-embedded privacy framework for federated learning with secure homomorphic encryption in medical AI. Sci Rep 16, 10931 (2026). https://doi.org/10.1038/s41598-026-41469-4

Palabras clave: aprendizaje federado, imagen médica, privacidad de datos, cifrado homomórfico, diagnóstico por rayos X