Clear Sky Science · es

Inteligencia humana frente a artificial en el diagnóstico de patología oral: un estudio comparativo de ChatGPT, Grok y MANUS

Por qué esto importa para su próxima visita dental

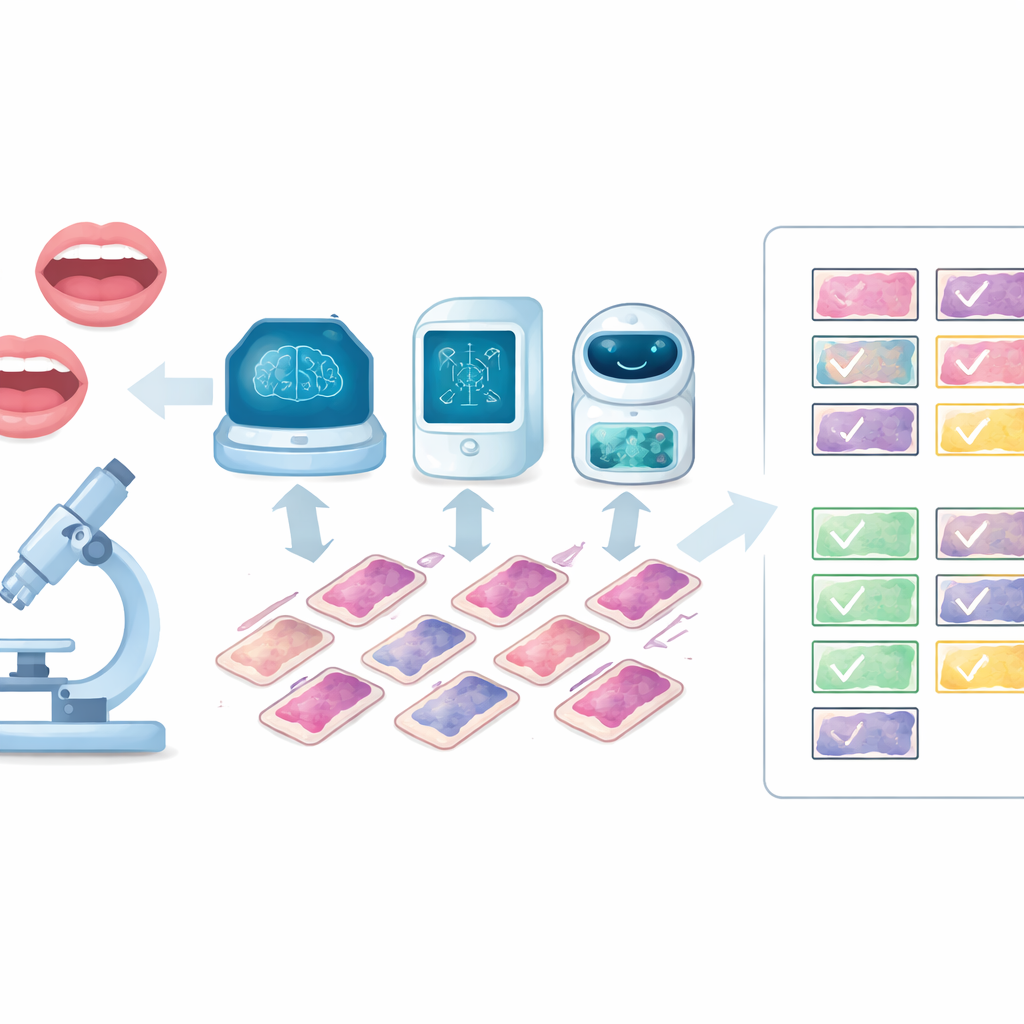

Cuando un dentista detecta una lesión sospechosa en la boca, la palabra final sobre si es inocua o peligrosa suele provenir de un especialista que examina el tejido al microscopio. Este trabajo es minucioso, consume tiempo y, en muchas partes del mundo, no hay suficientes expertos. Este estudio plantea una pregunta pertinente: ¿pueden los modernos sistemas de inteligencia artificial ayudar a leer estas imágenes microscópicas de tejidos bucales con una precisión cercana a la de los especialistas humanos, haciendo el diagnóstico más rápido, más consistente y más disponible?

Qué se propusieron evaluar los investigadores

El equipo se centró en tres programas informáticos avanzados conocidos por comprender tanto imágenes como lenguaje: ChatGPT, Grok y un sistema médico llamado MANUS. En lugar de usar datos de pacientes reales, tomaron 100 imágenes microscópicas claras y de alta calidad de un libro de texto estándar de enfermedades orales. Cada imagen mostraba un tipo diferente de problema, que iba desde cambios pre‑cancerosos tempranos hasta tumores, quistes y crecimientos reactivos. Dos patólogos orales experimentados acordaron primero el diagnóstico correcto para cada lámina, creando un sólido estándar humano contra el cual comparar a las máquinas.

Cómo funcionó la comparación cara a cara

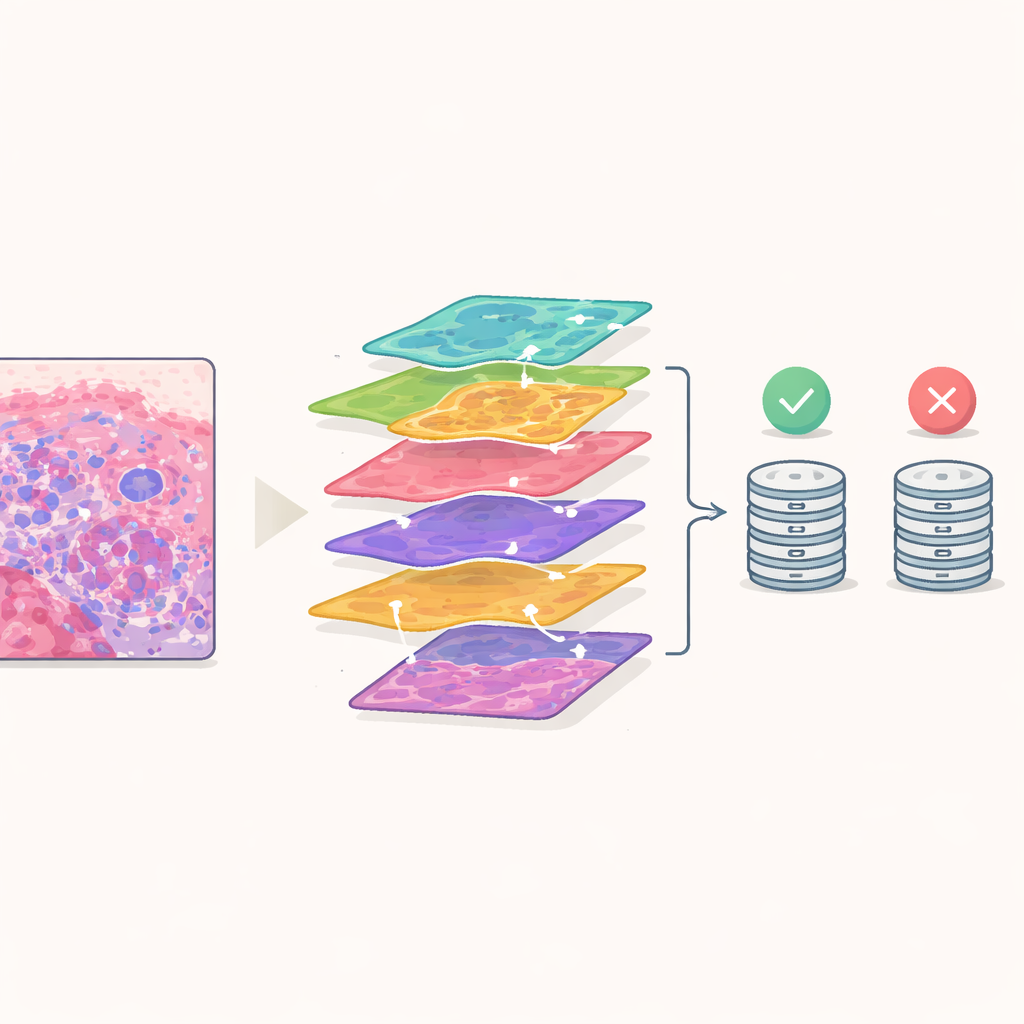

Cada una de las 100 láminas se mostró a los tres sistemas de IA usando el mismo mensaje corto que describía el caso y la misma imagen digital. Se pidió a los modelos que nombraran el diagnóstico más probable único, tal como lo haría un especialista al emitir un informe. Para ver si los sistemas daban respuestas estables a lo largo del tiempo, los investigadores repitieron todo el proceso dos semanas después con las mismas láminas e instrucciones. Mientras tanto, los dos patólogos humanos leyeron las láminas de forma independiente sin ver los resultados de la IA y luego discutieron las diferencias hasta acordar una decisión final. Estas decisiones de los expertos se consideraron la mejor respuesta disponible.

Qué tan bien rindieron las máquinas y los humanos

Las tres herramientas de IA lo hicieron sorprendentemente bien. En la segunda ronda de pruebas, Grok identificó correctamente 97 de los 100 casos, MANUS 96 y ChatGPT 94. El par de especialistas humanos obtuvo una puntuación ligeramente superior, clasificando correctamente 98 láminas. ChatGPT destacó por ofrecer respuestas casi idénticas en ambas rondas, mostrando una consistencia interna muy fuerte, mientras que MANUS y Grok también mostraron un rendimiento sólido y estable. Cuando se compararon entre sí, los sistemas coincidieron en la gran mayoría de los casos, lo que sugiere que distintos diseños de IA pueden llegar a juicios muy similares cuando se les dan imágenes de alta calidad.

Qué tan cerca estuvo la IA del razonamiento de los expertos

Acierto del diagnóstico es solo parte de la historia; también importa si los ordenadores tienden a coincidir con los patrones de razonamiento humanos. Aquí, MANUS mostró la mayor alineación con las decisiones de los patólogos, incluso cuando no superó a Grok en precisión bruta. Grok, aunque ligeramente más preciso en general, a veces llegó a elecciones diferentes de las de los expertos en los pocos casos difíciles. La mayoría de los errores de los tres sistemas surgieron en láminas que eran visualmente confusas incluso para ojos entrenados, donde los cambios tisulares se solapaban o parecían limítrofes entre dos condiciones. Aun así, no hubo brechas de rendimiento importantes entre los modelos, y los tres mostraron niveles de concordancia con los humanos que los autores describen como moderados a sustanciales.

Qué podría significar esto para la atención futura

El estudio sugiere que los sistemas multimodales de IA actuales ya son capaces de servir como ayudantes fiables en el diagnóstico microscópico de enfermedades orales. No son un reemplazo de los patólogos, que aún mantienen la mejor precisión global y aportan el juicio clínico esencial, pero podrían actuar como segundos lectores rápidos, apoyar la formación de nuevos especialistas u ofrecer asistencia de nivel experto en regiones con acceso limitado a servicios de patología dental. Dado que la investigación utilizó imágenes de libro de texto cuidadosamente seleccionadas en lugar de muestras reales desordenadas del mundo clínico, los autores subrayan que se necesita más prueba en colecciones clínicas mayores y más variadas y con información adicional del paciente. Si estas comprobaciones posteriores confirman la promesa inicial, la IA podría hacer que el diagnóstico de enfermedades bucales sea más preciso, coherente y accesible para pacientes en todo el mundo.

Cita: Alshammari, A.F., Madfa, A.A. & Anazi, B.A. Human versus artificial intelligence in oral pathology diagnosis: a comparative study of ChatGPT, Grok, and MANUS. Sci Rep 16, 11057 (2026). https://doi.org/10.1038/s41598-026-40792-0

Palabras clave: patología oral, patología digital, inteligencia artificial, modelos de lenguaje a gran escala, diagnóstico histopatológico