Clear Sky Science · es

Abrir la caja negra: IA explicable para el análisis automatizado de bioturbación en testigos y afloramientos

Ver pistas ocultas en el barro antiguo

Cuando los animales excavan a través del lodo blando del lecho marino, dejan detrás un laberinto de túneles que puede conservarse durante millones de años. Estos patrones sutiles, llamados bioturbación, ayudan a los geólogos a interpretar ambientes pasados e incluso a localizar yacimientos de petróleo y gas. Pero detectar y clasificar estas trazas a simple vista es un proceso lento y subjetivo. Este estudio muestra cómo una nueva generación de inteligencia artificial "explicable" puede no solo automatizar esa tarea, sino también revelar exactamente en qué está fijando la atención el ordenador, transformando una caja negra en una caja de cristal.

Por qué importan los túneles en la roca

Muchas decisiones geológicas aún comienzan con la observación directa: en acantilados, testigos de perforación y láminas delgadas de roca. La disposición de las capas, cuán limpias o alteradas parecen y dónde los túneles las atraviesan, aportan pistas sobre la profundidad del agua, la energía del ambiente, los niveles de oxígeno y las criaturas que vivieron allí. Los geólogos suelen resumir esta alteración como intensidad de bioturbación, que va desde capas intactas hasta sedimentos completamente removidos. Esas categorías son vitales para reconstruir líneas de costa antiguas y para valorar la facilidad con la que los fluidos pueden moverse por areniscas enterradas que podrían funcionar como reservorios. Aun así, incluso los expertos pueden discrepar, especialmente en casos limítrofes donde la bioturbación es moderada en lugar de claramente débil o intensa.

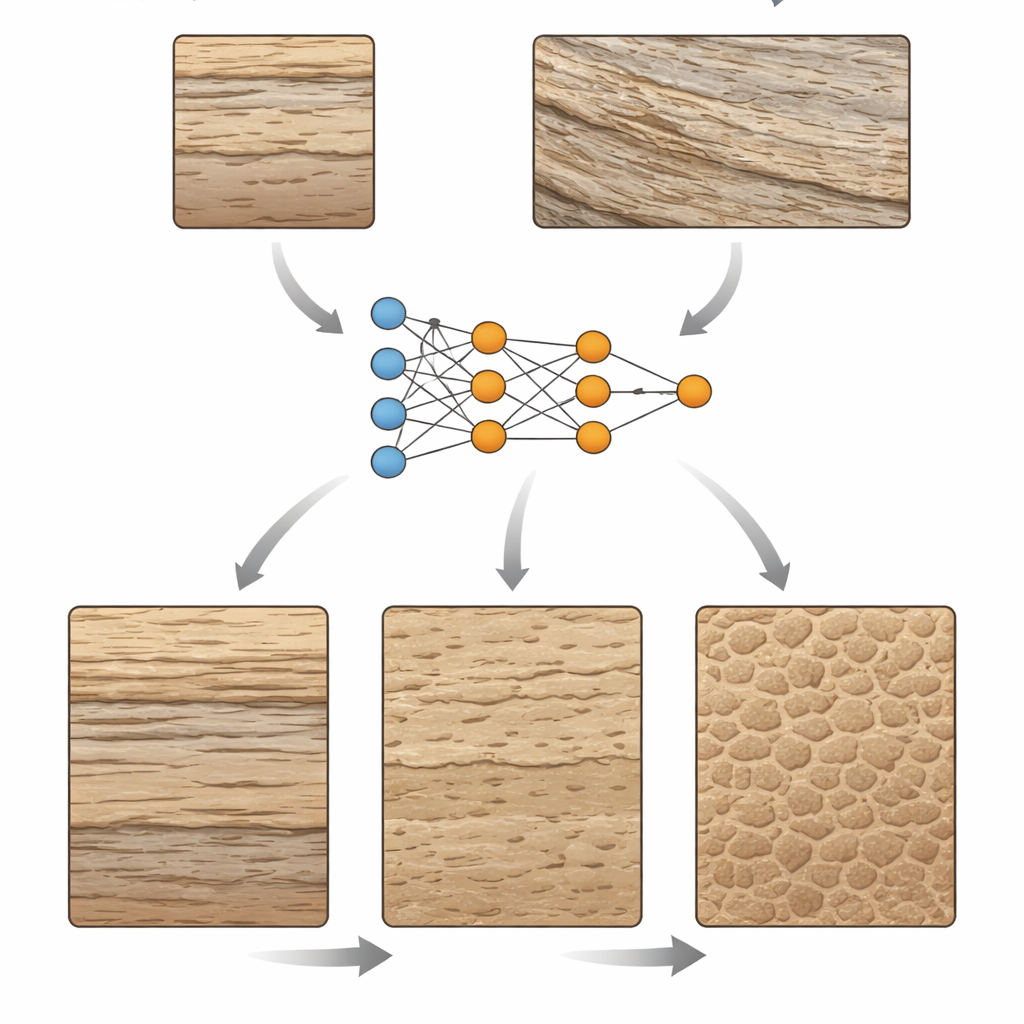

Enseñar a un ordenador a leer fotos de roca

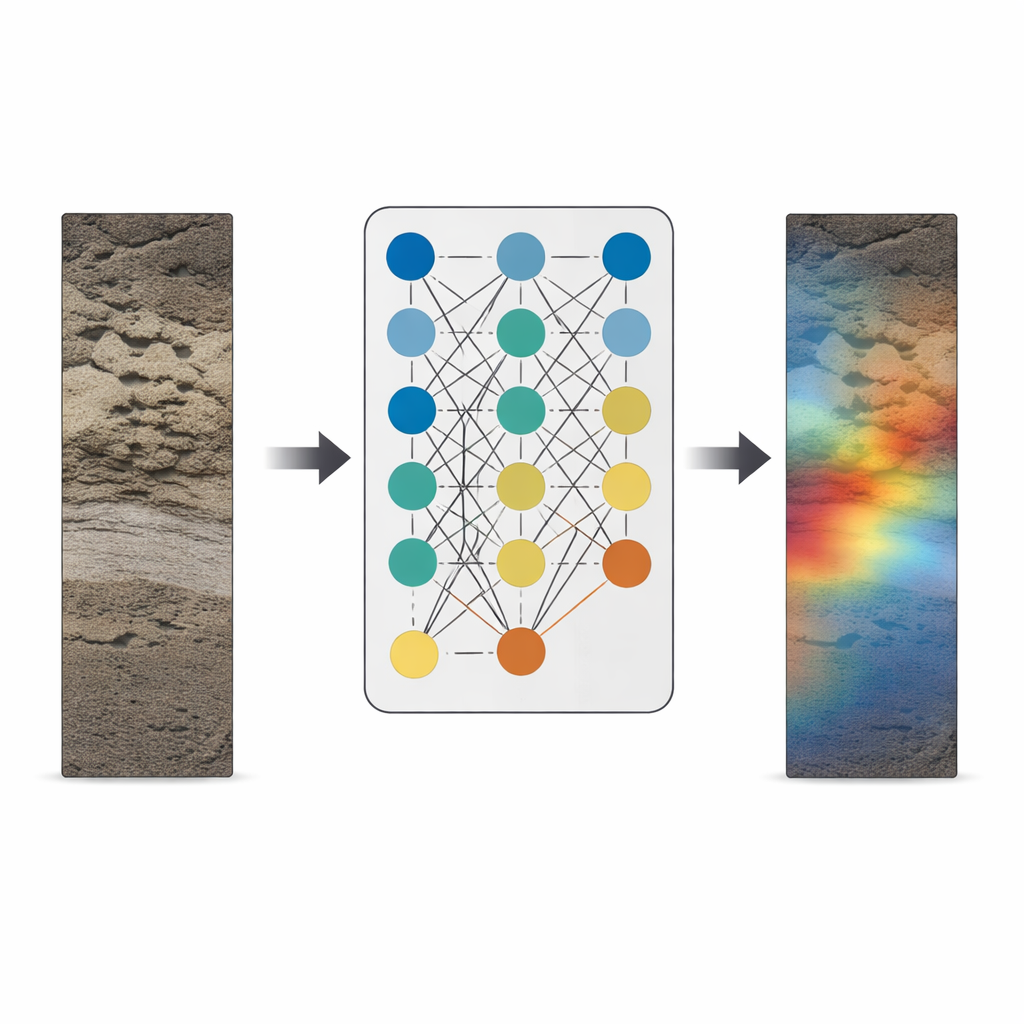

Los autores parten de un modelo de aprendizaje profundo anterior entrenado para clasificar fotos de testigos y afloramientos de arenisca en tres niveles amplios de bioturbación: no trabajada, moderadamente trabajada e intensamente trabajada. El modelo ya había mostrado alta precisión, clasificando correctamente la mayor parte de 262 imágenes de prueba. En este estudio, el foco pasa de "¿Qué tan bien lo hace?" a "¿Qué está viendo realmente?" Para responder, el equipo usa herramientas de IA explicable que generan mapas de calor sobre cada imagen, destacando las regiones que más influyeron en la elección del modelo. Las áreas más rojas importan más para la decisión; los tonos fríos importan menos. Este enfoque permite a los geólogos comparar la atención visual de la máquina con la de un icnólogo experimentado, un experto en fósiles de huellas.

Cómo se ilumina la caja negra

El método, conocido como Grad-CAM, aprovecha las capas finales de la red neuronal, donde la imagen se ha destilado en parches groseros de características. Cuando el modelo decide una clase, Grad-CAM mide cuán sensible es esa decisión a cada parche y proyecta el resultado de nuevo sobre la foto original como una superposición coloreada. En rocas sin bioturbación, los mapas de calor tienden a iluminar parches de estratificación bien preservada o unidades masivas y no perturbadas, a veces también resaltando fracturas naturales o cantos dispersos que destacan sobre un fondo uniforme. En imágenes con bioturbación moderada, los mapas suelen centrarse en túneles individuales o zonas donde la estratificación está parcialmente interrumpida, coincidiendo estrechamente con lo que los expertos marcarían en una página. En muestras intensamente trabajadas, donde casi toda la estructura original está borrada, los mapas muestran un patrón moteado repartido por la imagen, reflejando la agitada remoción del antiguo lecho marino.

Qué se equivoca el modelo y por qué

Puesto que las explicaciones son visuales, los investigadores pueden investigar los errores del modelo en lugar de limitarlos a registrarlos como fallos. Algunas imágenes no trabajadas se interpretaron erróneamente como bioturbadas cuando ciertos clastos o texturas coincidían con la apariencia de túneles. En otros casos, trazas fósiles muy pequeñas o tenues fueron pasadas por alto, especialmente cuando ocupaban solo una esquina de la foto. Las estructuras muy grandes también plantearon problemas: si un único túnel ancho llenaba la mayor parte del encuadre y sus detalles internos estaban atenuados, el modelo lo trató como una masa sin rasgos en lugar de como una traza. Es importante señalar que los mapas de calor muestran que el sistema, en general, ignora el desorden no geológico como marcas de bolígrafo, cortes de sierra y sombras, lo que demuestra que ha aprendido a centrarse en las texturas de la roca en lugar del ruido fotográfico. Los autores sugieren que imágenes de entrenamiento más variadas y de mayor calidad y una mejor cobertura de niveles de intensidad limítrofes mejorarían aún más el rendimiento.

De herramienta experta a recurso docente

Al abrir el funcionamiento interno del modelo a la inspección, la IA explicable ayuda a cerrar la brecha de confianza entre los geocientíficos y los algoritmos. El estudio muestra que la atención de la red suele alinearse con el juicio de los expertos, centrando la atención en los mismos túneles y zonas alteradas que un icnólogo entrenado enfatizaría. Esta transparencia facilita la adopción del análisis automatizado de bioturbación tanto en la investigación como en la industria, donde el cribado rápido y coherente de grandes bibliotecas de imágenes puede ahorrar tiempo y reducir el sesgo humano. Al mismo tiempo, los mapas de calor coloridos funcionan como herramienta didáctica, guiando la mirada de los estudiantes hacia las señales texturales sutiles que distinguen roca no trabajada, moderadamente trabajada y totalmente removida. Al convertir decisiones invisibles del modelo en patrones visibles, el trabajo apunta a un futuro en el que la IA no sustituya la intuición geológica, sino que la afine y la amplíe.

Cita: Ayranci, K., Yildirim, I.E., Yildirim, E.U. et al. Opening the black box: explainable AI for automated bioturbation analysis in cores and outcrops. Sci Rep 16, 9725 (2026). https://doi.org/10.1038/s41598-026-40747-5

Palabras clave: IA explicable, bioturbación, análisis de imágenes geológicas, aprendizaje profundo, testigos sedimentarios