Clear Sky Science · es

Evaluación de modelos de lenguaje de IA en la respuesta a preguntas relacionadas con el embarazo evaluadas por especialistas en obstetricia

Por qué esto importa para las futuras familias

El embarazo es una etapa llena de preguntas, y muchas personas recurren ahora a herramientas en línea y chatbots para obtener respuestas rápidas. Este estudio planteó una pregunta sencilla pero importante: en lo que respecta a preocupaciones habituales en el embarazo, ¿qué tan buenos son los chatbots de inteligencia artificial (IA) populares de hoy en día para ofrecer información clara, precisa y tranquilizadora en la que los médicos confiarían?

Comparando tres “motores de respuesta” digitales

Investigadores en Turquía se propusieron comparar tres modelos de lenguaje de IA bien conocidos: una versión anterior de ChatGPT (3.5), una versión más nueva (4.0) y Gemini de Google. Se centraron en diez preguntas cotidianas que las personas embarazadas suelen hacer, como qué alimentos evitar, si el ejercicio y las relaciones sexuales son seguros, qué puede significar un sangrado temprano, cómo interpretar los movimientos fetales y qué signos de alarma requieren atención urgente. Cada pregunta se introdujo en los tres sistemas usando las mismas instrucciones sencillas, con ajustes para reducir la aleatoriedad de modo que las respuestas fueran consistentes en lugar de conversacionales o creativas.

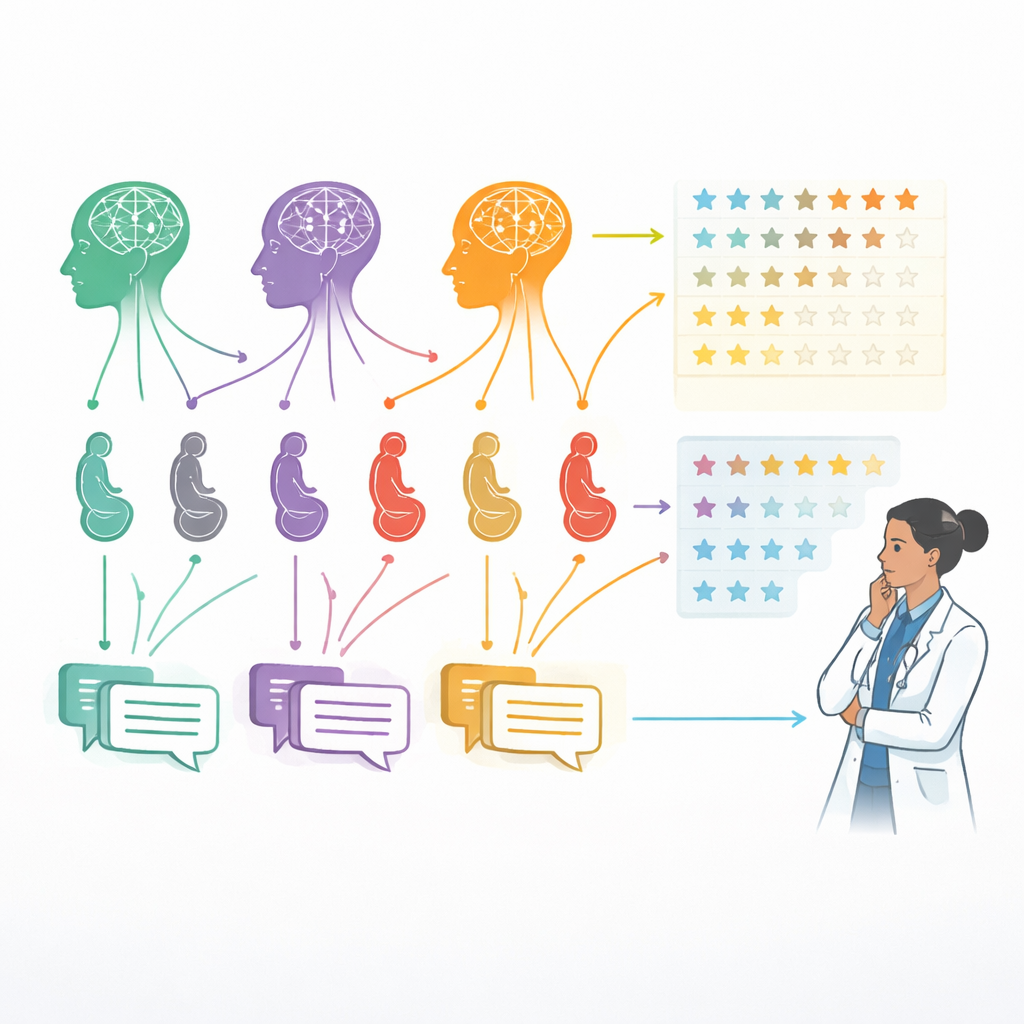

Cada modelo produjo una respuesta por pregunta, en turco, sin indicaciones de seguimiento ni edición. Las respuestas se despojaron luego de cualquier pista que pudiera revelar qué sistema las había escrito y se barajaron al azar. De este modo, los evaluadores humanos —especialistas en obstetricia y ginecología— juzgaron únicamente lo que aparecía en la página, no la marca o el estilo de redacción que creyeran reconocer.

Cómo valoraron los médicos las respuestas

Setenta y cinco especialistas en obstetricia, desde médicos en etapas iniciales hasta clínicos muy experimentados, puntuaron las 30 respuestas anonimizadas. Para cada respuesta emplearon una escala de cinco puntos para valorar cuatro cualidades: precisión (¿coincide con el conocimiento médico y las guías actuales?), fiabilidad (¿el mensaje es internamente coherente y está libre de consejos inseguros?), amabilidad hacia el paciente (¿el tono es apropiado y tranquilizador para no expertos?) y comprensibilidad (¿el lenguaje es claro, bien estructurado y fácil de seguir?). En total, los expertos aportaron 9.000 valoraciones individuales, un conjunto de datos amplio que permitió a los investigadores detectar diferencias significativas entre las tres herramientas de IA.

El equipo luego utilizó métodos estadísticos diseñados para escalas de valoración para comparar los modelos. También comprobaron cuán consistentes eran las valoraciones entre distintos médicos y exploraron si los clínicos más experimentados puntuaban de manera diferente a sus colegas más jóvenes. El objetivo no era construir un chatbot funcional, sino tomar una fotografía cuidadosa de cómo se comportan estos sistemas en condiciones controladas al responder preguntas realistas sobre el embarazo.

¿Qué chatbot resultó mejor?

En términos generales, la más nueva, ChatGPT-4.0, quedó en primer lugar. Los médicos valoraron sus respuestas como las más precisas y las más amables para el paciente, y también fue la que obtuvo mejor rendimiento en fiabilidad. Gemini se situó generalmente en un punto intermedio: sus respuestas eran a menudo claras y fáciles de leer, y en cuanto a comprensibilidad era similar a ChatGPT-4.0, pero tendía a ser algo menos detallada y precisa. ChatGPT-3.5, el modelo más antiguo, recibió consistentemente las puntuaciones más bajas, ofreciendo con frecuencia explicaciones más cortas o menos completas. Es interesante que, en lo relativo a la claridad básica y la estructura, los tres modelos se parecieran más, lo que sugiere que lograr texto legible puede ser más sencillo que asegurar que cada detalle médico sea correcto y equilibrado.

Las valoraciones de los médicos fueron altamente consistentes entre sí, lo que indica que los resultados no estuvieron condicionados por unas pocas opiniones atípicas. Hubo una tendencia modesta a que los clínicos más experimentados otorgaran puntuaciones de fiabilidad algo más altas en general, pero sus opiniones no variaron mucho respecto a la amabilidad o la facilidad de comprensión de las respuestas.

Qué significa esto para el uso en el mundo real

Para una persona no experta, la conclusión es que las herramientas de IA modernas —especialmente ChatGPT-4.0— ya pueden ofrecer información sobre el embarazo que muchos especialistas en obstetricia consideran razonablemente precisa, segura y fácil de leer. Dicho esto, el estudio también subraya un límite importante: ni siquiera el sistema con mejor rendimiento es un médico. Los investigadores no compararon las respuestas del chatbot con “estándares de oro” de guías oficiales, ni probaron cómo interpretan o actúan realmente los pacientes ante los consejos. Como el trabajo se realizó íntegramente en turco, el rendimiento en otros idiomas y contextos culturales puede diferir.

En términos claros, estos chatbots de IA pueden ser compañeros útiles para informarse sobre el embarazo, especialmente cuando una visita clínica está lejos o el tiempo con el proveedor es limitado. Pueden apoyar, pero no deben sustituir, las conversaciones con profesionales de la salud. Los autores insisten en que la supervisión experta sigue siendo esencial para detectar errores, evitar falsas tranquilidades y asegurar que las situaciones matizadas o de alto riesgo reciban la atención personal y presencial que requieren.

Cita: Keyif, B., Yurtçu, E., Başbuğ, A. et al. Evaluation of AI language models in answering pregnancy-related questions assessed by obstetrics specialists. Sci Rep 16, 9322 (2026). https://doi.org/10.1038/s41598-026-40609-0

Palabras clave: educación sobre el embarazo, chatbots de IA, asesoramiento de salud en línea, obstetricia, calidad de la información para pacientes