Clear Sky Science · es

Atribución de la cámara fuente mediante una red neuronal convolucional explicable basada en reglas

Por qué tus fotos pueden decir más de lo que piensas

Cada foto que tomas contiene pistas ocultas sobre la cámara que la capturó. Para los investigadores digitales, estas pistas pueden ayudar a confirmar si una imagen es genuina, rastrear de qué dispositivo provino o vincular fotos entre diferentes escenas del crimen. Hoy, potentes herramientas de inteligencia artificial (IA) pueden detectar estos patrones mejor que los humanos, pero a menudo funcionan como “cajas negras” misteriosas. Este artículo presenta una forma de abrir esa caja: un método basado en reglas que explica cómo un modelo de aprendizaje profundo decide qué cámara tomó una imagen, en un formato que un examinador humano puede entender y en el que puede confiar.

El reto de confiar en herramientas forenses inteligentes

La informática forense moderna debe cribar grandes volúmenes de datos —procedentes de teléfonos inteligentes, copias de seguridad en la nube y redes sociales— muy por encima de lo que los analistas humanos pueden inspeccionar manualmente. Los sistemas de aprendizaje profundo pueden señalar rápidamente imágenes o sugerir cuáles son importantes, pero sus mecanismos internos son notoriamente opacos. En entornos sensibles como las salas de justicia, no basta con decir “la red neuronal lo estima así”. Las herramientas de explicación existentes suelen resaltar regiones de la imagen que el modelo considera relevantes, lo cual es útil para tareas como reconocer rostros u objetos. Sin embargo, para la identificación de la cámara fuente, la señal crucial no es una característica visible sino una huella del sensor muy débil: patrones de ruido sutiles que las personas no pueden ver. Como resultado, las herramientas de explicación visual actuales no muestran claramente por qué un modelo piensa que una imagen proviene de una cámara concreta, ni ayudan a los examinadores a detectar cuándo el modelo falla.

Una nueva forma de ver pensar a una red neuronal

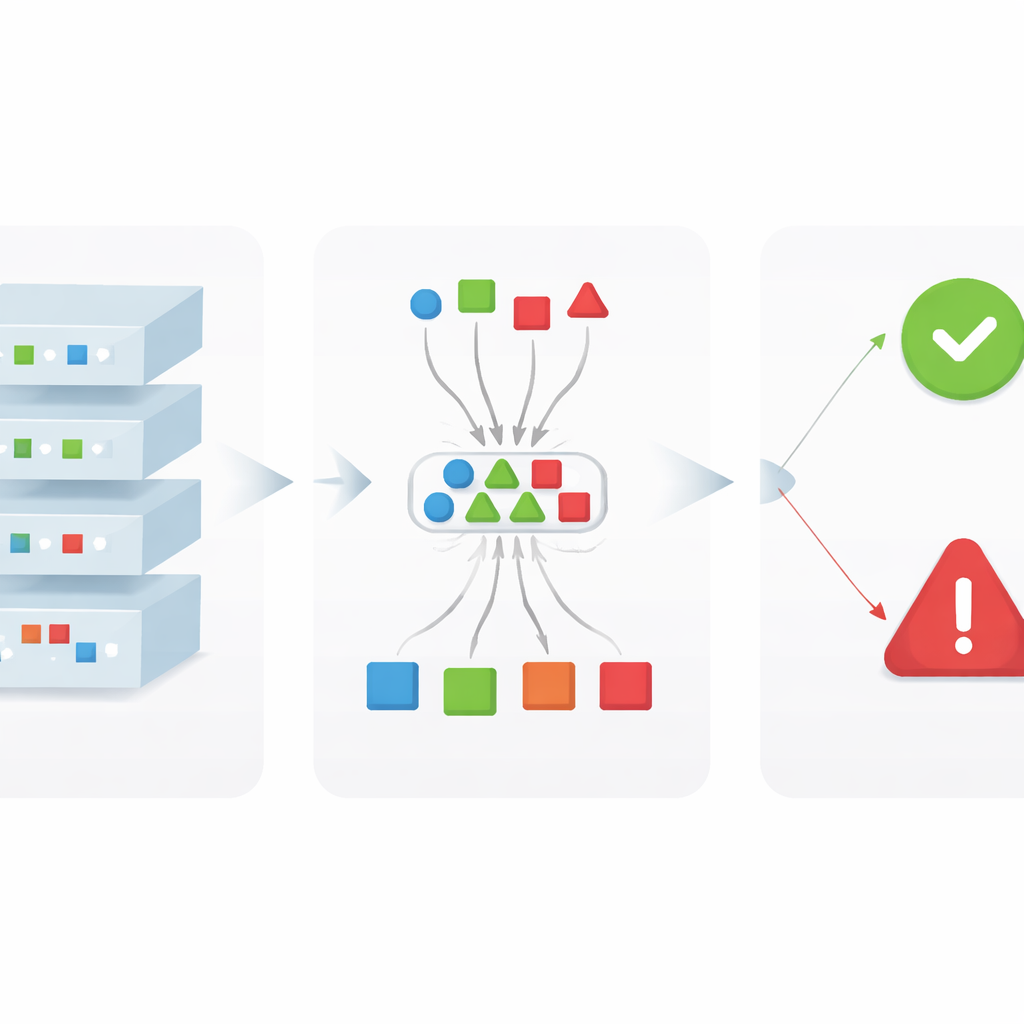

Los autores presentan xDFAI, un marco diseñado específicamente para la informática forense digital que explica cómo una red neuronal convolucional (CNN) llega a sus decisiones sin modificar el modelo original. En lugar de tratar la red como una caja opaca única, xDFAI observa su interior capa por capa. Para cada capa y cada clase de cámara, identifica un conjunto de patrones internos recurrentes, llamados “rastros”, que se activan de forma consistente cuando el modelo considera que una imagen pertenece a esa cámara. Estos rastros se extraen de un modelo entrenado usando métodos de atribución existentes y luego se filtran para conservar solo aquellos patrones que aparecen de manera fiable en muchas imágenes de entrenamiento. En conjunto, estos rastros forman un mapa estructurado de cómo evolucionan las pistas sobre la identidad de la cámara a medida que la imagen atraviesa la red.

Permitir que las capas voten y convertir los votos en reglas

Una vez identificados los rastros, xDFAI los usa para examinar imágenes nuevas y no vistas. Para una foto de prueba dada, el marco mide cuán similares son sus activaciones internas a los rastros almacenados para cada cámara en cada capa. Cada capa efectivamente emite votos a favor de los modelos de cámara con los que sus activaciones coinciden más estrechamente. Una “votación mayoritaria” entre capas resume entonces con qué intensidad la red, en su conjunto, respalda cada cámara candidata. Crucialmente, los autores no usan esta votación para sustituir la predicción del modelo; en cambio, la emplean como una comprobación. Reglas lógicas simples comparan la votación mayoritaria con la predicción original: si la cámara predicha también recibe un fuerte respaldo de muchas capas, la decisión se confirma; si los votos están dispersos o favorecen otra cámara, el comportamiento se marca como anómalo y se muestra al examinador como un posible error del modelo.

Poner el marco a prueba

Para demostrar xDFAI, los autores lo aplican a una CNN de siete capas entrenada para identificar cuál de 27 modelos de cámara capturó una imagen, usando un conjunto de datos forenses bien conocido. La CNN base por sí sola ya rinde muy bien, clasificando correctamente alrededor del 97% de las imágenes de prueba. Cuando se aplican las reglas de xDFAI encima, el sistema marca automáticamente 27 de las 37 predicciones erróneas como sospechosas. Esos casos marcados dejan de contarse como identificaciones confiables, lo que aumenta la precisión —la fracción de decisiones aceptadas que son realmente correctas— del 97,33% al 99,2%, mientras que la exactitud global solo se reduce ligeramente. Para el trabajo forense, donde una única atribución equivocada puede tener consecuencias graves, este compromiso es muy deseable: menos falsos positivos entre las conclusiones que los analistas deciden aceptar.

Qué significa esto para las investigaciones del mundo real

Este trabajo muestra que es posible mantener todo el poder de un modelo moderno de aprendizaje profundo mientras se añaden explicaciones comprensibles para humanos que respetan las normas de integridad forense: sin volver a entrenar, sin manipular el modelo original y sin depender únicamente de mapas de calor vagos. Al exponer rastros internos estables, agregarlos mediante un esquema de votación transparente y expresar el resultado como reglas simples, xDFAI ofrece a los examinadores una forma de confirmar o cuestionar las atribuciones de cámara generadas por IA. Aunque el estudio se centra en la identificación de la fuente de la cámara, las mismas ideas podrían extenderse a otras tareas forenses de atribución. A la larga, enfoques como este podrían ayudar a cerrar la brecha entre sistemas de IA muy precisos y el nivel de transparencia y fiabilidad requerido en los tribunales y en la práctica investigadora.

Cita: Nayerifard, T., Amintoosi, H. & Ghaemi Bafghi, A. Source camera attribution using a rule-based explainable convolutional neural network. Sci Rep 16, 9137 (2026). https://doi.org/10.1038/s41598-026-40387-9

Palabras clave: informática forense digital, IA explicable, identificación de cámara, redes neuronales convolucionales, forense de imágenes