Clear Sky Science · es

MedicalPatchNet: una arquitectura de IA auto-explicable basada en parches para la clasificación de radiografías de tórax

Por qué importan las radiografías más inteligentes

Las radiografías de tórax son una de las pruebas médicas más comunes del mundo, y los sistemas de inteligencia artificial (IA) ayudan cada vez más a los médicos a interpretarlas. Pero muchos de los modelos de IA con mejor rendimiento actúan como “cajas negras”: pueden ser precisos, pero ni siquiera los expertos pueden ver fácilmente por qué llegaron a un diagnóstico concreto. Esta falta de transparencia dificulta que los clínicos confíen en la IA y la utilicen con seguridad en la atención real. El estudio presenta MedicalPatchNet, un nuevo enfoque de IA que busca mantener una alta precisión mientras hace visible y comprensible su razonamiento, incluso para personas sin formación en aprendizaje automático.

Dividir las imágenes en regiones pequeñas y significativas

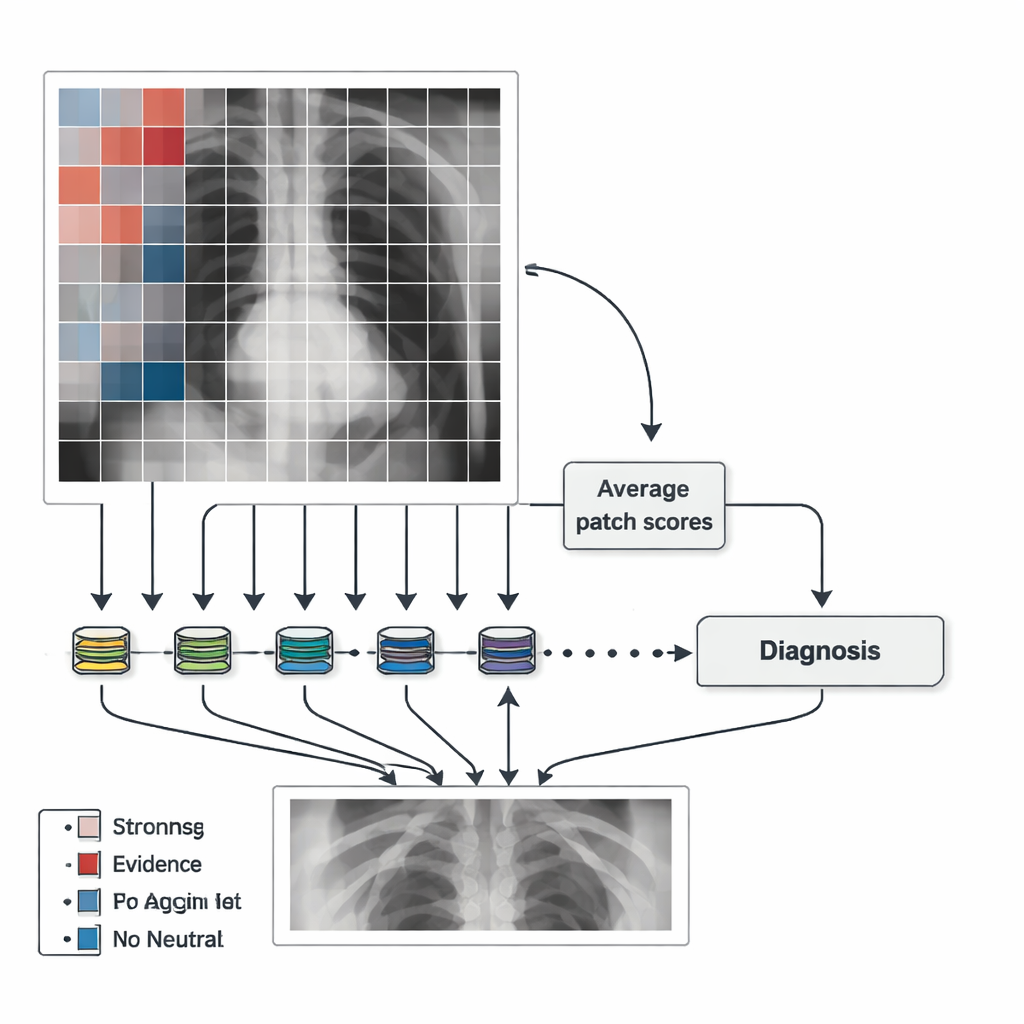

En lugar de analizar una radiografía de tórax como un gran y enigmático todo, MedicalPatchNet funciona dividiendo la imagen en muchos cuadrados pequeños no solapados o “parches”. Cada parche se envía a través de la misma red neuronal, que produce una puntuación para varios hallazgos posibles, como opacidad pulmonar, neumonía o derrame pleural (líquido alrededor de los pulmones). Estas puntuaciones a nivel de parche se promedian simplemente para obtener una decisión global para toda la imagen. Como la respuesta final es solo la suma de muchos votos locales, es sencillo mostrar cuánto contribuyó cada parche al diagnóstico. De forma crucial, no hay mecanismos de atención ocultos ni esquemas internos de ponderación complejos, por lo que la influencia de cada región está definida explícitamente en lugar de aprendida de manera opaca.

Convertir las decisiones del modelo en mapas visuales claros

Los autores usan estas puntuaciones de parche para crear “mapas de saliencia” que resaltan dónde la IA encontró evidencia a favor o en contra de una enfermedad. Los parches que apoyan fuertemente un hallazgo se muestran en colores cálidos (por ejemplo, rojo), los que lo contradicen en colores fríos (como azul) y las áreas neutras en gris. Esto facilita ver si el modelo se está centrando en los pulmones, el corazón o, preocupantemente, en características irrelevantes como artefactos de borde o etiquetas de texto. Para suavizar los mapas y evitar su aspecto en bloques, el equipo también genera mapas tras desplazar ligeramente la imagen en muchos pequeños pasos y promediar los resultados. Esto añade cierto coste computacional, pero produce mapas de calor que se ajustan mejor a la anatomía subyacente manteniendo al mismo tiempo el vínculo claro entre cada región y su contribución a la decisión final.

Igualar el rendimiento de las cajas negras mientras se mejora la confianza

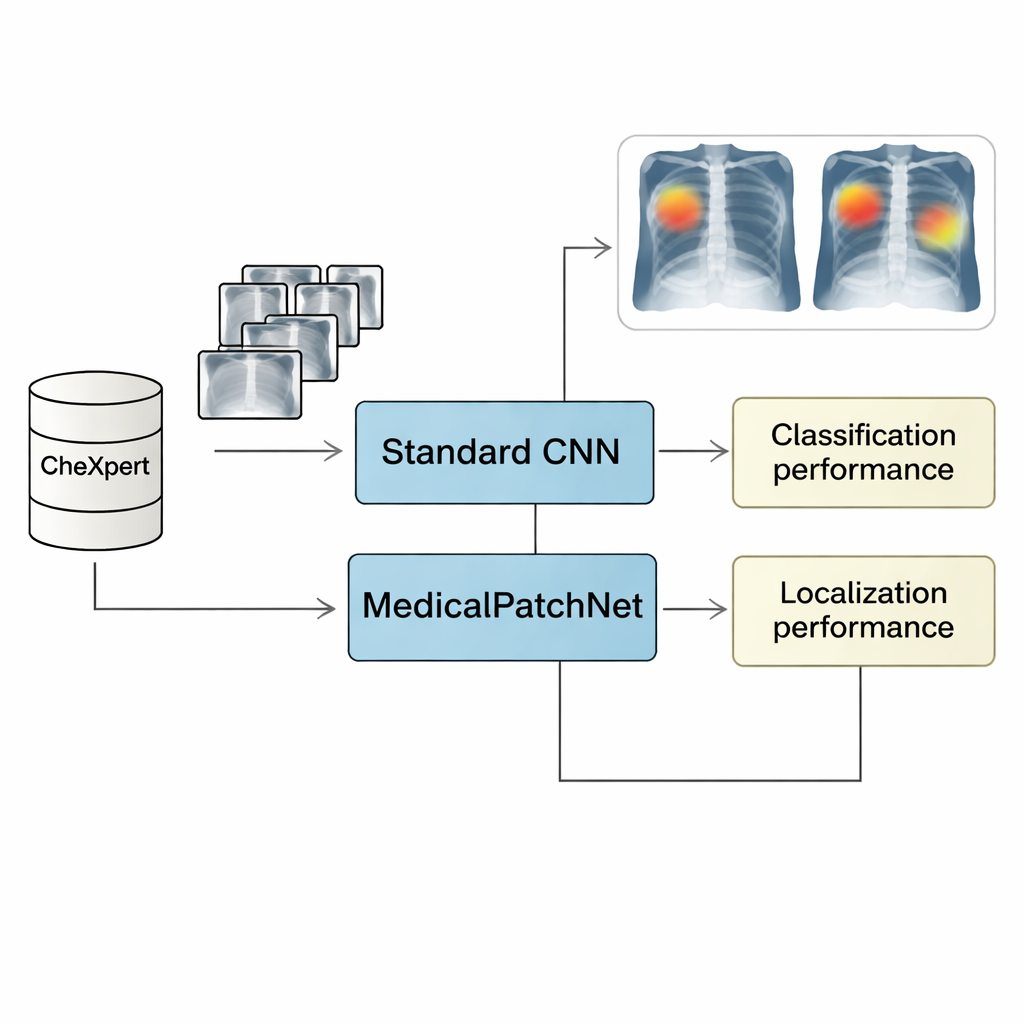

Para evaluar MedicalPatchNet, los investigadores lo entrenaron con CheXpert, un gran conjunto de datos público de más de 220 000 radiografías de tórax etiquetadas para 14 hallazgos comunes. Compararon su rendimiento con un modelo convencional a nivel de imagen usando la misma red base (EfficientNetV2-S). En promedio, ambos modelos lograron un rendimiento diagnóstico casi idéntico, medido por el Área bajo la curva ROC (AUROC), sensibilidad, especificidad y precisión. En otras palabras, forzar al modelo a razonar parche a parche y luego promediar los resultados no debilitó de forma significativa su capacidad para reconocer enfermedad. Esto sugiere que, para muchas tareas en radiografías de tórax, la información local de la imagen es suficiente y no existe necesidad de que el modelo dependa de patrones complejos y totalmente globales para rendir bien.

Ver dónde el modelo “mira” para detectar enfermedad

Más allá de la precisión global, la cuestión clave es si MedicalPatchNet se explica a sí mismo de forma más fiable que herramientas populares “a posteriori” como Grad-CAM y sus variantes. Para ello, el equipo usó un segundo conjunto de datos, CheXlocalize, que proporciona contornos dibujados por radiólogos de las regiones de enfermedad reales. Midiendo con qué frecuencia el punto más resaltado por un método caía dentro del área anómala verdadera (la “tasa de aciertos”) y cuánto solapaba la región resaltada con las anotaciones de los expertos (Intersección sobre Unión media, mIoU), las mapas basados en parches de MedicalPatchNet alcanzaron tasas de acierto más altas que las explicaciones estilo Grad-CAM en nueve de diez condiciones, y el mejor solapamiento global al contar predicciones correctas e incorrectas. Esta evaluación más amplia es importante porque penaliza explicaciones que parecen buenas solo cuando el modelo acierta, pero que no revelan comportamientos engañosos cuando el modelo se equivoca.

De conjeturas opacas a socios transparentes

Para los no especialistas, el resultado principal es que MedicalPatchNet demuestra que es posible mantener un rendimiento cercano al estado del arte en el diagnóstico por radiografía de tórax a la vez que se hace mucho más transparente el razonamiento de la IA. En lugar de mapas de calor misteriosos que pueden o no reflejar lo que realmente motivó la decisión, este enfoque vincula cada resaltado directamente con un voto local en el cálculo del modelo. Los clínicos pueden ver no solo si la IA considera que existe una enfermedad, sino también exactamente dónde de la imagen encontró evidencia que la apoya o la contradice. Aunque el método todavía tiene límites—como la dificultad con condiciones que dependen de considerar regiones distantes de la imagen en conjunto—ofrece una vía práctica hacia herramientas de IA que actúen menos como cajas negras y más como socios claros y responsables en la imagenología médica.

Cita: Wienholt, P., Kuhl, C., Kather, J.N. et al. MedicalPatchNet: a patch-based self-explainable AI architecture for chest X-ray classification. Sci Rep 16, 7467 (2026). https://doi.org/10.1038/s41598-026-40358-0

Palabras clave: IA para radiografías de tórax, aprendizaje profundo explicable, MedicalPatchNet, mapas de saliencia en imágenes médicas, apoyo a la decisión en radiología