Clear Sky Science · es

Colorización de imágenes mediante aprendizaje profundo por transferencia usando VGG19 y CLAHE

Devolver vida a las fotos antiguas

Muchos de nosotros tenemos cajas de fotografías familiares en blanco y negro o disfrutamos de películas clásicas y documentales vintage. Imaginar cómo se veían esas escenas en la vida real —cielos azules, campos verdes, tonos de piel cálidos— puede acercar el pasado y hacerlo más tangible. Este artículo explora un nuevo método informático que añade automáticamente colores realistas y un contraste agradable a imágenes en escala de grises, facilitando la restauración de fotos antiguas, la renovación de películas en blanco y negro e incluso la mejora de exploraciones médicas, sin requerir que un experto pinte cada tono a mano.

Del teñido manual a las máquinas inteligentes

Colorizar imágenes es más difícil de lo que parece porque un único tono de gris puede corresponder a muchos colores posibles: un gris medio podría ser un ladrillo rojo, una hoja verde o una camisa azul. Las herramientas anteriores dependían mucho de la guía humana. Los artistas podían dibujar “garabatos” de color en partes de una imagen y el software propagaba esas pistas por regiones similares. Otros sistemas tomaban colores de una foto de referencia con contenido parecido. Aunque estos métodos podían ser convincentes, fallaban cuando la guía era escasa, la imagen de referencia no encajaba perfectamente o la escena era compleja. Con el auge del aprendizaje profundo, nuevos programas aprendieron a “adivinar” colores directamente a partir de grandes colecciones de fotos de ejemplo, reduciendo la necesidad de trabajo manual pero exigiendo enormes tiempos de entrenamiento y potencia de cálculo.

Enseñar a una red cómo es el mundo

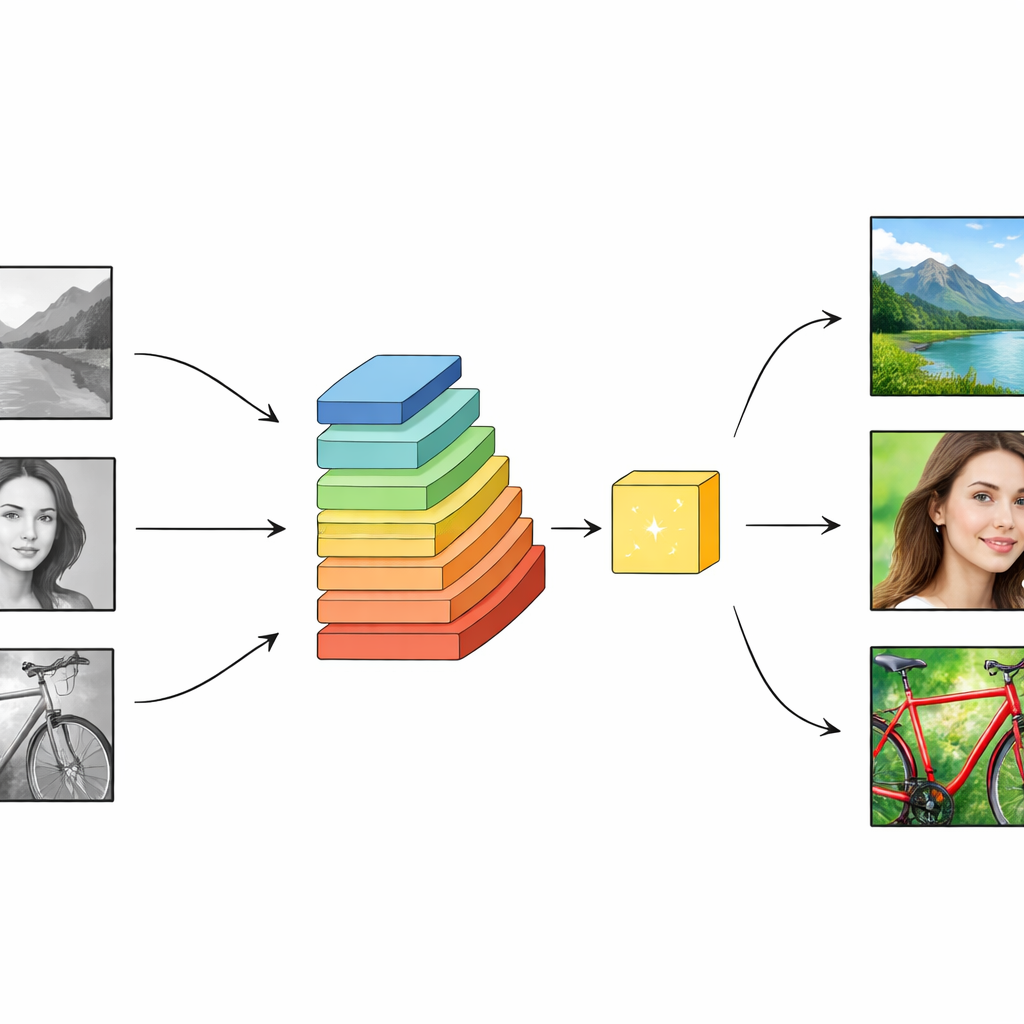

Los autores aprovechan este avance con una estrategia conocida como aprendizaje por transferencia. En lugar de entrenar un sistema nuevo desde cero, reutilizan una potente red de visión llamada VGG19 que ya ha sido entrenada con millones de imágenes en color. Esta red tiene muchas capas que pasan gradualmente de patrones sencillos como bordes y texturas a objetos y escenas completas: rostros, árboles, edificios, cielos. El sistema de colorización alimenta a VGG19 con una versión en escala de grises de la imagen y recoge características de varias capas a la vez, formando una “pilera” rica de información para cada píxel. Esto ayuda al modelo a entender tanto los detalles finos —como mechones de cabello o bordes de hojas— como el contexto más amplio, por ejemplo si la escena es una playa, una calle urbana o un bosque. Con ese contexto, la red está mejor posicionada para elegir colores creíbles, no solo soluciones matemáticamente plausibles.

Convertir la luz y la sombra en color y contraste

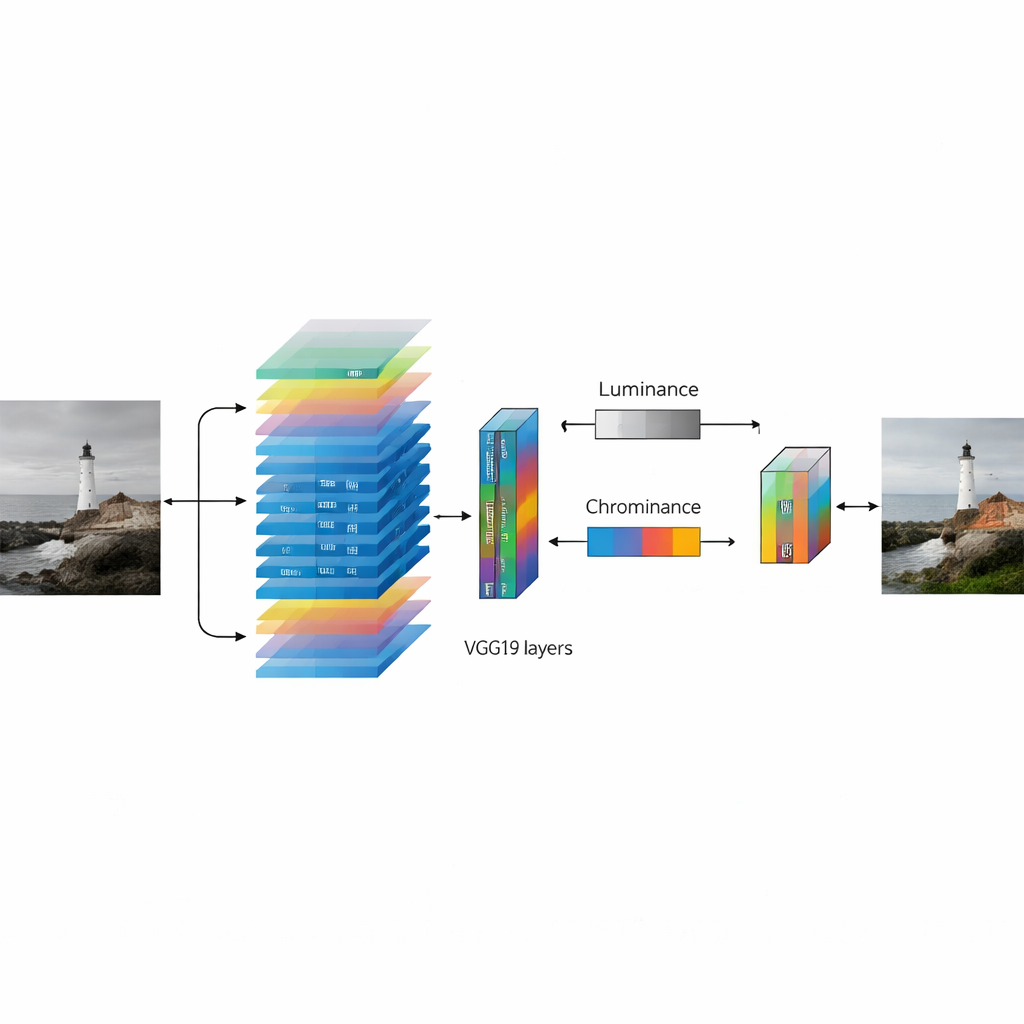

Para estabilizar las decisiones de color, el método representa las imágenes en un sistema de color que separa el brillo del contenido cromático. La entrada en escala de grises sirve como canal de brillo, mientras que la tarea de la red es predecir los dos canales restantes que codifican los sutiles desplazamientos entre rojos y verdes y entre azules y amarillos. Al mantener el brillo fijo, el sistema preserva el sombreado y la estructura originales de la imagen. Tras que la red produzca su mejor estimación de la información de color faltante, se aplica un paso final de mejora. Aquí los autores usan una técnica llamada ecualización de histograma adaptativa, que estira localmente el rango entre zonas oscuras y claras. Esto hace que las texturas sean más nítidas, los bordes más definidos y los colores parezcan más vibrantes, sin “quemar” las regiones brillantes ni perder detalle en las sombras.

Poner el método a prueba

Para evaluar el rendimiento de su enfoque en la práctica, los investigadores lo entrenaron y evaluaron con varias colecciones de imágenes bien conocidas que incluyen objetos, escenas, personas y entornos cotidianos. Compararon sus resultados con una variedad de métodos rivales, incluidos sistemas guiados por pistas del usuario, modelos generativos que intentan inventar imágenes realistas y modelos recientes basados en transformadores. Usando medidas estándar de calidad de imagen, su método produjo de forma consistente colores más nítidos y fieles y estructuras más claras, con un rendimiento especialmente fuerte en un conjunto desafiante de fotografías de escenas. Las comparaciones visuales muestran que sus salidas colorizadas a menudo se parecen más a las fotos en color originales, con una saturación más rica pero controlada y un contraste mejor equilibrado. También destacan dónde el método aún tiene dificultades: imágenes muy oscuras o excesivamente brillantes, o escenas con texturas inusuales y colores raros, pueden seguir produciendo tonos extraños o iluminación desigual.

Qué significa esto para las imágenes cotidianas

En términos sencillos, este estudio demuestra que dotar a un sistema de colorización de una sólida educación previa sobre el mundo visual —y luego mejorar cuidadosamente el resultado— puede producir imágenes que resultan más naturales al ojo humano. Al apoyarse en una red grande preentrenada y añadir un paso inteligente de realce del contraste, los autores ofrecen una herramienta práctica que puede insuflar vida a fotografías históricas, enriquecer películas en blanco y negro y facilitar la interpretación de ciertos tipos de imágenes médicas. Aunque no es perfecta y puede fallar ante iluminación extrema o escenas muy inusuales, este aproximación acerca la colorización automatizada a algo en lo que los no expertos pueden confiar, haciendo que el color realista esté al alcance en una amplia gama de usos cotidianos.

Cita: Ghosh, N., Mandal, G. Deep transfer learning based image colorization using VGG19 and CLAHE. Sci Rep 16, 9528 (2026). https://doi.org/10.1038/s41598-026-40292-1

Palabras clave: colorización de imágenes, aprendizaje profundo, aprendizaje por transferencia, restauración fotográfica, mejora del contraste