Clear Sky Science · es

Un marco integrado para la mitigación proactiva de deepfakes mediante marcas de agua guiadas por atención y verificación de autenticidad basada en blockchain

Por qué los vídeos falsificados son un problema de todos

Hoy es posible falsificar vídeos que parecen y suenan reales con software disponible comercialmente, difuminando la línea entre verdad y ficción en línea. Estos llamados deepfakes ya se usan en estafas, acoso y maniobras políticas. En lugar de intentar detectar falsificaciones después de que se han difundido, este estudio plantea una pregunta distinta: ¿y si pudiésemos proteger discretamente los vídeos genuinos en el momento en que se crean, de modo que cualquier manipulación posterior resulte evidente?

De perseguir fakes a proteger originales

La mayor parte de la investigación actual intenta atrapar deepfakes a posteriori, entrenando algoritmos para detectar pequeños fallos dejados por modelos generativos. Pero a medida que esos modelos mejoran, este juego del gato y el ratón se vuelve más difícil de ganar. Los autores abogan por un enfoque proactivo: proteger el metraje auténtico mientras se graba, de forma que espectadores y plataformas puedan verificar más adelante si lo que ven es el original intacto. Su marco combina tres capas: un analizador de vídeo inteligente que decide dónde la protección importa más, una marca digital invisible entretejida en cada fotograma y un registro en blockchain que fija la identidad del archivo en su conjunto.

Enseñando al sistema qué importa realmente en un vídeo

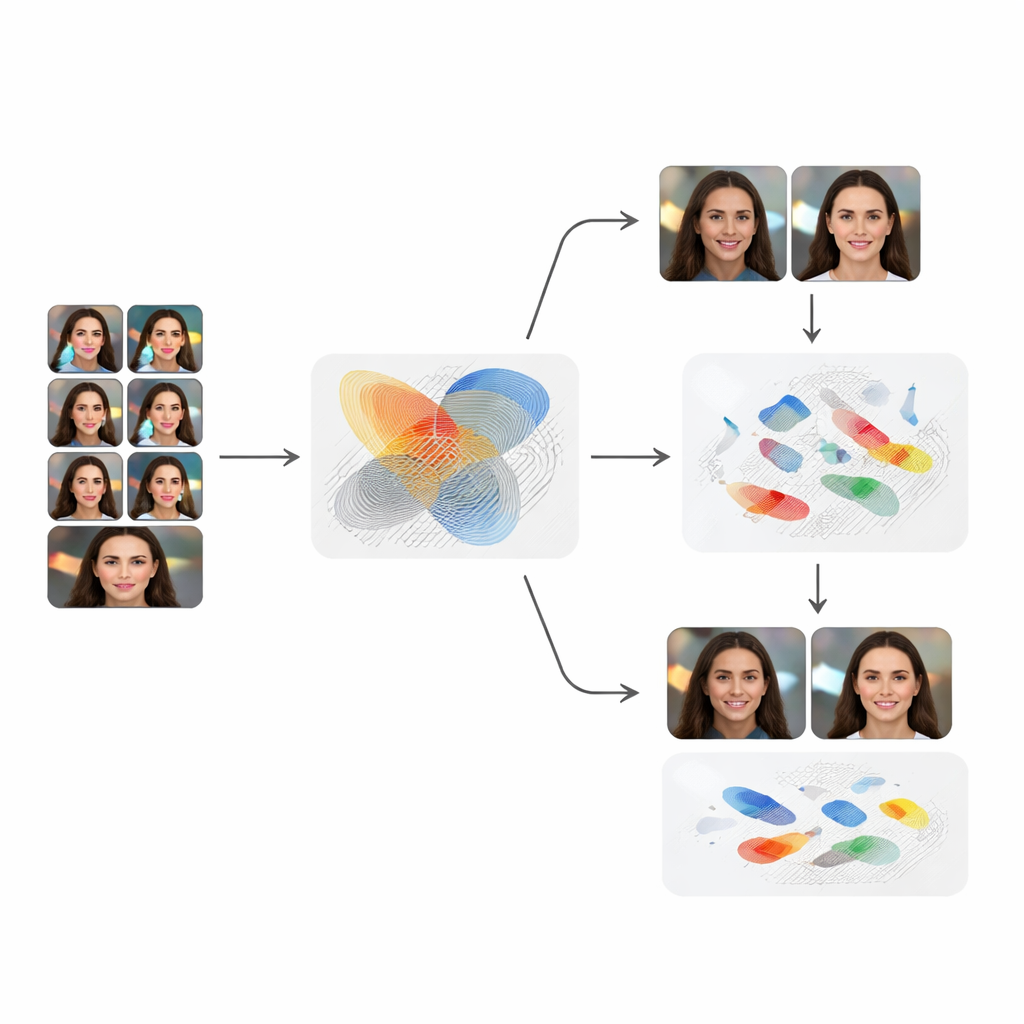

La primera capa es un modelo de atención que aprende qué partes de un vídeo contienen el movimiento y el detalle más significativos a lo largo del tiempo. El equipo entrena una red compacta pero potente con miles de clips cotidianos que muestran a personas realizando acciones. Una parte de la red examina cada fotograma como una fotografía fija, mientras otra observa cómo se mueven las cosas a través de fragmentos de 16 fotogramas. Juntas, alcanzan más del 97 % de precisión en una prueba estándar de reconocimiento de acciones, lo que demuestra que el sistema ha aprendido patrones ricos de cómo cambian las personas y las escenas con el tiempo. Esos patrones se convierten luego en mapas de atención que resaltan las regiones donde cualquier manipulación afectaría más la historia que cuenta el vídeo.

Ocultando una marca secreta donde los falsificadores harán más daño

A continuación, se inserta en cada fotograma una marca digital invisible —una marca de agua—, pero no de forma simple o uniforme. Una red generativa crea un patrón sutil, parecido a ruido, que se mezcla con mayor intensidad en las regiones que el modelo de atención señala como importantes, como rostros o manos en movimiento, y con menor intensidad en otras zonas para preservar la calidad visual. Los espectadores no notan diferencia, y las puntuaciones de calidad confirman que los fotogramas marcados son casi indistinguibles de los originales. Aun así, el patrón es lo bastante fuerte y complejo como para que una red compañera, entrenada como una especie de decodificador, pueda recuperar más adelante la firma oculta a partir del metraje genuino, fotograma por fotograma.

Poniendo a prueba deepfakes y distorsiones cotidianas

Para comprobar si esta protección resiste en el mundo real, los autores realizan una serie de pruebas de esfuerzo. Primero marcan con agua una diversa colección de vídeos cortos de archivo y luego los introducen en DeepFaceLab, una de las herramientas de intercambio de rostros más usadas, para crear deepfakes convincentes. En cada uno de los 50 clips manipulados, la marca oculta queda destruida o gravemente alterada, y el sistema identifica correctamente el vídeo como manipulado. El método también resiste bien pasos de procesamiento comunes, como recompresión intensa, cambio de tamaño y desenfoque que suelen ocurrir cuando los clips se comparten en línea, aunque un ruido aleatorio muy intenso puede acabar por sobrepasar la señal oculta. Experimentos cuidadosos muestran que tanto la orientación por atención como el uso del movimiento a lo largo del tiempo son cruciales; eliminar cualquiera de estos componentes debilita notablemente la protección.

Fijando la confianza con una huella permanente

La capa final va más allá del contenido de los fotogramas y asegura el propio archivo de vídeo. Tras la marca de agua, el archivo completo se somete a una función criptográfica que produce una huella digital corta. Esa huella, junto con información básica sobre el clip, se escribe en un libro mayor en blockchain, donde no puede alterarse sin dejar rastro. Más adelante, cualquiera puede subir una copia del vídeo: el sistema intenta recuperar la marca de agua y también recalcula la huella. Si tanto la marca oculta como la huella criptográfica coinciden con los registros originales, el vídeo puede considerarse auténtico con alta confianza; si cualquiera falla, los espectadores saben que el metraje ha sido modificado.

Qué significa esto para los vídeos que ves

En términos sencillos, este trabajo muestra que podemos pasar de adivinar si un vídeo es falso a demostrar que un vídeo es real. Al entretejer discretamente una marca inteligente y difícil de falsificar en las partes más significativas de cada fotograma y respaldarla con una entrada en un libro de contabilidad a prueba de manipulaciones, el marco detecta todos los ataques por intercambio de rostros probados y sobrevive a muchas distorsiones cotidianas. Aunque aún tiene dificultades frente a ruido visual extremo y necesita pruebas más amplias, señala un futuro en el que cámaras, plataformas y salas de redacción puedan distribuir vídeos con prueba de autenticidad integrada —haciendo mucho más difícil que los deepfakes se hagan pasar por la verdad.

Cita: Hajjej, F., Hamid, M. & Alluhaidan, A.S. An integrated framework for proactive deepfake mitigation via attention-driven watermarking and blockchain-based authenticity verification. Sci Rep 16, 9545 (2026). https://doi.org/10.1038/s41598-026-40166-6

Palabras clave: protección contra deepfakes, autenticidad de video, marcas de agua digitales, verificación en blockchain, seguridad mediática