Clear Sky Science · es

Calibración de clasificadores profundos con propagación dinámica de confianza y normalización adaptativa

Por qué importar confiar en la confianza de la IA

Los sistemas de inteligencia artificial modernos no solo indican qué creen que aparece en una foto o en una lectura de sensor: también informan cuánto están seguros. Esa confianza auto‑reportada es crucial en entornos con riesgos para la seguridad, como la imagen médica, la conducción autónoma o la monitorización industrial, donde una sensación de certeza equivocada puede ser peligrosa. Sin embargo, las redes neuronales profundas actuales son famosas por mostrarse excesivamente confiadas en sus errores, y las correcciones existentes a menudo fallan cuando los datos están desequilibrados o provienen de entornos cambiantes. Este artículo presenta un nuevo método, llamado Propagación Dinámica de Confianza con Normalización Alternante (DCP‑AN), diseñado para que las puntuaciones de confianza de los sistemas de IA sean más veraces, estables y eficientes en condiciones realistas y cambiantes.

Cuando las máquinas inteligentes están demasiado seguras de sí mismas

La mayoría de los modelos populares de aprendizaje profundo se entrenan para predecir la etiqueta correcta, no para juzgar cuán fiable es cada predicción. Como resultado, una red puede estar 99% “segura” de que una imagen muestra un gato cuando en realidad es un perro. Las técnicas estándar de calibración, como el escalado de temperatura o dividir las predicciones en contenedores de confianza, intentan corregir esto tras el entrenamiento aplicando ajustes globales. Sin embargo, estos métodos tratan todas las categorías y todos los ejemplos por igual. En el mundo real, los datos rara vez están balanceados: unas pocas clases comunes (“head”) tienen muchos ejemplos, mientras que las clases raras (“tail”) pueden aparecer solo unas pocas veces. Las redes tienden a estar demasiado confiadas en las clases comunes y poco confiadas en las raras, una brecha que las correcciones estáticas y uniformes no pueden cerrar, especialmente cuando la distribución de datos cambia entre dominios, por ejemplo de bocetos artísticos a fotos del mundo real.

Una nueva manera de compartir información entre datos y etiquetas

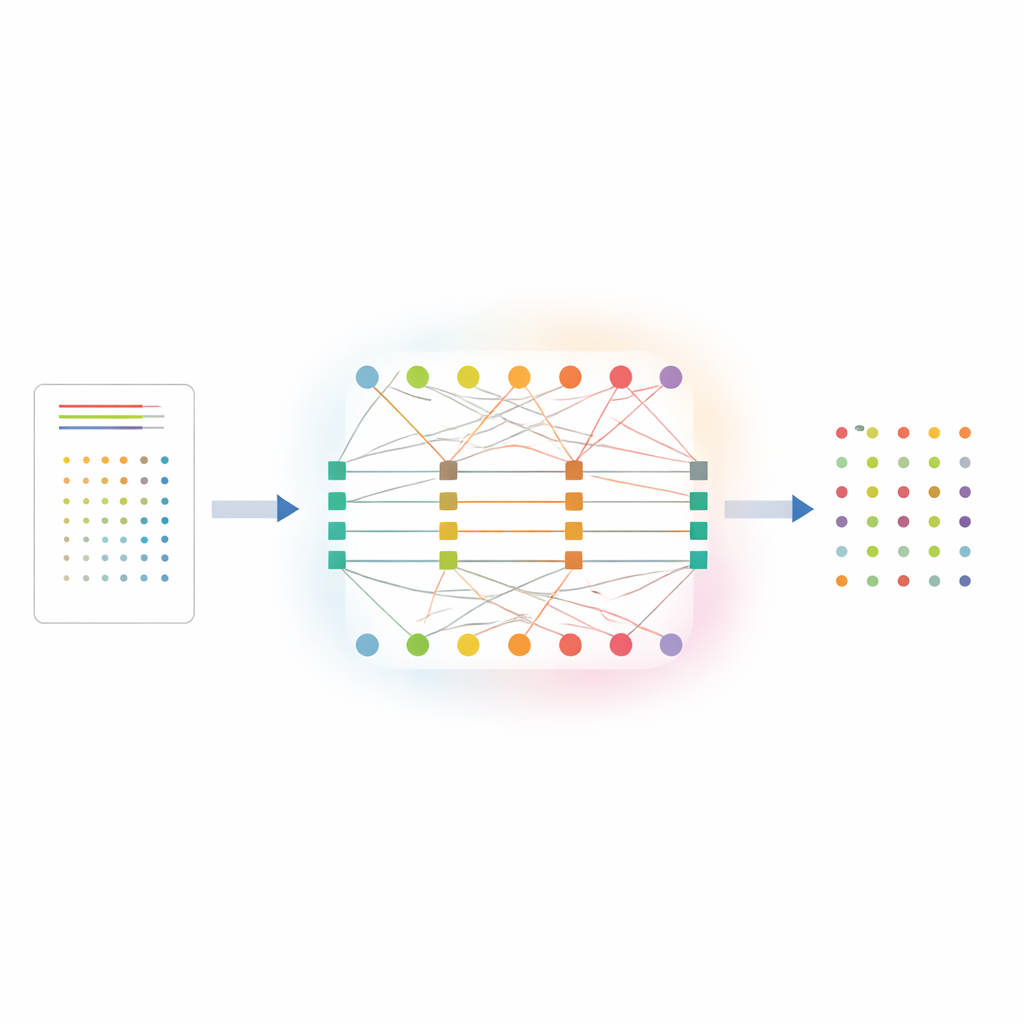

DCP‑AN aborda este problema modelando explícitamente cómo debe fluir la confianza entre muestras individuales y las clases a las que pertenecen. El método representa la relación entre muestras y clases como una red de dos capas: una capa de nodos para muestras y otra para clases, enlazadas por conexiones ponderadas que codifican las fortalezas de predicción iniciales. La confianza se refina luego mediante una danza de dos pasos. En el primer paso, la información fluye de las muestras a las clases, ajustando cuán dispersas están las predicciones de cada clase, guiado por cuánta incertidumbre parece tener esa clase en ese momento. En el segundo paso, la información regresa de las clases a las muestras, empujando el perfil de confianza de cada muestra según su coherencia con estimaciones anteriores. Al repetir este proceso de ida y vuelta un número limitado de veces, el sistema fomenta un mejor “trabajo en equipo” entre ejemplos y etiquetas, de modo que las clases raras reciben señales más claras en lugar de quedar ahogadas por las comunes.

Subir la temperatura donde hace falta

Una innovación clave en DCP‑AN es un “campo de temperatura” adaptativo que cambia la intensidad con la que el método remodela la confianza, según cómo se perciba la incertidumbre a nivel local y global. En lugar de usar un único valor de temperatura para todas las predicciones, el método calcula fuerzas de ajuste separadas para clases y para muestras, basadas en medidas de incertidumbre y desajuste a lo largo del tiempo. Para las clases head que la red ya maneja con confianza, la temperatura efectiva se enfría suavemente, evitando el sobre‑suavizado y preservando distinciones nítidas. Para las clases tail y las muestras ambiguas, la temperatura aumenta, permitiendo correcciones más fuertes que elevan su confianza cuando está justificado y atenúan picos espurios. Este comportamiento dinámico resulta de una regla de actualización principiada y se muestra capaz de responder con rapidez cuando la incertidumbre crece, manteniéndose estable cuando el modelo ya está bien alineado.

Mejora fiable en tareas y hardware

Los autores evalúan cuidadosamente DCP‑AN en varios conjuntos de imágenes de uso común. En una versión con distribución larga de ImageNet, donde algunas categorías tienen cientos de veces más imágenes que otras, el método aumenta la precisión en las clases raras (tail) en alrededor de 10 puntos porcentuales absolutos y reduce una medida estándar de error de calibración a más de la mitad en comparación con una línea base sin corrección. En una prueba de transferencia entre dominios que traslada un modelo entrenado en obras de arte a fotos del mundo real, DCP‑AN tanto incrementa la precisión en el nuevo dominio como reduce una medida estadística de la brecha entre los datos de origen y destino. Es importante destacar que estas mejoras no implican un coste computacional elevado: al ejecutarse en una tarjeta gráfica moderna, el método añade poco más de un milisegundo de demora y menos de medio megabyte de memoria adicional, manteniéndolo práctico para dispositivos en tiempo real y en el borde.

Qué significa esto para la IA cotidiana

En términos sencillos, este trabajo demuestra que podemos hacer los sistemas de IA no solo más inteligentes, sino también más conscientes de cuándo pueden estar equivocados. Al permitir que la información de confianza fluya de ida y vuelta entre ejemplos y categorías, y al adaptar cuán agresivamente se corrige según la incertidumbre cambiante, DCP‑AN ofrece estimaciones de probabilidad que coinciden mejor con la realidad—incluso para eventos raros y a través de entornos cambiantes. Porque viene con una garantía matemática de que sus actualizaciones iterativas se estabilizan con rapidez, y porque se ejecuta con una sobrecarga mínima, este marco podría integrarse en redes neuronales existentes en dominios como la salud, la robótica y la monitorización de seguridad. El resultado es una IA que sigue cometiendo errores, pero que es mucho más honesta sobre cuán segura está—un paso crucial hacia sistemas en los que las personas puedan confiar con seguridad.

Cita: He, P., Fu, W., Wang, L. et al. Calibrating deep classifiers with dynamic confidence propagation and adaptive normalization. Sci Rep 16, 10959 (2026). https://doi.org/10.1038/s41598-026-39842-4

Palabras clave: calibración de confianza, redes neuronales profundas, reconocimiento con distribución larga, estimación de incertidumbre, adaptación de dominio