Clear Sky Science · es

ACFM: algoritmo de fusión ponderada por canal adaptable para mejorar la detección de objetos pequeños en tráfico con UAV

Ver más desde el cielo

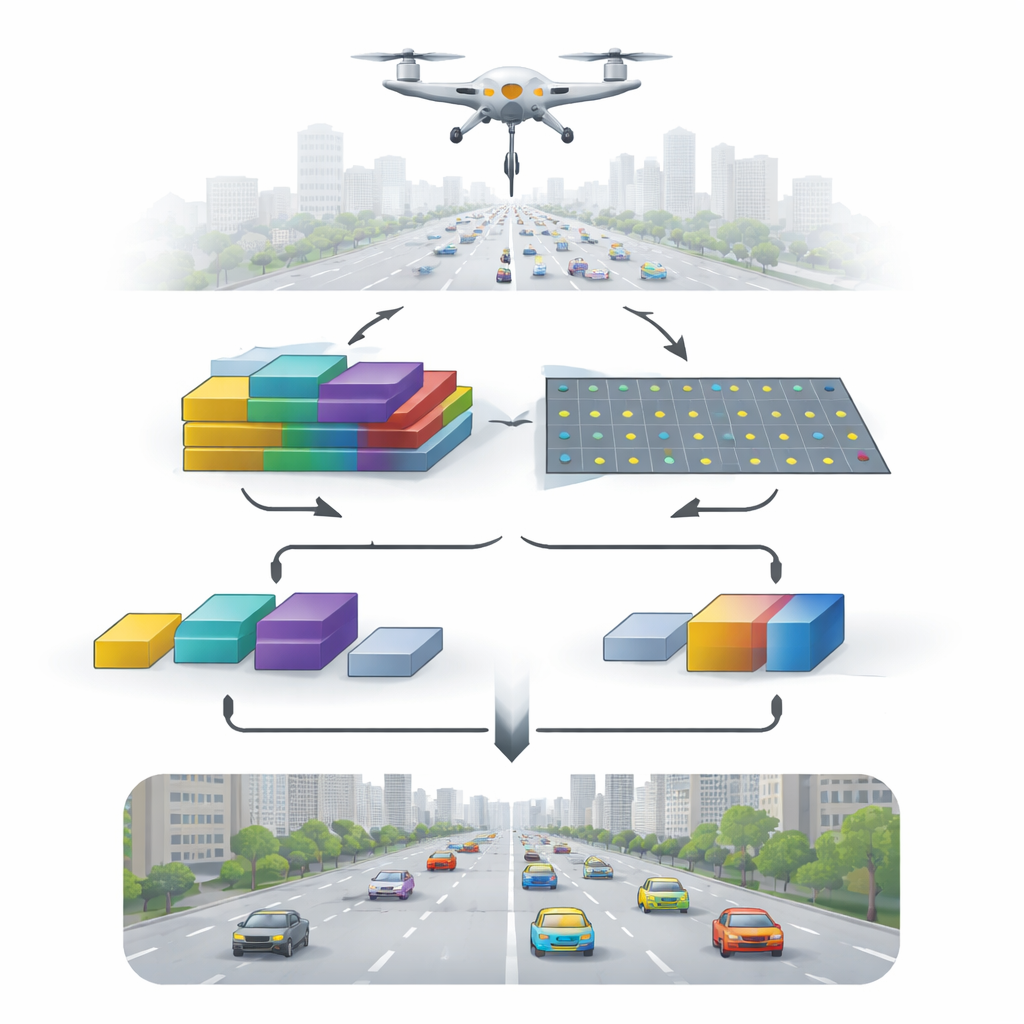

A medida que los drones vigilan cada vez más el tráfico, la seguridad de multitudes y zonas de desastre, se enfrentan a un problema simple pero persistente: desde gran altura, lo que nos interesa —coches, autobuses, incluso personas— a menudo ocupa solo unos pocos píxeles. Estas diminutas manchas son fáciles de pasar por alto para los algoritmos, especialmente en calles urbanas llenas de sombras, señales y desenfoque por movimiento. Este artículo presenta una nueva forma de ayudar a los ordenadores a «ver» con más claridad esos objetos pequeños en metraje de drones, sin ralentizar la detección de forma significativa.

Por qué importan los puntitos

Las cámaras de los drones capturan escenas amplias desde grandes alturas, de modo que una sola imagen puede contener autopistas, edificios, árboles y docenas de vehículos. La mayoría de esos vehículos aparecen muy pequeños y pueden solaparse u ocultarse unos a otros. Los detectores tradicionales basados en deep learning son excelentes encontrando objetos grandes y claros, pero tienden a perder los detalles finos a medida que la información avanza por las capas más profundas de la red. El resultado es que los vehículos pequeños se disuelven en el fondo, especialmente en cruces concurridos, con poca luz o en metraje ligeramente desenfocado. Los métodos multi-escala existentes ayudan en parte al combinar información de distintas capas de la red, pero por lo general se apoyan en reglas fijas predefinidas y les cuesta adaptarse cuando la escena se vuelve especialmente desordenada o compleja.

Una manera más inteligente de combinar pistas

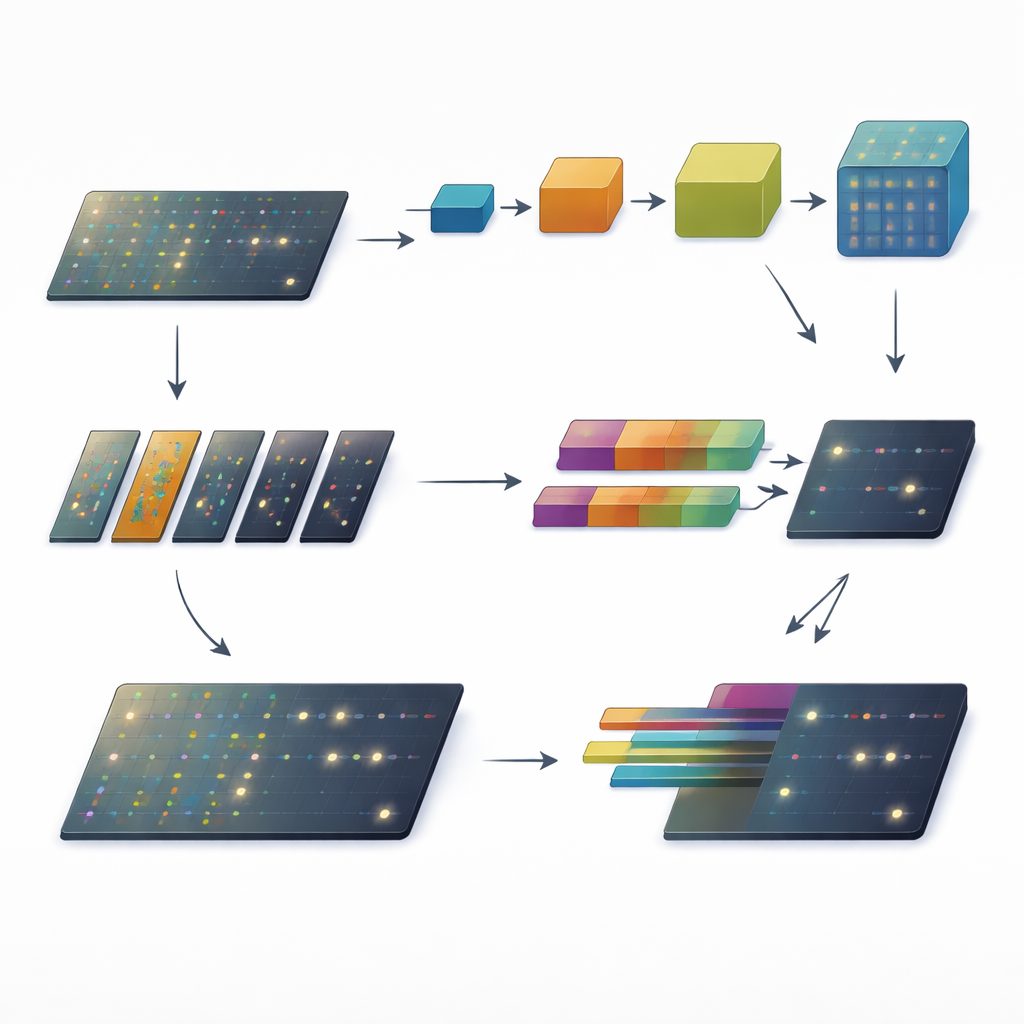

Los autores proponen un módulo de fusión ponderada por canal adaptable, o ACFM, diseñado para integrarse en detectores de objetos existentes y mejorar su capacidad para localizar objetivos pequeños en escenas de tráfico captadas por drones. En lugar de tratar toda la información visual por igual, ACFM ejecuta dos ramas especializadas en paralelo y luego fusiona sus salidas de forma dependiente de la escena. Una rama refina cómo se manejan las características a través de las escalas para que los detalles espaciales finos no se pierdan. La otra rama actúa como un foco, potenciando las señales verdaderamente importantes de objetos pequeños mientras suprime patrones de fondo que distraen. Crucialmente, la fusión entre estas ramas no es fija. ACFM ajusta cuánto confía en cada rama según la imagen actual, permitiendo al sistema reaccionar de manera distinta ante una autopista tranquila que ante una intersección densa.

Mantener los detalles a través de las escalas

En la primera rama, llamada bloque de refinamiento multi-escala, la red envía las características por un par de caminos. Un camino preserva simplemente la información original, asegurando que los detalles finos y de alta resolución sobrevivan. El otro camino comprime y luego expande la representación de la imagen, incentivando al modelo a comprender el contexto más amplio de dónde se sitúan los vehículos pequeños dentro de la escena. Al final, estos caminos se fusionan para que cada píxel de salida se beneficie tanto de detalles locales nítidos como de la comprensión del entorno circundante. Esto facilita al detector trazar cajas delimitadoras más ajustadas y coherentes alrededor de coches y autobuses pequeños de distintos tamaños, incluso cuando el fondo está ocupado o parcialmente oculto.

Reducir el ruido de fondo

La segunda rama se centra en la atención. Divide los canales de características en grupos y, para cada grupo, aprende una «máscara» escasa que resalta solo las regiones más prometedoras. Las áreas que parecen fondo —superficies de la calzada, tejados de edificios, copas de árboles— se atenúan, mientras que señales pequeñas pero relevantes, como reflejos y bordes de vehículos, se amplifican. Al combinar estos detalles realzados con las características originales de forma controlada, esta rama de atención agrupada y dispersa produce una vista de la escena más limpia y discriminativa. Así se reduce la probabilidad de que el detector confunda patrones del asfalto o sombras proyectadas por edificios con vehículos reales.

Dejar que la escena elija la mezcla

La pieza final de ACFM es un mecanismo de ponderación adaptable a nivel de canal que decide, canal por canal, cuánto confiar en cada rama. Primero resume lo que ocurre en toda la imagen y luego utiliza una operación ligera para inferir un conjunto de pesos entre cero y uno. Si la escena es simple y los objetos están bien separados, la red puede apoyarse más en el refinamiento multi-escala. Si la escena es densa, desordenada o ruidosa, puede desplazar más énfasis hacia la rama de atención que suprime las distracciones del fondo. Este balance dinámico sustituye reglas de fusión rígidas y manuales por una estrategia automática y basada en datos, permitiendo que el detector responda con flexibilidad cuando las condiciones cambian de un fotograma a otro.

Ojos más agudos para el tráfico con drones

Al integrarse en un detector popular llamado GFL y probarse en tres conjuntos públicos de datos de tráfico con drones, ACFM mejoró de forma consistente las puntuaciones de detección, especialmente en conjuntos desafiantes con muchos vehículos pequeños y solapados. Las mejoras en precisión llegaron con un coste computacional adicional reducido, lo que significa que el sistema mejorado puede seguir funcionando cerca del tiempo real —un requisito crítico para la vigilancia práctica del tráfico. Para el público general, la conclusión es clara: preservando detalles, suprimiendo el ruido y adaptando cómo se combinan las características según la escena, ACFM ayuda a que los drones actúen más como observadores humanos atentos y menos como comparadores rígidos de patrones, ofreciendo una base más fiable para futuras aplicaciones de ciudades inteligentes y monitorización aérea.

Cita: Liu, S., Zhu, H., Yuan, Z. et al. ACFM: adaptive channel weighted fusion algorithm for improving small object detection performance in UAV traffic. Sci Rep 16, 8366 (2026). https://doi.org/10.1038/s41598-026-39789-6

Palabras clave: monitorización del tráfico con drones, detección de objetos pequeños, visión por computador, mecanismos de atención, fusión de características multi-escala